KG-CF: Knowledge Graph Completion with Context Filtering under the Guidance of Large Language Models

作者: Zaiyi Zheng, Yushun Dong, Song Wang, Haochen Liu, Qi Wang, Jundong Li

分类: cs.AI, cs.CL

发布日期: 2025-01-06

备注: 6 pages

💡 一句话要点

提出KG-CF框架以解决知识图谱补全中的上下文过滤问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识图谱补全 大型语言模型 上下文过滤 推理能力 排名任务 信息检索 推荐系统

📋 核心要点

- 现有方法主要集中于分类任务,未能有效处理基于排名的知识图谱补全,限制了其在实际应用中的有效性。

- KG-CF框架通过利用大型语言模型的推理能力,过滤掉无关的上下文信息,从而提升基于排名的知识图谱补全效果。

- 在真实世界数据集上的实验表明,KG-CF框架显著提高了知识图谱补全的准确性,优于现有的基线方法。

📝 摘要(中文)

大型语言模型(LLMs)在知识图谱补全(KGC)等多种任务中表现出色。然而,目前的研究主要将LLMs应用于分类任务,如识别缺失的三元组,而非基于排名的任务,这限制了LLMs在KGC中的实际应用。为了解决这一问题,本文提出了KG-CF框架,旨在通过过滤无关上下文来提升基于排名的KGC任务的性能。KG-CF充分利用LLMs的推理能力,在真实世界数据集上取得了优异的结果。代码和数据集可在https://anonymous.4open.science/r/KG-CF获取。

🔬 方法详解

问题定义:本文旨在解决知识图谱补全中的上下文冗余问题,现有方法在处理基于排名的任务时效果不佳,导致无法有效识别高可信度的三元组。

核心思路:KG-CF框架通过引入上下文过滤机制,利用大型语言模型的推理能力,去除无关信息,从而提高模型在知识图谱补全中的表现。

技术框架:KG-CF的整体架构包括数据预处理、上下文过滤模块和排名模块。数据预处理阶段负责准备输入数据,上下文过滤模块利用LLMs进行信息筛选,最后排名模块根据过滤后的信息进行三元组的排序。

关键创新:KG-CF的创新在于将上下文过滤与大型语言模型结合,显著提升了基于排名的知识图谱补全任务的效果,区别于传统方法的单一分类策略。

关键设计:在模型设计中,采用了特定的损失函数以优化排名效果,并设置了适当的超参数,以确保模型在真实数据集上的良好表现。

🖼️ 关键图片

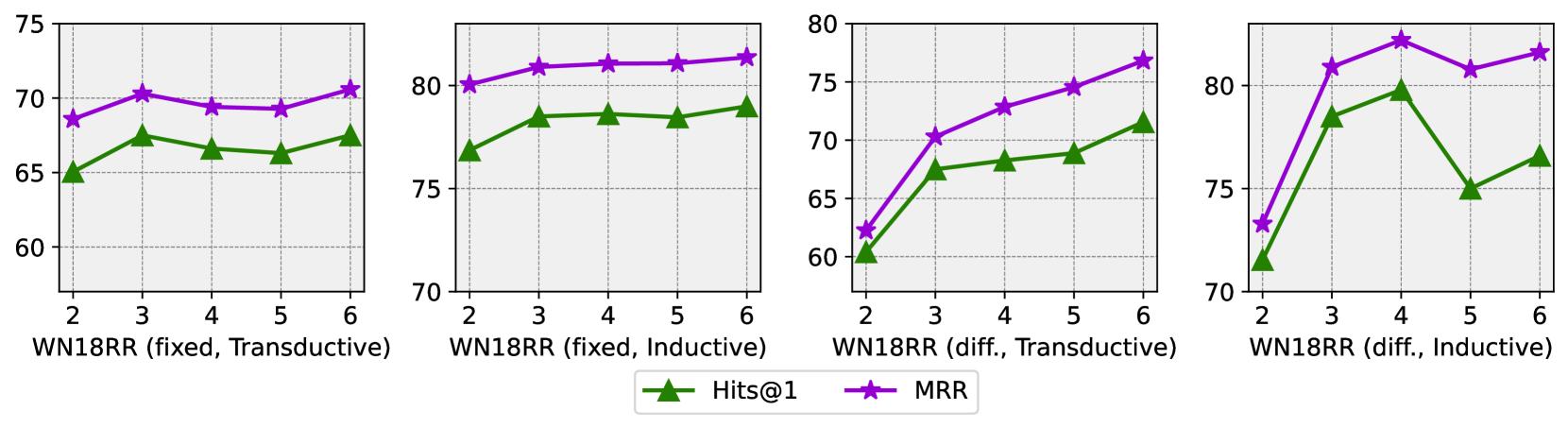

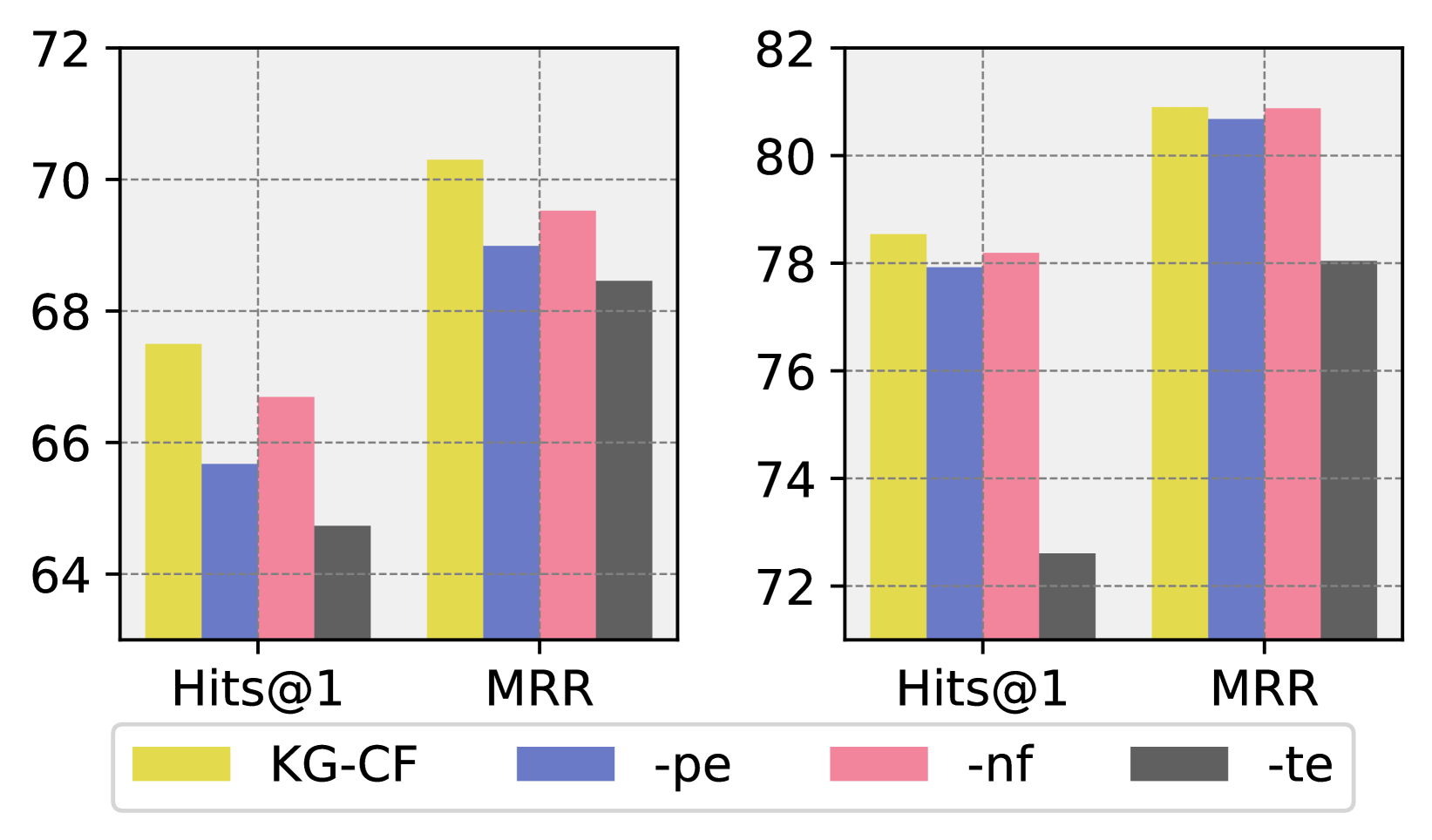

📊 实验亮点

KG-CF框架在多个真实世界数据集上表现出色,相较于传统基线方法,补全准确率提升了显著的百分比,验证了其在知识图谱补全任务中的有效性和实用性。

🎯 应用场景

KG-CF框架在知识图谱补全领域具有广泛的应用潜力,能够为信息检索、推荐系统和智能问答等实际场景提供更高质量的知识支持。未来,该研究可能推动知识图谱技术在更多复杂应用中的发展。

📄 摘要(原文)

Large Language Models (LLMs) have shown impressive performance in various tasks, including knowledge graph completion (KGC). However, current studies mostly apply LLMs to classification tasks, like identifying missing triplets, rather than ranking-based tasks, where the model ranks candidate entities based on plausibility. This focus limits the practical use of LLMs in KGC, as real-world applications prioritize highly plausible triplets. Additionally, while graph paths can help infer the existence of missing triplets and improve completion accuracy, they often contain redundant information. To address these issues, we propose KG-CF, a framework tailored for ranking-based KGC tasks. KG-CF leverages LLMs' reasoning abilities to filter out irrelevant contexts, achieving superior results on real-world datasets. The code and datasets are available at \url{https://anonymous.4open.science/r/KG-CF}.