Energy Optimization of Multi-task DNN Inference in MEC-assisted XR Devices: A Lyapunov-Guided Reinforcement Learning Approach

作者: Yanzan Sun, Jiacheng Qiu, Guangjin Pan, Shugong Xu, Shunqing Zhang, Xiaoyun Wang, Shuangfeng Han

分类: cs.NI, cs.AI, eess.SY

发布日期: 2025-01-05

备注: 13 pages, 7 figures. This work has been submitted to the IEEE for possible publication

💡 一句话要点

提出Lyapunov引导的PPO算法,优化MEC辅助XR设备中多任务DNN推理的能耗。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 边缘计算 扩展现实 深度神经网络 强化学习 Lyapunov优化 资源分配 能耗优化

📋 核心要点

- XR设备面临计算和能耗挑战,现有方法难以有效解决资源竞争和队列耦合问题。

- 提出双时间尺度联合优化策略,结合Lyapunov优化和PPO算法,实现模型划分和资源分配。

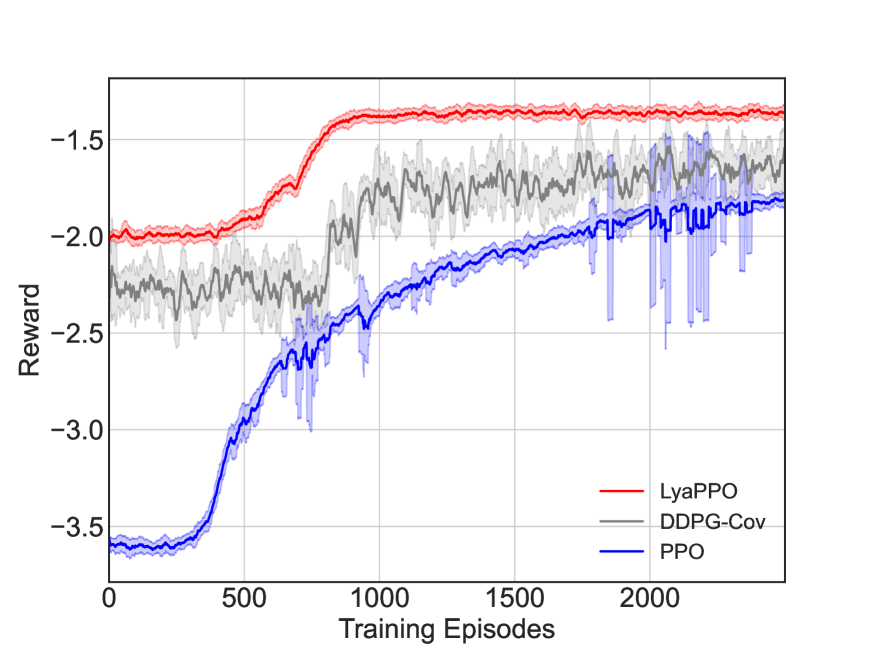

- 实验结果表明,LyaPPO算法在节能方面优于基线算法,节能效果显著。

📝 摘要(中文)

本文针对未来网络关键应用——扩展现实(XR),在边缘计算(MEC)辅助下,研究了多任务DNN推理的能耗优化问题。针对轻量级XR设备面临的计算和能量挑战,建立了多任务DNN推理的分布式队列模型,解决了资源竞争和队列耦合问题。设计了一种双时间尺度联合优化策略,用于模型划分和资源分配,并将其形式化为双层优化问题。该策略旨在最小化XR设备的总能耗,同时保证队列稳定性并满足计算和通信资源约束。为此,提出了一种Lyapunov引导的近端策略优化算法(LyaPPO)。数值结果表明,LyaPPO算法优于基线算法,在不同资源容量下实现了24.79%至46.14%的节能效果。与基线算法相比,该算法将XR设备的能耗降低了24.29%至56.62%。

🔬 方法详解

问题定义:论文旨在解决在MEC辅助的XR设备上,多任务DNN推理过程中的高能耗问题。现有的方法可能无法有效地处理多任务之间的资源竞争,以及由于任务到达的随机性导致的队列不稳定问题,从而导致更高的能耗和延迟。

核心思路:论文的核心思路是将模型划分和资源分配问题建模为一个双层优化问题,并利用Lyapunov优化理论来保证队列的稳定性。同时,采用强化学习算法(PPO)来寻找最优的策略,从而在满足队列稳定性约束的前提下,最小化XR设备的能耗。这种设计旨在平衡能耗和性能,并适应动态变化的任务负载。

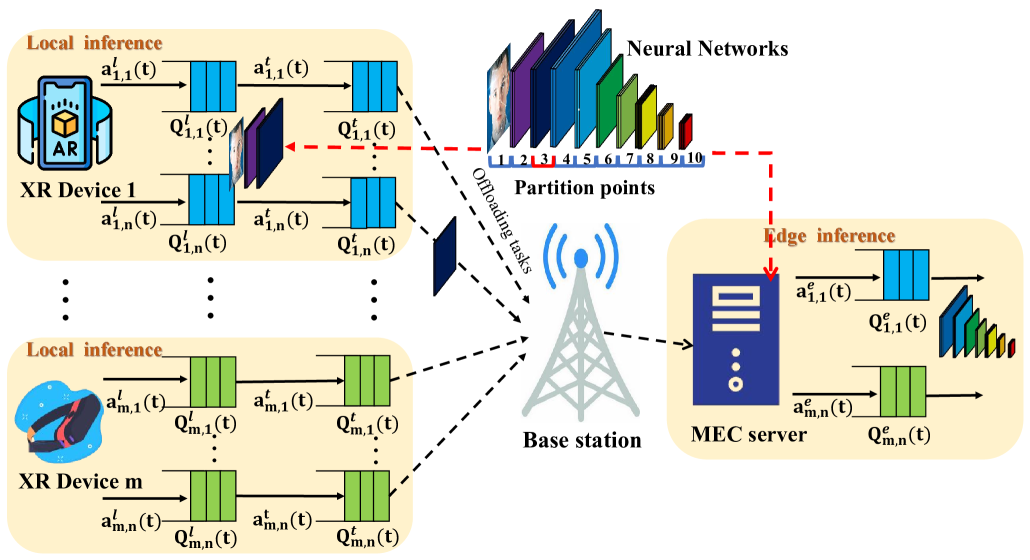

技术框架:整体框架包含三个主要部分:XR设备、MEC服务器和云服务器(可选)。XR设备负责收集数据和执行部分DNN推理任务,MEC服务器负责执行剩余的DNN推理任务,云服务器作为补充资源。论文提出的LyaPPO算法在MEC服务器上运行,根据XR设备的状态(如队列长度、资源利用率等)动态地调整模型划分和资源分配策略。

关键创新:论文的关键创新在于将Lyapunov优化与PPO算法相结合,提出了一种新的强化学习算法LyaPPO。Lyapunov优化用于保证队列的稳定性,而PPO算法用于寻找最优的资源分配策略。这种结合使得算法能够在保证系统稳定的前提下,有效地降低能耗。此外,双时间尺度优化策略也是一个创新点,它将模型划分和资源分配问题分解为两个时间尺度不同的子问题,从而降低了问题的复杂度。

关键设计:论文设计了一个分布式队列模型来描述多任务DNN推理过程。每个任务都有一个队列,用于存储等待处理的数据。Lyapunov函数用于衡量系统的稳定性,其目标是使Lyapunov漂移(Lyapunov drift)最小化。PPO算法使用Actor-Critic网络结构,Actor网络用于生成策略,Critic网络用于评估策略的价值。损失函数包括PPO的clip loss、value loss和entropy loss,以及一个与Lyapunov漂移相关的惩罚项。关键参数包括学习率、折扣因子、clip范围和惩罚系数等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LyaPPO算法在不同资源容量下实现了24.79%至46.14%的节能效果。与基线算法相比,LyaPPO算法将XR设备的能耗降低了24.29%至56.62%。这些结果表明,LyaPPO算法能够有效地降低XR设备的能耗,并且在不同的资源条件下都具有良好的性能。

🎯 应用场景

该研究成果可应用于各种需要低延迟和低功耗的边缘计算场景,例如AR/VR游戏、远程医疗、智能制造等。通过优化DNN推理过程,可以显著降低XR设备的能耗,延长电池续航时间,并提升用户体验。此外,该方法还可以推广到其他类型的边缘计算应用,例如智能监控、自动驾驶等。

📄 摘要(原文)

Extended reality (XR), blending virtual and real worlds, is a key application of future networks. While AI advancements enhance XR capabilities, they also impose significant computational and energy challenges on lightweight XR devices. In this paper, we developed a distributed queue model for multi-task DNN inference, addressing issues of resource competition and queue coupling. In response to the challenges posed by the high energy consumption and limited resources of XR devices, we designed a dual time-scale joint optimization strategy for model partitioning and resource allocation, formulated as a bi-level optimization problem. This strategy aims to minimize the total energy consumption of XR devices while ensuring queue stability and adhering to computational and communication resource constraints. To tackle this problem, we devised a Lyapunov-guided Proximal Policy Optimization algorithm, named LyaPPO. Numerical results demonstrate that the LyaPPO algorithm outperforms the baselines, achieving energy conservation of 24.79% to 46.14% under varying resource capacities. Specifically, the proposed algorithm reduces the energy consumption of XR devices by 24.29% to 56.62% compared to baseline algorithms.