Effective LLM-Driven Code Generation with Pythoness

作者: Kyla H. Levin, Kyle Gwilt, Emery D. Berger, Stephen N. Freund

分类: cs.PL, cs.AI, cs.SE

发布日期: 2025-01-03

备注: 5 pages

💡 一句话要点

Pythoness:利用领域特定语言提升LLM驱动的代码生成质量

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 代码生成 大型语言模型 领域特定语言 行为规范 测试驱动开发

📋 核心要点

- 现有LLM代码生成缺乏正确性和可靠性保证,开发者面临优化、集成和维护AI生成代码的挑战。

- Pythoness提出一种嵌入式DSL,允许开发者在高层次的行为规范(如测试)上与LLM交互,而非直接操作代码。

- Pythoness原型实现表明,结合测试和代码生成能产生比仅使用规范更高质量的代码。

📝 摘要(中文)

大型语言模型(LLMs)的出现为编程工具开辟了新纪元,但也带来了代码正确性和可靠性方面的风险。开发者在使用LLMs时,面临着优化、集成和维护AI生成代码的难题。我们提出了一个嵌入式领域特定语言(DSL)Pythoness来应对这些挑战。在Pythoness中,开发者可以在更高的抽象层次上与LLMs进行编程。使用Pythoness的开发者不是直接与生成的代码交互,而是在编写函数、类或整个程序时,操作行为规范。这些规范可以采用单元测试和基于属性的测试的形式,可以用形式化语言或自然语言表达。在这些规范的指导下,Pythoness生成既能通过测试,又能在执行过程中持续检查的代码。我们认为,Pythoness方法使开发者能够充分利用LLMs在代码生成方面的潜力,同时大大降低其固有的风险。我们描述了Pythoness的当前原型实现,并证明它可以成功地利用测试和代码生成的组合来产生比仅使用规范更高质量的代码。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在代码生成过程中产生的代码质量问题。现有方法直接使用LLMs生成代码,缺乏对代码正确性和可靠性的保证,开发者需要花费大量精力进行调试、优化和维护。这限制了LLMs在软件开发中的应用。

核心思路:论文的核心思路是引入一个嵌入式领域特定语言(DSL)Pythoness,让开发者在高层次的行为规范上与LLMs交互。开发者通过编写测试用例(包括单元测试和基于属性的测试)来描述期望的代码行为,Pythoness利用这些测试用例来引导LLMs生成符合规范的代码,并在执行过程中持续检查代码的正确性。

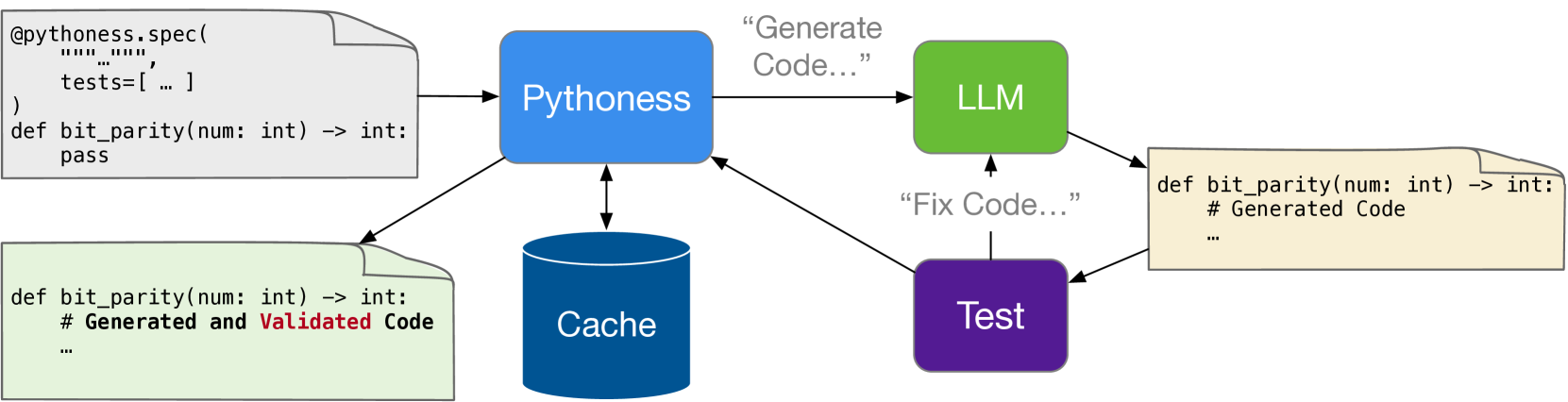

技术框架:Pythoness的技术框架包含以下几个主要模块:1. 规范定义模块:允许开发者使用形式化语言或自然语言编写测试用例,描述期望的代码行为。2. 代码生成模块:利用LLMs根据规范生成代码。3. 测试执行模块:执行测试用例,评估生成的代码是否符合规范。4. 代码优化模块:根据测试结果,对生成的代码进行优化,直到代码通过所有测试用例。5. 运行时检查模块:在代码执行过程中,持续检查代码的正确性,及时发现并修复错误。

关键创新:最重要的技术创新点是引入了行为规范作为LLM代码生成的指导。与直接使用LLMs生成代码相比,Pythoness通过测试用例来约束LLMs的行为,从而生成更高质量、更可靠的代码。这种方法将开发者的意图更清晰地传递给LLMs,减少了LLMs产生错误代码的可能性。

关键设计:Pythoness的关键设计包括:1. 测试用例的表达形式:支持形式化语言和自然语言,方便开发者编写测试用例。2. 代码生成策略:采用多种代码生成策略,例如基于模板的代码生成、基于示例的代码生成等,以提高代码生成的效率和质量。3. 测试执行框架:支持多种测试框架,例如unittest、pytest等,方便开发者进行测试。4. 运行时检查机制:采用多种运行时检查技术,例如断言、类型检查等,以提高代码的可靠性。

🖼️ 关键图片

📊 实验亮点

论文展示了Pythoness能够利用测试和代码生成的组合来产生比仅使用规范更高质量的代码。具体实验数据未知,但强调了结合测试用例的优势,表明Pythoness在提高代码质量方面具有潜力。未来的工作可以进一步量化Pythoness的性能提升。

🎯 应用场景

Pythoness可应用于各种软件开发场景,尤其是在需要高可靠性和安全性的领域,如金融、医疗和航空航天等。它可以帮助开发者更高效地利用LLMs生成高质量的代码,降低开发成本,缩短开发周期。未来,Pythoness有望成为LLM驱动的软件开发的重要工具。

📄 摘要(原文)

The advent of large language models (LLMs) has paved the way for a new era of programming tools with both significant capabilities and risks, as the generated code lacks guarantees of correctness and reliability. Developers using LLMs currently face the difficult task of optimizing, integrating, and maintaining code generated by AI. We propose an embedded domain-specific language (DSL), Pythoness, to address those challenges. In Pythoness, developers program with LLMs at a higher level of abstraction. Rather than interacting directly with generated code, developers using Pythoness operate at the level of behavioral specifications when writing functions, classes, or an entire program. These specifications can take the form of unit tests and property-based tests, which may be expressed formally or in natural language. Guided by these specifications, Pythoness generates code that both passes the tests and can be continuously checked during execution. We posit that the Pythoness approach lets developers harness the full potential of LLMs for code generation while substantially mitigating their inherent risks. We describe our current prototype implementation of Pythoness and demonstrate that it can successfully leverage a combination of tests and code generation to yield higher quality code than specifications alone.