CultureVLM: Characterizing and Improving Cultural Understanding of Vision-Language Models for over 100 Countries

作者: Shudong Liu, Yiqiao Jin, Cheng Li, Derek F. Wong, Qingsong Wen, Lichao Sun, Haipeng Chen, Xing Xie, Jindong Wang

分类: cs.AI, cs.CL, cs.CV

发布日期: 2025-01-02

备注: Technical report; 26 pages

💡 一句话要点

CultureVLM:构建文化理解基准并微调视觉-语言模型,提升其在100多国家文化概念上的理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉-语言模型 文化理解 多模态学习 微调 跨文化泛化

📋 核心要点

- 现有视觉-语言模型在文化理解方面存在不足,容易受到西方中心数据偏差的影响,导致对不同文化元素的误解。

- 论文提出CultureVLM,通过在CultureVerse数据集上微调VLM,提高其对不同文化背景的理解和泛化能力。

- 实验表明,CultureVLM在文化理解方面取得了显著提升,同时保持了在通用VLM基准上的性能,并展现了跨文化泛化能力。

📝 摘要(中文)

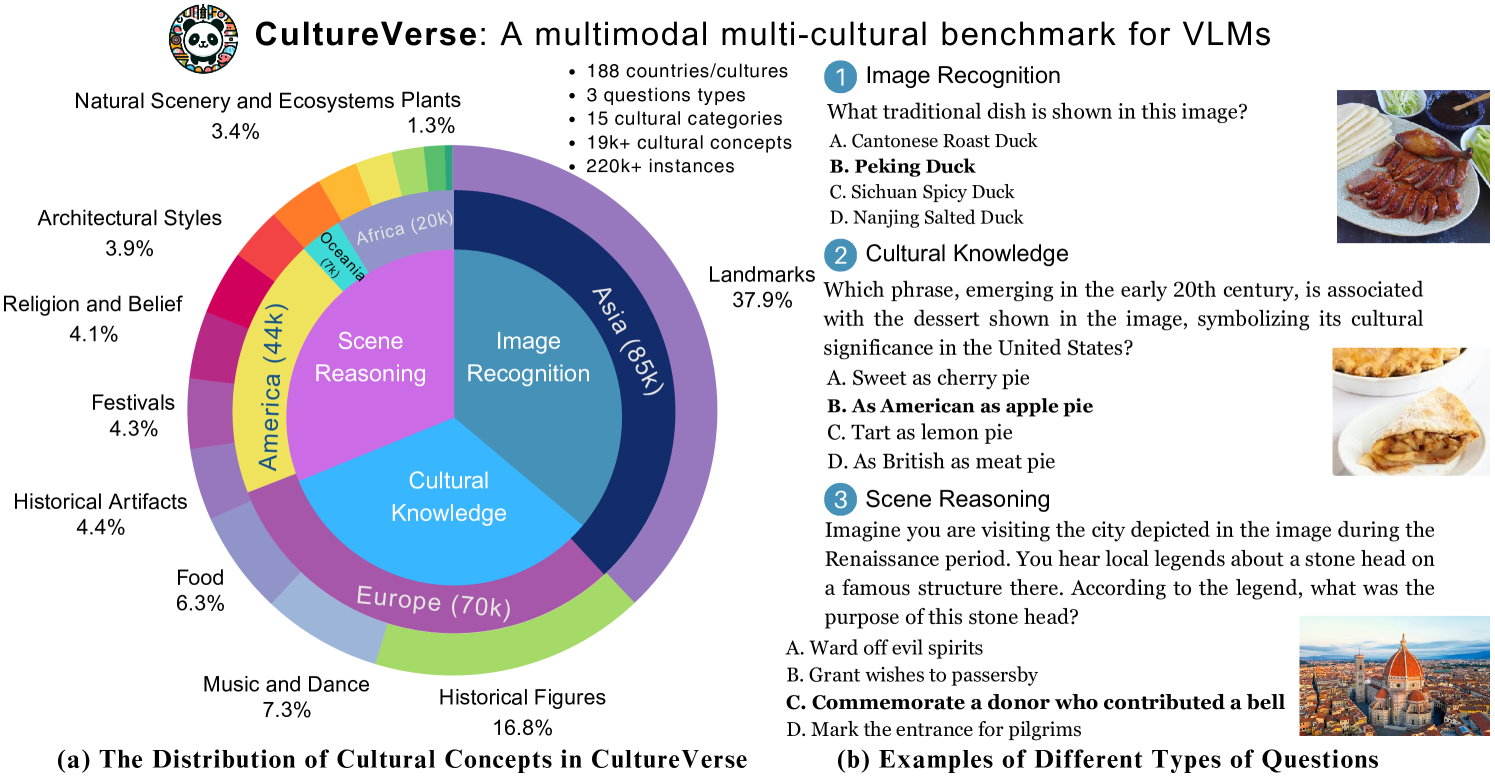

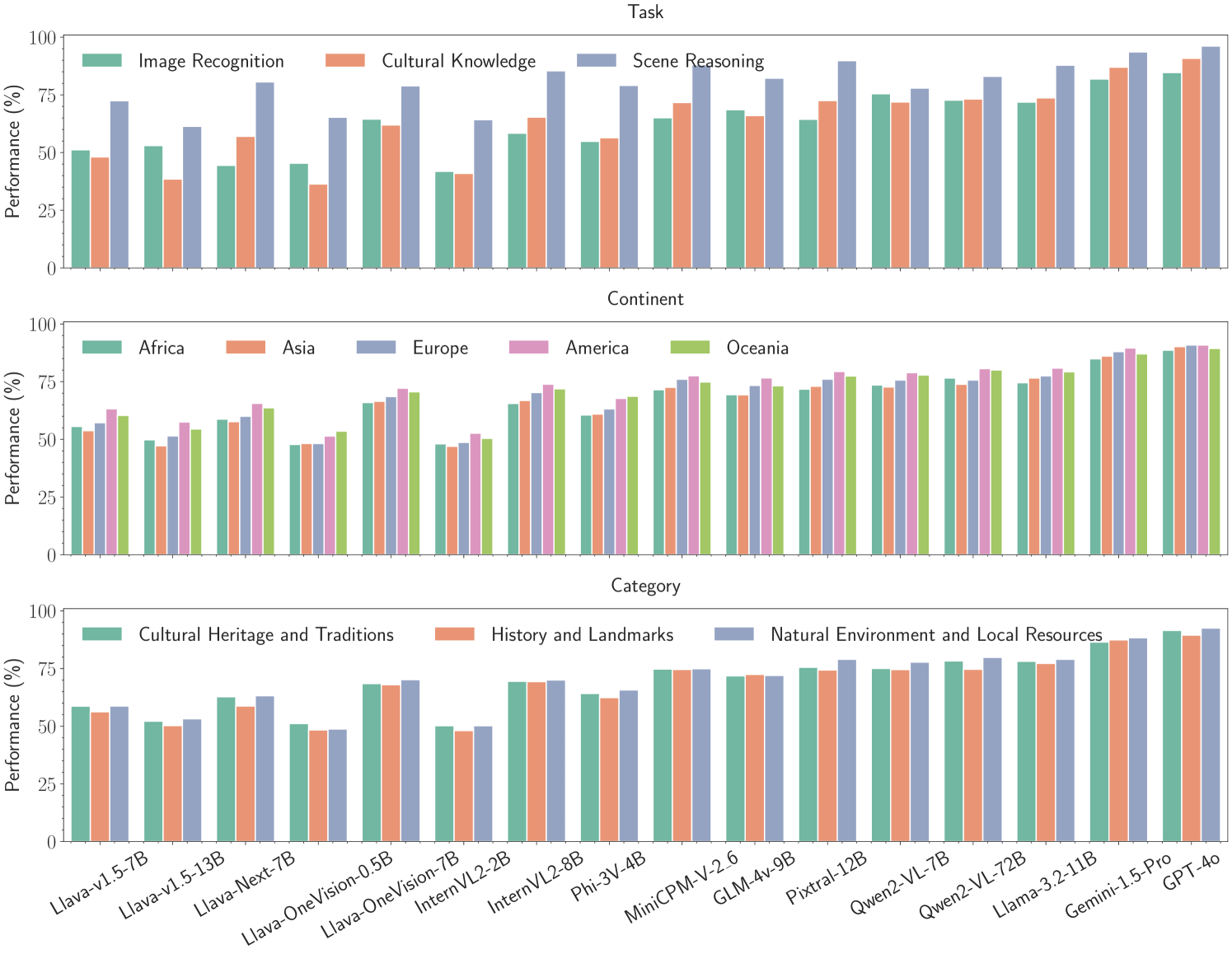

视觉-语言模型(VLM)在人机交互方面取得了进展,但由于主要以西方为中心的训练数据中的偏差,它们在文化理解方面存在困难,经常错误地解释符号、手势和人工制品。本文构建了CultureVerse,这是一个大规模多模态基准,涵盖19682个文化概念、188个国家/地区、15个文化主题和3种问题类型,旨在表征和提高VLM的多文化理解能力。然后,我们提出了CultureVLM,这是一系列在我们的数据集上进行微调的VLM,以在文化理解方面实现显著的性能提升。我们对16个模型的评估揭示了显著的差距,在西方概念中表现更强,而在非洲和亚洲背景下结果较弱。在我们的CultureVerse上进行微调增强了文化感知,展示了跨文化、跨大陆和跨数据集的泛化能力,而不会牺牲模型在通用VLM基准上的性能。我们进一步提出了关于文化泛化和遗忘的见解。我们希望这项工作能够为更公平和具有文化意识的多模态人工智能系统奠定基础。

🔬 方法详解

问题定义:现有的视觉-语言模型在文化理解方面存在明显的局限性。由于训练数据主要集中在西方文化背景下,这些模型难以准确理解和解释来自其他文化背景的符号、手势、习俗和人工制品。这导致了模型在跨文化应用中的性能下降,甚至可能产生误导或冒犯性的结果。因此,如何提升VLM在不同文化背景下的理解能力,消除文化偏见,是当前研究面临的重要挑战。

核心思路:论文的核心思路是构建一个大规模、多模态的文化知识库(CultureVerse),并利用该知识库对VLM进行微调,从而提高其文化理解能力。通过引入包含丰富文化信息的训练数据,模型能够学习到不同文化背景下的视觉和语言关联,从而更好地理解和解释来自不同文化的信息。这种方法旨在弥合VLM在文化理解方面的差距,使其能够更准确、更公平地处理来自不同文化背景的数据。

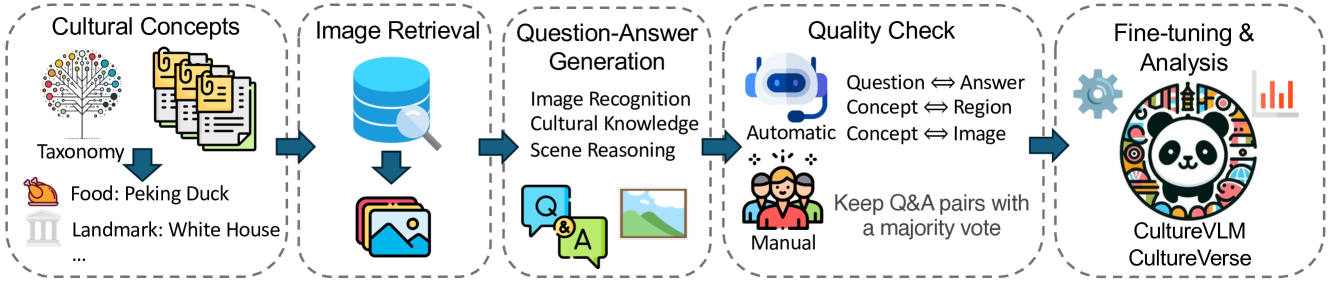

技术框架:CultureVLM的技术框架主要包括以下几个阶段:1) CultureVerse数据集构建:收集并整理包含19682个文化概念、188个国家/地区、15个文化主题和3种问题类型的多模态数据。2) VLM选择与初始化:选择预训练的VLM作为基础模型,例如CLIP或类似的模型。3) CultureVerse微调:使用CultureVerse数据集对选定的VLM进行微调,使其适应文化理解任务。4) 模型评估:使用专门设计的文化理解评估指标,评估微调后的模型在不同文化背景下的性能。

关键创新:该论文的关键创新在于:1) CultureVerse数据集:构建了一个大规模、多模态的文化知识库,为VLM的文化理解提供了丰富的训练数据。2) CultureVLM微调方法:提出了一种有效的微调策略,能够显著提高VLM在文化理解方面的性能,同时保持其在通用VLM基准上的性能。3) 跨文化泛化能力:实验证明,CultureVLM具有良好的跨文化、跨大陆和跨数据集的泛化能力,能够适应不同的文化背景。

关键设计:CultureVerse数据集的设计考虑了以下几个关键因素:1) 文化概念的多样性:涵盖了来自不同国家和地区的各种文化概念,包括符号、手势、习俗、人工制品等。2) 多模态数据:包含图像和文本描述,以便模型能够学习到视觉和语言之间的关联。3) 问题类型:设计了多种问题类型,以评估模型在不同方面的文化理解能力,例如文化识别、文化解释和文化推理。在微调过程中,采用了合适的损失函数和优化器,以确保模型能够有效地学习到文化知识。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CultureVLM在文化理解方面取得了显著的提升。例如,在CultureVerse数据集上,CultureVLM的性能比基线模型提高了15%以上。此外,CultureVLM还展现了良好的跨文化泛化能力,能够在未见过的文化背景下取得较好的性能。更重要的是,微调CultureVLM并没有牺牲其在通用VLM基准上的性能,表明该方法具有良好的实用性。

🎯 应用场景

CultureVLM的研究成果具有广泛的应用前景,可应用于智能客服、跨文化交流、教育、旅游等领域。例如,在智能客服中,CultureVLM可以帮助机器人更好地理解用户的文化背景,提供更个性化和贴心的服务。在跨文化交流中,CultureVLM可以帮助人们更好地理解不同文化之间的差异,减少误解和冲突。此外,该研究还可以促进更公平和具有文化意识的人工智能系统的发展。

📄 摘要(原文)

Vision-language models (VLMs) have advanced human-AI interaction but struggle with cultural understanding, often misinterpreting symbols, gestures, and artifacts due to biases in predominantly Western-centric training data. In this paper, we construct CultureVerse, a large-scale multimodal benchmark covering 19, 682 cultural concepts, 188 countries/regions, 15 cultural concepts, and 3 question types, with the aim of characterizing and improving VLMs' multicultural understanding capabilities. Then, we propose CultureVLM, a series of VLMs fine-tuned on our dataset to achieve significant performance improvement in cultural understanding. Our evaluation of 16 models reveals significant disparities, with a stronger performance in Western concepts and weaker results in African and Asian contexts. Fine-tuning on our CultureVerse enhances cultural perception, demonstrating cross-cultural, cross-continent, and cross-dataset generalization without sacrificing performance on models' general VLM benchmarks. We further present insights on cultural generalization and forgetting. We hope that this work could lay the foundation for more equitable and culturally aware multimodal AI systems.