From Generalist to Specialist: A Survey of Large Language Models for Chemistry

作者: Yang Han, Ziping Wan, Lu Chen, Kai Yu, Xin Chen

分类: physics.chem-ph, cs.AI, cs.CL, cs.LG

发布日期: 2024-12-28

备注: COLING2025,We maintain an up-to-date Github repository at: https://github.com/OpenDFM/LLM4Chemistry

💡 一句话要点

综述:化学领域大语言模型研究进展与应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 化学信息学 多模态学习 领域知识融合 化学工具 科学发现 综述

📋 核心要点

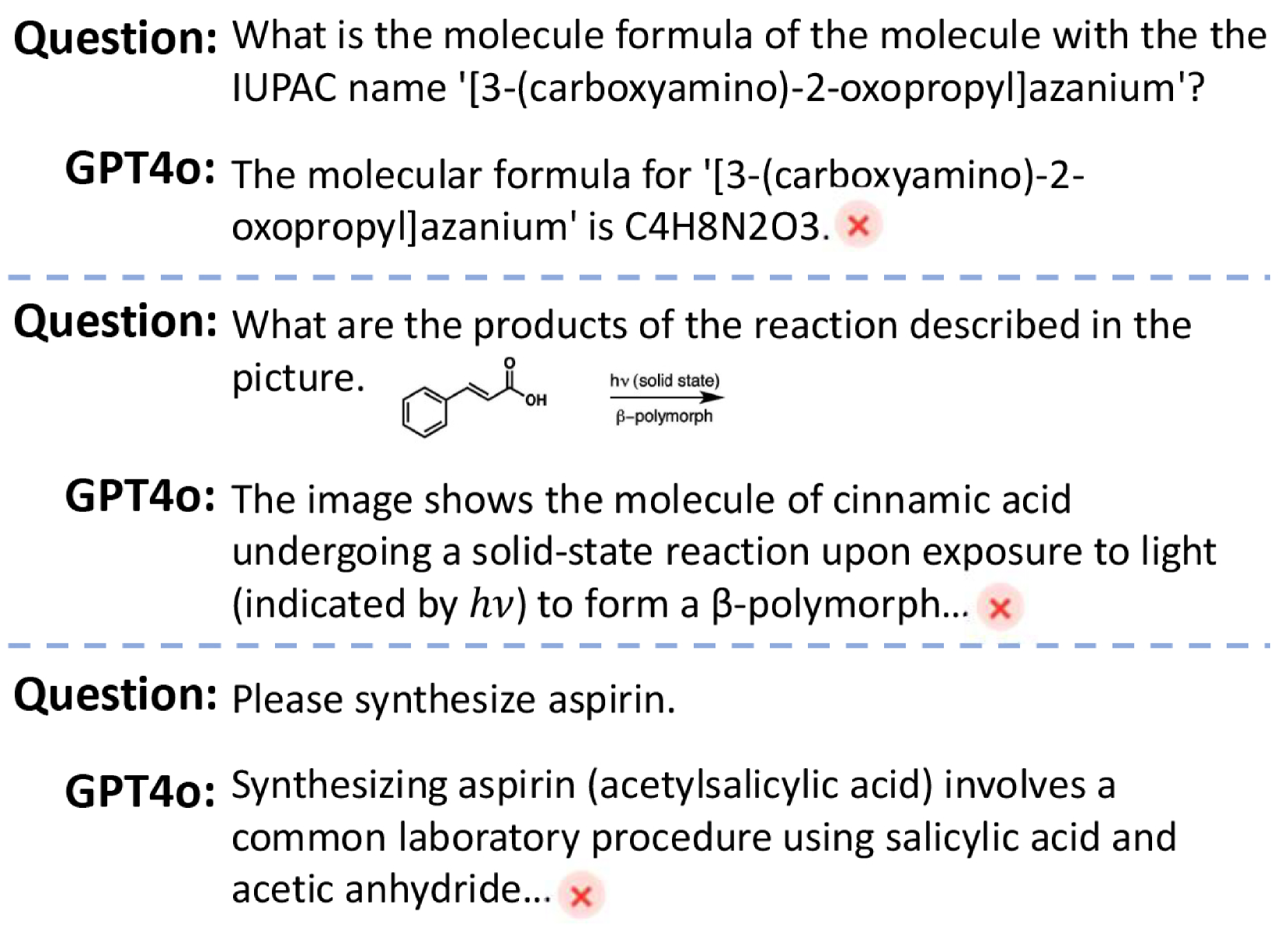

- 现有LLM在化学领域应用受限,主要由于缺乏专业化学数据和处理复杂多模态信息的能力。

- 本文旨在系统性地综述化学领域LLM的研究进展,包括知识融合、工具使用和能力评估。

- 通过分析现有方法和挑战,为化学LLM的未来研究方向提供指导,促进创新应用。

📝 摘要(中文)

大语言模型(LLMs)显著改变了我们的日常生活,并在自然语言处理(NLP)领域建立了一种新的范式。然而,LLMs主要基于大量网络文本的预训练,对于高级科学发现,尤其是在化学领域,仍然是不够的。专业化学数据的稀缺,以及2D图、3D结构和光谱等多模态数据的复杂性,带来了独特的挑战。尽管一些研究已经回顾了化学领域的预训练语言模型(PLMs),但明显缺乏专门针对化学LLMs的系统性综述。本文概述了将领域特定的化学知识和多模态信息融入LLMs的方法,还将化学LLMs概念化为使用化学工具的智能体,并探讨了它们加速科学研究的潜力。此外,我们总结了现有的用于评估LLMs化学能力的基准。最后,我们批判性地考察了当前的挑战,并为未来的研究确定了有希望的方向。通过这篇全面的综述,我们旨在帮助研究人员站在化学LLMs发展的前沿,并激发该领域的创新应用。

🔬 方法详解

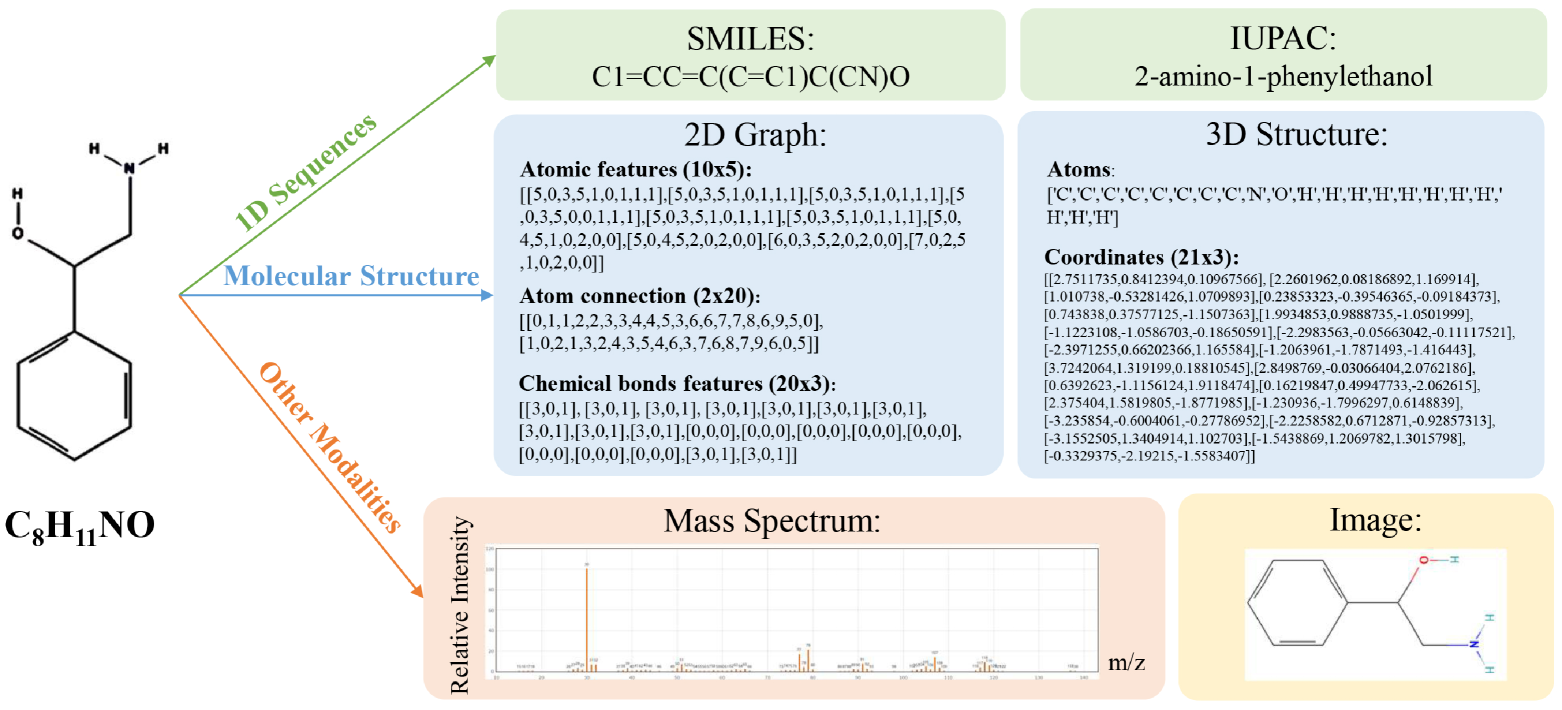

问题定义:现有的大语言模型主要在通用文本数据上进行预训练,缺乏化学领域的专业知识,难以处理化学领域的复杂任务。此外,化学数据通常是多模态的,例如2D图、3D结构和光谱数据,而通用LLM难以有效地利用这些信息。因此,如何将领域知识和多模态信息融入LLM,并使其具备解决化学问题的能力,是一个重要的挑战。

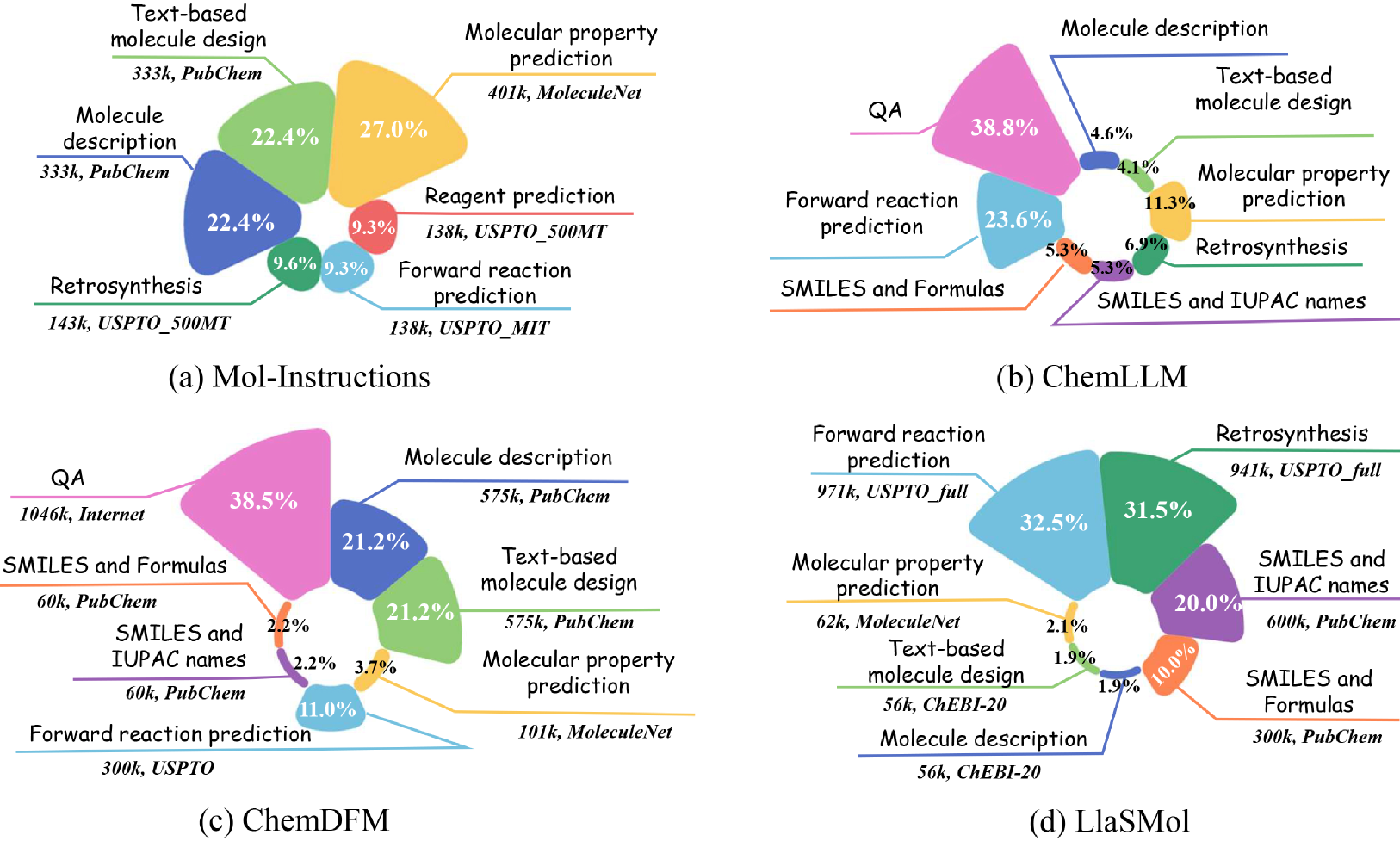

核心思路:本文的核心思路是对现有的化学领域大语言模型进行全面的综述,从数据、模型和应用三个方面分析其研究进展。通过总结现有方法,例如领域知识融合、多模态信息处理和化学工具使用,为研究人员提供一个系统的了解化学LLM的框架。同时,本文也指出了当前研究的挑战和未来发展方向。

技术框架:本文的综述框架主要包括以下几个方面:1) 化学领域知识的融入方法,例如使用化学领域的语料库进行预训练或微调,以及利用知识图谱等外部知识源;2) 多模态信息的处理方法,例如将2D图、3D结构和光谱数据编码为向量表示,并与文本信息进行融合;3) 化学工具的使用,例如使用分子动力学模拟软件或量子化学计算软件来辅助LLM进行预测和推理;4) 化学LLM的评估基准,例如用于评估LLM在化学性质预测、反应预测和逆合成等任务上的性能。

关键创新:本文的关键创新在于它是首个专门针对化学领域大语言模型的系统性综述。之前的综述主要关注预训练语言模型在化学领域的应用,而本文则更加关注如何构建和利用化学LLM。此外,本文还提出了将化学LLM概念化为使用化学工具的智能体的思想,这为未来的研究提供了一个新的视角。

关键设计:本文主要关注现有研究的方法论,因此没有涉及具体的参数设置、损失函数或网络结构等技术细节。但是,本文对各种方法的优缺点进行了分析,并为未来的研究提供了指导。

🖼️ 关键图片

📊 实验亮点

本文总结了现有的化学LLM评估基准,并分析了不同模型在化学性质预测、反应预测和逆合成等任务上的性能。通过对比不同方法的优缺点,为研究人员选择合适的模型和评估指标提供了参考。

🎯 应用场景

该研究成果可应用于药物发现、材料设计、化学合成等领域。通过构建更强大的化学LLM,可以加速新药研发、优化材料性能、提高化学合成效率,从而推动化学及相关领域的科学研究和产业发展。

📄 摘要(原文)

Large Language Models (LLMs) have significantly transformed our daily life and established a new paradigm in natural language processing (NLP). However, the predominant pretraining of LLMs on extensive web-based texts remains insufficient for advanced scientific discovery, particularly in chemistry. The scarcity of specialized chemistry data, coupled with the complexity of multi-modal data such as 2D graph, 3D structure and spectrum, present distinct challenges. Although several studies have reviewed Pretrained Language Models (PLMs) in chemistry, there is a conspicuous absence of a systematic survey specifically focused on chemistry-oriented LLMs. In this paper, we outline methodologies for incorporating domain-specific chemistry knowledge and multi-modal information into LLMs, we also conceptualize chemistry LLMs as agents using chemistry tools and investigate their potential to accelerate scientific research. Additionally, we conclude the existing benchmarks to evaluate chemistry ability of LLMs. Finally, we critically examine the current challenges and identify promising directions for future research. Through this comprehensive survey, we aim to assist researchers in staying at the forefront of developments in chemistry LLMs and to inspire innovative applications in the field.