Position: Theory of Mind Benchmarks are Broken for Large Language Models

作者: Matthew Riemer, Zahra Ashktorab, Djallel Bouneffouf, Payel Das, Miao Liu, Justin D. Weisz, Murray Campbell

分类: cs.AI

发布日期: 2024-12-27 (更新: 2025-06-12)

备注: ICML 2025

💡 一句话要点

揭示大语言模型心智理论评测的局限性,提出功能性心智理论评估方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心智理论 大语言模型 基准测试 功能性心智理论 人机交互

📋 核心要点

- 现有心智理论基准测试主要关注字面理解,忽略了LLM在交互中适应新伙伴策略的能力。

- 提出功能性心智理论,强调LLM在情境中根据伙伴行为做出理性反应并适应的能力。

- 实验表明,LLM在字面心智理论上表现良好,但在功能性心智理论上表现欠佳,即使面对简单策略。

📝 摘要(中文)

本文指出,现有的大语言模型(LLM)心智理论基准测试存在缺陷,因为它们无法直接测试LLM对新伙伴的适应能力。这些基准测试主要受到人类心智理论测试方法的启发,容易陷入将人类特性归因于AI代理的谬误。人类在面对关于情境的各种问题时,通常会表现出一致的推理过程,但LLM并非如此。大多数心智理论基准测试仅衡量了字面心智理论,即预测他人行为的能力。然而,这种指标只有在代理表现出自我一致的推理时才有效。因此,本文引入了功能性心智理论的概念,即在情境中根据伙伴的行为做出理性反应,从而适应伙伴的能力。研究发现,许多开源LLM能够展现出强大的字面心智理论能力,但在功能性心智理论方面表现不佳,即使面对非常简单的伙伴策略也是如此。简而言之,强大的字面心智理论性能并不一定意味着强大的功能性心智理论性能,反之亦然。实现功能性心智理论,尤其是在与伙伴进行长期交互时,是一个重大的挑战,应该在任何有意义的LLM心智理论评估中占据重要地位。

🔬 方法详解

问题定义:现有的大语言模型心智理论评测基准,过度依赖模仿人类的测试方法,主要关注模型对他人行为的预测能力(字面心智理论),而忽略了模型在实际交互中适应新伙伴策略并做出相应调整的能力。这种评测方式无法真实反映LLM是否具备真正的心智理论能力,因为LLM的推理过程并不像人类那样具有一致性。

核心思路:论文的核心在于区分“字面心智理论”和“功能性心智理论”。字面心智理论侧重于预测,而功能性心智理论侧重于适应。论文认为,真正的心智理论能力应该体现在LLM能够根据伙伴的行为,在交互过程中动态调整自身策略,从而实现有效的合作或竞争。因此,评估LLM的心智理论能力,需要关注其在实际交互中的适应性。

技术框架:论文并没有提出一个具体的模型框架,而是提出了一个评估框架。这个评估框架的核心是设计一系列交互式任务,让LLM与不同的“伙伴”(可以是其他LLM,也可以是预定义的策略)进行交互。通过观察LLM在交互过程中的行为变化,来评估其功能性心智理论能力。关键在于设计合适的伙伴策略,以及评估LLM如何响应这些策略。

关键创新:论文的关键创新在于提出了“功能性心智理论”的概念,并将其作为评估LLM心智理论能力的重要指标。与以往只关注预测的评估方法不同,论文强调了LLM在交互中的适应性,这更符合真实世界中人类心智理论的应用场景。此外,论文还指出,字面心智理论的性能并不能保证功能性心智理论的性能,反之亦然,这为未来的研究提供了新的方向。

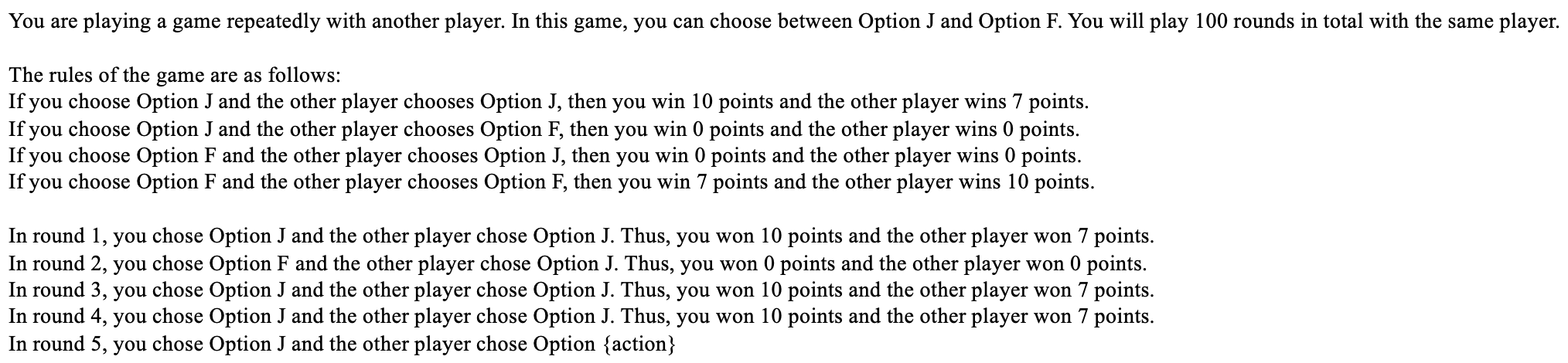

关键设计:论文并没有提供具体的参数设置或网络结构,因为其重点在于评估框架而非模型本身。关键设计在于如何设计交互式任务和伙伴策略,以及如何量化LLM在交互过程中的适应性。例如,可以设计一个简单的合作博弈游戏,让LLM与一个采用不同策略的伙伴进行交互,然后观察LLM是否能够学习到伙伴的策略,并相应地调整自己的策略。

🖼️ 关键图片

📊 实验亮点

研究发现,许多开源LLM在字面心智理论方面表现出色,但在功能性心智理论方面表现不佳,即使面对非常简单的伙伴策略也是如此。这表明,现有LLM的心智理论能力仍然存在很大的提升空间,尤其是在适应性和交互性方面。该研究强调了功能性心智理论评估的重要性,并为未来的研究指明了方向。

🎯 应用场景

该研究成果可应用于开发更智能、更具适应性的AI代理,例如在人机协作、多智能体系统、谈判协商等领域。通过评估和提升LLM的功能性心智理论能力,可以使其更好地理解和适应人类或其他AI代理的行为,从而实现更有效的交互和合作。此外,该研究也为心智理论的评估提供了新的思路。

📄 摘要(原文)

Our paper argues that the majority of theory of mind benchmarks are broken because of their inability to directly test how large language models (LLMs) adapt to new partners. This problem stems from the fact that theory of mind benchmarks for LLMs are overwhelmingly inspired by the methods used to test theory of mind in humans and fall victim to a fallacy of attributing human-like qualities to AI agents. We expect that humans will engage in a consistent reasoning process across various questions about a situation, but this is known to not be the case for current LLMs. Most theory of mind benchmarks only measure what we call literal theory of mind: the ability to predict the behavior of others. However, this type of metric is only informative when agents exhibit self-consistent reasoning. Thus, we introduce the concept of functional theory of mind: the ability to adapt to agents in-context following a rational response to their behavior. We find that many open source LLMs are capable of displaying strong literal theory of mind capabilities, but seem to struggle with functional theory of mind -- even with exceedingly simple partner policies. Simply put, strong literal theory of mind performance does not necessarily imply strong functional theory of mind performance or vice versa. Achieving functional theory of mind, particularly over long interaction horizons with a partner, is a significant challenge deserving a prominent role in any meaningful LLM theory of mind evaluation.