Biology-Instructions: A Dataset and Benchmark for Multi-Omics Sequence Understanding Capability of Large Language Models

作者: Haonan He, Yuchen Ren, Yining Tang, Ziyang Xu, Junxian Li, Minghao Yang, Di Zhang, Dong Yuan, Tao Chen, Shufei Zhang, Yuqiang Li, Nanqing Dong, Wanli Ouyang, Dongzhan Zhou, Peng Ye

分类: q-bio.BM, cs.AI, cs.LG

发布日期: 2024-12-26 (更新: 2025-09-23)

备注: EMNLP 2025 findings

🔗 代码/项目: GITHUB

💡 一句话要点

提出Biology-Instructions数据集与ChatMultiOmics模型,提升LLM在多组学序列理解能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 多组学 生物序列 指令调优 数据集 Transformer 生物信息学

📋 核心要点

- 现有LLM在通用领域表现出色,但在多组学生物序列理解方面存在不足,缺乏专门训练和数据集。

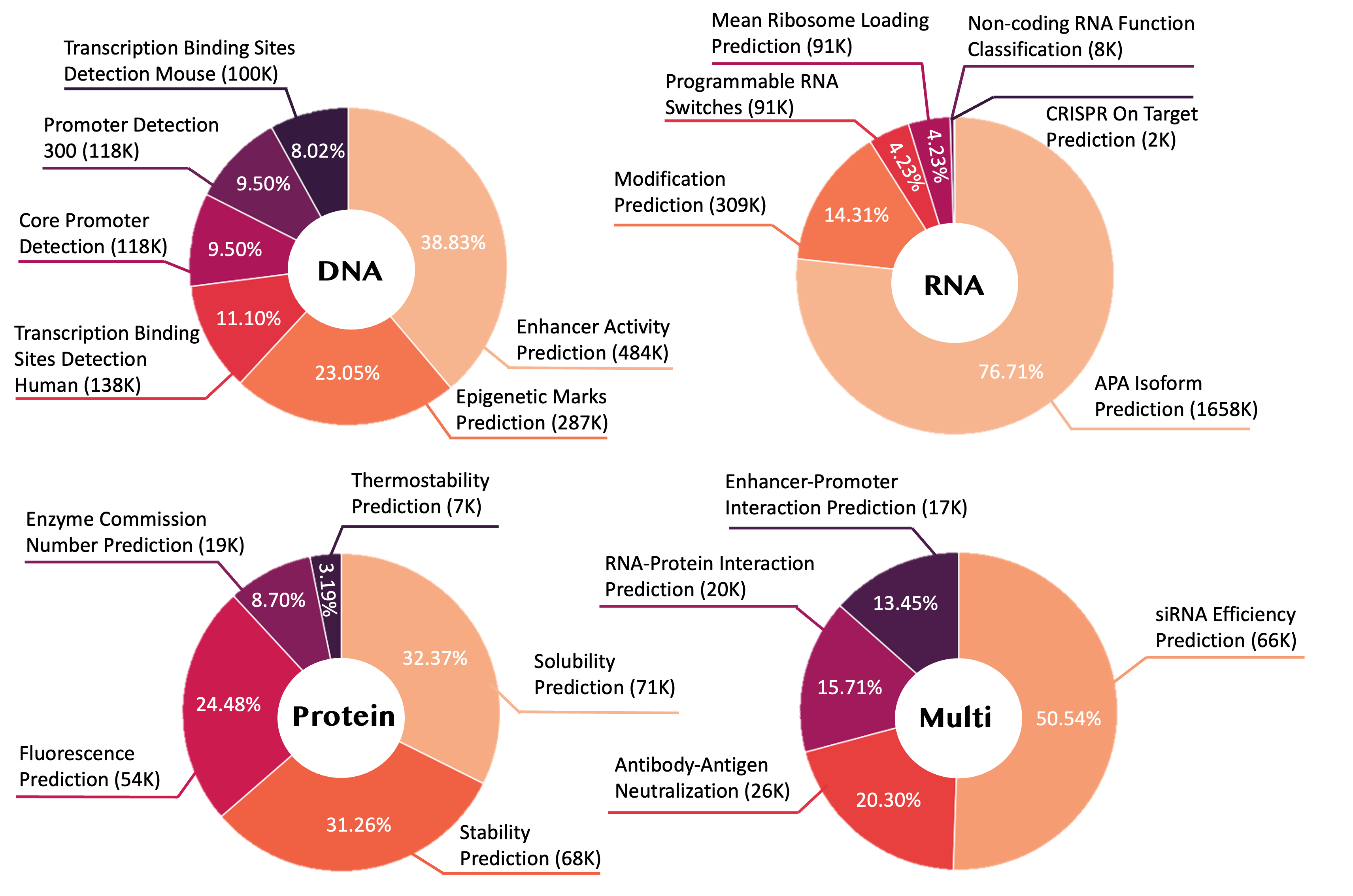

- 提出Biology-Instructions数据集,包含DNA、RNA、蛋白质等多组学数据,用于指令调优LLM,提升生物序列理解能力。

- 构建ChatMultiOmics模型,采用三阶段训练流程,在Biology-Instructions数据集上表现出更强的生物学理解能力。

📝 摘要(中文)

大型语言模型(LLMs)在通用领域表现出卓越的能力,但它们在多组学生物学中的应用仍未被充分探索。为了解决这一差距,我们推出了Biology-Instructions,这是第一个用于多组学生物序列的大规模指令调优数据集,包括DNA、RNA、蛋白质和多分子。该数据集连接了LLMs和复杂的生物序列相关任务,增强了它们的多功能性和推理能力,同时保持了对话流畅性。我们还强调了当前最先进的LLMs在没有专门训练的情况下,在多组学任务上的显著局限性。为了克服这一点,我们提出了ChatMultiOmics,这是一个具有新颖的三阶段训练流程的强大基线,通过Biology-Instructions展示了卓越的生物学理解能力。这两种资源都是公开可用的,为更好地将LLMs集成到多组学分析中铺平了道路。Biology-Instructions可在https://github.com/hhnqqq/Biology-Instructions公开获取。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)在通用领域表现出色,但在处理多组学(multi-omics)生物序列数据,如DNA、RNA和蛋白质时,面临着理解能力不足的问题。这些模型缺乏针对生物序列的专门训练,难以胜任复杂的生物学任务,例如序列功能预测、变异影响评估等。现有的方法要么是针对特定任务的小规模模型,要么是通用LLM的简单应用,无法充分利用LLM的潜力来解决多组学问题。

核心思路:本文的核心思路是构建一个大规模的、高质量的指令调优数据集(Biology-Instructions),并在此基础上训练一个专门针对多组学任务的LLM(ChatMultiOmics)。通过指令调优,使LLM能够更好地理解和执行与生物序列相关的任务,从而提升其在多组学领域的应用能力。这种方法旨在弥合通用LLM和特定生物学任务之间的差距,充分发挥LLM的通用性和推理能力。

技术框架:ChatMultiOmics的训练流程包含三个主要阶段:1) 预训练阶段:使用大规模的通用文本数据对LLM进行预训练,使其具备基本的语言理解和生成能力。2) 指令调优阶段:使用Biology-Instructions数据集对LLM进行指令调优,使其能够理解和执行与生物序列相关的任务。3) 多任务学习阶段:使用多个不同的生物学任务数据对LLM进行多任务学习,进一步提升其在多组学领域的泛化能力。

关键创新:该论文的关键创新点在于:1) Biology-Instructions数据集:这是第一个大规模的、专门针对多组学生物序列的指令调优数据集,包含了DNA、RNA、蛋白质等多种类型的生物序列数据,以及丰富的指令和任务描述。2) ChatMultiOmics模型:这是一个专门针对多组学任务设计的LLM,通过三阶段训练流程,实现了在生物序列理解方面的显著提升。与现有方法相比,ChatMultiOmics能够更好地理解和执行与生物序列相关的任务,具有更强的泛化能力。

关键设计:Biology-Instructions数据集包含了多种类型的生物序列数据,例如DNA序列、RNA序列、蛋白质序列等。每个数据样本都包含一个指令(instruction)和一个对应的输出(output)。指令描述了需要执行的任务,例如“预测该DNA序列的功能”、“评估该蛋白质序列的变异影响”等。输出是根据指令生成的答案或结果。ChatMultiOmics模型采用Transformer架构,并针对生物序列的特点进行了一些改进。例如,在输入层,使用了专门的生物序列嵌入方法,将生物序列转换为向量表示。在训练过程中,使用了多种损失函数,例如交叉熵损失、序列生成损失等,以优化模型的性能。

🖼️ 关键图片

📊 实验亮点

论文提出的ChatMultiOmics模型在Biology-Instructions数据集上取得了显著的性能提升。具体来说,ChatMultiOmics在多个生物学任务上的准确率和F1值均超过了现有的基线模型,例如通用LLM和针对特定任务的小规模模型。实验结果表明,通过指令调优和多任务学习,LLM能够更好地理解和执行与生物序列相关的任务,具有更强的泛化能力。

🎯 应用场景

该研究成果可广泛应用于基因组学、蛋白质组学、药物发现等领域。例如,可用于预测基因的功能、评估蛋白质变异的影响、设计新的药物靶点等。通过将LLM应用于多组学数据分析,可以加速生物学研究的进程,为疾病诊断和治疗提供新的思路和方法。未来,该研究有望推动精准医疗的发展,实现个性化的疾病治疗方案。

📄 摘要(原文)

Large language models (LLMs) have shown remarkable capabilities in general domains, but their application to multi-omics biology remains underexplored. To address this gap, we introduce Biology-Instructions, the first large-scale instruction-tuning dataset for multi-omics biological sequences, including DNA, RNA, proteins, and multi-molecules. This dataset bridges LLMs and complex biological sequence-related tasks, enhancing their versatility and reasoning while maintaining conversational fluency. We also highlight significant limitations of current state-of-the-art LLMs on multi-omics tasks without specialized training. To overcome this, we propose ChatMultiOmics, a strong baseline with a novel three-stage training pipeline, demonstrating superior biological understanding through Biology-Instructions. Both resources are publicly available, paving the way for better integration of LLMs in multi-omics analysis. The Biology-Instructions is publicly available at: https://github.com/hhnqqq/Biology-Instructions.