LongDocURL: a Comprehensive Multimodal Long Document Benchmark Integrating Understanding, Reasoning, and Locating

作者: Chao Deng, Jiale Yuan, Pi Bu, Peijie Wang, Zhong-Zhi Li, Jian Xu, Xiao-Hui Li, Yuan Gao, Jun Song, Bo Zheng, Cheng-Lin Liu

分类: cs.AI, cs.CL

发布日期: 2024-12-24 (更新: 2025-07-15)

💡 一句话要点

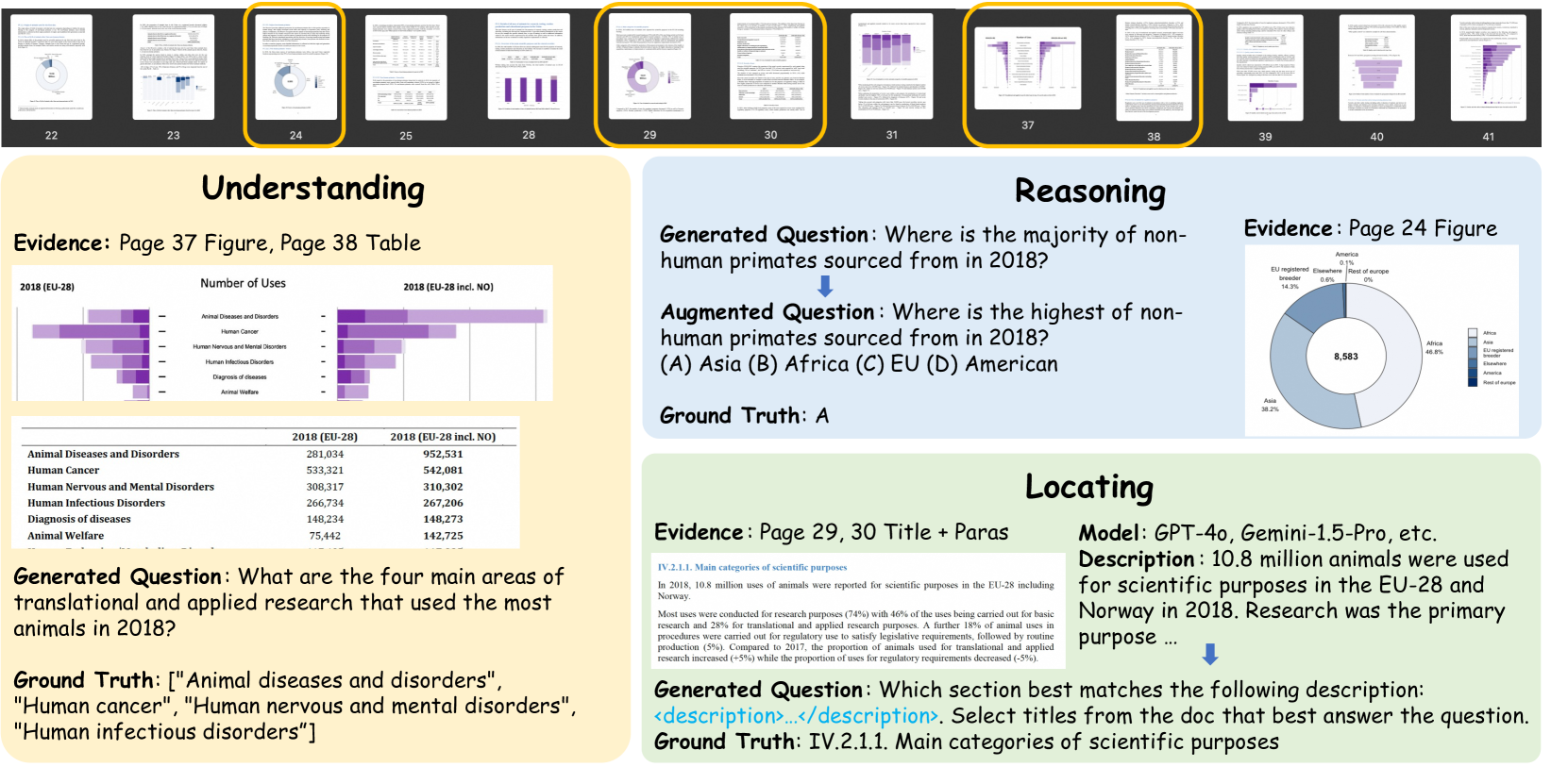

提出LongDocURL,一个综合性的多模态长文档基准,用于评估理解、推理和定位能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文档理解 多模态学习 视觉语言模型 文档推理 布局分析 基准测试 问答系统

📋 核心要点

- 现有文档理解基准在处理长文档和布局元素定位方面存在局限性,无法全面评估模型能力。

- LongDocURL基准通过集成长文档理解、数值推理和跨元素定位三个任务来解决上述问题。

- 实验结果揭示了现有模型在LongDocURL上的性能差距,为未来研究提供了方向。

📝 摘要(中文)

大型视觉语言模型(LVLMs)显著提升了文档理解能力,能够处理复杂的文档元素、更长的上下文和更广泛的任务。然而,现有的文档理解基准测试仅限于处理少量页面,并且未能提供对布局元素定位的全面分析。本文首先定义了三个主要任务类别:长文档理解、数值推理和跨元素定位,然后提出了一个综合基准LongDocURL,集成了上述三个主要任务,包含20个子任务,这些子任务根据不同的主要任务和答案证据进行分类。此外,我们开发了一个半自动构建流程,并收集了2325个高质量的问答对,涵盖超过33000页的文档,显著优于现有的基准。随后,我们对26种不同配置的开源和闭源模型进行了全面的评估实验,揭示了该领域存在的关键性能差距。

🔬 方法详解

问题定义:现有文档理解基准主要存在两个痛点:一是处理的文档页数较少,无法有效评估模型在长文档上下文下的理解能力;二是缺乏对文档布局元素定位的全面分析,限制了模型对文档结构化信息的利用。因此,需要一个更全面、更具挑战性的基准来推动长文档理解领域的发展。

核心思路:LongDocURL的核心思路是构建一个包含长文档理解、数值推理和跨元素定位三个主要任务的综合性基准。通过设计不同的子任务,并结合高质量的问答对,全面评估模型在处理复杂文档时的理解、推理和定位能力。这种多任务的设置能够更真实地反映实际应用场景的需求。

技术框架:LongDocURL的构建主要包含以下几个阶段:1) 任务定义:明确长文档理解、数值推理和跨元素定位三个主要任务,并设计相应的子任务。2) 数据收集:采用半自动化的构建流程,收集包含大量页面的文档,并生成高质量的问答对。3) 模型评估:选择具有代表性的开源和闭源模型,在LongDocURL上进行评估,并分析实验结果。

关键创新:LongDocURL的关键创新在于其综合性和全面性。它不仅考虑了长文档的上下文信息,还关注了文档的布局元素和数值信息,从而更全面地评估模型的文档理解能力。此外,半自动化的数据构建流程保证了数据的质量和规模。

关键设计:LongDocURL包含20个子任务,这些子任务根据不同的主要任务和答案证据进行分类。数据集包含2325个高质量的问答对,涵盖超过33000页的文档。在模型评估方面,论文选择了26种不同配置的开源和闭源模型,并进行了全面的实验分析。

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有模型在LongDocURL基准上存在显著的性能差距,尤其是在数值推理和跨元素定位任务上。例如,某些模型在长文档理解任务上表现良好,但在数值推理任务上表现较差。这些结果揭示了现有模型在处理复杂文档时的局限性,为未来的研究提供了重要的参考。

🎯 应用场景

LongDocURL基准的提出,将推动长文档理解技术在金融报告分析、法律文档处理、科学文献挖掘等领域的应用。该基准能够帮助研究人员开发更强大的文档理解模型,从而提高工作效率和决策质量,具有重要的实际价值和深远的影响。

📄 摘要(原文)

Large vision language models (LVLMs) have improved the document understanding capabilities remarkably, enabling the handling of complex document elements, longer contexts, and a wider range of tasks. However, existing document understanding benchmarks have been limited to handling only a small number of pages and fail to provide a comprehensive analysis of layout elements locating. In this paper, we first define three primary task categories: Long Document Understanding, numerical Reasoning, and cross-element Locating, and then propose a comprehensive benchmark, LongDocURL, integrating above three primary tasks and comprising 20 sub-tasks categorized based on different primary tasks and answer evidences. Furthermore, we develop a semi-automated construction pipeline and collect 2,325 high-quality question-answering pairs, covering more than 33,000 pages of documents, significantly outperforming existing benchmarks. Subsequently, we conduct comprehensive evaluation experiments on both open-source and closed-source models across 26 different configurations, revealing critical performance gaps in this field.