VISION: A Modular AI Assistant for Natural Human-Instrument Interaction at Scientific User Facilities

作者: Shray Mathur, Noah van der Vleuten, Kevin Yager, Esther Tsai

分类: cs.AI

发布日期: 2024-12-24

💡 一句话要点

提出VISION:一个模块化AI助手,用于科学用户设施中的自然人机交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机交互 大型语言模型 科学用户设施 语音控制 自动化实验 模块化架构 X射线散射

📋 核心要点

- 现有科学用户设施的人机交互复杂,依赖专业开发人员,阻碍了科研人员直接高效地使用仪器。

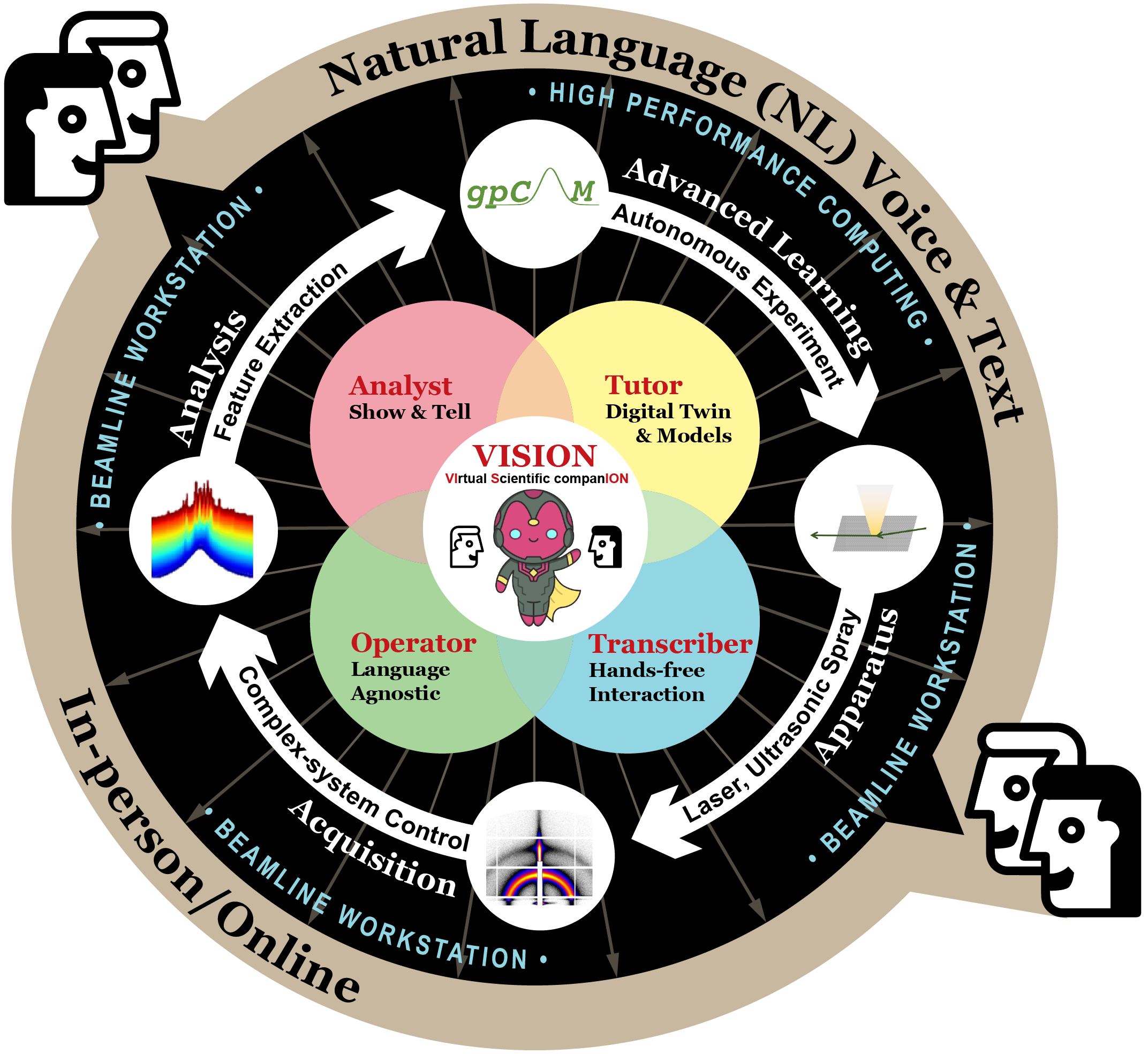

- VISION通过模块化架构,将大型语言模型(LLM)集成到各个认知模块中,实现自然语言控制和自动化实验流程。

- 实验证明VISION能够以低延迟在光束线工作站上执行LLM操作,并首次实现了X射线散射光束线的语音控制实验。

📝 摘要(中文)

科学用户设施,如同步辐射光束线,配备了大量的硬件和软件工具,需要代码库来实现人机交互。这通常需要开发人员参与,以建立用户/研究人员与复杂仪器之间的连接。生成式AI的出现提供了一个弥合这种知识差距的机会,从而实现无缝通信和高效的实验工作流程。本文提出了虚拟科学助手(VISION)的模块化架构,通过组装多个支持AI的认知模块,每个模块都为大型语言模型(LLM)提供专门任务的支架。借助VISION,我们在光束线工作站上进行了基于LLM的操作,延迟较低,并展示了首次在X射线散射光束线上进行的语音控制实验。模块化和可扩展的架构允许轻松适应新的仪器和功能。基于自然语言的科学实验的开发是即将到来的未来的一个组成部分,在这个未来,科学外脑——科学家认知的合成延伸——可能会彻底改变科学实践和发现。

🔬 方法详解

问题定义:科学用户设施的仪器操作复杂,需要专业的软件和编程知识,这使得研究人员难以直接有效地使用这些设备。现有的方法依赖于开发人员来建立用户和仪器之间的连接,这既耗时又增加了实验的复杂性。因此,需要一种更自然、更直观的人机交互方式,以简化实验流程并提高科研效率。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大自然语言处理能力,构建一个模块化的AI助手,即VISION。VISION通过将LLM集成到不同的认知模块中,实现对仪器的自然语言控制、实验流程的自动化以及数据的智能分析。这种方法旨在弥合研究人员与复杂仪器之间的知识鸿沟,使他们能够更轻松地进行科学实验。

技术框架:VISION的整体架构是一个模块化的系统,包含多个AI使能的认知模块。每个模块都负责一个特定的任务,例如语音识别、自然语言理解、仪器控制和数据分析。这些模块通过API进行通信,并以LLM作为核心驱动力。用户可以通过语音或文本与VISION进行交互,VISION将用户的指令转换为仪器可以理解的命令,并执行相应的操作。实验数据会被自动收集和分析,并将结果以易于理解的方式呈现给用户。

关键创新:VISION的关键创新在于其模块化的架构和对LLM的有效利用。模块化架构使得系统易于扩展和定制,可以轻松地适应不同的仪器和实验需求。通过将LLM集成到各个认知模块中,VISION实现了自然语言控制和自动化实验流程,大大简化了人机交互的复杂性。此外,VISION还首次展示了在X射线散射光束线上进行语音控制实验的可能性。

关键设计:VISION的关键设计包括:1) 针对特定仪器和实验任务定制的LLM提示工程,以提高LLM的准确性和效率;2) 低延迟的通信协议,以确保实时响应;3) 模块化的软件架构,以支持灵活的扩展和定制;4) 用户友好的界面,以简化人机交互。

🖼️ 关键图片

📊 实验亮点

VISION成功地在X射线散射光束线上实现了首次语音控制实验,证明了其在实际科研环境中的可行性。实验结果表明,VISION能够以低延迟响应用户的语音指令,并自动执行相应的实验操作。此外,VISION的模块化架构使其易于适应新的仪器和实验需求,具有很强的可扩展性。

🎯 应用场景

VISION具有广泛的应用前景,可应用于各种科学用户设施,如同步辐射光束线、中子散射设施和电子显微镜实验室。它可以简化实验流程,提高科研效率,并促进新的科学发现。此外,VISION还可以用于教育和培训,帮助学生和新研究人员更快地掌握复杂仪器的使用方法。未来,VISION有望成为科学家们进行科学研究的强大助手。

📄 摘要(原文)

Scientific user facilities, such as synchrotron beamlines, are equipped with a wide array of hardware and software tools that require a codebase for human-computer-interaction. This often necessitates developers to be involved to establish connection between users/researchers and the complex instrumentation. The advent of generative AI presents an opportunity to bridge this knowledge gap, enabling seamless communication and efficient experimental workflows. Here we present a modular architecture for the Virtual Scientific Companion (VISION) by assembling multiple AI-enabled cognitive blocks that each scaffolds large language models (LLMs) for a specialized task. With VISION, we performed LLM-based operation on the beamline workstation with low latency and demonstrated the first voice-controlled experiment at an X-ray scattering beamline. The modular and scalable architecture allows for easy adaptation to new instrument and capabilities. Development on natural language-based scientific experimentation is a building block for an impending future where a science exocortex -- a synthetic extension to the cognition of scientists -- may radically transform scientific practice and discovery.