Enhancing Conflict Resolution in Language Models via Abstract Argumentation

作者: Zhaoqun Li, Xiaotong Fang, Chen Chen, Mengze Li, Beishui Liao

分类: cs.AI

发布日期: 2024-12-21 (更新: 2025-11-13)

💡 一句话要点

利用抽象论证增强语言模型在冲突解决中的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 抽象论证 冲突解决 过程解释 符号计算 对话系统 模型微调

📋 核心要点

- 大型语言模型在冲突解决方面存在不足,尤其是在处理不完整或不一致信息时。

- 论文提出将形式化抽象论证与语言模型学习相结合,增强LLMs的冲突解决能力。

- 实验表明,使用过程解释进行训练的模型具有更好的泛化能力,并能提供更透明的决策过程。

📝 摘要(中文)

近年来,大型语言模型(LLMs)在开发类人且引人入胜的对话系统方面取得了显著进展。然而,在共识建立和说服等任务中,LLMs常常难以解决由不完整或不一致信息引起的冲突,这暴露了它们在实际应用中的局限性。鉴于这些局限性,抽象论证作为一种专门用于解决冲突和不一致的逻辑框架,变得尤为重要。本文旨在通过利用形式化抽象论证,将语言模型学习与符号计算相结合,来增强LLMs的冲突解决能力。为此,我们开发并整理了一个包含多样化抽象论证框架的数据集,并附有论证可接受性计算过程的详细解释。随后,我们在此数据集上对LLMs进行微调,重点关注抽象冲突解决任务。作为比较基线,我们还使用思维链方法评估了LLMs,但它们未能有效地解决基于冲突的论证。实验表明,过程解释在学习中起着至关重要的作用。与仅在问答对上训练的模型相比,使用解释训练的模型表现出更高的泛化准确性。此外,利用LLMs的自我解释能力,我们的方法提供了详细的说明,从而减轻了通常与神经网络相关的缺乏透明度的问题。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在共识建立、说服等任务中,由于不完整或不一致信息导致的冲突解决能力不足的问题。现有方法,如思维链(Chain-of-Thought),在解决基于冲突的论证时效果不佳,缺乏有效处理冲突和不一致性的机制。

核心思路:论文的核心思路是将形式化的抽象论证框架融入到LLMs的学习过程中。抽象论证是一种符号计算方法,擅长处理冲突和不一致性。通过将LLMs与抽象论证相结合,可以提升LLMs在冲突解决方面的能力。这种设计旨在弥补LLMs在逻辑推理和符号计算方面的不足。

技术框架:整体框架包括以下几个主要步骤:1) 构建包含多样化抽象论证框架的数据集,并提供论证可接受性计算过程的详细解释。2) 在该数据集上对LLMs进行微调,重点关注抽象冲突解决任务。3) 使用思维链方法作为基线进行比较。4) 分析过程解释在模型学习中的作用。框架的核心在于将LLMs的学习与抽象论证的符号计算相结合。

关键创新:论文的关键创新在于将抽象论证这一形式化方法引入到LLMs的训练中,从而增强了LLMs的冲突解决能力。与传统的端到端训练方法不同,该方法利用符号计算来指导LLMs的学习,使其能够更好地理解和处理冲突信息。此外,论文还强调了过程解释的重要性,并利用LLMs的自我解释能力来提高模型透明度。

关键设计:论文的关键设计包括:1) 数据集的构建,该数据集包含了多样化的抽象论证框架,并提供了详细的解释。2) 微调策略,针对抽象冲突解决任务对LLMs进行微调。3) 过程解释的引入,通过提供解释来指导模型的学习,并提高模型透明度。具体的参数设置、损失函数和网络结构等技术细节在论文中可能没有详细描述,属于未知信息。

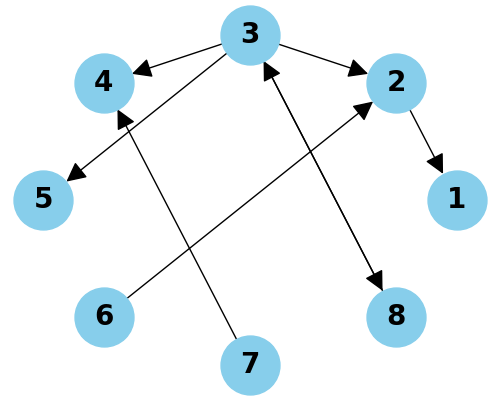

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用过程解释进行训练的LLMs在泛化准确性方面优于仅使用问答对训练的模型。这表明过程解释在模型学习中起着至关重要的作用。此外,该方法还能够利用LLMs的自我解释能力,提供详细的说明,从而减轻了神经网络通常存在的缺乏透明度的问题。具体的性能提升数据在摘要中未明确给出,属于未知信息。

🎯 应用场景

该研究成果可应用于构建更智能、更可靠的对话系统,尤其是在需要处理复杂冲突和不一致信息的场景中,例如:智能客服、法律咨询、政策辩论等。通过提升LLMs的冲突解决能力,可以提高对话系统的实用性和可信度,并为未来的AI应用开辟新的可能性。

📄 摘要(原文)

In recent years, large language models (LLMs) have made significant advancements in developing human-like and engaging dialogue systems. However, in tasks such as consensus-building and persuasion, LLMs often struggle to resolve conflicts arising from incomplete or inconsistent information, revealing their limitations in real-world applications. Given these limitations, abstract argumentation, a specialized logical framework designed to resolve conflicts and inconsistencies, becomes particularly relevant. In this paper, we aim to enhance the conflict-solving capabilities of LLMs by leveraging formal abstract argumentation, integrating language model learning with symbolic computation. To achieve this, we develop and curate a dataset comprising diverse abstract argumentation frameworks, accompanied by detailed explanations of the argument acceptability computation process. Subsequently, we fine-tune LLMs on this dataset, focusing on abstract conflict resolution tasks. As a comparative baseline, LLMs are also evaluated using a chain-of-thought approach, however, they fail to solve the conflict-based arguments effectively. Our experiments demonstrate that process explanations play a crucial role in learning. Models trained with explanations exhibit superior generalization accuracy compared to those trained solely on question-answer pairs. Furthermore, leveraging LLMs' self-explanation capabilities, our approach provides detailed illustrations that mitigate the lack of transparency typically associated with neural networks.