Multi-modal Agent Tuning: Building a VLM-Driven Agent for Efficient Tool Usage

作者: Zhi Gao, Bofei Zhang, Pengxiang Li, Xiaojian Ma, Tao Yuan, Yue Fan, Yuwei Wu, Yunde Jia, Song-Chun Zhu, Qing Li

分类: cs.AI, cs.CV

发布日期: 2024-12-20 (更新: 2025-02-03)

备注: ICLR 2025, https://mat-agent.github.io/

💡 一句话要点

提出多模态Agent调优方法,构建VLM驱动的工具高效使用Agent

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态Agent 工具使用 视觉-语言模型 数据合成 Agent调优

📋 核心要点

- 现有大型语言模型驱动的多模态Agent在工具使用方面仍面临挑战,缺乏高质量的训练数据是主要瓶颈。

- 论文提出一种自动化的多模态数据生成和Agent调优方法,通过GPT-4o mini模型生成数据,并设计验证器保证数据质量。

- 实验结果表明,使用该方法训练的T3-Agent在工具使用任务上显著优于未经训练的VLM,性能提升达20%。

📝 摘要(中文)

本文提出了一种多模态Agent调优方法,该方法自动生成多模态工具使用数据,并调优视觉-语言模型(VLM),使其作为控制器,实现强大的工具使用推理能力。为了保证数据质量,我们提示GPT-4o mini模型生成查询、文件和轨迹,然后使用查询-文件和轨迹验证器进行验证。基于该数据合成流程,我们收集了包含2万个工具使用轨迹任务的MM-Traj数据集。然后,我们通过在MM-Traj上对VLM进行轨迹调优,开发了用于工具使用的T3-Agent。在GTA和GAIA基准测试上的评估表明,T3-Agent在MiniCPM-V-8.5B和Qwen2-VL-7B两个流行的VLM上均取得了持续的改进,性能比未经训练的VLM提高了20%,表明了所提出的数据合成流程的有效性,从而产生了高质量的工具使用能力数据。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)驱动的多模态Agent在工具使用方面表现出潜力,但缺乏高质量的训练数据来提升其工具使用推理能力。现有的方法通常依赖人工标注或有限的数据集,难以覆盖各种工具和使用场景,限制了Agent的泛化能力和性能。

核心思路:本文的核心思路是自动生成高质量的多模态工具使用数据,并利用这些数据对视觉-语言模型(VLM)进行调优,使其能够更好地理解和执行工具使用任务。通过模仿人类使用工具的轨迹,VLM可以学习到更有效的工具使用策略。

技术框架:该方法包含一个数据合成流程和一个Agent调优流程。数据合成流程首先使用GPT-4o mini模型生成查询、文件和轨迹,然后使用查询-文件和轨迹验证器来过滤低质量的数据。Agent调优流程使用合成的数据集(MM-Traj)对VLM进行微调,得到T3-Agent。整体框架包括数据生成、数据验证和Agent训练三个主要阶段。

关键创新:该方法最重要的创新点在于提出了一种自动化的多模态数据生成流程,能够高效地生成大规模、高质量的工具使用数据。与传统的人工标注方法相比,该方法大大降低了数据获取的成本,并能够覆盖更广泛的工具和使用场景。此外,使用验证器保证数据质量也是一个关键创新。

关键设计:在数据生成阶段,使用GPT-4o mini模型生成多样化的查询、文件和轨迹。在数据验证阶段,设计了查询-文件验证器和轨迹验证器,用于过滤不合理的数据。在Agent训练阶段,使用MM-Traj数据集对VLM进行微调,采用交叉熵损失函数进行优化。具体的参数设置和网络结构细节在论文中进行了详细描述(未知)。

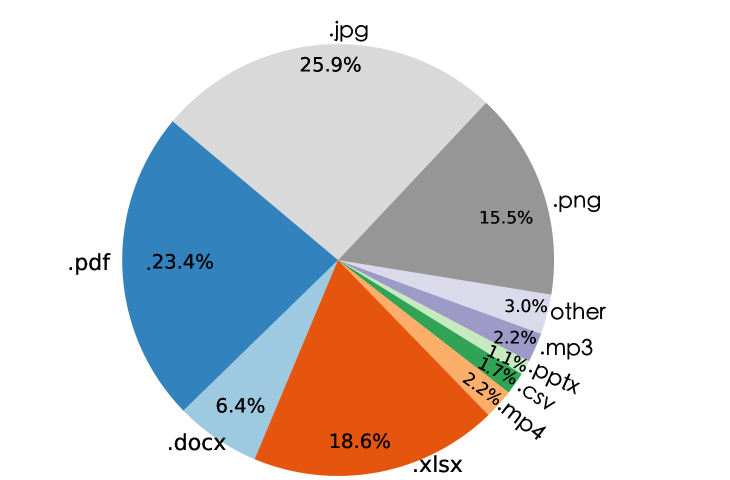

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用该方法训练的T3-Agent在GTA和GAIA基准测试上均取得了显著的性能提升。具体来说,T3-Agent在MiniCPM-V-8.5B和Qwen2-VL-7B两个流行的VLM上,性能比未经训练的VLM提高了20%,证明了该方法的有效性。MM-Traj数据集的构建和T3-Agent的提出是重要的实验亮点。

🎯 应用场景

该研究成果可应用于智能助手、自动化机器人、智能家居等领域。通过提升Agent的工具使用能力,可以实现更智能、更高效的任务自动化,例如自动生成报告、自动处理图像、自动控制设备等。未来,该技术有望推动人机协作的进一步发展,使机器能够更好地理解人类意图并完成复杂任务。

📄 摘要(原文)

The advancement of large language models (LLMs) prompts the development of multi-modal agents, which are used as a controller to call external tools, providing a feasible way to solve practical tasks. In this paper, we propose a multi-modal agent tuning method that automatically generates multi-modal tool-usage data and tunes a vision-language model (VLM) as the controller for powerful tool-usage reasoning. To preserve the data quality, we prompt the GPT-4o mini model to generate queries, files, and trajectories, followed by query-file and trajectory verifiers. Based on the data synthesis pipeline, we collect the MM-Traj dataset that contains 20K tasks with trajectories of tool usage. Then, we develop the T3-Agent via \underline{T}rajectory \underline{T}uning on VLMs for \underline{T}ool usage using MM-Traj. Evaluations on the GTA and GAIA benchmarks show that the T3-Agent consistently achieves improvements on two popular VLMs: MiniCPM-V-8.5B and {Qwen2-VL-7B}, which outperforms untrained VLMs by $20\%$, showing the effectiveness of the proposed data synthesis pipeline, leading to high-quality data for tool-usage capabilities.