The impact of behavioral diversity in multi-agent reinforcement learning

作者: Matteo Bettini, Ryan Kortvelesy, Amanda Prorok

分类: cs.AI, cs.LG, cs.MA

发布日期: 2024-12-19 (更新: 2025-01-29)

💡 一句话要点

研究行为多样性对多智能体强化学习的影响,提升团队协作能力

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 多智能体强化学习 行为多样性 团队协作 异质性 奖励函数

📋 核心要点

- 现有方法在多智能体强化学习中倾向于同质策略,忽略了行为多样性对集体表现的潜在提升。

- 本文通过多样性测量和控制,研究行为异质性对多智能体强化学习的影响,探索其在团队协作中的作用。

- 实验表明,行为多样性能够改善团队表现,提升在稀疏奖励环境中的合作能力,并增强对环境变化的适应性。

📝 摘要(中文)

本文研究了行为异质性在多智能体强化学习中的影响。现有机器学习范式通常偏好同质智能体策略,但本文通过多样性测量和控制范式,在团队协作等任务中,展示了无偏行为角色的涌现如何改善团队表现;行为多样性如何与形态多样性协同作用;多样化智能体如何在稀疏奖励环境中更有效地找到合作解决方案;以及行为异质团队如何学习和保持潜在技能以克服重复中断。结果表明,通过控制多样性,可以获得优于同质训练范式的非凡优势,证明了多样性是集体人工智能学习的基本组成部分。

🔬 方法详解

问题定义:多智能体强化学习中,现有方法通常侧重于训练同质化的智能体,忽略了行为多样性可能带来的益处。这种同质化策略在解决复杂协作问题时可能存在局限性,例如难以适应动态环境、难以发现创新性的解决方案等。因此,本文旨在研究行为多样性对多智能体系统性能的影响,并探索如何有效地利用多样性来提升团队协作能力。

核心思路:本文的核心思路是通过引入和控制智能体的行为多样性,来提升多智能体系统的整体性能。作者认为,行为多样性可以促进智能体之间的互补和协作,从而更好地解决复杂问题。通过鼓励智能体探索不同的行为策略,并学习适应彼此的行为,可以使整个系统更加鲁棒和高效。

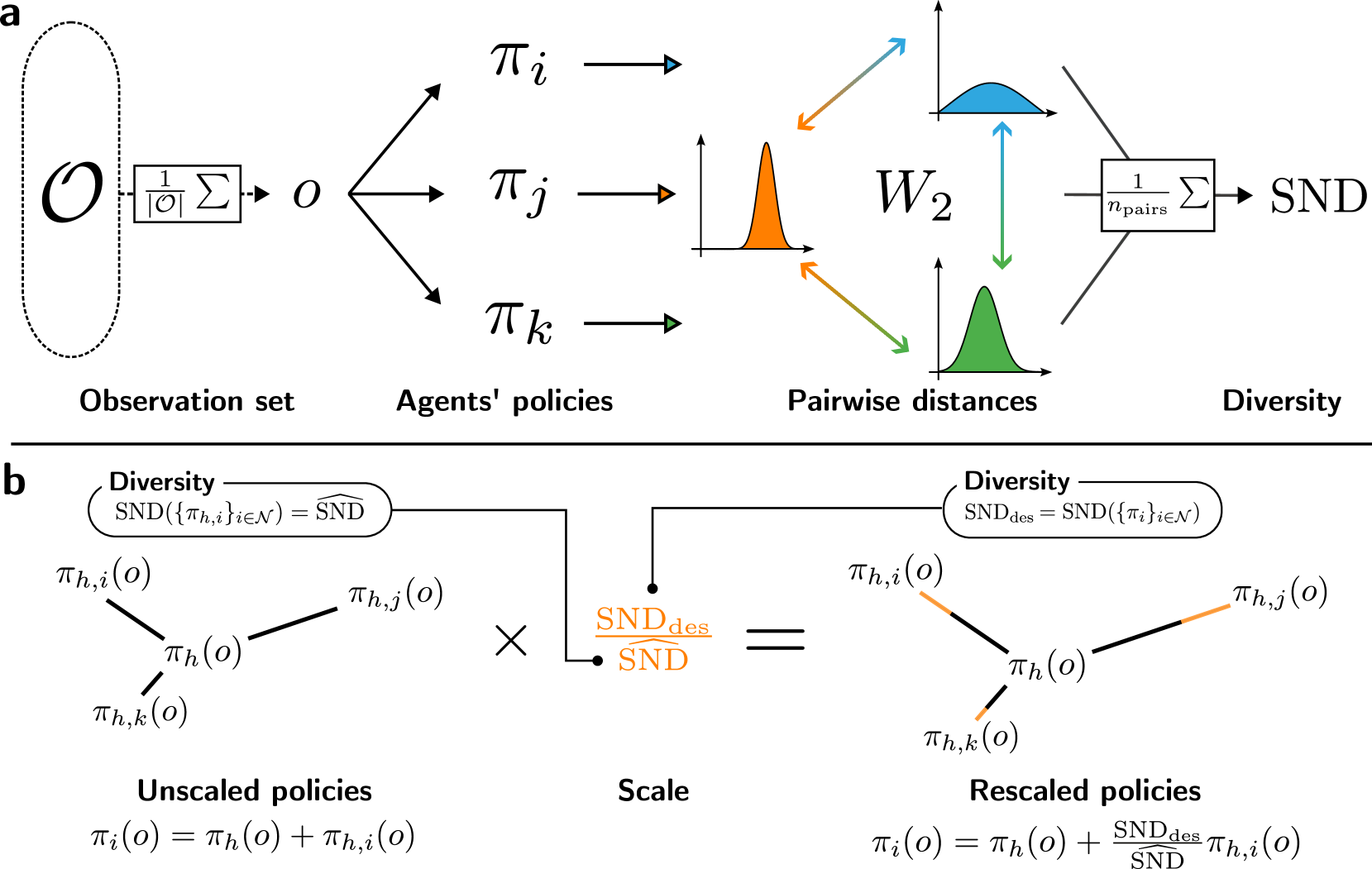

技术框架:本文采用多智能体强化学习框架,并在该框架下引入了多样性测量和控制机制。整体流程包括以下几个步骤:1)定义多智能体协作任务;2)设计奖励函数,鼓励智能体进行协作;3)引入多样性度量指标,例如行为熵、策略差异等;4)设计多样性控制机制,例如通过调整奖励函数或策略梯度来鼓励或抑制多样性;5)训练多智能体系统,并评估其性能。

关键创新:本文最重要的技术创新点在于将多样性控制引入到多智能体强化学习中。与以往侧重于同质化训练的方法不同,本文通过主动控制智能体的行为多样性,来探索其对系统性能的影响。这种方法可以帮助我们更好地理解多样性在多智能体系统中的作用,并为设计更有效的协作策略提供指导。

关键设计:在实验中,作者采用了多种多样性度量指标,例如行为熵、策略差异等。同时,作者还设计了多种多样性控制机制,例如通过调整奖励函数来鼓励或抑制多样性。具体的参数设置和网络结构取决于具体的任务和环境,但总体思路是鼓励智能体探索不同的行为策略,并学习适应彼此的行为。

🖼️ 关键图片

📊 实验亮点

实验结果表明,行为多样性能够显著提升多智能体系统的性能。例如,在团队协作任务中,行为多样性能够使团队更快地找到合作解决方案,并取得更高的奖励。在稀疏奖励环境中,行为多样性能够帮助智能体探索更多的可能性,从而更容易找到有效的策略。此外,行为多样性还能够增强系统对环境变化的适应性,使其在面对干扰时更加鲁棒。

🎯 应用场景

该研究成果可应用于各种需要多智能体协作的场景,例如机器人团队协作、交通流量优化、资源分配、以及分布式能源管理等。通过引入行为多样性,可以提升系统的鲁棒性、适应性和效率,从而更好地解决现实世界中的复杂问题。此外,该研究还可以为设计更有效的多智能体学习算法提供指导。

📄 摘要(原文)

Many of the world's most pressing issues, such as climate change and global peace, require complex collective problem-solving skills. Recent studies indicate that diversity in individuals' behaviors is key to developing such skills and increasing collective performance. Yet behavioral diversity in collective artificial learning is understudied, with today's machine learning paradigms commonly favoring homogeneous agent strategies over heterogeneous ones, mainly due to computational considerations. In this work, we employ diversity measurement and control paradigms to study the impact of behavioral heterogeneity in several facets of multi-agent reinforcement learning. Through experiments in team play and other cooperative tasks, we show the emergence of unbiased behavioral roles that improve team outcomes; how behavioral diversity synergizes with morphological diversity; how diverse agents are more effective at finding cooperative solutions in sparse reward settings; and how behaviorally heterogeneous teams learn and retain latent skills to overcome repeated disruptions. Overall, our results indicate that, by controlling diversity, we can obtain non-trivial benefits over homogeneous training paradigms, demonstrating that diversity is a fundamental component of collective artificial learning, an insight thus far overlooked.