Cognition Chain for Explainable Psychological Stress Detection on Social Media

作者: Xin Wang, Boyan Gao, Yi Dai, Lei Cao, Liang Zhao, Yibo Yang, David Clifton

分类: cs.AI, cs.CL, cs.HC

发布日期: 2024-12-18

💡 一句话要点

提出认知链(Cognition Chain)方法,用于社交媒体上可解释的心理压力检测。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 心理压力检测 可解释AI 大型语言模型 认知评估理论 指令调优

📋 核心要点

- 现有压力检测模型是黑盒模型,缺乏可解释性,难以在临床应用中获得信任。

- 论文提出认知链方法,模拟人类认知过程,指导LLM进行压力推理,提高可解释性。

- 通过CogInstruct数据集指令调优Llama3,得到CogLLM模型,在压力检测任务上表现出色。

📝 摘要(中文)

压力是一个普遍的全球健康问题,可能导致严重的精神健康问题。早期检测可以及时干预和预防与压力相关的疾病。目前的早期检测模型执行“黑盒”推理,缺乏可解释性和信任度,阻碍了实际临床应用。得益于大型语言模型(LLMs)引入的生成特性,此类模型的决策和预测可以通过相应的描述进行半解释。然而,现有的LLMs大多是为通用目的而训练的,没有心理认知理论的指导。为此,我们首先强调了先验理论的重要性,通过针对压力检测量身定制的思维链(chain-of-thoughts)来提高性能。这种名为认知链的方法通过基于认知评估理论的逐步认知视角,阐明了压力的产生过程,其流程为:刺激→评估→反应→压力状态,引导LLMs提供全面的推理解释。我们进一步研究了所提出的认知链格式带来的好处,通过利用它作为LLMs指令调优的合成数据集生成模板,并引入CogInstruct,一个用于压力检测的指令调优数据集。该数据集是使用三阶段自反思标注流程开发的,使LLMs能够自主生成和改进指令数据。通过使用CogInstruct指令调优Llama3,我们开发了CogLLM,一个可解释的压力检测模型。评估表明,CogLLM在提高可解释性的同时,实现了出色的性能。我们的工作贡献了一种新颖的方法,通过将认知理论整合到LLM推理过程中,为未来的可解释AI研究提供了一个有希望的方向。

🔬 方法详解

问题定义:现有压力检测模型缺乏可解释性,导致用户和医生难以信任模型的预测结果,阻碍了其在实际临床环境中的应用。这些模型通常是黑盒模型,无法提供关于其决策过程的解释。

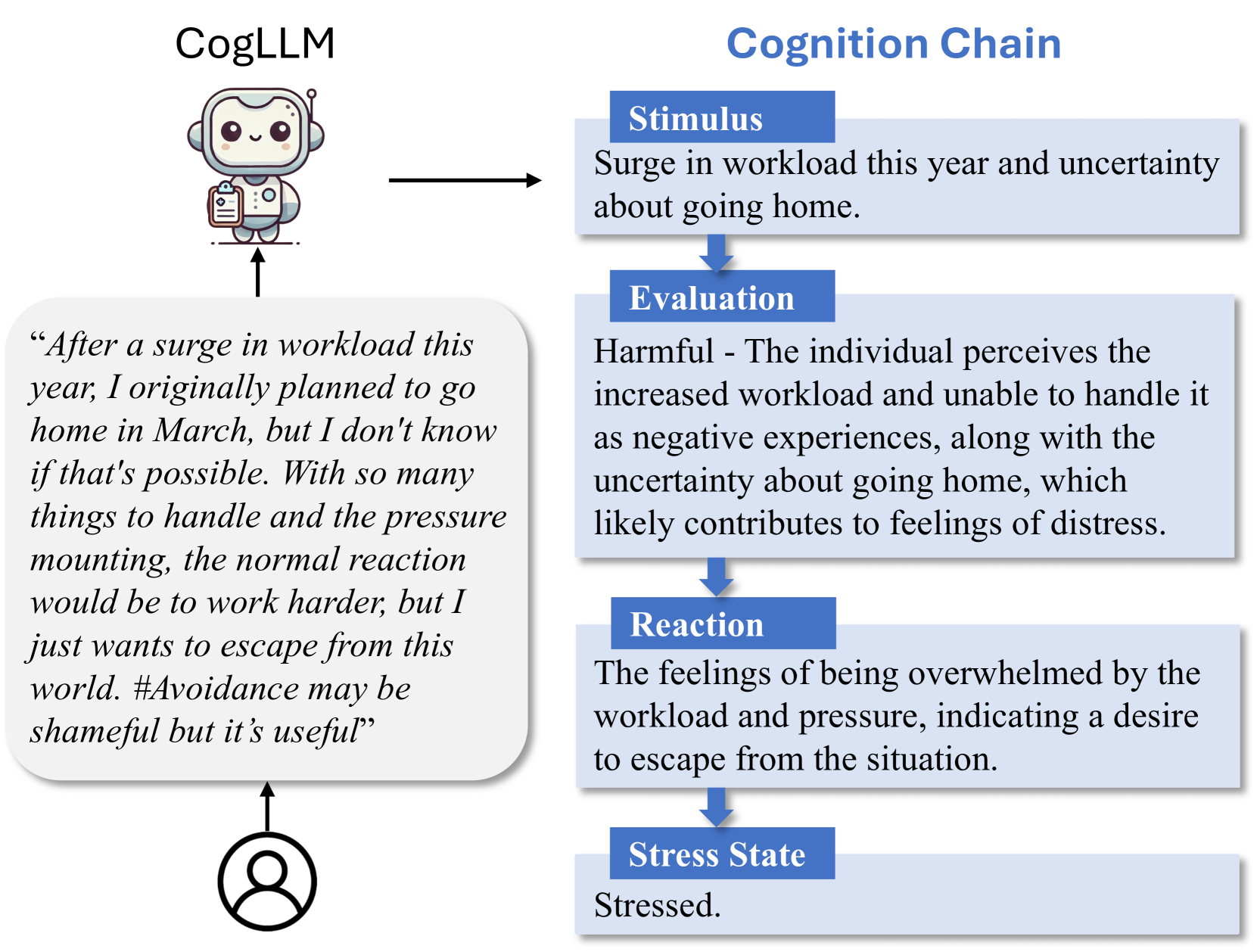

核心思路:论文的核心思路是将认知评估理论融入到大型语言模型(LLMs)的推理过程中。通过模拟人类对压力的认知过程(刺激->评估->反应->压力状态),引导LLMs生成更具解释性的推理过程,从而提高模型的可解释性和可信度。

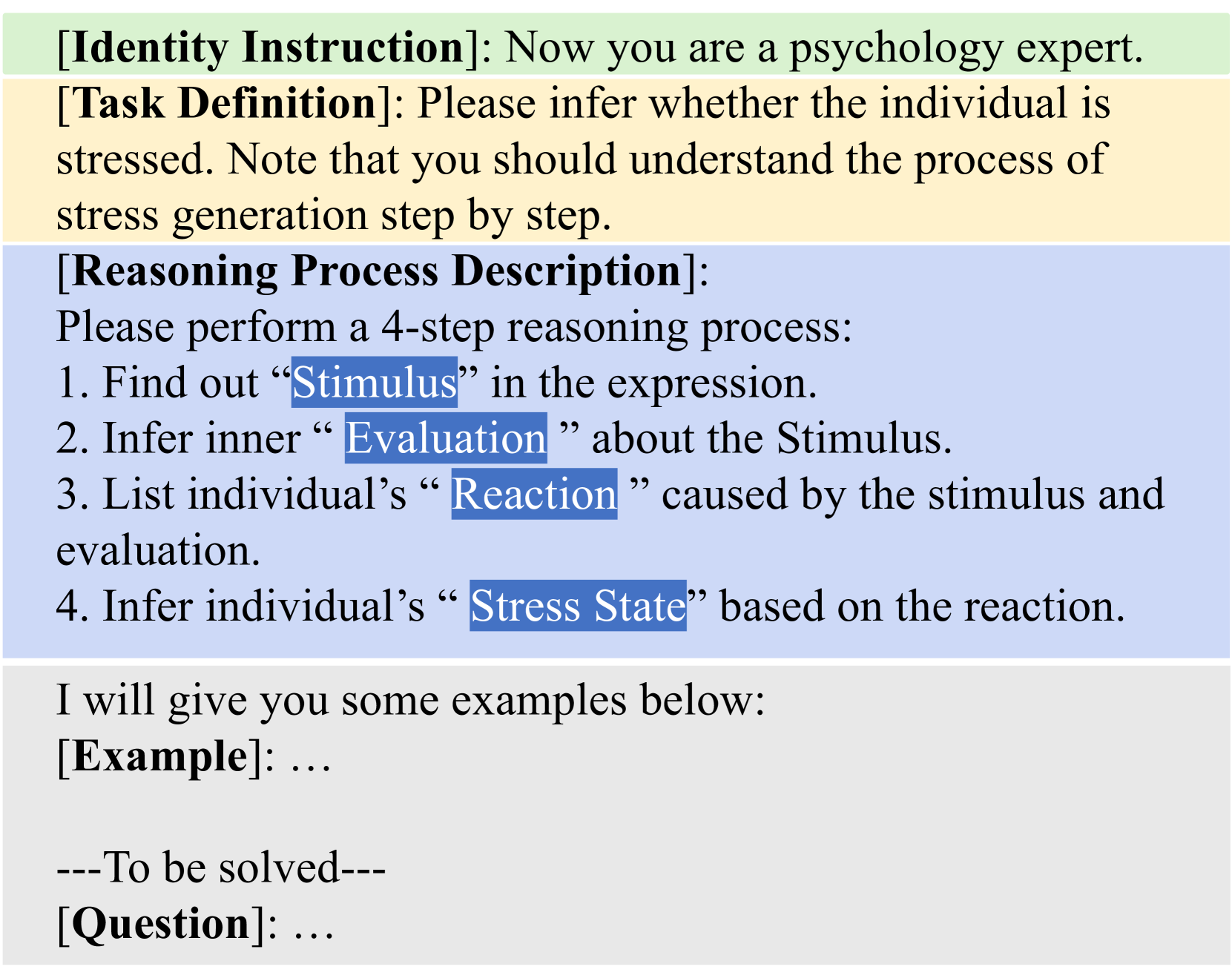

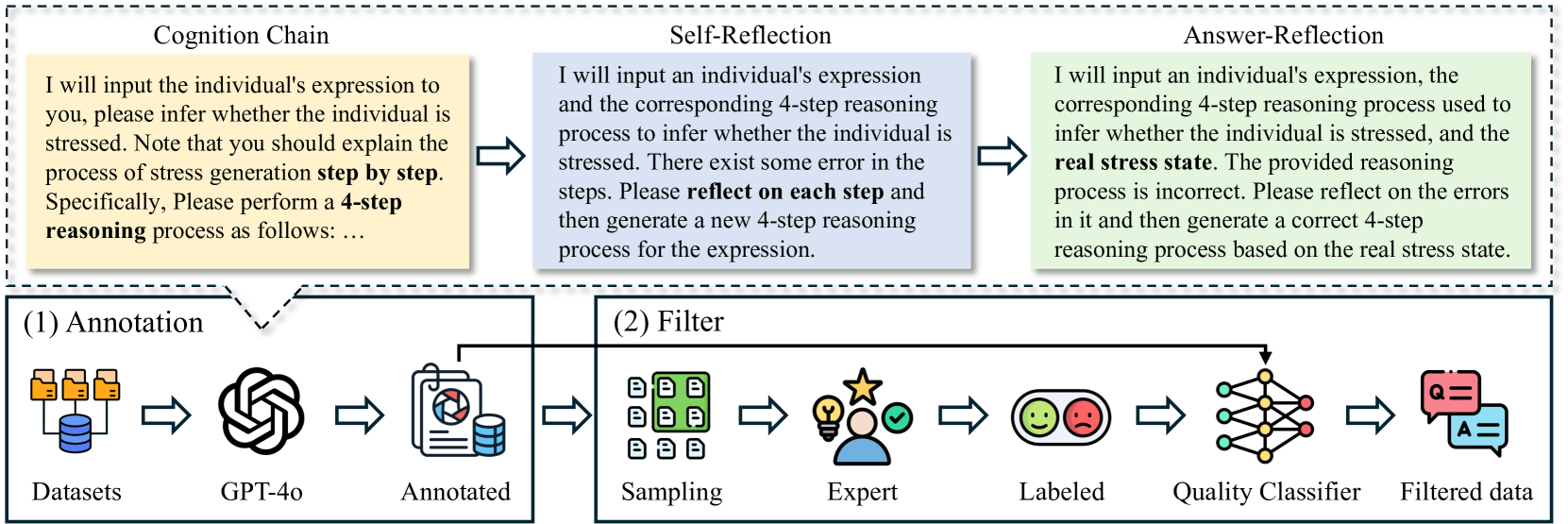

技术框架:论文的技术框架主要包含两个部分:认知链(Cognition Chain)和CogInstruct数据集。首先,定义认知链格式,用于指导LLMs进行压力推理。然后,利用认知链作为模板,生成CogInstruct数据集,用于指令调优LLMs。最后,使用CogInstruct数据集对Llama3进行指令调优,得到CogLLM模型。

关键创新:论文的关键创新在于将认知理论与LLMs相结合,提出了一种可解释的压力检测方法。与现有方法相比,该方法不仅能够进行压力检测,还能够提供关于其决策过程的解释,从而提高模型的可解释性和可信度。此外,CogInstruct数据集的构建也采用了三阶段自反思标注流程,提高了数据的质量和多样性。

关键设计:认知链的设计基于认知评估理论,包含四个阶段:刺激、评估、反应和压力状态。每个阶段都对应着LLM需要生成的文本描述。CogInstruct数据集的构建采用了三阶段自反思标注流程,包括生成、评估和改进三个阶段。在生成阶段,LLM根据认知链生成初始数据。在评估阶段,LLM对生成的数据进行评估,并识别出错误或不一致之处。在改进阶段,LLM根据评估结果对数据进行改进,从而提高数据的质量。

🖼️ 关键图片

📊 实验亮点

论文通过实验证明,CogLLM在压力检测任务上取得了出色的性能,同时显著提高了模型的可解释性。具体性能数据未知,但论文强调CogLLM在可解释性方面优于现有方法,为未来的可解释AI研究提供了有希望的方向。

🎯 应用场景

该研究成果可应用于心理健康领域的早期干预和预防。通过社交媒体数据,可以帮助识别高危人群,提供个性化的心理支持和干预措施。此外,该方法还可以推广到其他需要可解释AI的领域,如医疗诊断、金融风险评估等。

📄 摘要(原文)

Stress is a pervasive global health issue that can lead to severe mental health problems. Early detection offers timely intervention and prevention of stress-related disorders. The current early detection models perform "black box" inference suffering from limited explainability and trust which blocks the real-world clinical application. Thanks to the generative properties introduced by the Large Language Models (LLMs), the decision and the prediction from such models are semi-interpretable through the corresponding description. However, the existing LLMs are mostly trained for general purposes without the guidance of psychological cognitive theory. To this end, we first highlight the importance of prior theory with the observation of performance boosted by the chain-of-thoughts tailored for stress detection. This method termed Cognition Chain explicates the generation of stress through a step-by-step cognitive perspective based on cognitive appraisal theory with a progress pipeline: Stimulus $\rightarrow$ Evaluation $\rightarrow$ Reaction $\rightarrow$ Stress State, guiding LLMs to provide comprehensive reasoning explanations. We further study the benefits brought by the proposed Cognition Chain format by utilising it as a synthetic dataset generation template for LLMs instruction-tuning and introduce CogInstruct, an instruction-tuning dataset for stress detection. This dataset is developed using a three-stage self-reflective annotation pipeline that enables LLMs to autonomously generate and refine instructional data. By instruction-tuning Llama3 with CogInstruct, we develop CogLLM, an explainable stress detection model. Evaluations demonstrate that CogLLM achieves outstanding performance while enhancing explainability. Our work contributes a novel approach by integrating cognitive theories into LLM reasoning processes, offering a promising direction for future explainable AI research.