Embodied CoT Distillation From LLM To Off-the-shelf Agents

作者: Wonje Choi, Woo Kyung Kim, Minjong Yoo, Honguk Woo

分类: cs.AI, cs.RO

发布日期: 2024-12-16

备注: Accepted at ICML 2024

💡 一句话要点

提出DeDer框架,将LLM的具身推理能力蒸馏到轻量级Agent中

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能 大型语言模型 知识蒸馏 小型语言模型 推理规划

📋 核心要点

- 现有方法难以在算力受限设备上部署LLM进行复杂的具身任务,限制了LLM在实际场景中的应用。

- DeDer框架通过分解LLM的推理过程,并利用蒸馏技术将知识迁移到小型语言模型,实现高效推理。

- 实验结果表明,DeDer在ALFRED基准测试中超越了现有方法,验证了其有效性和效率。

📝 摘要(中文)

本文旨在解决如何在算力受限的设备上,利用大型语言模型(LLM)处理复杂的具身任务。为此,我们提出了DeDer框架,用于分解和蒸馏LLM的具身推理能力,使其能够迁移到高效的、基于小型语言模型(sLM)的策略中。在DeDer中,基于LLM的策略决策过程被重构为一个层级结构,包含推理策略和规划策略。推理策略通过蒸馏LLM的具身上下文学习和自验证生成的数据,产生有效的理由。规划策略在理由的指导下,高效地生成优化后的计划。DeDer允许采用sLM来实现这两种策略,并部署在现成的设备上。此外,为了提高中间理由的质量,我们设计了具身知识图谱,并使用对比提示注意力模型,通过单次推理及时生成多个理由。在ALFRED基准测试上的实验表明,DeDer超越了领先的语言规划和蒸馏方法,证明了基于sLM的具身策略通过DeDer获得的适用性和效率。

🔬 方法详解

问题定义:现有方法难以将大型语言模型(LLM)的强大推理能力部署到算力受限的具身智能体上。直接使用LLM进行决策计算成本高昂,无法满足实时性要求。此外,LLM在具身任务中的推理过程缺乏针对性优化,导致效率低下。

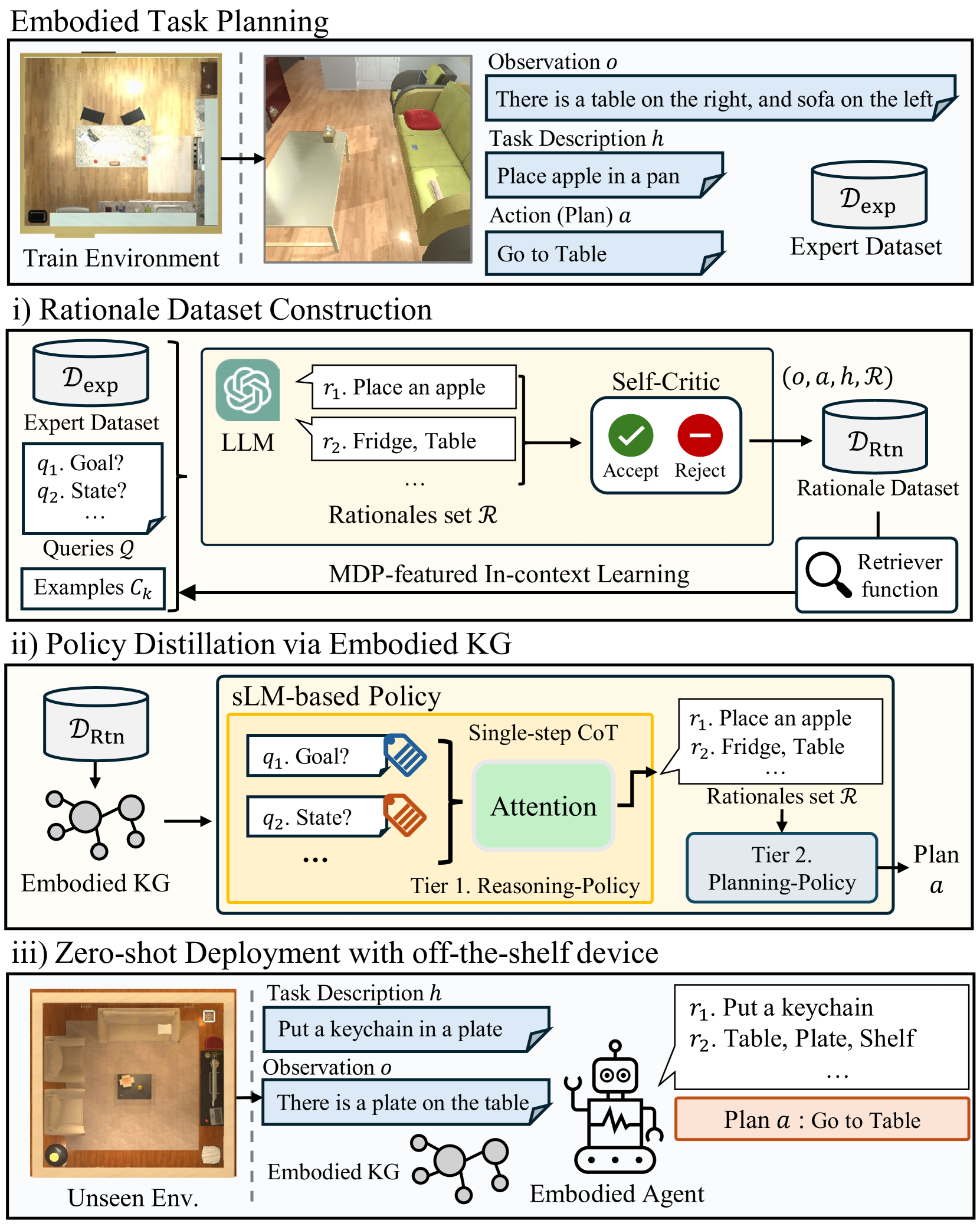

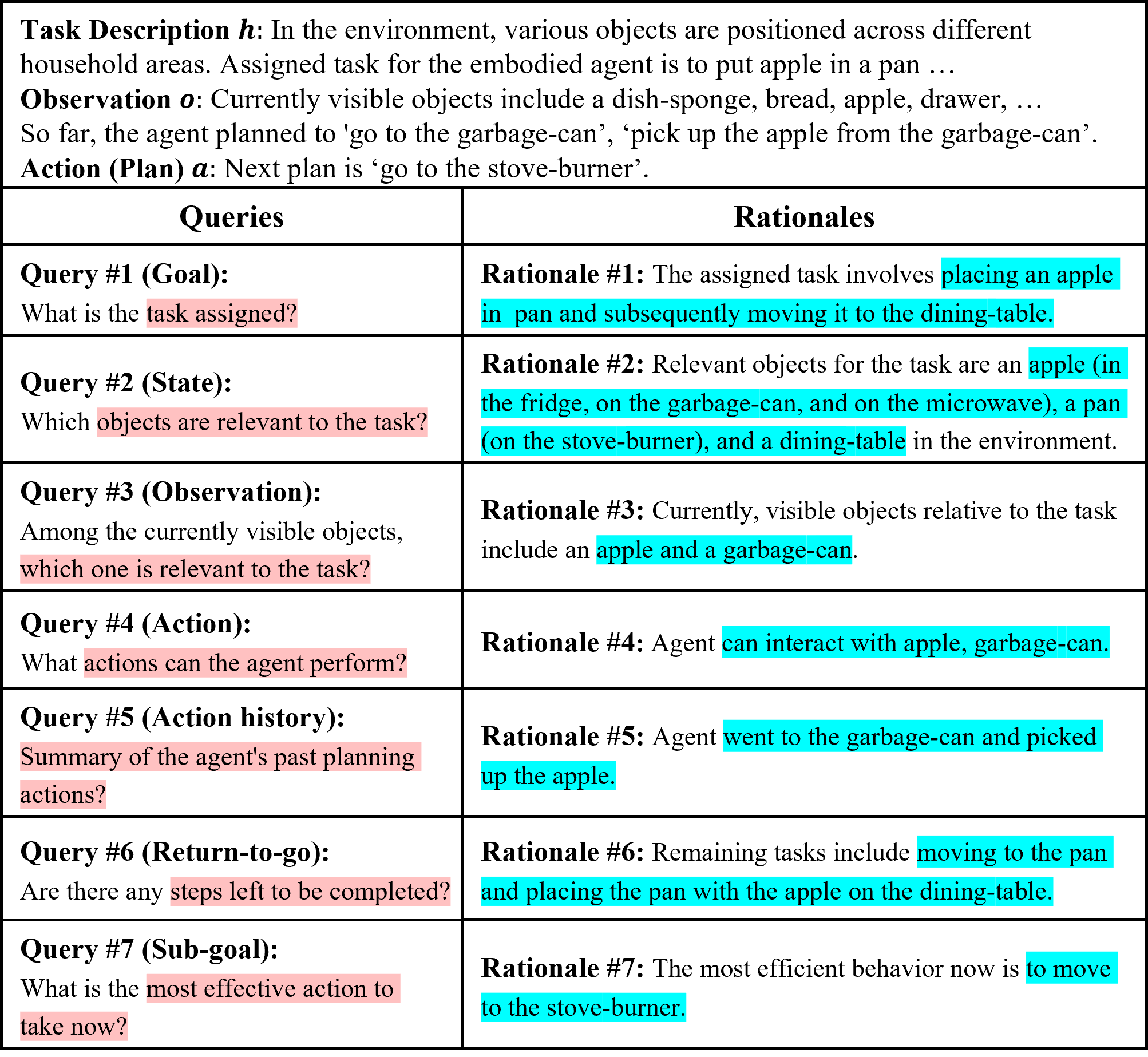

核心思路:DeDer框架的核心思路是将LLM的复杂决策过程分解为两个阶段:推理和规划。首先,利用LLM进行上下文学习和自验证,生成高质量的推理链(rationales)。然后,将这些推理链作为指导,训练一个小型语言模型(sLM)进行高效的规划。通过蒸馏LLM的知识,sLM能够在算力受限的设备上实现接近LLM的性能。

技术框架:DeDer框架包含以下主要模块:1) LLM推理模块:利用LLM进行上下文学习,生成初始的推理链。2) 自验证模块:对LLM生成的推理链进行验证和修正,提高推理质量。3) 具身知识图谱:构建特定于具身任务的知识图谱,用于增强推理过程。4) 对比提示注意力模型:通过对比学习,生成多个不同的推理链,提高鲁棒性。5) 蒸馏模块:将LLM生成的推理链作为训练数据,训练sLM进行规划。

关键创新:DeDer的关键创新在于:1) 分层推理框架:将LLM的决策过程分解为推理和规划两个阶段,降低了计算复杂度。2) 具身知识图谱:利用特定于具身任务的知识,提高了推理质量。3) 对比提示注意力模型:通过生成多个不同的推理链,提高了鲁棒性。4) 蒸馏到sLM:将LLM的知识迁移到小型语言模型,使其能够在算力受限的设备上运行。

关键设计:DeDer的关键设计包括:1) 上下文学习策略:设计合适的上下文示例,引导LLM生成高质量的推理链。2) 自验证机制:设计有效的自验证规则,对LLM生成的推理链进行修正。3) 对比损失函数:设计对比损失函数,训练对比提示注意力模型,生成多个不同的推理链。4) 蒸馏损失函数:设计蒸馏损失函数,将LLM的知识迁移到sLM。

🖼️ 关键图片

📊 实验亮点

在ALFRED基准测试中,DeDer框架超越了现有的语言规划和蒸馏方法,证明了其有效性。具体而言,DeDer在任务完成率方面取得了显著提升,表明其生成的计划更加准确和可靠。此外,DeDer在推理速度方面也表现出色,验证了其在算力受限设备上的适用性。

🎯 应用场景

DeDer框架可应用于各种需要具身智能的场景,例如家庭服务机器人、自动驾驶、智能制造等。通过将LLM的强大推理能力迁移到轻量级设备上,DeDer可以实现更智能、更高效的决策,提高机器人在复杂环境中的适应性和自主性。未来,DeDer有望推动具身智能技术的广泛应用。

📄 摘要(原文)

We address the challenge of utilizing large language models (LLMs) for complex embodied tasks, in the environment where decision-making systems operate timely on capacity-limited, off-the-shelf devices. We present DeDer, a framework for decomposing and distilling the embodied reasoning capabilities from LLMs to efficient, small language model (sLM)-based policies. In DeDer, the decision-making process of LLM-based strategies is restructured into a hierarchy with a reasoning-policy and planning-policy. The reasoning-policy is distilled from the data that is generated through the embodied in-context learning and self-verification of an LLM, so it can produce effective rationales. The planning-policy, guided by the rationales, can render optimized plans efficiently. In turn, DeDer allows for adopting sLMs for both policies, deployed on off-the-shelf devices. Furthermore, to enhance the quality of intermediate rationales, specific to embodied tasks, we devise the embodied knowledge graph, and to generate multiple rationales timely through a single inference, we also use the contrastively prompted attention model. Our experiments with the ALFRED benchmark demonstrate that DeDer surpasses leading language planning and distillation approaches, indicating the applicability and efficiency of sLM-based embodied policies derived through DeDer.