Optimizing AI-Assisted Code Generation

作者: Simon Torka, Sahin Albayrak

分类: cs.SE, cs.AI, cs.LG

发布日期: 2024-12-14

💡 一句话要点

优化AI辅助代码生成:提升安全性、可靠性与可访问性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI辅助代码生成 大型语言模型 代码安全性 代码可靠性 软件开发 代码质量 AI伦理 代码验证

📋 核心要点

- 现有AI代码生成工具虽然强大,但其生成代码的功能性和安全性无法得到保证,存在潜在风险。

- 论文旨在探索优化AI代码生成系统的方法,以提升生成代码的安全性、可靠性、功能性和质量。

- 研究关注如何使AI代码生成更安全、高性能,并提高其可访问性,促进AI开发的包容性和公平性。

📝 摘要(中文)

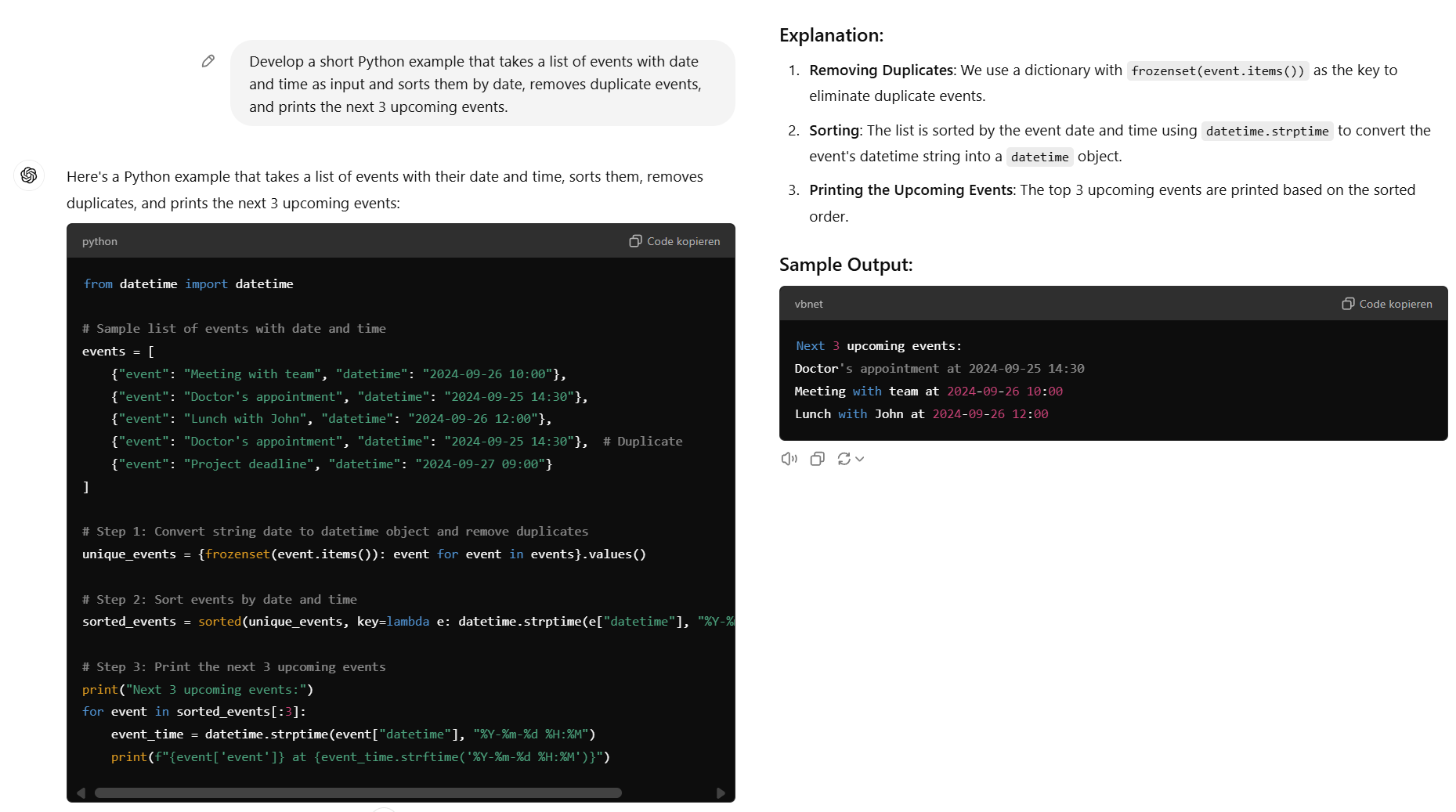

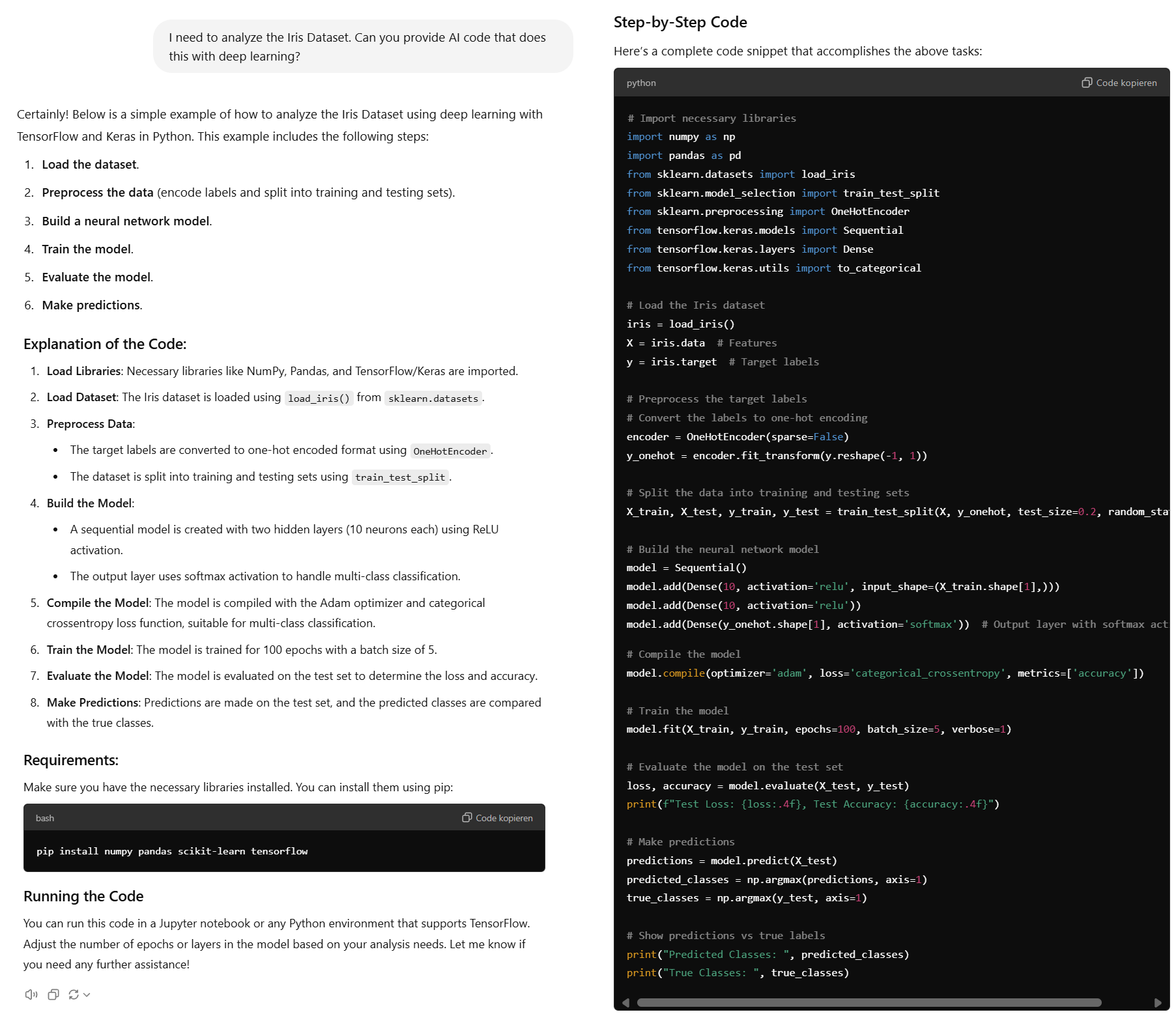

近年来,AI辅助代码生成工具的兴起显著改变了软件开发。虽然代码生成器主要用于支持传统软件开发,但其应用将扩展到强大而安全的AI系统。诸如ChatGPT、OpenAI Codex、GitHub Copilot和AlphaCode等系统,利用了大型语言模型(LLM)在机器学习(ML)和自然语言处理(NLP)方面的进步。然而,必须牢记这些模型以概率方式工作,这意味着虽然它们可以从自然语言输入生成复杂代码,但无法保证生成代码的功能和安全性。为了充分利用这项技术的巨大潜力,必须保证生成代码的安全性、可靠性、功能性和质量。本文探讨了迄今为止这些目标的实现情况,并探讨了优化它们的策略。此外,我们还探讨了如何优化这些系统以创建安全、高性能和可执行的人工智能(AI)模型,并考虑如何提高其可访问性,从而使AI开发更具包容性和公平性。

🔬 方法详解

问题定义:当前AI辅助代码生成工具,如ChatGPT等,虽然能够根据自然语言生成代码,但由于其概率性本质,无法保证生成代码的安全性、可靠性和功能性。现有方法缺乏对生成代码质量的有效保障机制,容易引入漏洞和错误。

核心思路:论文的核心思路是研究和探索优化策略,从多个维度提升AI辅助代码生成系统的性能。这包括提高生成代码的安全性、可靠性、功能性和质量,并关注如何使AI开发更具包容性和公平性。

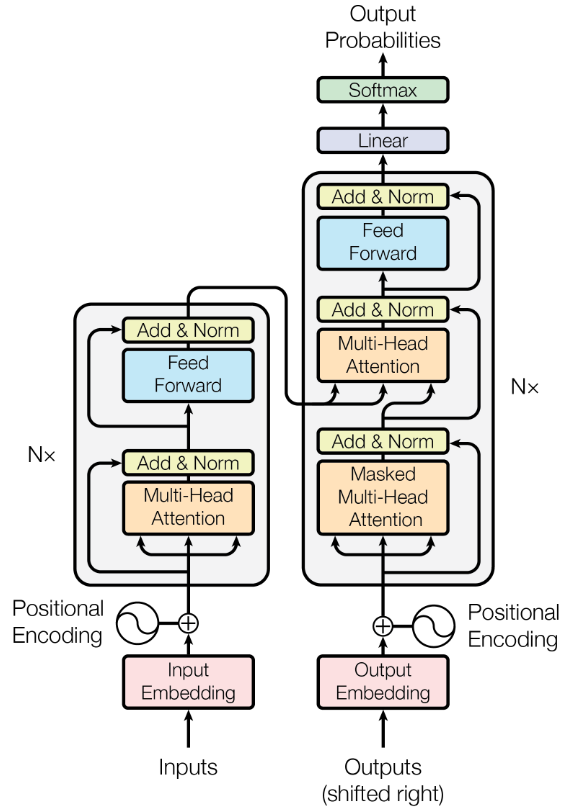

技术框架:论文并未明确提出一个具体的技术框架,而是侧重于对现有AI代码生成系统的优化策略进行探讨。研究可能涉及对大型语言模型(LLM)的改进、代码验证技术的应用、以及针对特定安全漏洞的防御机制设计。整体流程可能包括需求分析、代码生成、代码验证、以及反馈优化等环节。

关键创新:论文的创新之处在于其系统性地关注AI辅助代码生成过程中的安全性、可靠性、功能性和质量问题,并探讨了相应的优化策略。与以往研究可能侧重于代码生成效率或功能实现不同,本文更加强调生成代码的实用性和安全性。

关键设计:由于论文是综述性质,并未提出具体的算法或模型设计。可能的关键设计包括:1) 设计有效的代码验证机制,例如基于形式化方法的验证工具;2) 引入安全编码规范,并将其融入到代码生成过程中;3) 开发针对特定漏洞的检测和修复工具;4) 优化大型语言模型的训练数据,使其更加关注代码的安全性和可靠性。

🖼️ 关键图片

📊 实验亮点

由于该论文为综述性文章,并未提供具体的实验结果。其亮点在于对现有AI辅助代码生成技术的局限性进行了深入分析,并提出了未来优化的方向,为后续研究提供了有价值的参考。

🎯 应用场景

该研究成果可应用于各种软件开发场景,尤其是在对安全性要求较高的领域,如金融、医疗和国防等。通过优化AI辅助代码生成,可以降低软件开发成本,提高开发效率,并减少潜在的安全风险。未来,该技术有望促进AI在软件开发领域的更广泛应用,并推动软件工程的自动化和智能化。

📄 摘要(原文)

In recent years, the rise of AI-assisted code-generation tools has significantly transformed software development. While code generators have mainly been used to support conventional software development, their use will be extended to powerful and secure AI systems. Systems capable of generating code, such as ChatGPT, OpenAI Codex, GitHub Copilot, and AlphaCode, take advantage of advances in machine learning (ML) and natural language processing (NLP) enabled by large language models (LLMs). However, it must be borne in mind that these models work probabilistically, which means that although they can generate complex code from natural language input, there is no guarantee for the functionality and security of the generated code. However, to fully exploit the considerable potential of this technology, the security, reliability, functionality, and quality of the generated code must be guaranteed. This paper examines the implementation of these goals to date and explores strategies to optimize them. In addition, we explore how these systems can be optimized to create safe, high-performance, and executable artificial intelligence (AI) models, and consider how to improve their accessibility to make AI development more inclusive and equitable.