Neural Interactive Proofs

作者: Lewis Hammond, Sam Adam-Day

分类: cs.AI, cs.LG

发布日期: 2024-12-12 (更新: 2025-03-17)

备注: ICLR'25 camera-ready version; 51 pages, 17 figures

💡 一句话要点

提出神经交互证明框架,用于可信但算力有限的验证者与不可信但强大的证明者之间的交互任务。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经交互证明 交互式证明系统 AI安全 证明者-验证者博弈 神经网络 图同构 代码验证

📋 核心要点

- 现有方法难以保证AI系统的安全性,尤其是在与不可信的强大AI交互时,验证其行为的正确性面临挑战。

- 论文提出神经交互证明框架,允许算力有限的验证者与强大的证明者通过多轮交互,验证任务的正确性。

- 实验在图同构和代码验证任务上验证了该框架的有效性,为构建更安全的AI系统奠定基础。

📝 摘要(中文)

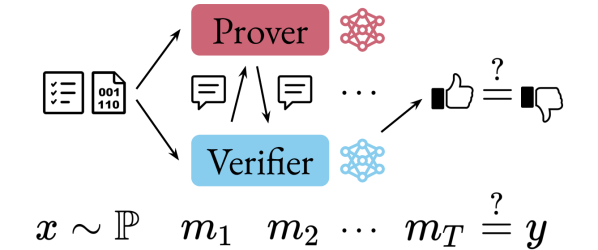

本文研究了如何让一个可信但计算能力有限的代理(“验证者”)学习与一个或多个强大但不可信的代理(“证明者”)交互,以解决给定的任务。更具体地说,我们研究了使用神经网络表示代理的情况,并将此问题的解决方案称为神经交互证明。首先,我们介绍了一个基于证明者-验证者博弈的统一框架,该框架概括了先前提出的交互协议。然后,我们描述了几种用于生成神经交互证明的新协议,并对新的和现有的方法进行了理论比较。最后,我们通过在两个领域中的实验来支持这一理论:一个说明关键思想的玩具图同构问题,以及一个使用大型语言模型的代码验证任务。通过这样做,我们旨在为未来关于神经交互证明及其在构建更安全的AI系统中的应用奠定基础。

🔬 方法详解

问题定义:论文旨在解决如何让一个计算能力有限但可信的验证者,与一个或多个计算能力强大但不可信的证明者进行交互,以确保解决特定任务的正确性。现有的挑战在于,如何设计一种协议,使得验证者能够在不信任证明者的情况下,有效地验证其提供的解决方案的正确性,尤其是在证明者具有远超验证者的计算能力时。

核心思路:核心思路是借鉴交互式证明系统的思想,通过多轮的交互,让证明者逐步揭示解决方案的关键信息,而验证者则通过一系列的验证步骤,逐步确认解决方案的正确性。这种设计允许验证者利用其有限的计算资源,通过巧妙的提问和验证,来抵御证明者的欺骗。

技术框架:整体框架基于证明者-验证者博弈。框架包含以下主要模块:1) 证明者网络:负责生成解决方案或证明;2) 验证者网络:负责提出问题并验证证明者的回答;3) 交互协议:定义证明者和验证者之间的交互流程,包括提问、回答和验证的顺序和方式;4) 奖励函数:用于训练证明者和验证者网络,鼓励他们合作解决问题。

关键创新:最重要的创新在于将交互式证明系统的概念与神经网络相结合,提出了神经交互证明。与传统的交互式证明系统不同,神经交互证明使用神经网络来表示证明者和验证者,从而能够处理更复杂、更现实的任务。此外,论文还提出了一些新的交互协议,这些协议能够更有效地利用证明者和验证者的计算资源。

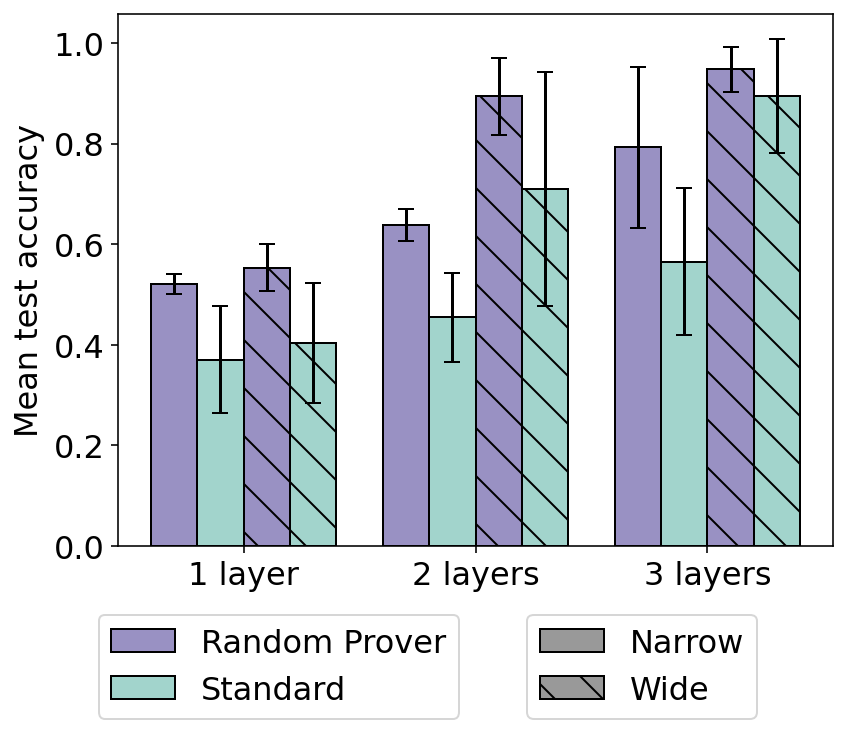

关键设计:关键设计包括:1) 网络结构:证明者和验证者网络可以使用各种神经网络结构,如循环神经网络(RNN)或Transformer网络,具体取决于任务的性质;2) 损失函数:损失函数的设计需要考虑证明者和验证者的目标,例如,证明者需要最大化验证者接受解决方案的概率,而验证者需要最小化接受错误解决方案的概率;3) 交互轮数:交互轮数的选择需要在效率和安全性之间进行权衡,更多的交互轮数可以提高验证的可靠性,但也会增加计算成本。

🖼️ 关键图片

📊 实验亮点

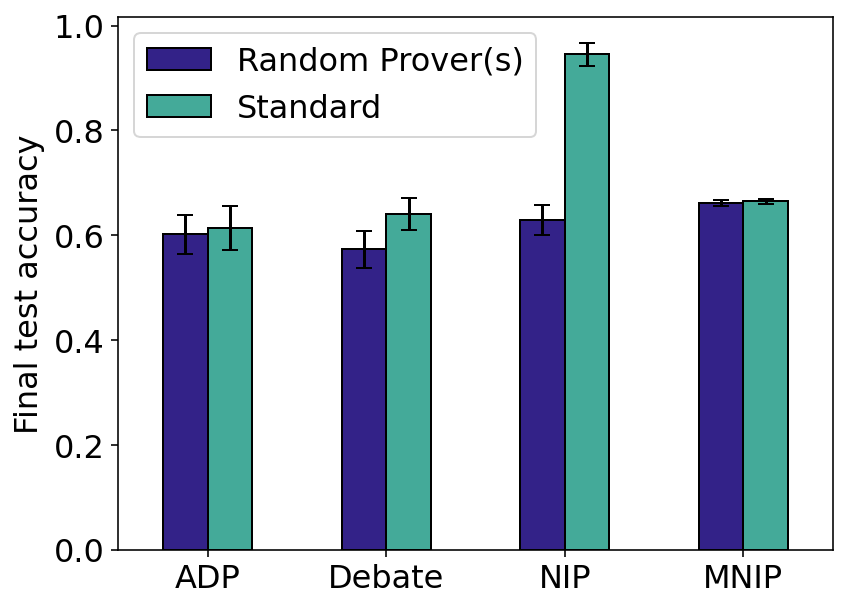

论文在图同构和代码验证两个任务上进行了实验。在图同构任务中,神经交互证明能够有效地验证两个图是否同构。在代码验证任务中,神经交互证明能够利用大型语言模型验证代码的正确性。实验结果表明,该框架能够有效地提高AI系统的安全性。

🎯 应用场景

神经交互证明在构建更安全的AI系统中具有广泛的应用前景。例如,可以用于验证AI模型的输出是否符合预期,防止AI系统产生有害或不正确的行为。此外,还可以用于代码验证、安全协议设计等领域,提高系统的安全性和可靠性。该研究为AI安全领域提供了一种新的思路和方法。

📄 摘要(原文)

We consider the problem of how a trusted, but computationally bounded agent (a 'verifier') can learn to interact with one or more powerful but untrusted agents ('provers') in order to solve a given task. More specifically, we study the case in which agents are represented using neural networks and refer to solutions of this problem as neural interactive proofs. First we introduce a unifying framework based on prover-verifier games, which generalises previously proposed interaction protocols. We then describe several new protocols for generating neural interactive proofs, and provide a theoretical comparison of both new and existing approaches. Finally, we support this theory with experiments in two domains: a toy graph isomorphism problem that illustrates the key ideas, and a code validation task using large language models. In so doing, we aim to create a foundation for future work on neural interactive proofs and their application in building safer AI systems.