Observing Micromotives and Macrobehavior of Large Language Models

作者: Yuyang Cheng, Xingwei Qu, Tomas Goldsack, Chenghua Lin, Chung-Chi Chen

分类: physics.soc-ph, cs.AI, cs.CL

发布日期: 2024-12-10

💡 一句话要点

基于Schelling模型,研究LLM的微观动机与宏观行为对社会隔离的影响

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 微观动机 宏观行为 社会隔离 Schelling模型

📋 核心要点

- 现有研究主要关注消除LLM的偏见,但忽略了LLM的微观动机如何影响社会宏观行为。

- 本文借鉴Schelling的隔离模型,观察LLM的微观动机与宏观行为之间的关系,分析LLM对社会隔离的影响。

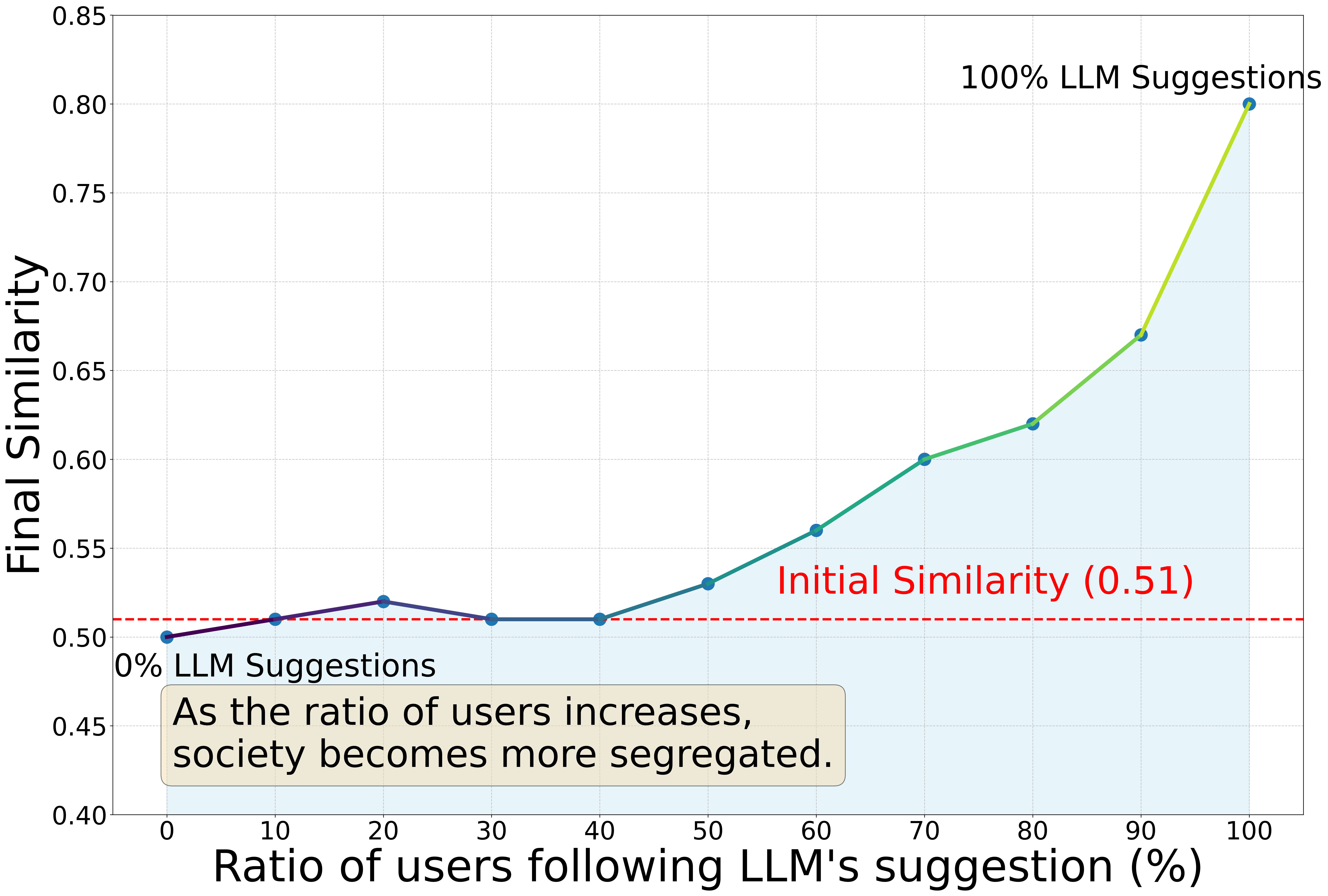

- 实验结果表明,即使LLM的偏见程度不同,更多人采纳LLM的建议会导致社会隔离现象加剧。

📝 摘要(中文)

本文研究大型语言模型(LLM)的微观动机与宏观行为之间的关系,借鉴了诺贝尔经济学奖得主Thomas C. Schelling的隔离模型。当前关于LLM微观动机(如偏好或偏见)的研究,通常假设消除这些偏见后,用户将做出更合适的决策。因此,许多研究致力于消除LLM的偏见。尽管NLP社区对LLM的微观动机进行了大量讨论,但鲜有研究系统地考察LLM如何影响社会的宏观行为。本文的研究结果表明,无论LLM的偏见程度如何,当更多人遵循LLM的建议时,社会隔离现象都会加剧。希望本文的讨论能引发对缓解LLM微观动机这一根本假设的进一步思考,并重新评估LLM对用户和社会的影响。

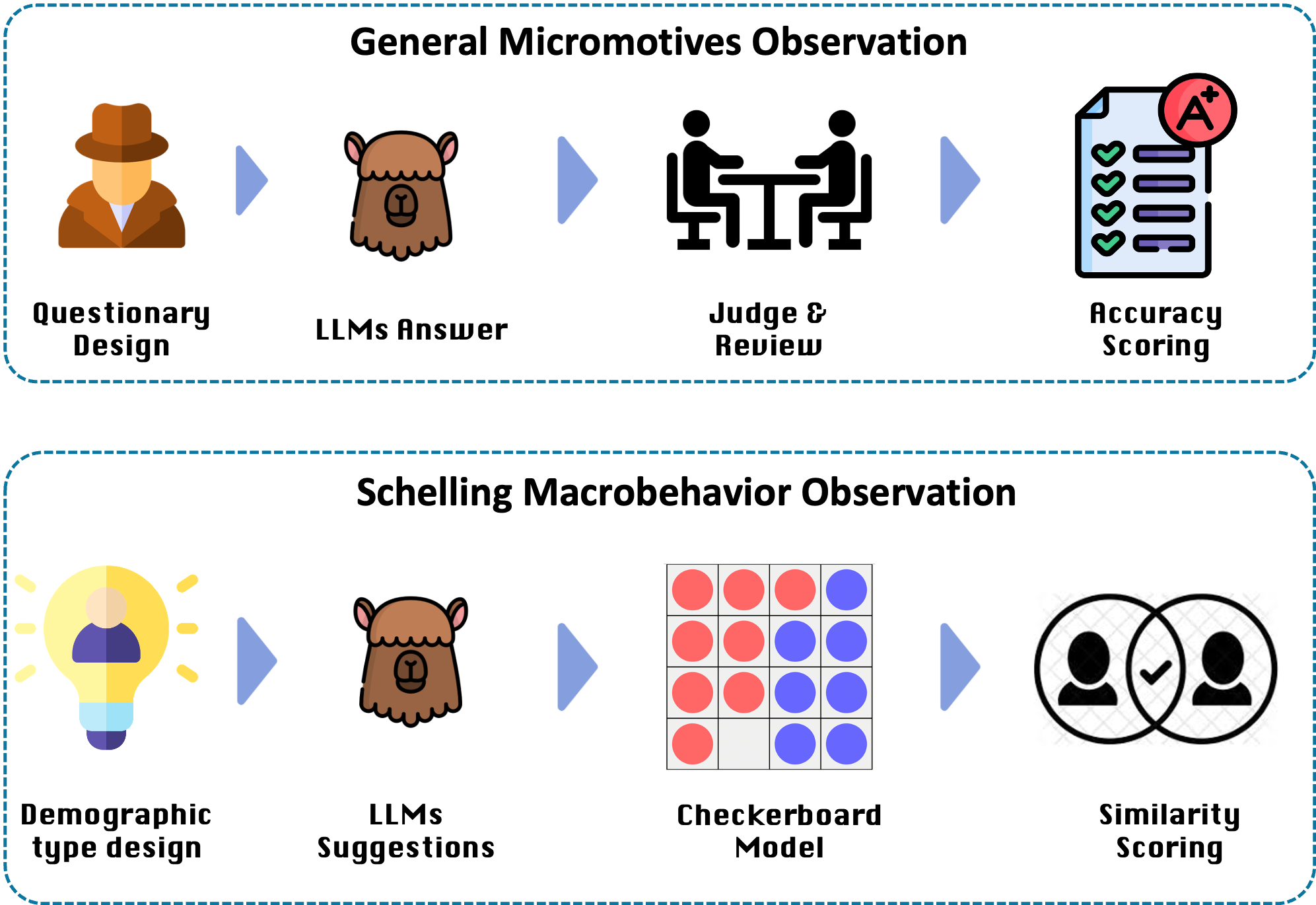

🔬 方法详解

问题定义:现有研究主要集中在消除LLM中的偏见,认为消除偏见后用户就能做出更合理的决策。然而,这些研究忽略了LLM的微观动机(如偏好)如何通过影响个体决策,进而影响整个社会的宏观行为,例如社会隔离。因此,本文旨在研究LLM的微观动机与宏观社会行为之间的关系,特别是它们如何影响社会隔离。

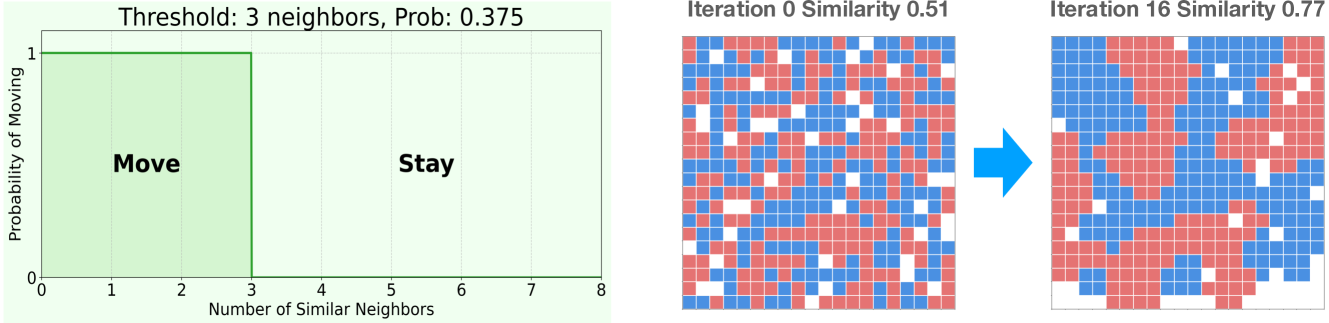

核心思路:本文的核心思路是借鉴Thomas C. Schelling的隔离模型,该模型用于研究个体偏好如何导致社会隔离。通过模拟个体在LLM建议下的决策过程,观察不同偏见程度的LLM如何影响社会隔离的程度。核心在于将LLM的建议作为影响个体决策的因素,并分析其对整体社会结构的影响。

技术框架:本文的技术框架主要包括以下几个阶段:1) 构建一个模拟社会环境,其中包含多个个体;2) 为每个个体设定初始属性(例如,对不同群体的偏好程度);3) 使用LLM为个体提供决策建议;4) 个体根据自身偏好和LLM的建议做出决策(例如,选择居住地);5) 评估社会隔离程度,并分析LLM的偏见程度与社会隔离程度之间的关系。

关键创新:本文的关键创新在于将Schelling的隔离模型应用于研究LLM的影响。以往的研究主要关注LLM的偏见消除,而本文则关注LLM的微观动机如何通过影响个体决策,进而影响整个社会的宏观行为。这种视角转变有助于更全面地理解LLM对社会的影响。

关键设计:关键设计包括:1) 如何量化LLM的偏见程度;2) 如何模拟个体根据自身偏好和LLM建议做出决策的过程;3) 如何定义和衡量社会隔离程度。具体的参数设置、损失函数和网络结构等技术细节在论文中可能未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

实验结果表明,无论LLM的偏见程度如何,当更多人遵循LLM的建议时,社会隔离现象都会加剧。这意味着即使LLM经过偏见消除处理,其建议仍然可能导致不良的社会后果。这一发现挑战了当前关于LLM偏见缓解的假设,并强调了重新评估LLM对用户和社会影响的必要性。具体的性能数据和提升幅度未知。

🎯 应用场景

该研究可应用于评估和改进LLM在社会决策支持方面的应用,例如城市规划、资源分配等。通过了解LLM的微观动机如何影响社会宏观行为,可以设计更公平、更具包容性的LLM系统,避免加剧社会不平等和隔离现象。未来的研究可以进一步探索不同类型的LLM和不同的社会环境下的影响。

📄 摘要(原文)

Thomas C. Schelling, awarded the 2005 Nobel Memorial Prize in Economic Sciences, pointed out that ``individuals decisions (micromotives), while often personal and localized, can lead to societal outcomes (macrobehavior) that are far more complex and different from what the individuals intended.'' The current research related to large language models' (LLMs') micromotives, such as preferences or biases, assumes that users will make more appropriate decisions once LLMs are devoid of preferences or biases. Consequently, a series of studies has focused on removing bias from LLMs. In the NLP community, while there are many discussions on LLMs' micromotives, previous studies have seldom conducted a systematic examination of how LLMs may influence society's macrobehavior. In this paper, we follow the design of Schelling's model of segregation to observe the relationship between the micromotives and macrobehavior of LLMs. Our results indicate that, regardless of the level of bias in LLMs, a highly segregated society will emerge as more people follow LLMs' suggestions. We hope our discussion will spark further consideration of the fundamental assumption regarding the mitigation of LLMs' micromotives and encourage a reevaluation of how LLMs may influence users and society.