A Survey of Sustainability in Large Language Models: Applications, Economics, and Challenges

作者: Aditi Singh, Nirmal Prakashbhai Patel, Abul Ehtesham, Saket Kumar, Tala Talaei Khoei

分类: cs.AI, cs.CE

发布日期: 2024-12-06 (更新: 2025-01-18)

💡 一句话要点

综述大型语言模型可持续性:应用、经济与挑战

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 可持续性 能源消耗 碳排放 资源利用 环境影响 人工智能

📋 核心要点

- 大型语言模型在各领域应用广泛,但其高能耗和碳排放引发了对环境可持续性的担忧。

- 该综述旨在全面考察LLM的环境、经济和计算挑战,并探讨资源高效训练等策略。

- 研究结果旨在为研究人员、从业者和政策制定者提供指导,促进可持续AI系统的发展。

📝 摘要(中文)

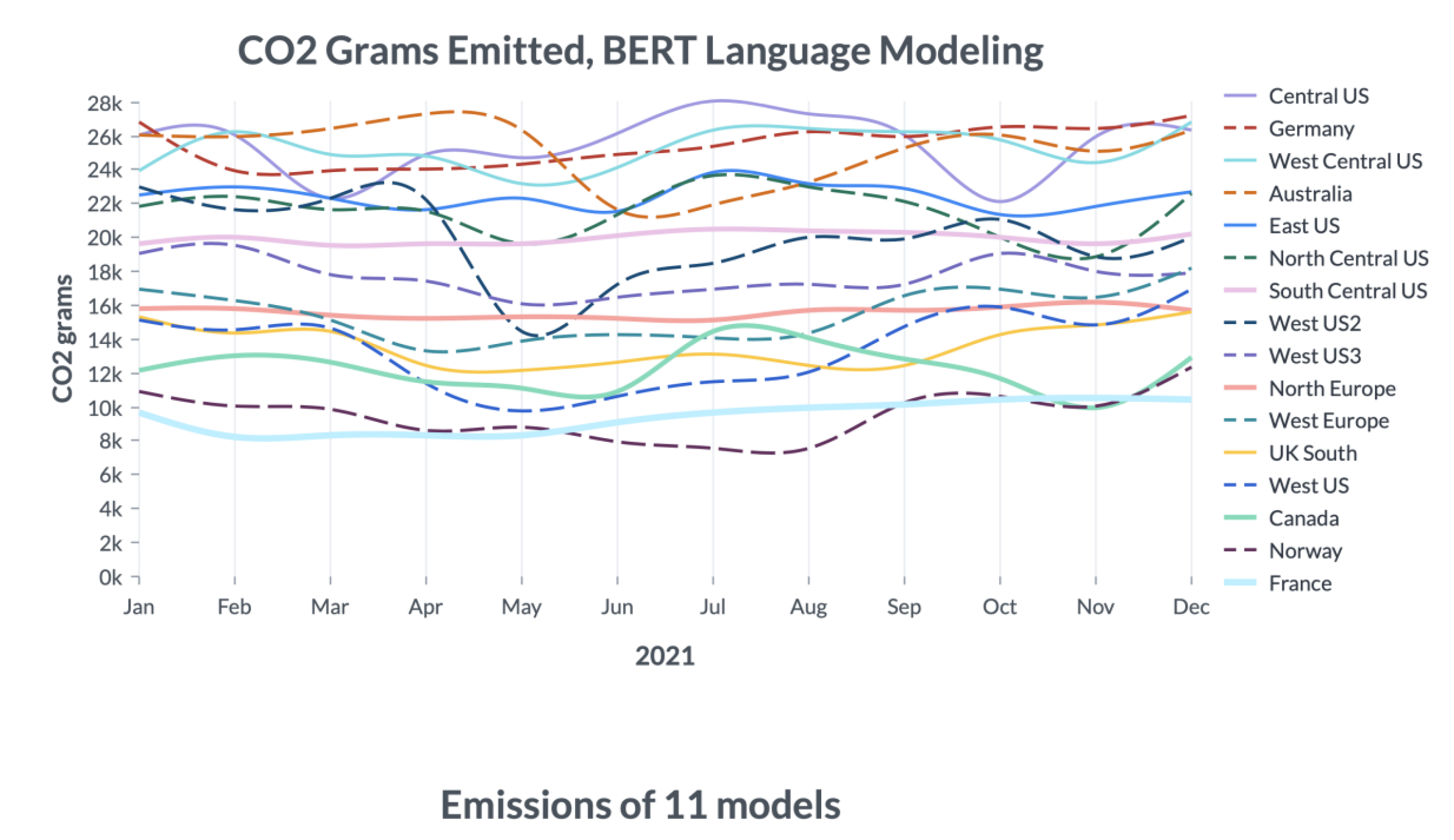

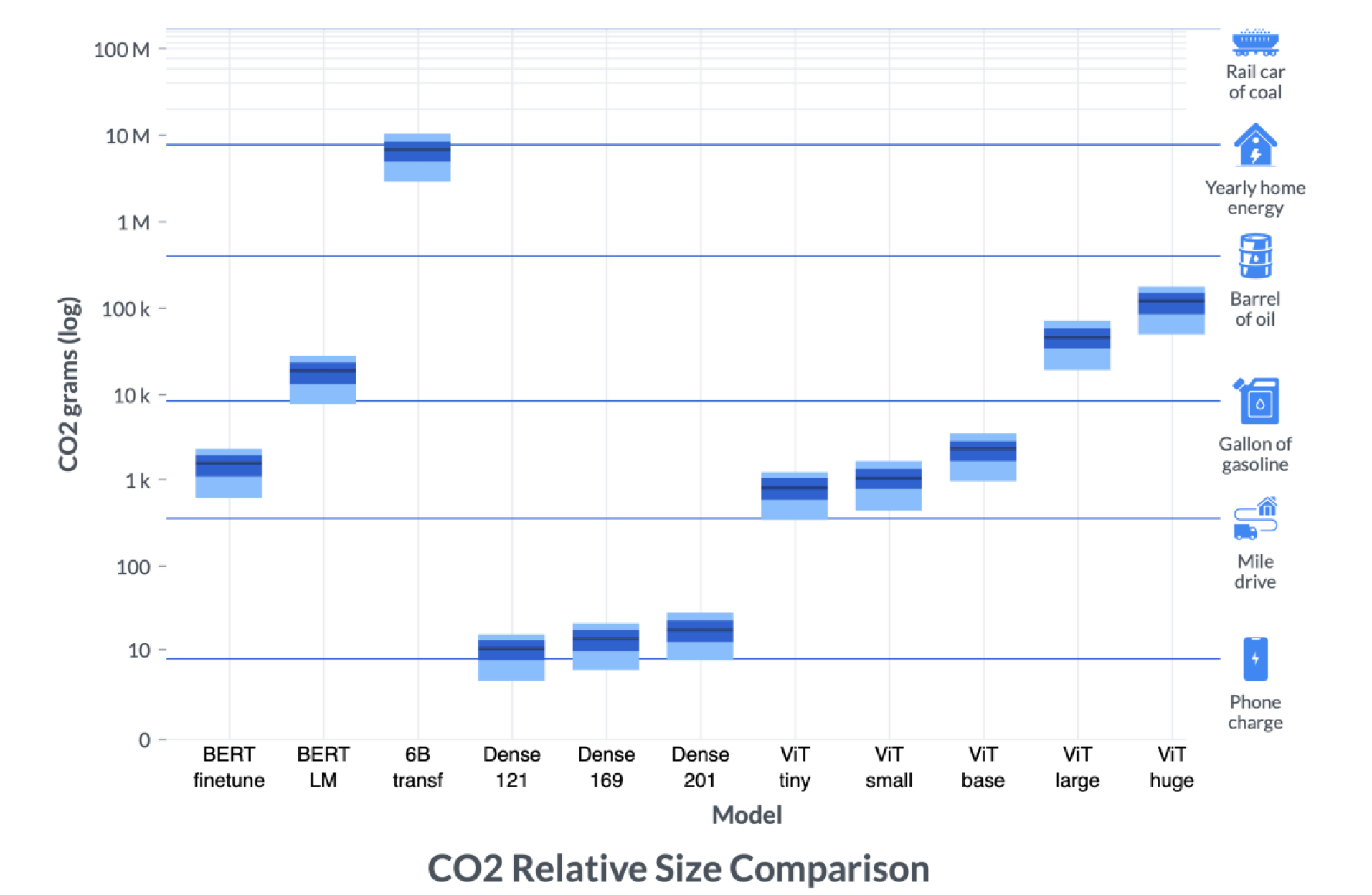

大型语言模型(LLMs)通过在自然语言理解、生成和推理方面提供先进能力,改变了众多领域。尽管它们在研究、医疗保健和创意媒体等行业具有突破性应用,但其快速普及也引发了对可持续性的严重担忧。本综述全面考察了与LLM相关的环境、经济和计算挑战,重点关注数据中心的能源消耗、碳排放和资源利用。通过综合现有文献的见解,本文探讨了资源高效训练、可持续部署实践和生命周期评估等策略,以减轻LLM对环境的影响。重点领域包括能源优化、可再生能源整合以及性能与可持续性之间的平衡。研究结果旨在指导研究人员、从业者和政策制定者制定可持续人工智能系统的可行策略,从而为人工智能创造一个负责任且具有环保意识的未来。

🔬 方法详解

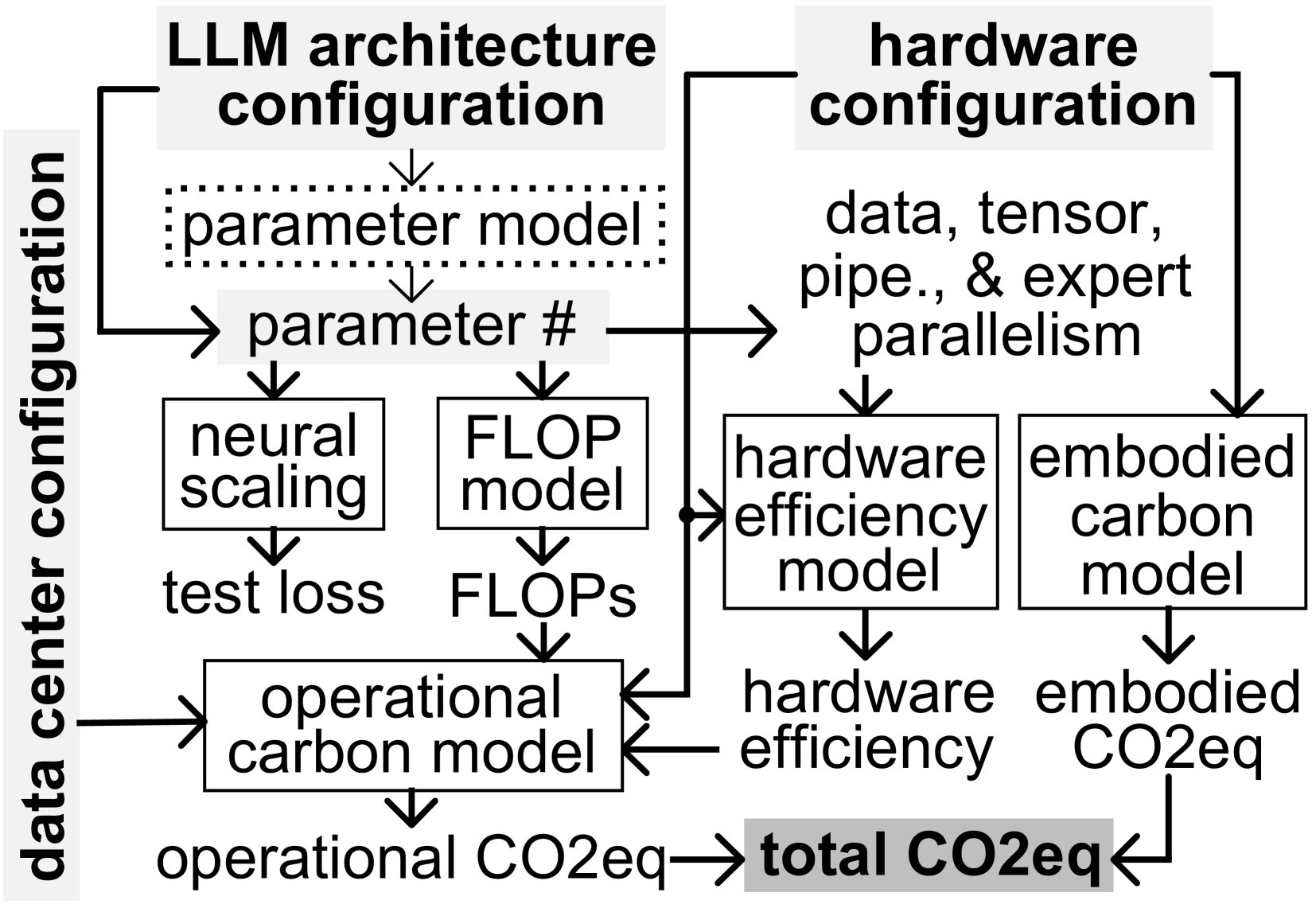

问题定义:大型语言模型(LLMs)的快速发展和广泛应用带来了显著的环境影响,主要体现在能源消耗、碳排放和资源利用等方面。现有方法在训练和部署LLM时,往往忽视了可持续性,导致数据中心能源需求激增,碳足迹不断扩大。因此,如何降低LLM的能耗,提高资源利用率,实现可持续发展,是当前面临的重要挑战。

核心思路:本综述的核心思路是通过系统性地分析LLM在环境、经济和计算方面面临的挑战,并总结现有文献中提出的各种解决方案和策略,为研究人员、从业者和政策制定者提供一个全面的参考框架。通过关注资源高效训练、可持续部署实践和生命周期评估等关键领域,旨在推动LLM朝着更加可持续的方向发展。

技术框架:该综述论文的技术框架主要包括以下几个方面:1) 概述LLM的应用领域和发展趋势;2) 分析LLM在环境、经济和计算方面面临的挑战,包括能源消耗、碳排放、硬件需求和数据存储等;3) 总结现有文献中提出的各种解决方案和策略,例如资源高效训练方法(如模型压缩、知识蒸馏)、可持续部署实践(如使用可再生能源、优化数据中心能效)和生命周期评估方法;4) 探讨未来研究方向和潜在的改进空间,例如开发更加节能的模型架构、探索新的训练算法和优化部署策略。

关键创新:本综述的关键创新在于其全面性和系统性。它不仅涵盖了LLM在环境、经济和计算方面面临的各种挑战,还总结了现有文献中提出的各种解决方案和策略,并对未来研究方向进行了展望。此外,该综述还强调了可持续性在LLM发展中的重要性,旨在引起研究人员、从业者和政策制定者对这一问题的重视。

关键设计:由于这是一篇综述文章,因此没有涉及具体的参数设置、损失函数或网络结构等技术细节。然而,该综述强调了以下几个关键设计原则:1) 资源高效训练:通过模型压缩、知识蒸馏等技术,降低模型训练的计算成本和能源消耗;2) 可持续部署:通过使用可再生能源、优化数据中心能效等措施,降低模型部署的环境影响;3) 生命周期评估:对LLM的整个生命周期进行评估,包括训练、部署和维护,以识别潜在的环境风险和改进空间。

🖼️ 关键图片

📊 实验亮点

该综述全面考察了LLM在环境、经济和计算方面的挑战,并总结了现有文献中提出的各种解决方案和策略。虽然没有提供具体的性能数据,但它强调了资源高效训练、可持续部署实践和生命周期评估的重要性,为未来的研究和实践提供了有价值的指导。

🎯 应用场景

该研究成果可应用于指导LLM的开发和部署,促进人工智能的可持续发展。具体而言,可以帮助企业和研究机构选择更节能的模型架构、优化训练算法和部署策略,从而降低能源消耗和碳排放。此外,该研究还可以为政府制定相关政策提供参考,推动人工智能行业朝着更加环保和可持续的方向发展。

📄 摘要(原文)

Large Language Models (LLMs) have transformed numerous domains by providing advanced capabilities in natural language understanding, generation, and reasoning. Despite their groundbreaking applications across industries such as research, healthcare, and creative media, their rapid adoption raises critical concerns regarding sustainability. This survey paper comprehensively examines the environmental, economic, and computational challenges associated with LLMs, focusing on energy consumption, carbon emissions, and resource utilization in data centers. By synthesizing insights from existing literature, this work explores strategies such as resource-efficient training, sustainable deployment practices, and lifecycle assessments to mitigate the environmental impacts of LLMs. Key areas of emphasis include energy optimization, renewable energy integration, and balancing performance with sustainability. The findings aim to guide researchers, practitioners, and policymakers in developing actionable strategies for sustainable AI systems, fostering a responsible and environmentally conscious future for artificial intelligence.