SocialMind: LLM-based Proactive AR Social Assistive System with Human-like Perception for In-situ Live Interactions

作者: Bufang Yang, Yunqi Guo, Lilin Xu, Zhenyu Yan, Hongkai Chen, Guoliang Xing, Xiaofan Jiang

分类: cs.AI

发布日期: 2024-12-05

💡 一句话要点

SocialMind:基于LLM的主动AR社交辅助系统,用于实时交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 社交辅助系统 增强现实 大型语言模型 多模态感知 人机交互

📋 核心要点

- 现有社交辅助系统主要提供被动服务,缺乏在实时对话中主动提供帮助的能力,影响用户体验。

- SocialMind利用多模态感知提取社交线索,结合LLM推理生成社交建议,并通过AR眼镜实时呈现。

- 实验结果表明,SocialMind显著提高了用户参与度,并获得了用户的高度认可,证明了其有效性。

📝 摘要(中文)

社交互动是人类生活的基础。基于大型语言模型(LLM)的虚拟助手已经展示了其彻底改变人际互动和生活方式的潜力。然而,现有的辅助系统主要为个体用户提供被动式服务,而不是在与对话伙伴的实时社交互动中提供现场帮助。本研究介绍了SocialMind,这是第一个基于LLM的主动AR社交辅助系统,为用户提供现场社交辅助。SocialMind采用类似人类的感知,利用多模态传感器提取口头和非口头线索、社会因素和隐含的角色,并将这些社会线索纳入LLM推理中,以生成社交建议。此外,SocialMind采用多层协作生成策略和主动更新机制,在增强现实(AR)眼镜上显示社交建议,确保及时向用户提供建议,而不会中断自然的对话流程。在三个公共数据集上的评估以及包含20名参与者的用户研究表明,与基线相比,SocialMind的参与度提高了38.3%,并且95%的参与者愿意在他们的实时社交互动中使用SocialMind。

🔬 方法详解

问题定义:现有社交辅助系统主要提供被动式服务,即用户需要主动提出请求才能获得帮助。在实时社交互动中,用户可能难以意识到自己需要帮助,或者不愿中断对话来寻求帮助。因此,如何主动、及时地为用户提供社交辅助,同时又不干扰自然的对话流程,是一个重要的挑战。

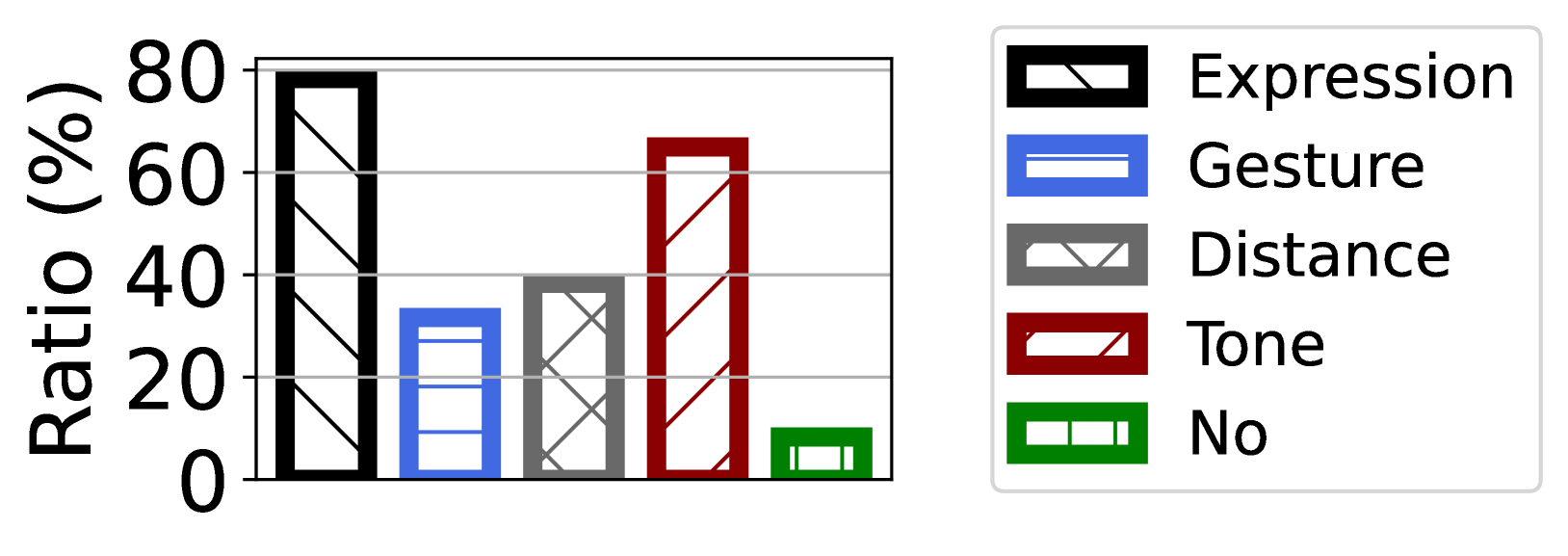

核心思路:SocialMind的核心思路是利用多模态感知模拟人类的社交感知能力,提取对话中的各种线索(包括语言、表情、姿势等),并结合大型语言模型(LLM)进行推理,从而预测用户可能需要的社交辅助。然后,通过增强现实(AR)眼镜将这些建议以不显眼的方式呈现给用户。

技术框架:SocialMind系统主要包含以下几个模块:1) 多模态感知模块:利用摄像头、麦克风等传感器,提取用户的语音、面部表情、肢体动作等信息。2) 社交线索提取模块:从多模态数据中提取关键的社交线索,例如情感、意图、关系等。3) LLM推理模块:利用LLM对提取的社交线索进行推理,生成社交建议。4) AR显示模块:将生成的社交建议以文本、图像等形式显示在AR眼镜上。5) 多层协作生成与主动更新机制:确保建议的及时性和相关性,避免打断对话。

关键创新:SocialMind的关键创新在于其主动性。与传统的被动式辅助系统不同,SocialMind能够主动感知用户的社交环境,并预测用户可能需要的帮助。此外,SocialMind还采用了多模态感知和LLM推理相结合的方法,能够更全面、准确地理解用户的社交状态。

关键设计:SocialMind采用多层协作生成策略,包括粗粒度建议生成和细粒度建议优化,以提高建议的质量和相关性。同时,系统采用主动更新机制,根据对话的进展动态调整建议,确保建议的及时性。具体参数设置和网络结构等细节在论文中未详细描述,属于未知信息。

🖼️ 关键图片

📊 实验亮点

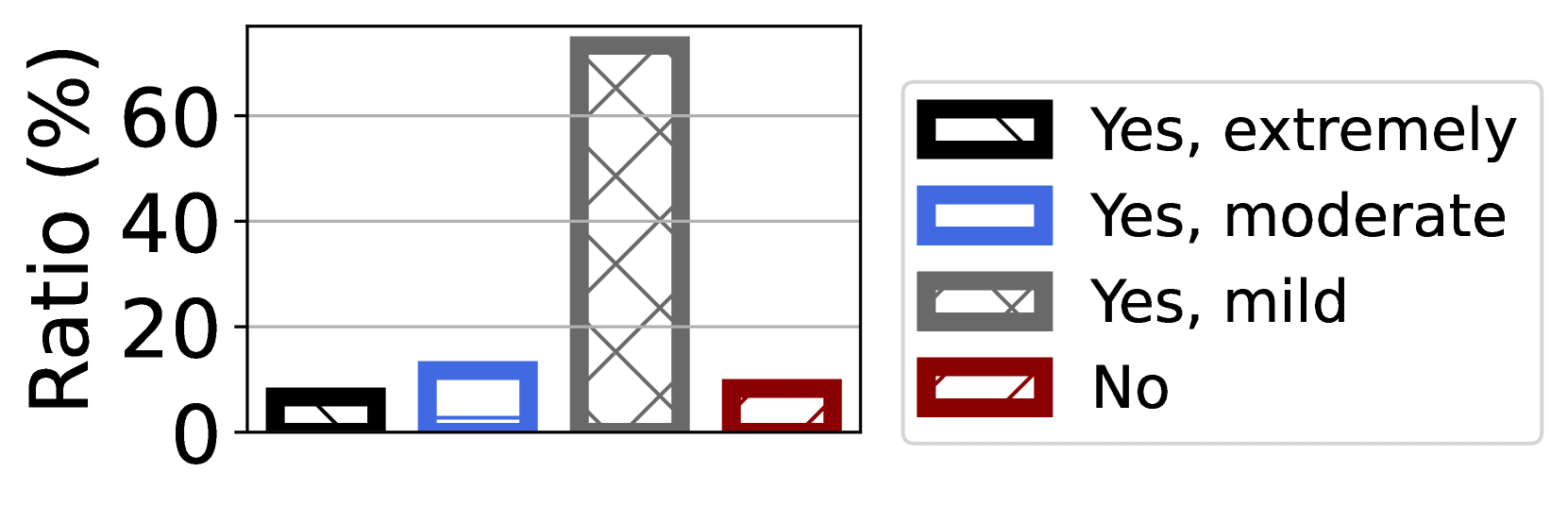

实验结果表明,SocialMind在用户参与度方面比基线提高了38.3%。用户研究表明,95%的参与者愿意在他们的实时社交互动中使用SocialMind。这些结果表明,SocialMind能够有效地提高用户的社交参与度和满意度,具有很高的实用价值。

🎯 应用场景

SocialMind具有广泛的应用前景,例如可以帮助社交障碍人士更好地参与社交活动,提升沟通能力;可以为商务人士提供实时的谈判建议,提高谈判效率;还可以应用于教育领域,帮助学生更好地理解课堂内容,提高学习效果。未来,SocialMind有望成为一种普及的社交辅助工具,提升人们的社交体验。

📄 摘要(原文)

Social interactions are fundamental to human life. The recent emergence of large language models (LLMs)-based virtual assistants has demonstrated their potential to revolutionize human interactions and lifestyles. However, existing assistive systems mainly provide reactive services to individual users, rather than offering in-situ assistance during live social interactions with conversational partners. In this study, we introduce SocialMind, the first LLM-based proactive AR social assistive system that provides users with in-situ social assistance. SocialMind employs human-like perception leveraging multi-modal sensors to extract both verbal and nonverbal cues, social factors, and implicit personas, incorporating these social cues into LLM reasoning for social suggestion generation. Additionally, SocialMind employs a multi-tier collaborative generation strategy and proactive update mechanism to display social suggestions on Augmented Reality (AR) glasses, ensuring that suggestions are timely provided to users without disrupting the natural flow of conversation. Evaluations on three public datasets and a user study with 20 participants show that SocialMind achieves 38.3% higher engagement compared to baselines, and 95% of participants are willing to use SocialMind in their live social interactions.