A Neurosymbolic Fast and Slow Architecture for Graph Coloring

作者: Vedant Khandelwal, Vishal Pallagani, Biplav Srivastava, Francesca Rossi

分类: cs.AI, cs.CL

发布日期: 2024-12-02 (更新: 2025-09-29)

备注: 31 Pages, 18 Figures, 3 Tables

💡 一句话要点

提出基于神经符号的快速与慢速架构SOFAI_v2,用于加速图着色问题求解。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 神经符号计算 约束满足问题 图着色 大型语言模型 元认知 混合架构 快速与慢速思维

📋 核心要点

- 现有符号求解器在解决约束满足问题(CSPs)时速度较慢,而大型语言模型(LLMs)由于问题复杂性难以单独胜任。

- SOFAI_v2架构结合了基于LLM的快速系统1和审慎的系统2,并通过元认知模块进行协调,以实现快速且准确的求解。

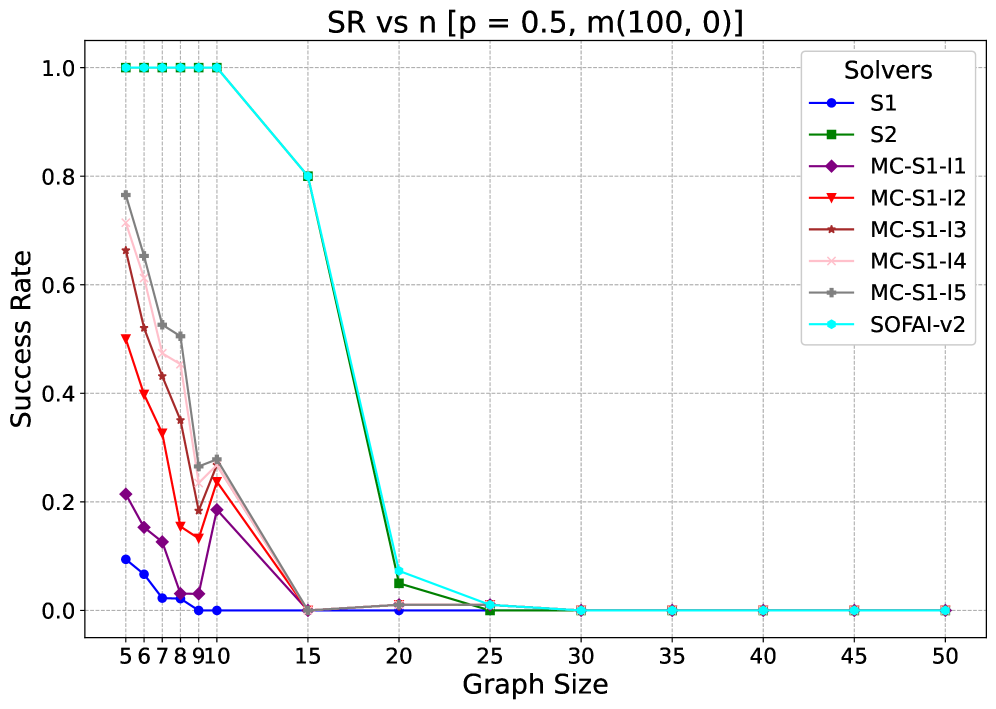

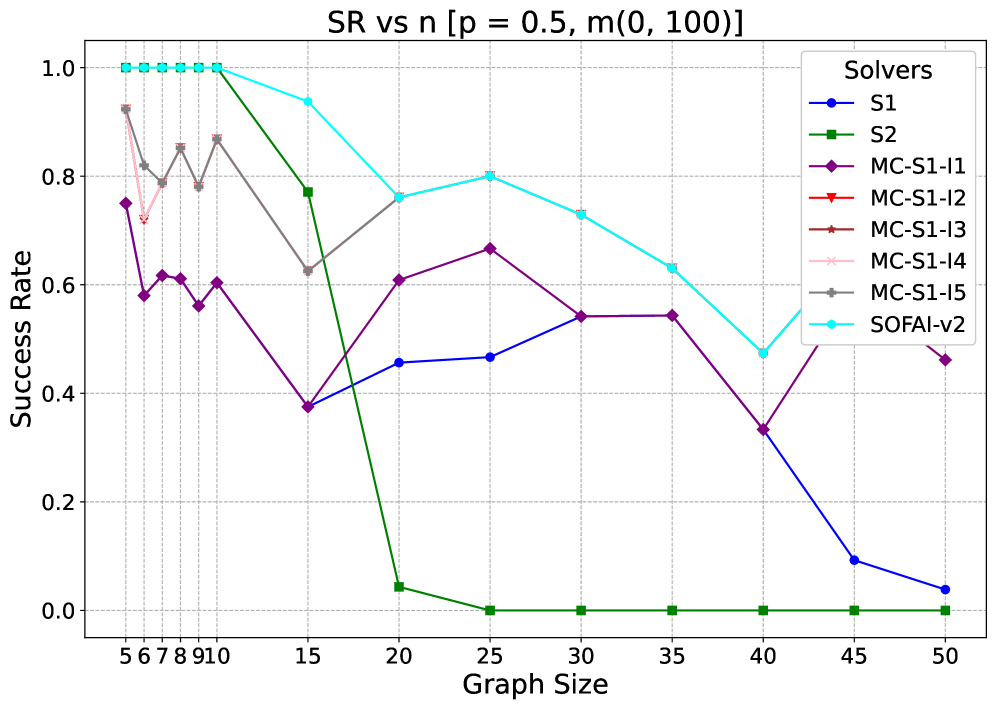

- 实验表明,SOFAI_v2在图着色问题上比传统符号求解器提高了成功率和速度,验证了该架构的有效性。

📝 摘要(中文)

本文针对约束满足问题(CSPs)的挑战,提出了一种增强的神经符号架构SOFAI_v2。该架构基于Daniel Kahneman的“快与慢”认知模型,并改进了元认知治理机制,以提高在复杂领域(特别是图着色问题)中的适应性。SOFAI_v2结合了利用大型语言模型(LLMs)的快速系统1(S1)和一个由元认知模块管理的审慎系统2(S2)。S1的初始解决方案通过元认知提供的反馈和示例进行改进,使其更符合CSP的要求。如果S1无法解决问题,元认知会策略性地调用S2,以确保准确可靠的解决方案。实验结果表明,SOFAI_v2在解决图着色问题时,成功率比传统符号求解器高10.5%,速度快30%。

🔬 方法详解

问题定义:论文旨在解决图着色问题,这是一个典型的约束满足问题。现有的符号求解器虽然能够保证解的正确性,但速度较慢,难以处理大规模问题。而直接使用大型语言模型(LLMs)进行求解,虽然速度快,但难以满足约束条件,解的质量不高。

核心思路:论文的核心思路是借鉴人类的“快与慢”认知模型,构建一个混合的神经符号架构。利用LLM的快速推理能力快速生成候选解,然后通过元认知模块评估解的质量,并根据需要调用符号求解器进行修正或重新求解。这种方式可以在保证解的正确性的前提下,提高求解速度。

技术框架:SOFAI_v2架构包含三个主要模块:系统1(S1)、系统2(S2)和元认知模块。S1是一个基于LLM的快速求解器,负责快速生成初始解。S2是一个传统的符号求解器,负责提供准确但较慢的解。元认知模块负责监控S1的性能,并根据需要调用S2。如果S1生成的解满足约束条件,则直接输出;否则,元认知模块会根据S1的错误类型,提供反馈和示例,引导S1生成更好的解。如果S1经过多次尝试仍然无法生成满足约束条件的解,则元认知模块会调用S2进行求解。

关键创新:SOFAI_v2的关键创新在于其元认知治理机制。该机制能够根据S1的性能动态调整求解策略,从而在速度和准确性之间取得平衡。此外,元认知模块还能够根据S1的错误类型,提供针对性的反馈和示例,从而提高S1的学习效率。

关键设计:论文中没有详细描述具体的参数设置、损失函数或网络结构等技术细节。但是,元认知模块的设计是关键。元认知模块需要能够准确评估S1的性能,并根据需要调用S2。此外,元认知模块还需要能够根据S1的错误类型,提供有效的反馈和示例。这些都需要仔细设计和调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,SOFAI_v2在解决图着色问题时,成功率比传统符号求解器高10.5%,并且速度提升高达30%。这表明SOFAI_v2架构能够有效地结合LLM的快速推理能力和符号求解器的准确性,从而在速度和准确性之间取得更好的平衡。这些结果验证了该架构的有效性和实用性。

🎯 应用场景

该研究成果可应用于各种需要解决约束满足问题的领域,例如资源调度、任务分配、电路设计、软件验证等。通过结合LLM的快速推理能力和符号求解器的准确性,可以更高效地解决实际问题,提高生产效率,降低成本。未来,该架构可以进一步扩展到其他类型的约束满足问题,并与其他AI技术相结合,以实现更强大的问题求解能力。

📄 摘要(原文)

Constraint Satisfaction Problems (CSPs) present significant challenges to artificial intelligence due to their intricate constraints and the necessity for precise solutions. Existing symbolic solvers are often slow, and prior research has shown that Large Language Models (LLMs) alone struggle with CSPs because of their complexity. To bridge this gap, we build upon the existing SOFAI architecture (SOFAI_v1), which adapts Daniel Kahneman's ''Thinking, Fast and Slow'' cognitive model to AI. Our enhanced architecture, SOFAI_v2, integrates refined metacognitive governance mechanisms to improve adaptability across complex domains, specifically tailored here for solving the graph coloring problem, a specific type of CSP. SOFAI_v2 combines a fast System 1 (S1), leveraging LLMs, with a deliberative System 2 (S2), governed by a metacognition module. S1's initial solutions, often limited by constraint adherence issues, are improved through targeted feedback and examples from metacognition, aligning S1 more closely with CSP requirements. If S1 fails to resolve the problem, metacognition strategically invokes S2, ensuring accurate and reliable solutions. Our empirical results demonstrate that SOFAI_v2 achieves a 10.5% higher success rate and is up to 30% faster than a traditional symbolic solver in solving graph coloring problems.