Benchmark Real-time Adaptation and Communication Capabilities of Embodied Agent in Collaborative Scenarios

作者: Shipeng Liu, Boshen Zhang, Zhehui Huang

分类: cs.AI, cs.HC, cs.RO

发布日期: 2024-11-30

备注: 16 pages, 8 figures

💡 一句话要点

提出MonTA框架,提升具身智能体在协同场景中的实时适应与沟通能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 具身智能体 人机协作 实时适应 大型语言模型 协同环境

📋 核心要点

- 现有具身智能体基准测试缺乏对智能体在协同环境中实时适应人类行为和有效沟通能力的评估。

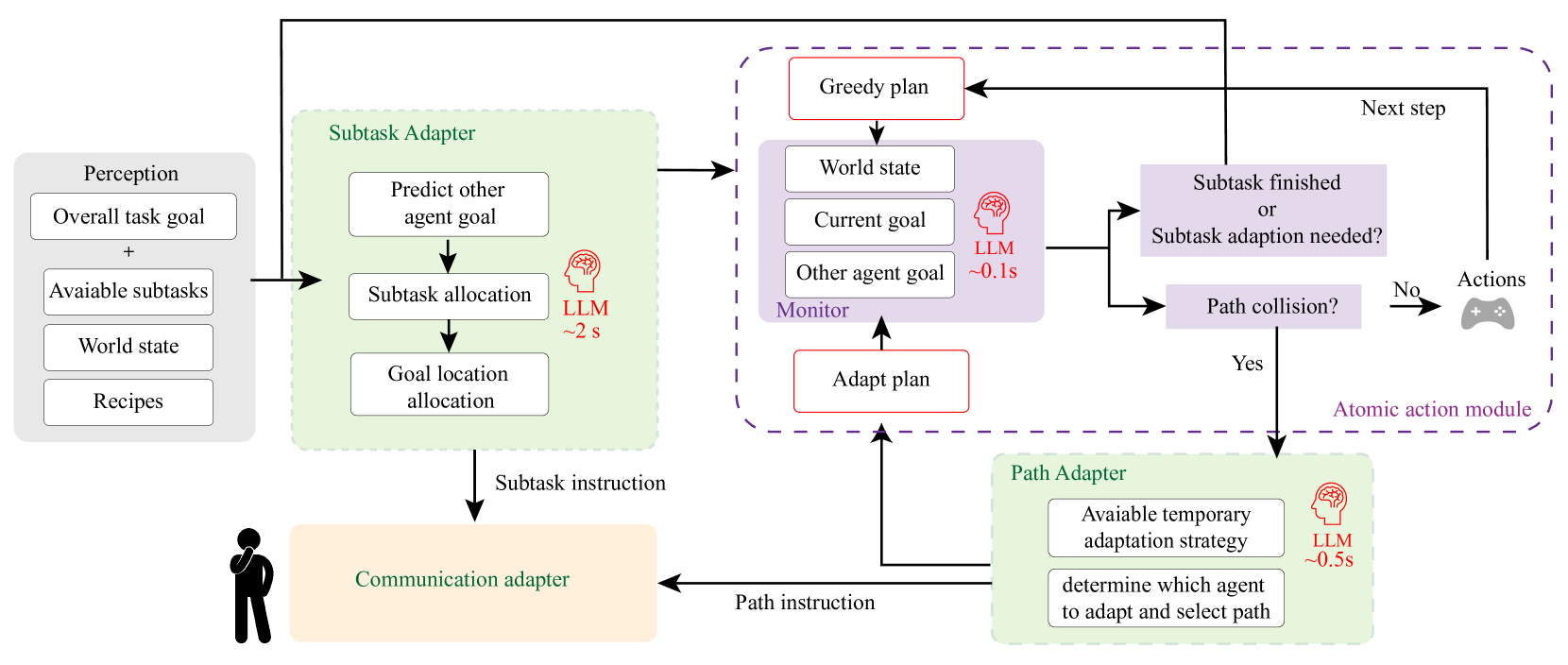

- 论文提出Monitor-then-Adapt (MonTA)框架,通过监控和适应机制,提升智能体在协同任务中的适应性和沟通能力。

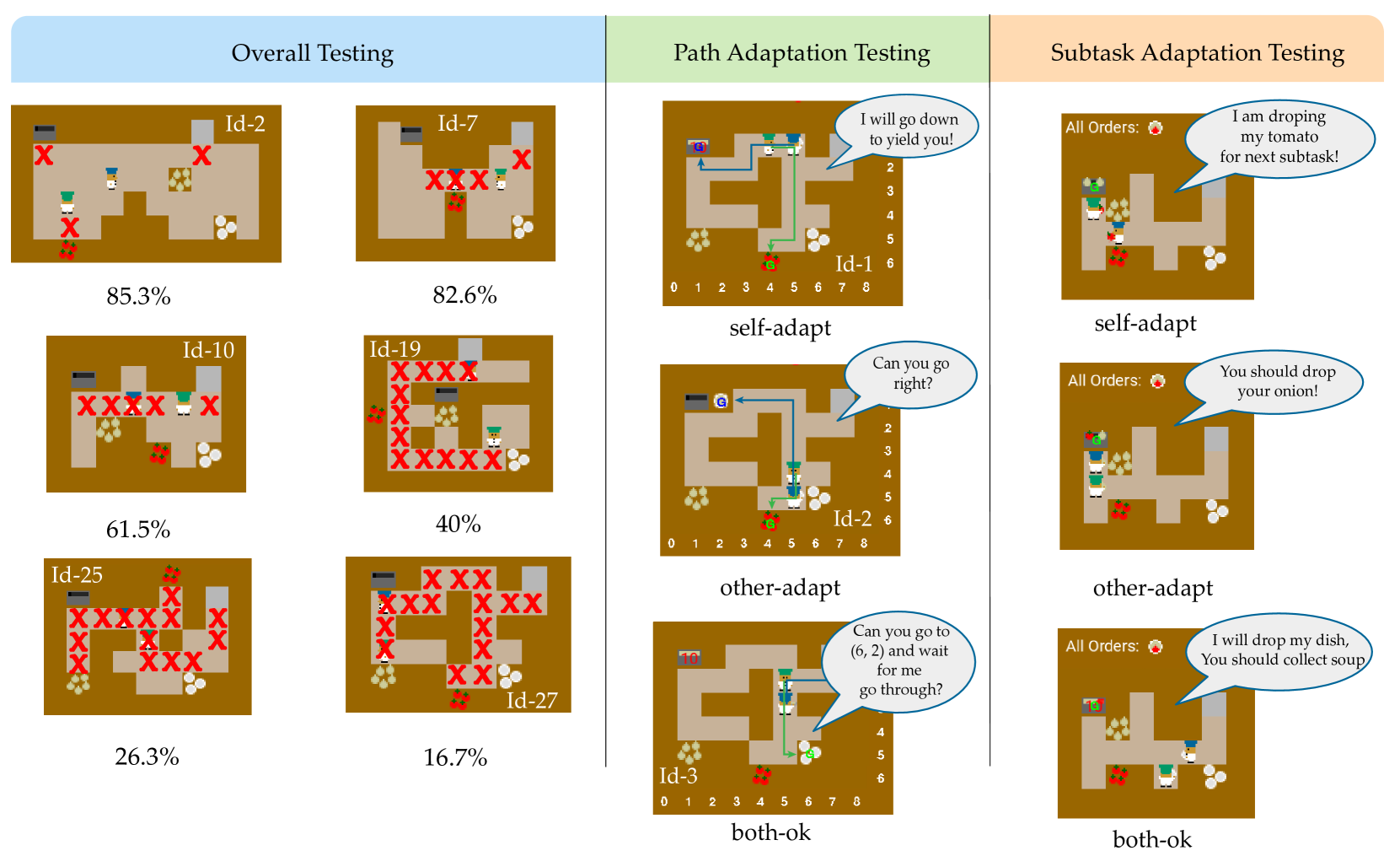

- 实验结果表明,MonTA在提出的基准测试中优于其他基线智能体,用户研究也验证了其适应计划和语言指令的合理性。

📝 摘要(中文)

大型语言模型(LLMs)的进步为人机交互开辟了变革性的可能性,尤其是在协作环境中。然而,实时人机协作要求智能体能够适应未见过的人类行为,同时保持有效的动态沟通。现有的基准测试在评估具身智能体的这种适应性方面存在不足,主要侧重于智能体自身的任务表现。为了解决这一差距,我们提出了一个新的基准,用于评估智能体每一步的反应适应性和即时沟通能力。基于此基准,我们提出了一个Monitor-then-Adapt框架(MonTA),将强大的适应性和沟通能力与实时执行相结合。MonTA包含三个关键的LLM模块:一个轻量级的 extit{Monitor},用于高频监控适应需求;以及两个精通的 extit{Adapters},用于低频的子任务和路径适应推理。我们的结果表明,MonTA在我们提出的基准上优于其他基线智能体。进一步的用户研究证实了我们的框架提供了高度合理的适应计划和一致的语言指令。

🔬 方法详解

问题定义:现有具身智能体在协同环境中,难以实时适应人类行为的变化,并且缺乏有效的沟通机制。现有基准测试主要关注智能体自身的任务完成情况,忽略了智能体与人类协同过程中的适应性和沟通能力。这导致智能体在实际应用中难以与人类进行流畅自然的协作。

核心思路:论文的核心思路是设计一个能够实时监控环境变化并进行适应性调整的框架。该框架通过轻量级的监控模块快速检测适应需求,并利用两个适配器模块进行子任务和路径的适应性推理。这种“监控-适应”的模式使得智能体能够根据人类行为的变化,动态调整自身行为,从而实现更有效的协同。

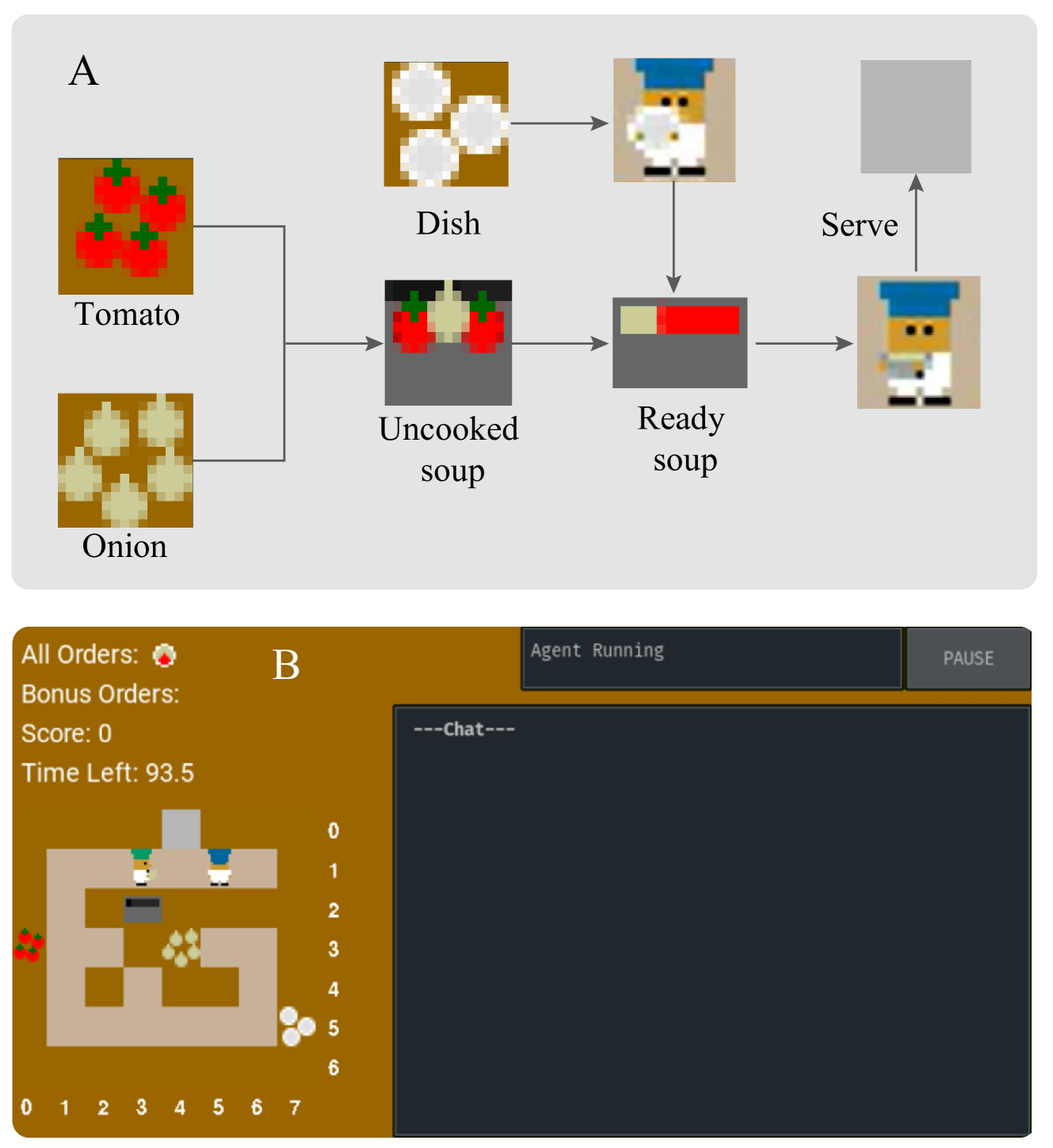

技术框架:MonTA框架包含三个主要模块:Monitor、Subtask Adapter和Path Adapter。Monitor模块是一个轻量级的LLM,负责高频监控环境变化,判断是否需要进行适应性调整。Subtask Adapter负责在需要调整时,重新规划子任务序列。Path Adapter负责在需要调整时,重新规划路径。整个框架以“监控-适应”的循环方式运行,确保智能体能够实时响应人类行为的变化。

关键创新:MonTA的关键创新在于其“监控-适应”的框架设计,以及轻量级监控模块的应用。传统的具身智能体通常采用预先规划好的行为序列,难以适应环境变化。MonTA通过实时监控环境变化,并根据变化动态调整行为,从而实现了更强的适应性。轻量级监控模块的设计,保证了框架的实时性。

关键设计:Monitor模块采用轻量级的LLM,以降低计算复杂度,保证实时性。Subtask Adapter和Path Adapter采用更强大的LLM,以进行更复杂的推理和规划。框架采用低频的子任务和路径适应推理,避免频繁调整带来的不稳定。具体的参数设置和网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

MonTA框架在提出的基准测试中优于其他基线智能体,证明了其在实时适应和沟通方面的优势。用户研究表明,MonTA能够生成合理的适应计划和一致的语言指令,进一步验证了其有效性。具体的性能数据和提升幅度在摘要中未给出,属于未知信息。

🎯 应用场景

该研究成果可应用于各种人机协作场景,例如:智能家居、辅助机器人、工业机器人等。通过提升智能体的适应性和沟通能力,可以实现更自然、高效的人机协作,提高工作效率和用户体验。未来,该技术有望应用于更复杂的协作任务,例如:医疗手术、灾难救援等。

📄 摘要(原文)

Advancements in Large Language Models (LLMs) have opened transformative possibilities for human-robot interaction, especially in collaborative environments. However, Real-time human-AI collaboration requires agents to adapt to unseen human behaviors while maintaining effective communication dynamically. Existing benchmarks fall short in evaluating such adaptability for embodied agents, focusing mostly on the task performance of the agent itself. To address this gap, we propose a novel benchmark that assesses agents' reactive adaptability and instantaneous communication capabilities at every step. Based on this benchmark, we propose a Monitor-then-Adapt framework (MonTA), combining strong adaptability and communication with real-time execution. MonTA contains three key LLM modules, a lightweight \textit{Monitor} for monitoring the need for adaptation in high frequency, and two proficient \textit{Adapters} for subtask and path adaptation reasoning in low frequency. Our results demonstrate that MonTA outperforms other baseline agents on our proposed benchmark. Further user studies confirm the high reasonability adaptation plan and consistent language instruction provided by our framework.