DroidCall: A Dataset for LLM-powered Android Intent Invocation

作者: Weikai Xie, Li Zhang, Shihe Wang, Rongjie Yi, Mengwei Xu

分类: cs.AI

发布日期: 2024-11-30

🔗 代码/项目: GITHUB

💡 一句话要点

DroidCall:用于LLM驱动的Android Intent调用的数据集

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Android Intent调用 大型语言模型 端侧AI 数据隐私 数据集 小型语言模型 微调 自然语言理解

📋 核心要点

- 现有Agentic系统依赖大型语言模型,但数据隐私是挑战,需要端侧解决方案。

- DroidCall数据集通过灵活的数据生成流程,为小型语言模型提供训练数据,实现精确的Android Intent调用。

- 实验表明,使用DroidCall微调的小型语言模型性能接近甚至超越GPT-4o。

📝 摘要(中文)

大型语言模型在自然语言理解方面的能力不断增强,极大地提升了现有智能代理系统的性能。为了支持高性能的端侧移动代理,并更好地保护数据隐私,我们推出了DroidCall,这是首个用于精确Android Intent调用的训练和测试数据集。通过高度灵活且可复用的数据生成流程,我们在DroidCall中构建了1万个样本。给定自然语言的任务指令,使用DroidCall微调的小型语言模型(如Qwen2.5-3B和Gemma2-2B)可以接近甚至超越GPT-4o在精确Android Intent调用方面的能力。我们还提供了一个配备这些微调模型的端到端Android应用程序,以演示Android Intent调用过程。代码和数据集可在https://github.com/UbiquitousLearning/DroidCall获取。

🔬 方法详解

问题定义:论文旨在解决在移动设备上精确调用Android Intent的问题。现有方法要么依赖于云端的大型语言模型,存在数据隐私风险,要么在端侧使用效果不佳。因此,需要一个专门用于训练小型语言模型,使其能够在本地设备上准确理解自然语言指令并调用相应的Android Intent的数据集。

核心思路:论文的核心思路是构建一个高质量、多样化的Android Intent调用数据集DroidCall,并利用该数据集对小型语言模型进行微调,使其能够在端侧实现高性能的Intent调用。通过数据驱动的方式,提升小型模型在特定任务上的能力。

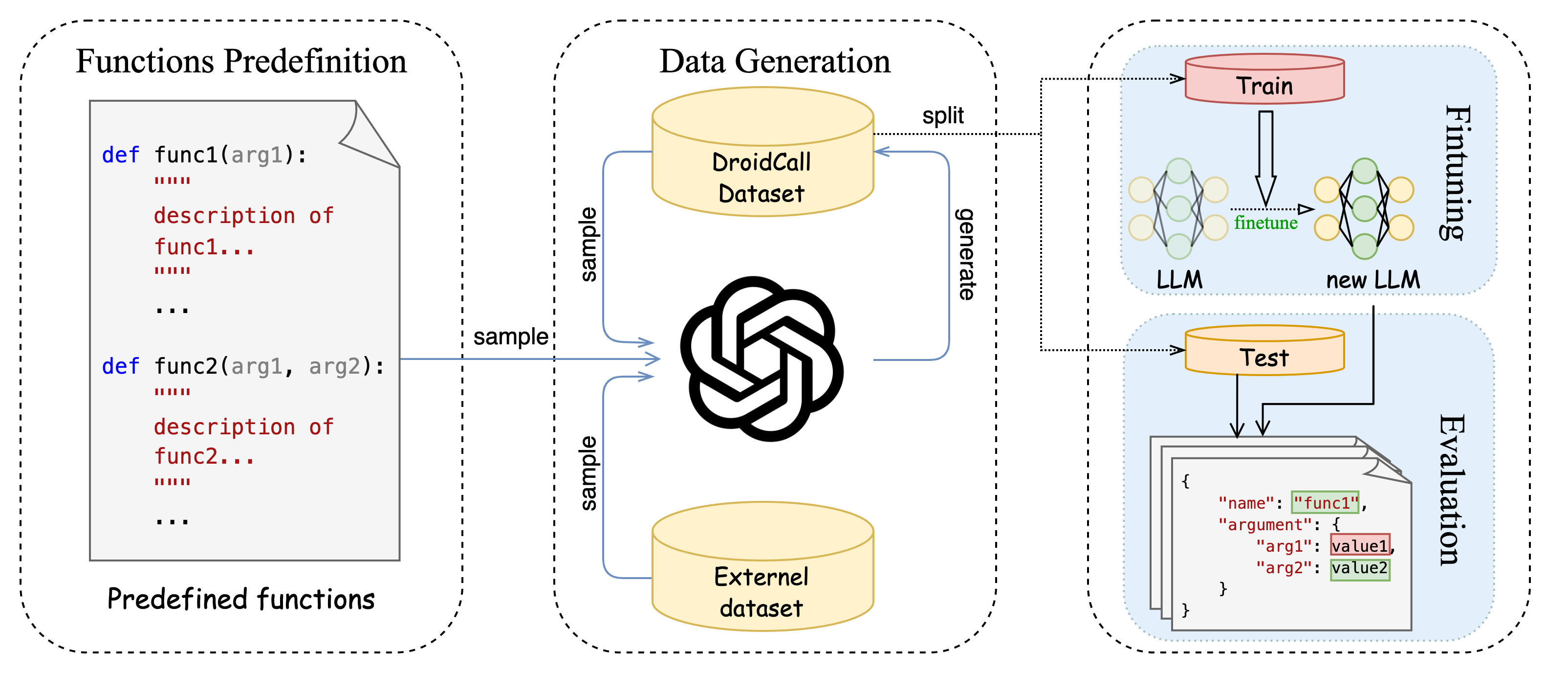

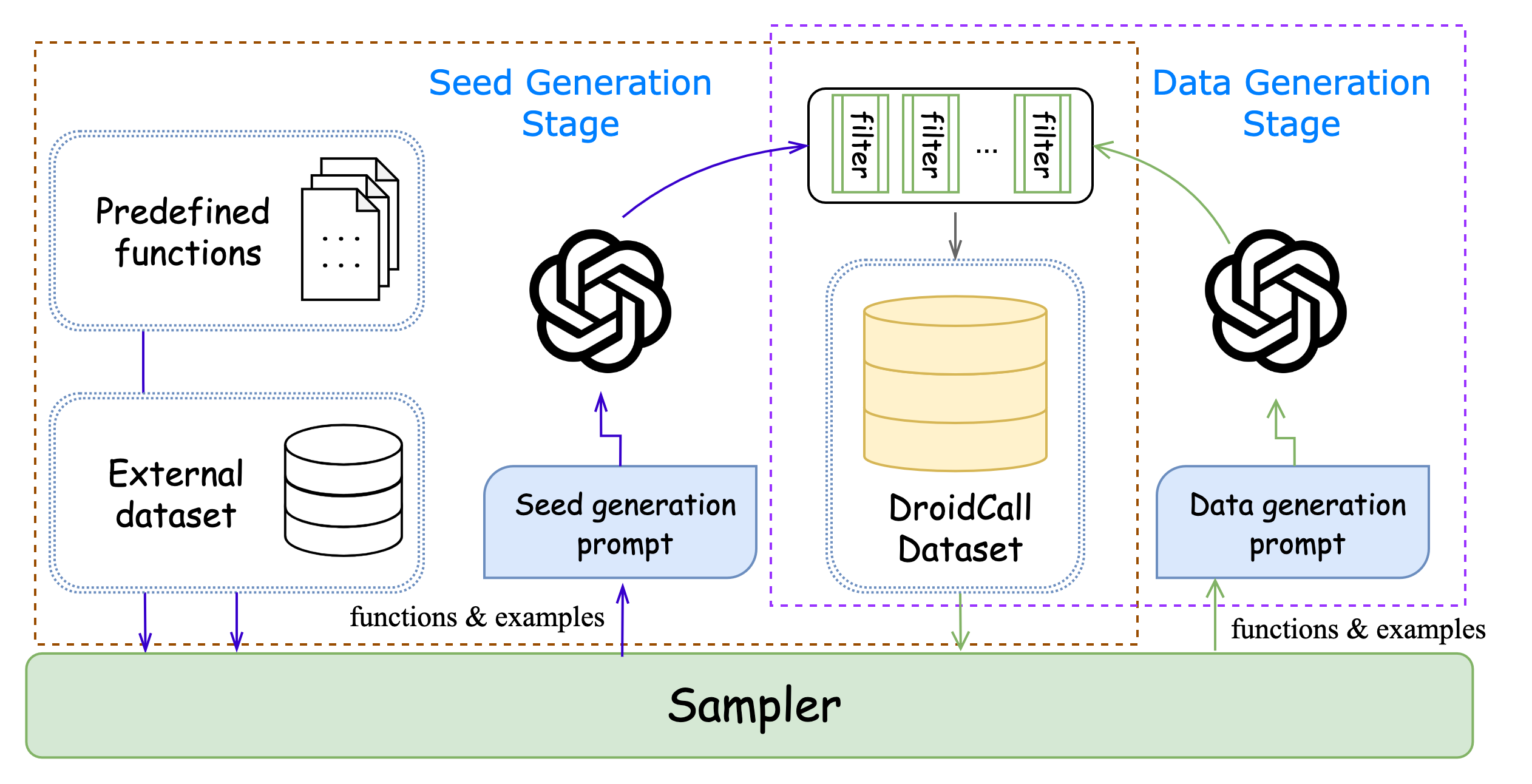

技术框架:DroidCall的整体框架包含两个主要部分:数据生成流水线和模型微调与评估。数据生成流水线负责生成包含自然语言指令和对应Android Intent信息的样本。模型微调与评估部分则使用生成的数据集对小型语言模型进行微调,并评估其在Android Intent调用任务上的性能。同时提供一个Android应用进行演示。

关键创新:该论文的关键创新在于构建了一个高度灵活且可复用的数据生成流水线,能够生成大规模的Android Intent调用数据集。该数据集专门针对小型语言模型的训练进行了优化,使得小型模型能够在端侧达到甚至超越大型模型的性能。

关键设计:数据生成流水线的设计允许用户自定义Intent的类型、参数和约束条件,从而生成多样化的样本。论文中使用了Qwen2.5-3B和Gemma2-2B等小型语言模型进行微调,并采用了标准的微调技术。具体的损失函数和网络结构细节可能需要参考论文的补充材料或代码。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用DroidCall数据集微调的Qwen2.5-3B和Gemma2-2B等小型语言模型在Android Intent调用任务上的性能接近甚至超越了GPT-4o。这表明通过高质量的数据集和微调技术,小型语言模型可以在特定任务上达到与大型模型相媲美的性能。

🎯 应用场景

DroidCall数据集和微调模型可应用于各种需要本地Android Intent调用的场景,例如智能助手、自动化任务执行、无障碍辅助等。该研究有助于推动端侧AI的发展,保护用户数据隐私,并为移动应用开发者提供更强大的工具。

📄 摘要(原文)

The growing capabilities of large language models in natural language understanding significantly strengthen existing agentic systems. To power performant on-device mobile agents for better data privacy, we introduce DroidCall, the first training and testing dataset for accurate Android intent invocation. With a highly flexible and reusable data generation pipeline, we constructed 10k samples in DroidCall. Given a task instruction in natural language, small language models such as Qwen2.5-3B and Gemma2-2B fine-tuned with DroidCall can approach or even surpass the capabilities of GPT-4o for accurate Android intent invocation. We also provide an end-to-end Android app equipped with these fine-tuned models to demonstrate the Android intent invocation process. The code and dataset are available at https://github.com/UbiquitousLearning/DroidCall.