Streamlining the review process: AI-generated annotations in research manuscripts

作者: Oscar Díaz, Xabier Garmendia, Juanan Pereira

分类: cs.AI

发布日期: 2024-11-29

💡 一句话要点

提出AnnotateGPT平台,利用LLM辅助学术论文评审,提升评审效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 学术论文评审 人机协作 GPT-4 手稿注释

📋 核心要点

- 当前学术论文评审面临巨大工作量挑战,传统评审效率难以满足日益增长的论文数量。

- 提出AnnotateGPT平台,利用GPT-4辅助评审员进行手稿注释,提升理解和专注力,实现人机协作。

- 通过技术接受模型(TAM)问卷评估,验证AnnotateGPT在评审流程中AI-人协作的可行性。

📝 摘要(中文)

研究论文提交数量的不断增加给传统的学术同行评审系统带来了巨大的挑战,导致评审人员的工作量过大。本研究探讨了将大型语言模型(LLM)集成到同行评审流程中以提高效率而不影响效果的潜力。我们专注于手稿注释,特别是摘录高亮显示,作为AI-人协作的潜在领域。虽然LLM在某些任务(如方面覆盖和信息量)方面表现出色,但它们通常缺乏高层次的分析和批判性思维,因此不适合完全取代人工评审员。我们的方法包括使用LLM来协助评审过程的特定方面。本文介绍了一个利用GPT-4进行手稿评审的平台AnnotateGPT,旨在提高评审员的理解和专注力。我们使用包含九名参与者的技术接受模型(TAM)问卷评估AnnotateGPT,并将结果推广。我们的工作强调了注释作为学术评审中AI-人协作的可行中间地带,为将LLM集成到评审流程中以及调整传统注释工具以纳入LLM提供了见解。

🔬 方法详解

问题定义:当前学术论文评审系统面临着论文数量激增的挑战,评审人员工作负担过重。传统评审方法效率低下,难以保证评审质量。现有方法缺乏有效的工具来辅助评审员快速理解和分析论文内容。

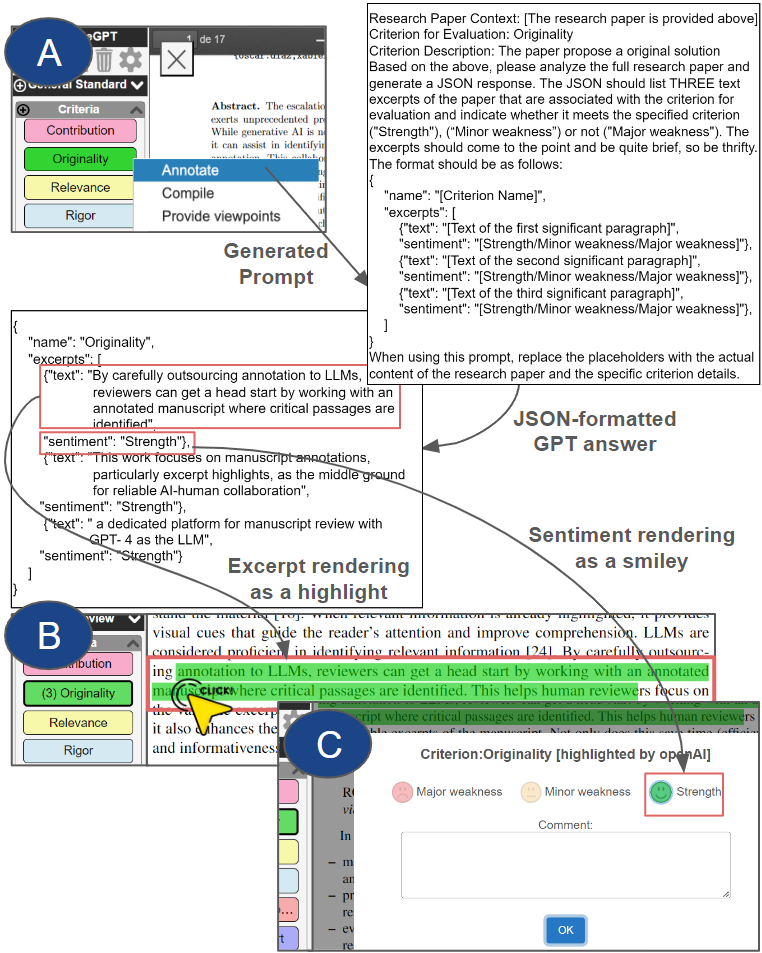

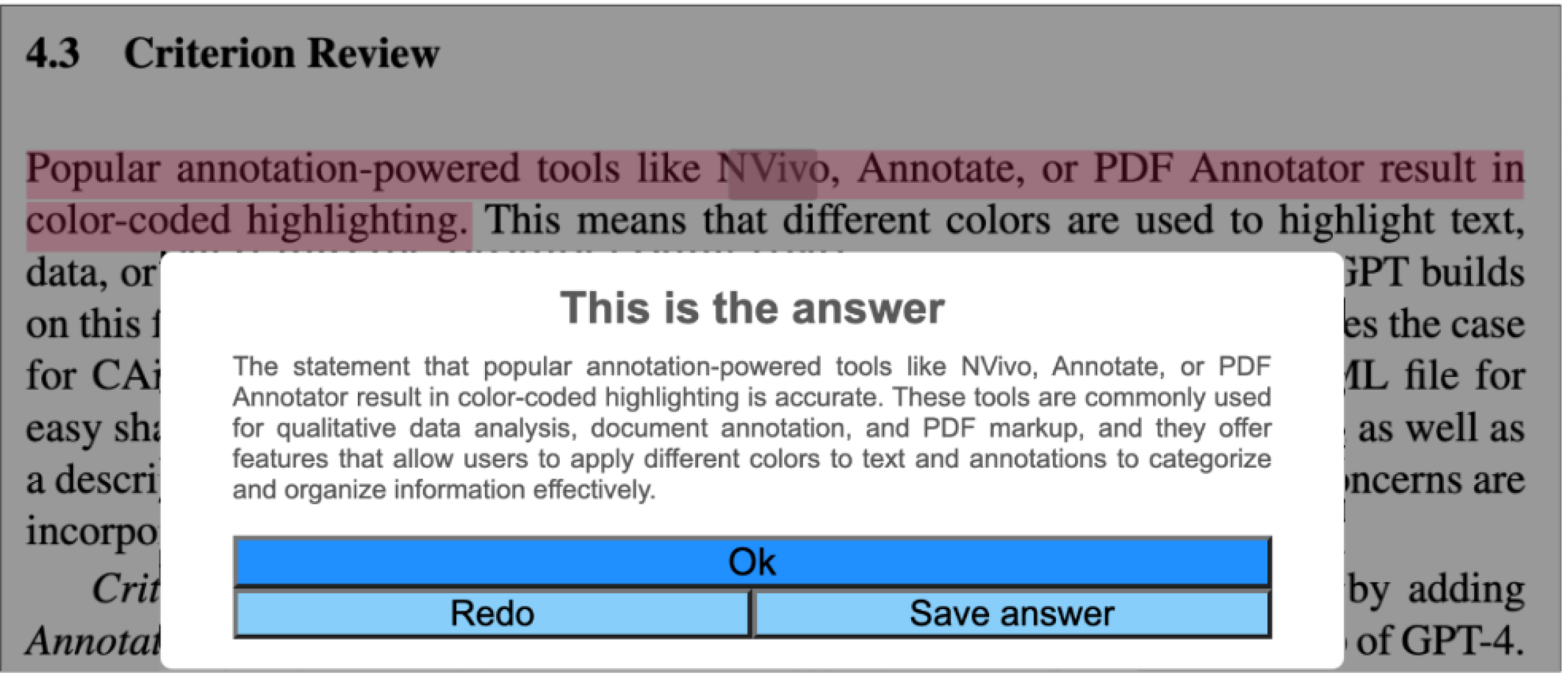

核心思路:利用大型语言模型(LLM)在自然语言处理方面的优势,辅助评审员进行手稿注释,特别是高亮显示关键信息。通过LLM的辅助,评审员可以更快地抓住论文的要点,从而提高评审效率和质量。核心在于找到LLM在评审流程中可以发挥作用的中间地带,避免完全依赖LLM,而是将其作为辅助工具。

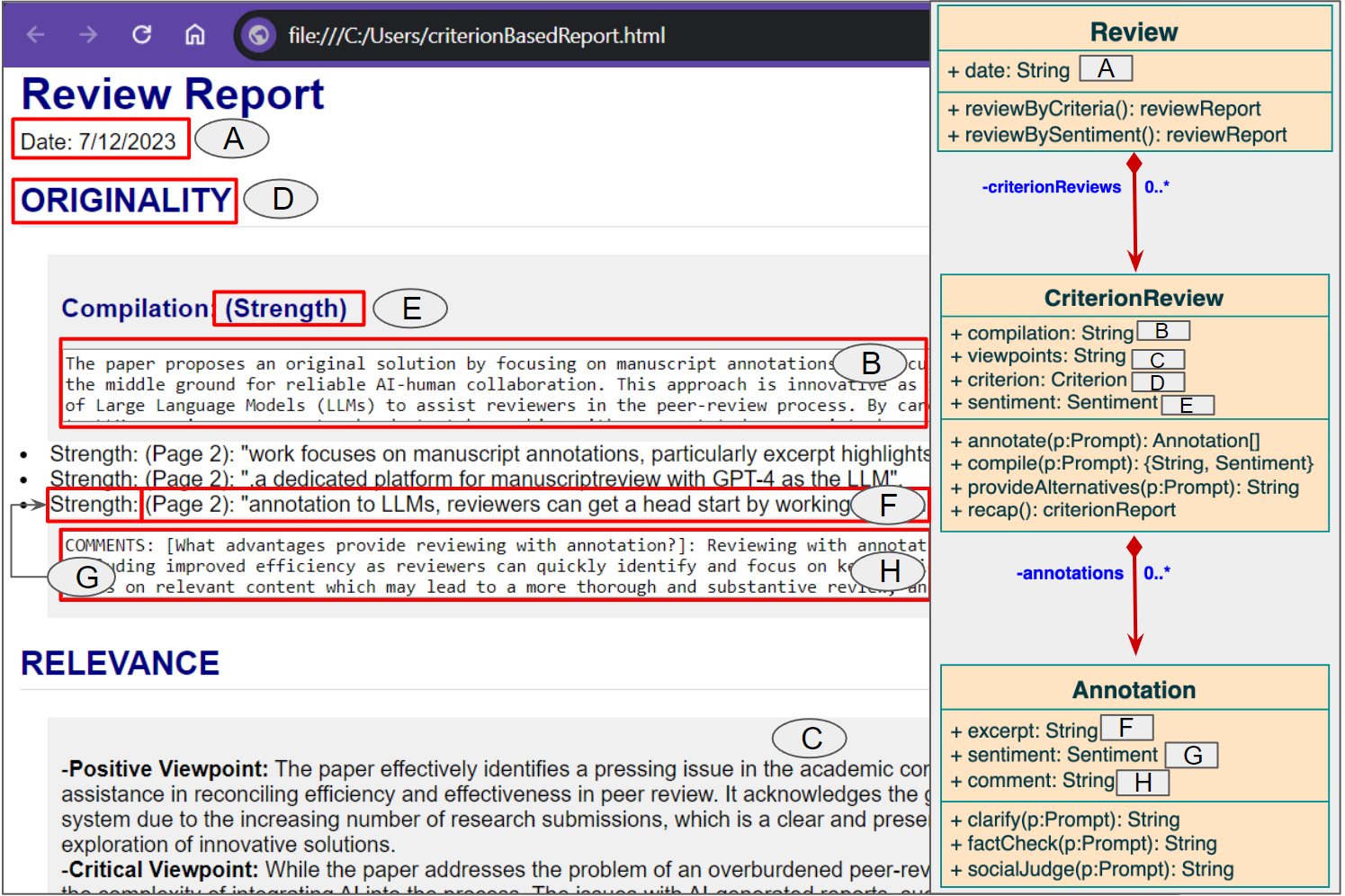

技术框架:AnnotateGPT平台是该研究的核心技术框架。该平台利用GPT-4模型进行手稿评审,主要流程包括:1) 上传待评审的手稿;2) GPT-4模型自动对文本进行分析和注释,例如高亮显示关键段落、总结要点等;3) 评审员查看带有注释的手稿,进行进一步的分析和判断;4) 评审员完成评审报告。

关键创新:该研究的关键创新在于将LLM应用于学术论文评审的特定环节——手稿注释。与完全依赖LLM进行评审不同,该方法强调人机协作,充分发挥LLM在信息提取和总结方面的优势,同时保留人工评审员的批判性思维和高层次分析能力。这种人机协作的模式可以有效提高评审效率和质量。

关键设计:AnnotateGPT平台的关键设计包括:1) 使用GPT-4模型,确保注释的准确性和信息量;2) 提供用户友好的界面,方便评审员上传和查看手稿;3) 可定制的注释选项,允许评审员根据需要选择不同的注释类型;4) 技术接受模型(TAM)问卷,用于评估评审员对AnnotateGPT的接受程度和使用体验。

🖼️ 关键图片

📊 实验亮点

该研究通过技术接受模型(TAM)问卷调查,评估了AnnotateGPT平台的用户接受度。结果表明,参与者普遍认为AnnotateGPT能够提高评审效率和理解能力。虽然文中没有给出具体的性能数据,但用户反馈表明,该平台在辅助评审方面具有潜力,为LLM在学术评审中的应用提供了有益的探索。

🎯 应用场景

该研究成果可应用于学术出版领域,帮助期刊编辑部和评审人员提高论文评审效率,缩短评审周期。此外,该方法也可推广到其他需要大量文本阅读和分析的领域,如法律文件审查、市场调研报告分析等,具有广泛的应用前景和实际价值。未来,可以进一步探索LLM在评审流程中的更多应用,例如自动生成评审报告草稿等。

📄 摘要(原文)

The increasing volume of research paper submissions poses a significant challenge to the traditional academic peer-review system, leading to an overwhelming workload for reviewers. This study explores the potential of integrating Large Language Models (LLMs) into the peer-review process to enhance efficiency without compromising effectiveness. We focus on manuscript annotations, particularly excerpt highlights, as a potential area for AI-human collaboration. While LLMs excel in certain tasks like aspect coverage and informativeness, they often lack high-level analysis and critical thinking, making them unsuitable for replacing human reviewers entirely. Our approach involves using LLMs to assist with specific aspects of the review process. This paper introduces AnnotateGPT, a platform that utilizes GPT-4 for manuscript review, aiming to improve reviewers' comprehension and focus. We evaluate AnnotateGPT using a Technology Acceptance Model (TAM) questionnaire with nine participants and generalize the findings. Our work highlights annotation as a viable middle ground for AI-human collaboration in academic review, offering insights into integrating LLMs into the review process and tuning traditional annotation tools for LLM incorporation.