Human Evaluation of Procedural Knowledge Graph Extraction from Text with Large Language Models

作者: Valentina Anita Carriero, Antonia Azzini, Ilaria Baroni, Mario Scrocca, Irene Celino

分类: cs.AI, cs.CL, cs.HC

发布日期: 2024-11-27

DOI: 10.1007/978-3-031-77792-9_26

💡 一句话要点

利用大型语言模型从文本中抽取程序性知识图谱并进行人工评估

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 程序性知识图谱 大型语言模型 提示工程 知识抽取 用户研究

📋 核心要点

- 程序性知识通常以自然语言文本描述,人工理解和执行成本高,将其转化为知识图谱具有重要意义。

- 论文提出一种基于提示工程的方法,利用LLM从文本程序中提取关键信息,构建程序性知识图谱。

- 通过用户研究评估了LLM提取的知识图谱的质量和实用性,验证了LLM在程序性知识提取方面的潜力。

📝 摘要(中文)

本文利用大型语言模型(LLM)的能力,提出了一种提示工程方法,从文本程序中提取步骤、动作、对象、设备和时间信息,从而根据预定义的本体填充程序性知识图谱(KG)。程序性知识以执行某些任务所需的步骤序列形式表达。这些程序通常通过自然语言文本描述,例如食谱或维护手册,可能分布在不同的文档和系统中,其解释和后续执行通常留给读者。将这些程序表示在知识图谱中,可以作为构建数字工具的基础,以支持那些需要应用或执行它们的用户。我们通过用户研究评估了KG提取结果,从而定性和定量地评估了LLM提取的程序性知识的感知质量和有用性。结果表明,LLM可以产生质量可接受的输出,并且我们评估了人类评估者对AI的主观感知。

🔬 方法详解

问题定义:论文旨在解决从自然语言文本中自动提取程序性知识,并构建程序性知识图谱的问题。现有方法通常依赖于人工标注或基于规则的方法,效率低且泛化能力差。LLM虽然具备一定的理解能力,但直接应用效果往往不佳,需要针对性优化。

核心思路:论文的核心思路是利用提示工程,通过精心设计的提示词引导LLM从文本中提取程序性知识的关键要素,包括步骤、动作、对象、设备和时间信息。这种方法充分利用了LLM的上下文理解和生成能力,同时通过提示词约束输出格式,提高提取的准确性和一致性。

技术框架:整体流程包括:1) 输入文本程序;2) 使用预定义的本体构建提示词,提示词包含任务描述、实体类型定义等;3) 将提示词输入LLM,LLM生成包含步骤、动作、对象等信息的结构化文本;4) 将LLM的输出解析为知识图谱,其中节点表示实体,边表示关系。

关键创新:论文的关键创新在于将提示工程应用于程序性知识图谱的构建。通过设计合适的提示词,可以有效地引导LLM提取关键信息,避免了传统方法中大量的人工标注和规则编写工作。此外,论文还通过用户研究对提取的知识图谱进行了评估,验证了方法的有效性。

关键设计:提示词的设计是关键。提示词需要清晰地定义任务目标、实体类型和输出格式。例如,提示词可以包含以下内容:任务描述(从文本中提取程序性知识),实体类型定义(步骤、动作、对象、设备等),输出格式要求(JSON格式)。此外,论文可能还探索了不同的LLM模型和提示词策略,以优化提取效果。具体的参数设置和损失函数未知。

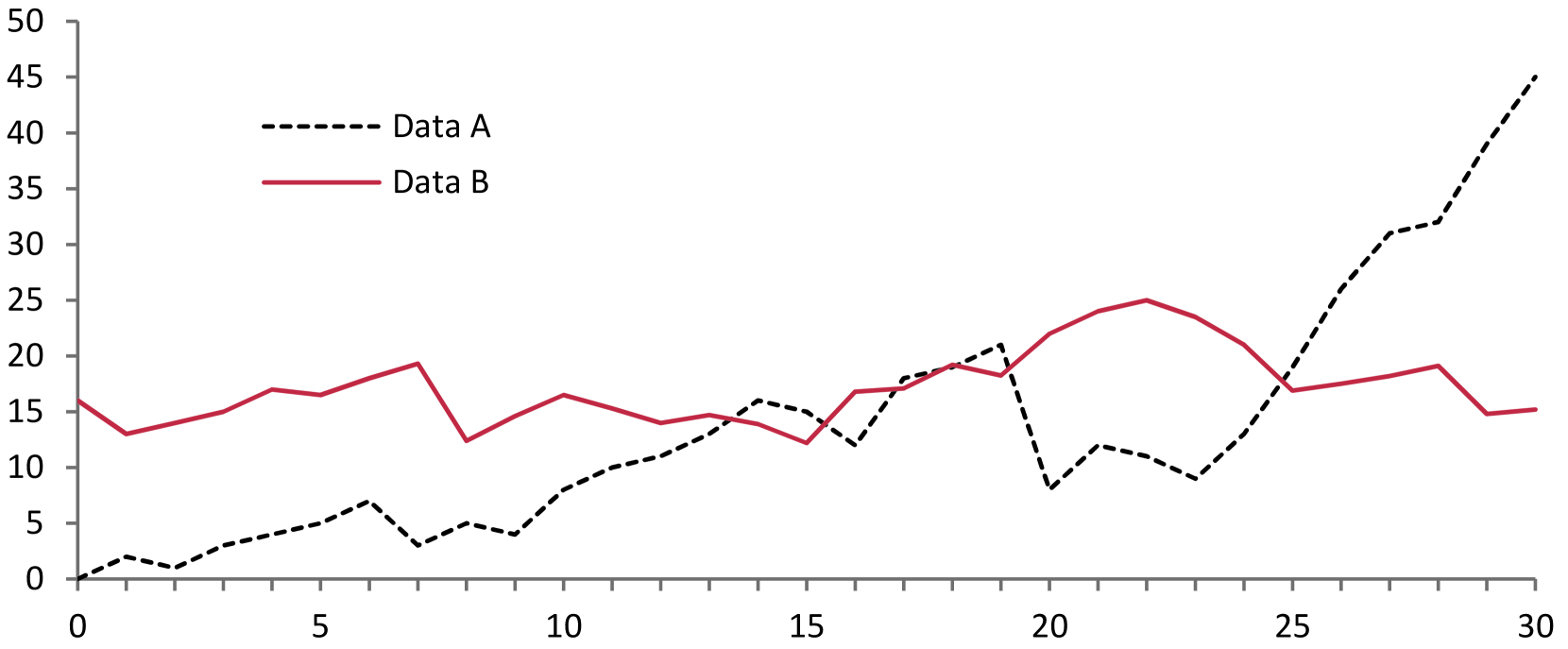

🖼️ 关键图片

📊 实验亮点

论文通过用户研究评估了LLM提取的程序性知识图谱的质量和实用性。结果表明,LLM可以生成质量可接受的输出,并且用户对LLM提取的知识图谱的感知质量较高。具体的性能数据和对比基线未知,但用户研究结果表明该方法具有一定的应用潜力。

🎯 应用场景

该研究成果可应用于多个领域,例如智能助手、自动化流程设计、机器人控制等。通过将程序性知识表示为知识图谱,可以实现对复杂任务的自动化执行和智能辅助,提高工作效率和质量。例如,在工业维护领域,可以利用该技术构建智能维护系统,帮助技术人员快速定位问题并执行维护步骤。

📄 摘要(原文)

Procedural Knowledge is the know-how expressed in the form of sequences of steps needed to perform some tasks. Procedures are usually described by means of natural language texts, such as recipes or maintenance manuals, possibly spread across different documents and systems, and their interpretation and subsequent execution is often left to the reader. Representing such procedures in a Knowledge Graph (KG) can be the basis to build digital tools to support those users who need to apply or execute them. In this paper, we leverage Large Language Model (LLM) capabilities and propose a prompt engineering approach to extract steps, actions, objects, equipment and temporal information from a textual procedure, in order to populate a Procedural KG according to a pre-defined ontology. We evaluate the KG extraction results by means of a user study, in order to qualitatively and quantitatively assess the perceived quality and usefulness of the LLM-extracted procedural knowledge. We show that LLMs can produce outputs of acceptable quality and we assess the subjective perception of AI by human evaluators.