Large Language Model-Brained GUI Agents: A Survey

作者: Chaoyun Zhang, Shilin He, Jiaxu Qian, Bowen Li, Liqun Li, Si Qin, Yu Kang, Minghua Ma, Guyue Liu, Qingwei Lin, Saravan Rajmohan, Dongmei Zhang, Qi Zhang

分类: cs.AI, cs.CL, cs.HC

发布日期: 2024-11-27 (更新: 2025-05-06)

备注: The collection of papers reviewed in this survey will be hosted and regularly updated on the GitHub repository: https://github.com/vyokky/LLM-Brained-GUI-Agents-Survey Additionally, a searchable webpage is available at https://aka.ms/gui-agent for easier access and exploration

💡 一句话要点

LLM驱动的GUI智能体综述:探索人机交互新范式

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI自动化 大型语言模型 人机交互 多模态学习 智能体 自然语言理解 视觉处理

📋 核心要点

- 现有GUI自动化方法难以理解复杂GUI元素和执行多步骤任务,用户交互体验受限。

- 利用LLM的自然语言理解、代码生成和视觉处理能力,构建能够自主执行GUI操作的智能体。

- 综述分析了GUI智能体的框架、数据、动作模型、评估指标和应用,为未来研究提供指导。

📝 摘要(中文)

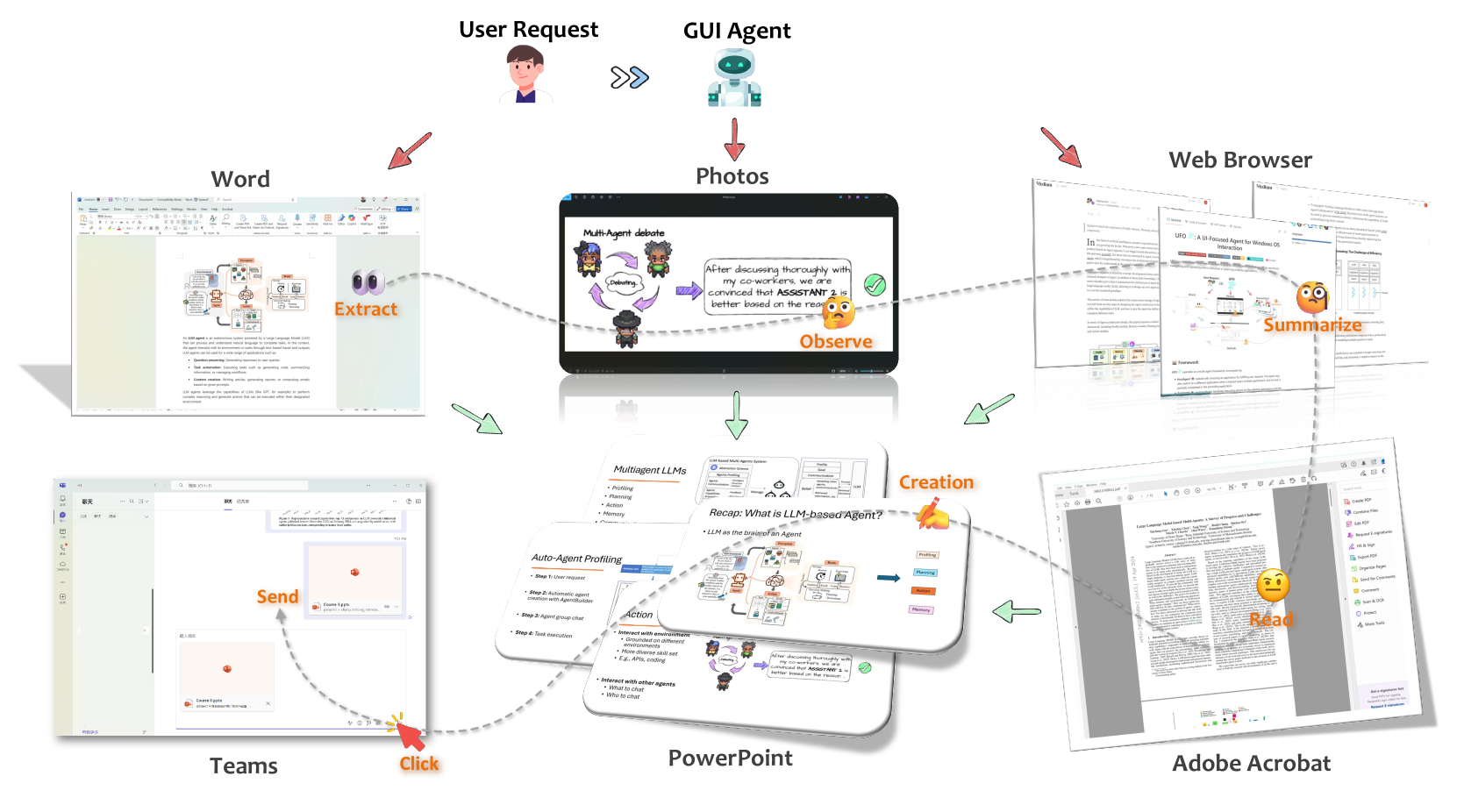

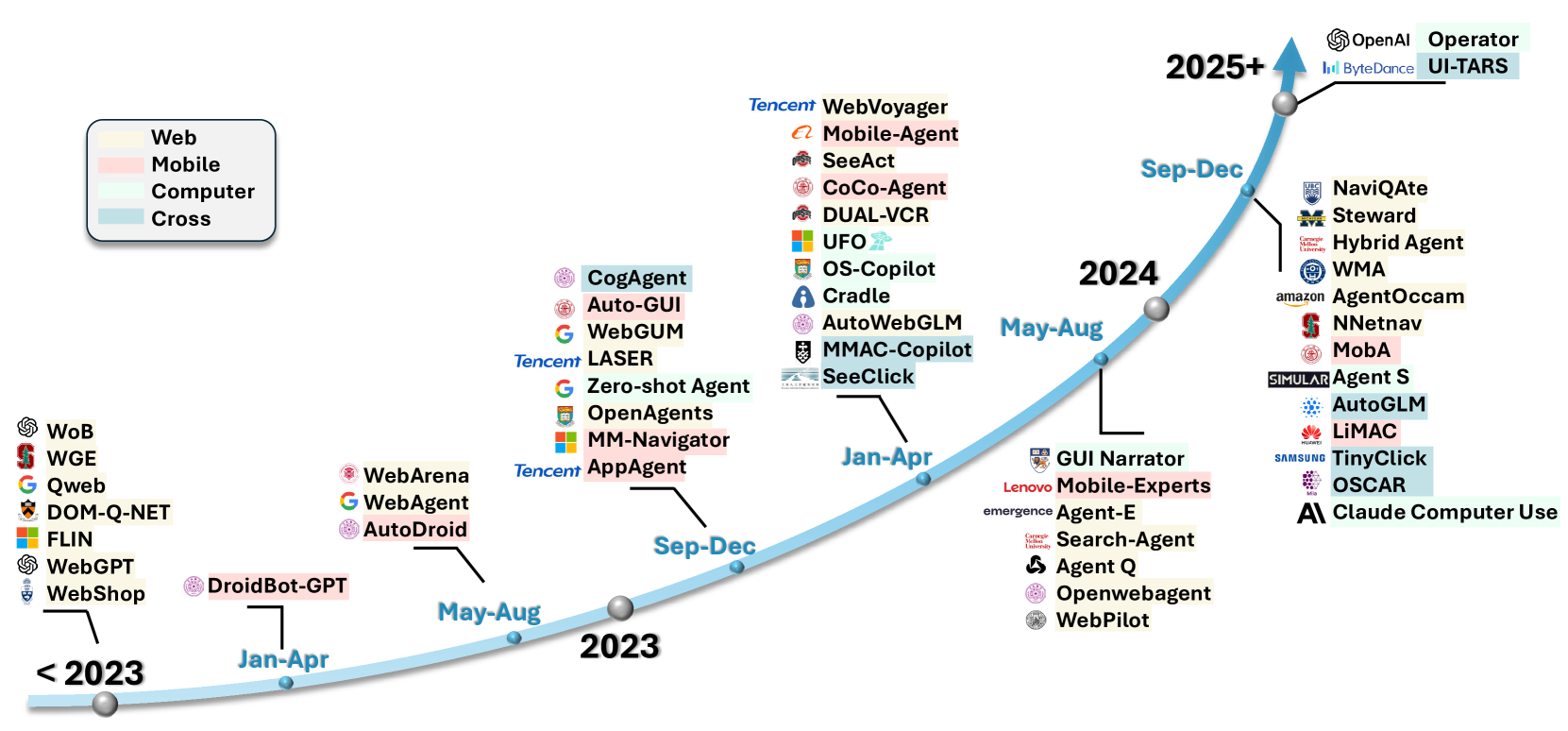

图形用户界面(GUI)一直是人机交互的核心,它提供了一种直观和可视化的方式来访问和交互数字系统。大型语言模型(LLM)的出现,特别是多模态模型,开创了GUI自动化新纪元。它们在自然语言理解、代码生成和视觉处理方面表现出卓越的能力,为新一代LLM驱动的GUI智能体铺平了道路,这些智能体能够解释复杂的GUI元素,并根据自然语言指令自主执行操作。这些智能体代表了一种范式转变,使用户能够通过简单的对话命令执行复杂的多步骤任务。它们的应用涵盖Web导航、移动应用交互和桌面自动化,提供了一种变革性的用户体验,彻底改变了个人与软件交互的方式。这个新兴领域正在迅速发展,在研究和工业领域都取得了显著进展。为了对这一趋势有一个结构化的理解,本文对LLM驱动的GUI智能体进行了全面的综述,探讨了它们的历史演变、核心组件和先进技术。我们解决了诸如现有GUI智能体框架、用于训练专用GUI智能体的数据收集和利用、为GUI任务量身定制的大型动作模型开发以及评估其有效性所需的评估指标和基准等研究问题。此外,我们还研究了由这些智能体驱动的新兴应用。通过详细的分析,本综述确定了关键的研究差距,并概述了该领域未来发展的路线图。通过整合基础知识和最先进的开发成果,这项工作旨在指导研究人员和从业人员克服挑战,并释放LLM驱动的GUI智能体的全部潜力。

🔬 方法详解

问题定义:现有GUI自动化方法在处理复杂GUI界面和执行多步骤任务时存在局限性。用户需要编写复杂的脚本或进行繁琐的手动操作,效率低下且用户体验不佳。此外,现有方法难以理解用户的自然语言指令,无法实现真正的智能化交互。

核心思路:利用大型语言模型(LLM)强大的自然语言理解、代码生成和视觉处理能力,构建能够理解GUI元素、解析用户指令并自主执行GUI操作的智能体。核心在于将LLM作为智能体的“大脑”,赋予其感知、推理和决策能力。

技术框架:LLM驱动的GUI智能体通常包含以下几个主要模块:1) GUI元素感知模块:负责识别和理解GUI界面上的各种元素,如按钮、文本框、下拉菜单等。2) 自然语言理解模块:负责解析用户的自然语言指令,提取用户的意图和目标。3) 动作规划模块:根据用户的意图和GUI元素的信息,规划出一系列需要执行的GUI操作。4) 动作执行模块:负责执行规划好的GUI操作,并监控执行结果。5) 反馈与学习模块:根据执行结果,对智能体的模型进行优化和改进。

关键创新:最重要的技术创新点在于将LLM作为GUI智能体的核心决策引擎,赋予其强大的泛化能力和适应性。与传统的基于规则或脚本的GUI自动化方法相比,LLM驱动的GUI智能体能够更好地理解用户的意图,处理复杂的GUI界面,并自主执行多步骤任务。

关键设计:关键设计包括:1) 如何有效地将GUI元素的信息输入到LLM中,例如使用视觉编码器提取GUI元素的特征向量。2) 如何设计合适的提示(prompt)来引导LLM生成正确的动作序列。3) 如何构建大规模的GUI操作数据集来训练和评估LLM驱动的GUI智能体。4) 如何设计合适的奖励函数来鼓励智能体执行正确的操作。

🖼️ 关键图片

📊 实验亮点

该论文是一篇综述文章,因此没有具体的实验结果。但它总结了当前LLM驱动的GUI智能体领域的研究进展,并指出了未来的研究方向。通过对现有方法的分析和比较,该综述为研究人员和从业人员提供了一个全面的了解,有助于推动该领域的发展。

🎯 应用场景

LLM驱动的GUI智能体具有广泛的应用前景,包括:Web自动化(自动填写表单、预订机票等)、移动应用自动化(自动测试、自动执行重复性任务等)、桌面自动化(自动处理文档、自动发送邮件等)。它们可以显著提高工作效率,降低用户的使用门槛,并为用户提供更加智能和便捷的人机交互体验。未来,随着LLM技术的不断发展,GUI智能体将在更多领域得到应用,例如智能家居、智能客服等。

📄 摘要(原文)

GUIs have long been central to human-computer interaction, providing an intuitive and visually-driven way to access and interact with digital systems. The advent of LLMs, particularly multimodal models, has ushered in a new era of GUI automation. They have demonstrated exceptional capabilities in natural language understanding, code generation, and visual processing. This has paved the way for a new generation of LLM-brained GUI agents capable of interpreting complex GUI elements and autonomously executing actions based on natural language instructions. These agents represent a paradigm shift, enabling users to perform intricate, multi-step tasks through simple conversational commands. Their applications span across web navigation, mobile app interactions, and desktop automation, offering a transformative user experience that revolutionizes how individuals interact with software. This emerging field is rapidly advancing, with significant progress in both research and industry. To provide a structured understanding of this trend, this paper presents a comprehensive survey of LLM-brained GUI agents, exploring their historical evolution, core components, and advanced techniques. We address research questions such as existing GUI agent frameworks, the collection and utilization of data for training specialized GUI agents, the development of large action models tailored for GUI tasks, and the evaluation metrics and benchmarks necessary to assess their effectiveness. Additionally, we examine emerging applications powered by these agents. Through a detailed analysis, this survey identifies key research gaps and outlines a roadmap for future advancements in the field. By consolidating foundational knowledge and state-of-the-art developments, this work aims to guide both researchers and practitioners in overcoming challenges and unlocking the full potential of LLM-brained GUI agents.