ThreatModeling-LLM: Automating Threat Modeling using Large Language Models for Banking System

作者: Tingmin Wu, Shuiqiao Yang, Shigang Liu, David Nguyen, Seung Jang, Alsharif Abuadbba

分类: cs.CR, cs.AI

发布日期: 2024-11-26 (更新: 2025-05-14)

💡 一句话要点

提出ThreatModeling-LLM,利用大语言模型自动化银行系统威胁建模。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 威胁建模 大型语言模型 银行系统 自动化 提示工程 模型微调 网络安全

📋 核心要点

- 传统银行系统威胁建模依赖专家,效率低且易出错,无法满足快速变化的安全需求。

- ThreatModeling-LLM利用LLM自动生成威胁模型,通过数据集构建、提示工程和模型微调三个阶段实现。

- 该方法旨在提升威胁识别和缓解策略生成能力,从而增强银行系统的安全性并符合相关标准。

📝 摘要(中文)

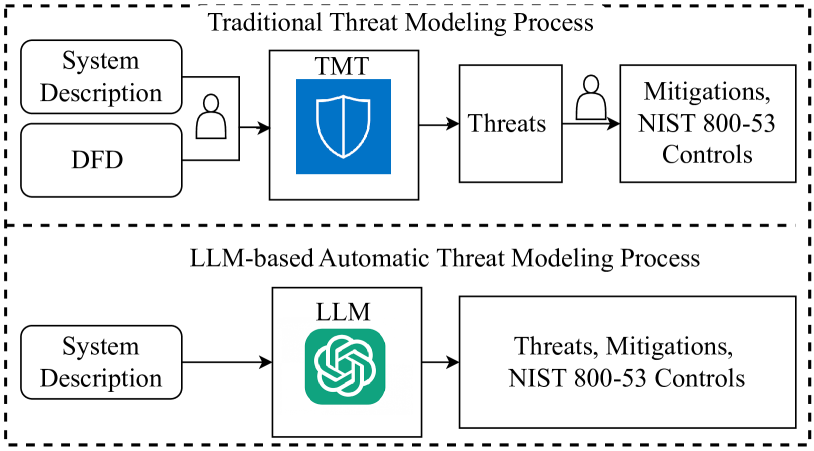

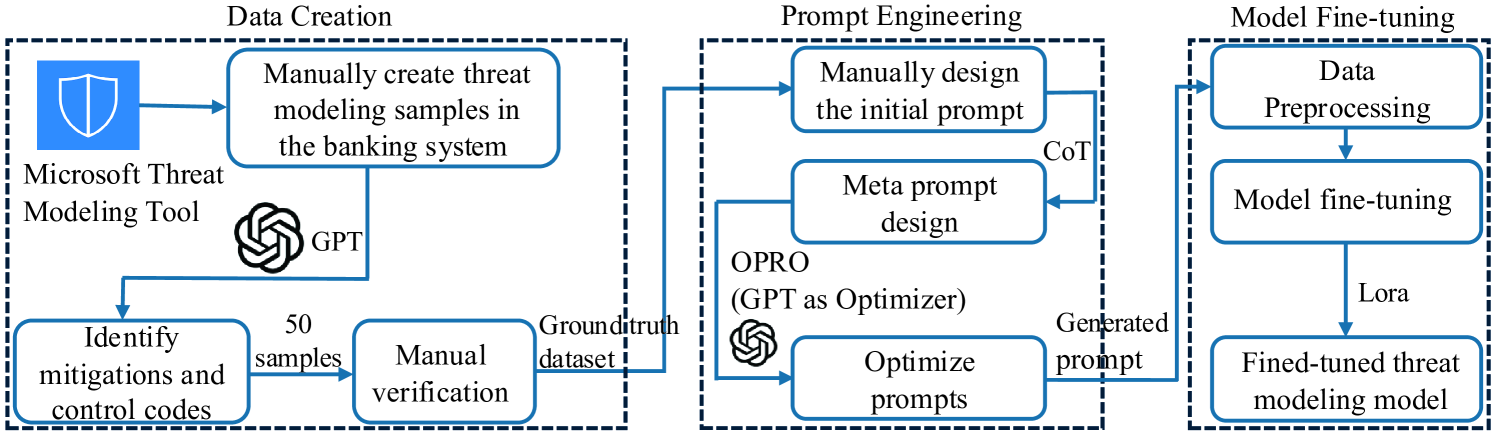

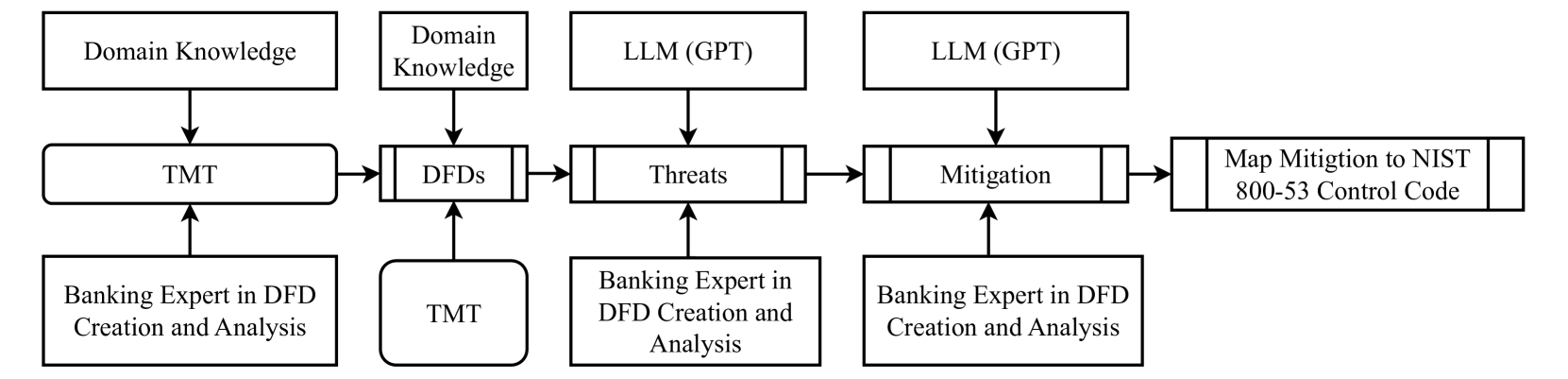

威胁建模是网络安全的关键组成部分,尤其是在银行业等金融数据安全至关重要的行业。传统的威胁建模方法需要专家干预和人工操作,效率低下且容易出现人为错误。大型语言模型(LLM)的出现为自动化这些流程提供了一条有希望的途径,可以提高效率和效力。然而,由于三个主要挑战,这种转变并非易事:(1) 缺乏公开的、特定领域的数据集,(2) 需要定制模型来处理复杂的银行系统架构,(3) 需要符合 NIST 800-53 等合规标准的实时自适应缓解策略。在本文中,我们介绍 ThreatModeling-LLM,这是一个新颖且适应性强的框架,它使用 LLM 自动执行银行系统的威胁建模。ThreatModeling-LLM 分三个阶段运行:1) 数据集创建,2) 提示工程和 3) 模型微调。我们首先使用 Microsoft Threat Modeling Tool (TMT) 生成基准数据集。然后,我们在预训练的 LLM 上应用思维链 (CoT) 和通过提示优化 (OPRO) 来优化初始提示。最后,我们基于基准数据集和优化的提示,使用低秩自适应 (LoRA) 对 LLM 进行微调,以提高预训练 LLM 的威胁识别和缓解生成能力。

🔬 方法详解

问题定义:论文旨在解决银行系统中威胁建模效率低、易出错的问题。现有方法依赖人工,无法快速适应新的威胁和复杂的系统架构,且缺乏针对银行业的领域知识。

核心思路:论文的核心思路是利用大型语言模型(LLM)的强大生成和推理能力,自动化威胁建模过程。通过构建领域数据集、优化提示和微调模型,使LLM能够准确识别威胁并生成有效的缓解策略。

技术框架:ThreatModeling-LLM框架包含三个主要阶段:1) 数据集创建:使用Microsoft Threat Modeling Tool (TMT)生成银行系统威胁建模的基准数据集。2) 提示工程:利用Chain of Thought (CoT) 和 Optimization by PROmpting (OPRO)技术优化LLM的初始提示,使其更好地理解威胁建模任务。3) 模型微调:使用Low-Rank Adaptation (LoRA)技术,基于基准数据集和优化后的提示,对预训练的LLM进行微调,提升其威胁识别和缓解生成能力。

关键创新:该方法的主要创新在于将LLM应用于银行系统的威胁建模,并提出了一个完整的工作流程,包括数据集构建、提示工程和模型微调。通过领域数据集和提示优化,解决了LLM在特定领域应用中的知识缺乏问题,提高了威胁建模的准确性和效率。

关键设计:数据集构建方面,使用TMT工具模拟银行系统架构和潜在威胁。提示工程方面,CoT用于引导LLM进行逐步推理,OPRO用于自动搜索最优提示。模型微调方面,LoRA通过冻结预训练模型的大部分参数,仅训练少量参数,降低了计算成本和存储需求。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了ThreatModeling-LLM的有效性,但具体性能数据和对比基线未知。该方法能够自动生成威胁模型,并提供相应的缓解策略,显著提升了威胁建模的效率和准确性。未来的研究可以进一步探索不同LLM架构和优化策略。

🎯 应用场景

ThreatModeling-LLM可应用于银行、金融机构等对安全要求高的领域,用于自动化威胁建模,提高安全防护效率,降低人工成本。该研究有助于构建更安全、可靠的金融系统,并为其他领域的安全自动化提供借鉴。

📄 摘要(原文)

Threat modeling is a crucial component of cybersecurity, particularly for industries such as banking, where the security of financial data is paramount. Traditional threat modeling approaches require expert intervention and manual effort, often leading to inefficiencies and human error. The advent of Large Language Models (LLMs) offers a promising avenue for automating these processes, enhancing both efficiency and efficacy. However, this transition is not straightforward due to three main challenges: (1) the lack of publicly available, domain-specific datasets, (2) the need for tailored models to handle complex banking system architectures, and (3) the requirement for real-time, adaptive mitigation strategies that align with compliance standards like NIST 800-53. In this paper, we introduce ThreatModeling-LLM, a novel and adaptable framework that automates threat modeling for banking systems using LLMs. ThreatModeling-LLM operates in three stages: 1) dataset creation, 2) prompt engineering and 3) model fine-tuning. We first generate a benchmark dataset using Microsoft Threat Modeling Tool (TMT). Then, we apply Chain of Thought (CoT) and Optimization by PROmpting (OPRO) on the pre-trained LLMs to optimize the initial prompt. Lastly, we fine-tune the LLM using Low-Rank Adaptation (LoRA) based on the benchmark dataset and the optimized prompt to improve the threat identification and mitigation generation capabilities of pre-trained LLMs.