From Pretraining to Privacy: Federated Ultrasound Foundation Model with Self-Supervised Learning

作者: Yuncheng Jiang, Chun-Mei Feng, Jinke Ren, Jun Wei, Zixun Zhang, Yiwen Hu, Yunbi Liu, Rui Sun, Xuemei Tang, Juan Du, Xiang Wan, Yong Xu, Bo Du, Xin Gao, Guangyu Wang, Shaohua Zhou, Shuguang Cui, Zhen Li

分类: eess.IV, cs.AI, cs.CV

发布日期: 2024-11-25 (更新: 2025-12-17)

备注: npj digital medicine(2025)

DOI: 10.1038/s41746-025-02085-0

💡 一句话要点

提出UltraFedFM:基于联邦学习的隐私保护超声影像基础模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 联邦学习 超声影像 基础模型 自监督学习 隐私保护 疾病诊断 病灶分割

📋 核心要点

- 现有超声影像AI方法依赖大量标注数据,存在患者隐私泄露风险,且模型通常针对特定任务设计,泛化能力受限。

- UltraFedFM利用联邦学习,在多中心超声数据集上进行预训练,构建隐私保护的基础模型,提升模型的泛化能力。

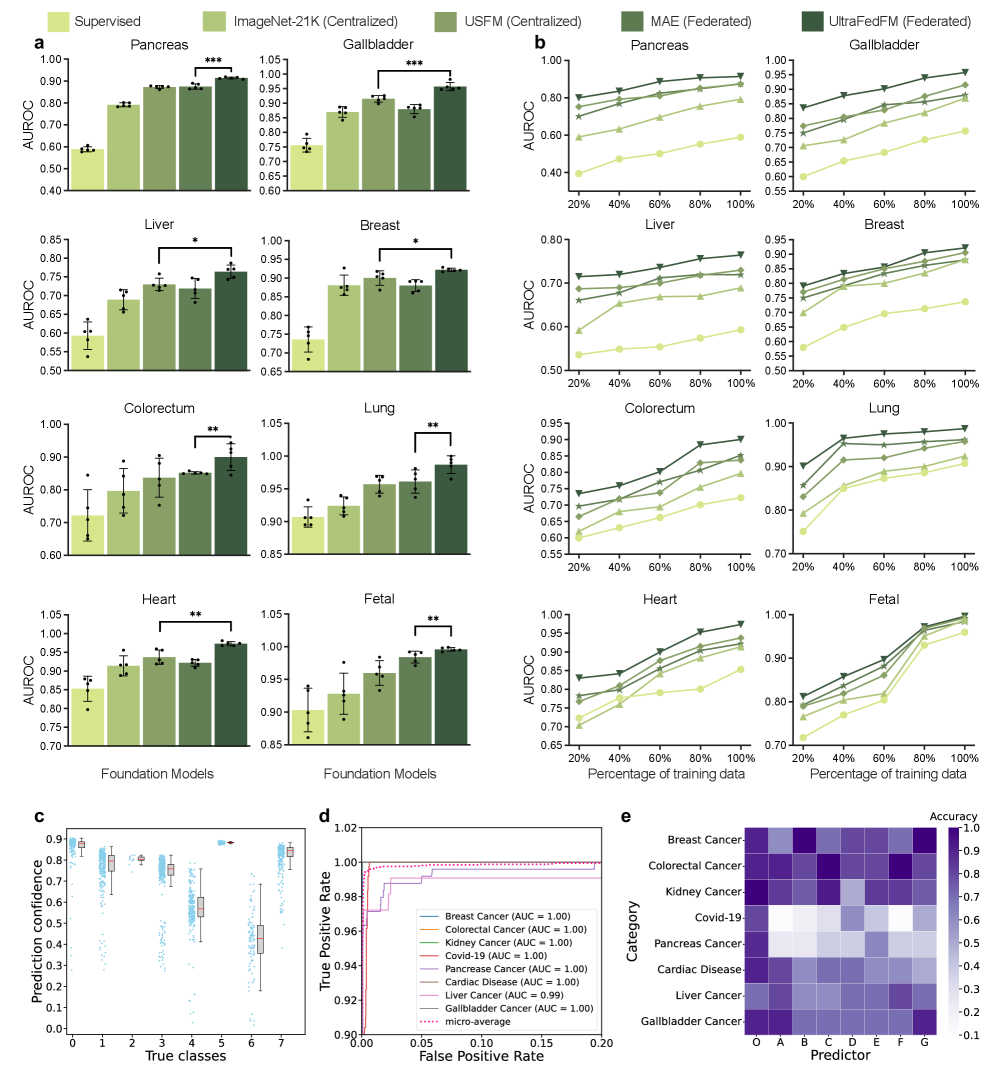

- UltraFedFM在疾病诊断和病灶分割任务上表现出色,诊断准确率超越中级医师,达到专家级医师水平。

📝 摘要(中文)

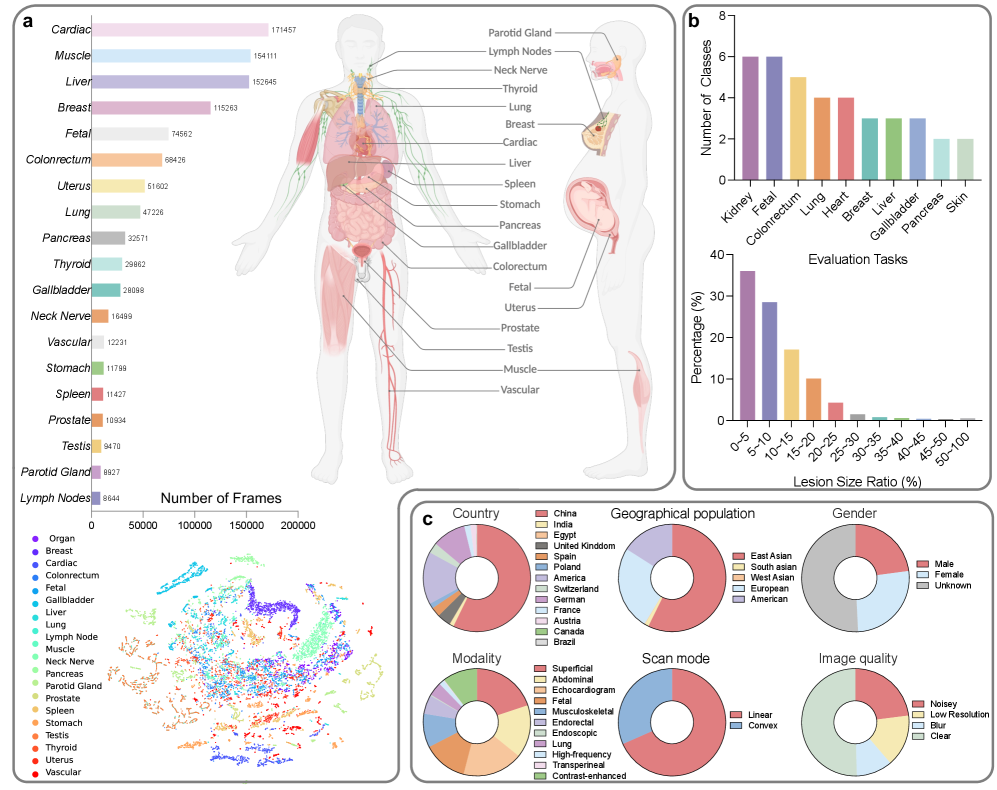

本文提出了一种创新的隐私保护超声影像基础模型UltraFedFM。该模型利用联邦学习,在9个国家的16个医疗机构的分布式数据集上进行协作预训练,数据集包含超过100万张超声图像,覆盖19个器官和10种超声模式。这种大规模和多样化的数据,结合安全的训练框架,使UltraFedFM具有强大的泛化和诊断能力。在疾病诊断方面,其平均受试者工作特征曲线下面积(AUROC)达到0.927,在病灶分割方面,Dice相似系数(DSC)达到0.878。值得注意的是,UltraFedFM的诊断准确率超过了中级超声医师(4-8年经验),并且在8种常见全身性疾病的联合诊断中与专家级超声医师(10年以上经验)的水平相当。这些发现表明,UltraFedFM可以在保护患者隐私的同时显著提高临床诊断水平,标志着人工智能驱动的超声影像技术在未来临床应用中的重大进步。

🔬 方法详解

问题定义:现有超声影像AI模型训练严重依赖大量标注数据,这不仅增加了数据获取和标注的成本,更重要的是,直接共享患者的医疗数据会带来严重的隐私泄露风险。此外,大多数模型是为特定任务设计的,缺乏通用性和泛化能力,难以适应不同的临床需求。

核心思路:本文的核心思路是利用联邦学习,在保护患者隐私的前提下,聚合多个医疗机构的超声影像数据,训练一个通用的超声影像基础模型。通过大规模的分布式训练,模型可以学习到更丰富的特征表示,从而提高其泛化能力和诊断性能。

技术框架:UltraFedFM的整体框架包括以下几个主要阶段:1) 数据准备:各个医疗机构准备本地的超声影像数据集。2) 模型初始化:服务器端初始化一个基础模型。3) 联邦训练:各个客户端(医疗机构)使用本地数据训练模型,并将模型更新上传到服务器端。服务器端聚合各个客户端的模型更新,得到全局模型。4) 模型评估:使用独立的测试数据集评估全局模型的性能。这个过程迭代进行,直到模型收敛。

关键创新:UltraFedFM的关键创新在于将联邦学习应用于超声影像基础模型的训练,从而在保护患者隐私的前提下,利用大规模的分布式数据来提升模型的性能。与传统的集中式训练方法相比,UltraFedFM避免了直接共享患者数据,从而降低了隐私泄露的风险。

关键设计:在联邦训练过程中,采用了差分隐私技术来进一步保护患者隐私。具体来说,在上传模型更新之前,会对模型参数添加噪声,从而防止攻击者通过分析模型更新来推断患者的个人信息。此外,还采用了模型压缩技术来减少模型更新的大小,从而降低了通信成本。

🖼️ 关键图片

📊 实验亮点

UltraFedFM在疾病诊断方面取得了显著的成果,平均AUROC达到0.927,在病灶分割方面,DSC达到0.878。更重要的是,UltraFedFM的诊断准确率超过了中级超声医师(4-8年经验),并且在8种常见全身性疾病的联合诊断中与专家级超声医师(10年以上经验)的水平相当。这些结果表明,UltraFedFM具有很强的临床应用价值。

🎯 应用场景

UltraFedFM具有广泛的应用前景,可用于辅助医生进行疾病诊断、病灶分割和病情评估,提高诊断效率和准确性。该模型还可应用于远程医疗和移动医疗,为缺乏医疗资源的地区提供高质量的超声影像诊断服务。未来,UltraFedFM有望成为超声影像领域的重要基础设施,推动人工智能在医疗领域的应用。

📄 摘要(原文)

Ultrasound imaging is widely used in clinical diagnosis due to its non-invasive nature and real-time capabilities. However, traditional ultrasound diagnostics relies heavily on physician expertise and is often hampered by suboptimal image quality, leading to potential diagnostic errors. While artificial intelligence (AI) offers a promising solution to enhance clinical diagnosis by detecting abnormalities across various imaging modalities, existing AI methods for ultrasound face two major challenges. First, they typically require vast amounts of labeled medical data, raising serious concerns regarding patient privacy. Second, most models are designed for specific tasks, which restricts their broader clinical utility. To overcome these challenges, we present UltraFedFM, an innovative privacy-preserving ultrasound foundation model. UltraFedFM is collaboratively pre-trained using federated learning across 16 distributed medical institutions in 9 countries, leveraging a dataset of over 1 million ultrasound images covering 19 organs and 10 ultrasound modalities. This extensive and diverse data, combined with a secure training framework, enables UltraFedFM to exhibit strong generalization and diagnostic capabilities. It achieves an average area under the receiver operating characteristic curve (AUROC) of 0.927 for disease diagnosis and a dice similarity coefficient (DSC) of 0.878 for lesion segmentation. Notably, UltraFedFM surpasses the diagnostic accuracy of mid-level ultrasonographers (4-8 years of experience) and matches the performance of expert-level sonographers (10+ years of experience) in the joint diagnosis of 8 common systemic diseases.c These findings indicate that UltraFedFM can significantly enhance clinical diagnostics while safeguarding patient privacy, marking a significant advancement in AI-driven ultrasound imaging for future clinical applications.