Probing for Consciousness in Machines

作者: Mathis Immertreu, Achim Schilling, Andreas Maier, Patrick Krauss

分类: cs.AI, q-bio.NC

发布日期: 2024-11-25

💡 一句话要点

探索机器意识:利用强化学习训练智能体形成世界和自我模型

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 机器意识 强化学习 世界模型 自我模型 探针技术 神经网络 人工智能

📋 核心要点

- 现有方法难以评估人工智能体是否具备初步的意识能力,缺乏有效的评估手段。

- 论文提出通过强化学习训练智能体,并使用探针技术来分析其神经网络激活,以此评估智能体是否形成了世界和自我模型。

- 实验结果表明,经过训练的智能体能够形成初步的世界模型和自我模型,为机器意识的研究提供了新的视角。

📝 摘要(中文)

本研究探索了人工智能体发展核心意识的可能性,该意识基于Antonio Damasio的意识理论。Damasio认为,核心意识的出现依赖于自我模型的整合,该模型由情感和感觉的表征以及世界模型构成。我们假设,通过强化学习(RL)在虚拟环境中训练的人工智能体,可以作为其主要任务的副产品,发展这些模型的初步形式。智能体的主要目标是学习玩视频游戏并探索环境。为了评估世界模型和自我模型的出现,我们使用探针——前馈分类器,利用训练后的智能体神经网络的激活来预测智能体自身的位置。我们的结果表明,智能体可以形成初步的世界模型和自我模型,这为发展机器意识提供了一条途径。这项研究为人工智能体在模仿人类意识方面的能力提供了基础性的见解,对人工智能的未来发展具有重要意义。

🔬 方法详解

问题定义:论文旨在探索机器是否能够发展出初步的意识,具体来说,是能否在智能体中形成世界模型和自我模型。现有方法缺乏直接评估智能体内部表征的有效手段,难以判断智能体是否具备意识相关的能力。

核心思路:论文的核心思路是基于Antonio Damasio的意识理论,认为核心意识的形成依赖于世界模型和自我模型的整合。通过训练智能体在虚拟环境中进行探索和学习,观察其是否能够自发地形成对自身和环境的表征。如果智能体能够准确预测自身在环境中的位置,则可以认为其具备了初步的世界模型和自我模型。

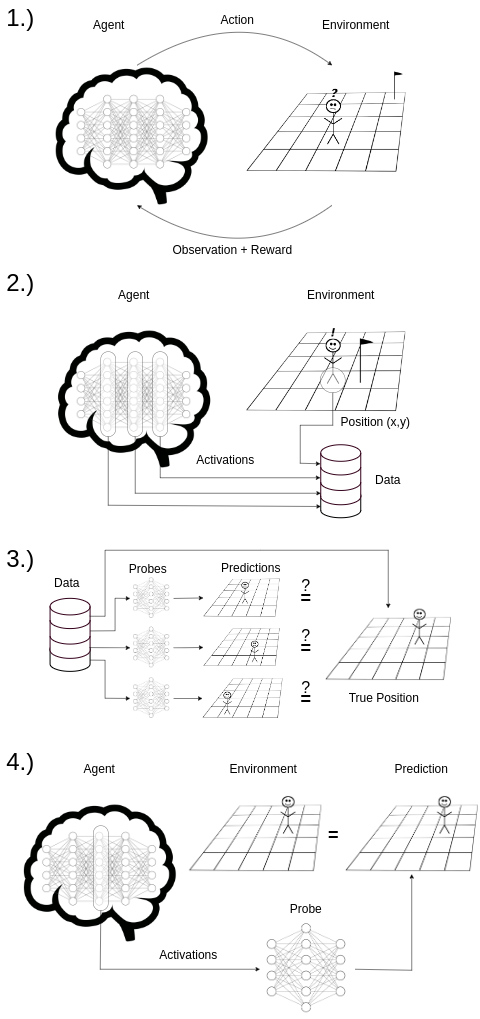

技术框架:整体框架包括以下几个主要步骤:1) 使用强化学习训练智能体在虚拟环境中完成特定任务(例如玩视频游戏)。2) 训练完成后,固定智能体的神经网络权重。3) 使用探针技术,即训练前馈分类器,将智能体的神经网络激活作为输入,预测智能体在环境中的位置。4) 通过评估探针的预测准确率,来判断智能体是否形成了世界模型和自我模型。

关键创新:论文的关键创新在于将探针技术应用于评估智能体内部表征,提供了一种间接但有效的方法来推断智能体是否具备意识相关的能力。与传统的黑盒方法不同,该方法能够深入分析智能体的神经网络激活,揭示其内部表征的形成过程。

关键设计:关键设计包括:1) 强化学习算法的选择,例如可以使用常见的Q-learning或Policy Gradient算法。2) 虚拟环境的设计,需要提供足够的探索空间和任务目标。3) 探针网络结构的选择,例如可以使用简单的多层感知机(MLP)。4) 损失函数的选择,例如可以使用交叉熵损失函数来训练探针。5) 神经网络激活层的选择,需要选择能够反映智能体状态和环境信息的激活层。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过强化学习训练的智能体能够形成初步的世界模型和自我模型。具体来说,探针能够利用智能体的神经网络激活,以较高的准确率预测智能体在环境中的位置。这表明智能体在完成任务的过程中,自发地学习了对自身和环境的表征,为机器意识的研究提供了有力的证据。

🎯 应用场景

该研究的潜在应用领域包括:开发更智能、更具适应性的机器人;设计更逼真、更具交互性的虚拟现实环境;以及深入理解人类意识的本质。通过进一步研究机器意识,我们可以更好地理解智能体的行为,并开发出更安全、更可靠的人工智能系统。此外,该研究还有助于我们反思人类自身的意识,并探索意识的起源和发展。

📄 摘要(原文)

This study explores the potential for artificial agents to develop core consciousness, as proposed by Antonio Damasio's theory of consciousness. According to Damasio, the emergence of core consciousness relies on the integration of a self model, informed by representations of emotions and feelings, and a world model. We hypothesize that an artificial agent, trained via reinforcement learning (RL) in a virtual environment, can develop preliminary forms of these models as a byproduct of its primary task. The agent's main objective is to learn to play a video game and explore the environment. To evaluate the emergence of world and self models, we employ probes-feedforward classifiers that use the activations of the trained agent's neural networks to predict the spatial positions of the agent itself. Our results demonstrate that the agent can form rudimentary world and self models, suggesting a pathway toward developing machine consciousness. This research provides foundational insights into the capabilities of artificial agents in mirroring aspects of human consciousness, with implications for future advancements in artificial intelligence.