Enhancing Multi-Agent Consensus through Third-Party LLM Integration: Analyzing Uncertainty and Mitigating Hallucinations in Large Language Models

作者: Zhihua Duan, Jialin Wang

分类: cs.AI, cs.CL, cs.MA

发布日期: 2024-11-25

💡 一句话要点

提出基于第三方LLM集成的多Agent共识方法,缓解LLM幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 多Agent系统 共识机制 幻觉缓解 不确定性估计

📋 核心要点

- 现有LLM在复杂推理中易产生幻觉,限制了其应用,亟需有效缓解方案。

- 引入第三方LLM,通过不确定性估计调整Agent注意力,促进多Agent共识。

- 实验表明,该方法在算术任务上优于传统多Agent基线,验证了有效性。

📝 摘要(中文)

大型语言模型(LLMs)在处理复杂推理任务时仍然面临挑战,常常产生幻觉,这限制了LLMs的实际应用。为了缓解这个问题,本文提出了一种新的方法,该方法集成了不同的LLMs来扩展知识边界,减少对单一模型的依赖,并促进Agent之间的深入辩论。主要贡献包括:1) 引入第三方LLMs,通过不确定性估计和置信度分析来调整Agent的注意力权重,优化多Agent系统中的共识形成;2) 在算术数据集上的实验验证了该方法的有效性,超过了传统的多Agent基线。这项研究为大型模型在处理复杂任务时缓解幻觉现象提供了一个新的视角。

🔬 方法详解

问题定义:论文旨在解决大型语言模型在复杂推理任务中出现的幻觉问题。现有方法通常依赖于单一模型,知识边界有限,容易产生错误信息。多Agent系统虽然可以提升性能,但Agent之间的共识形成容易受到个体Agent幻觉的影响,导致最终结果不准确。

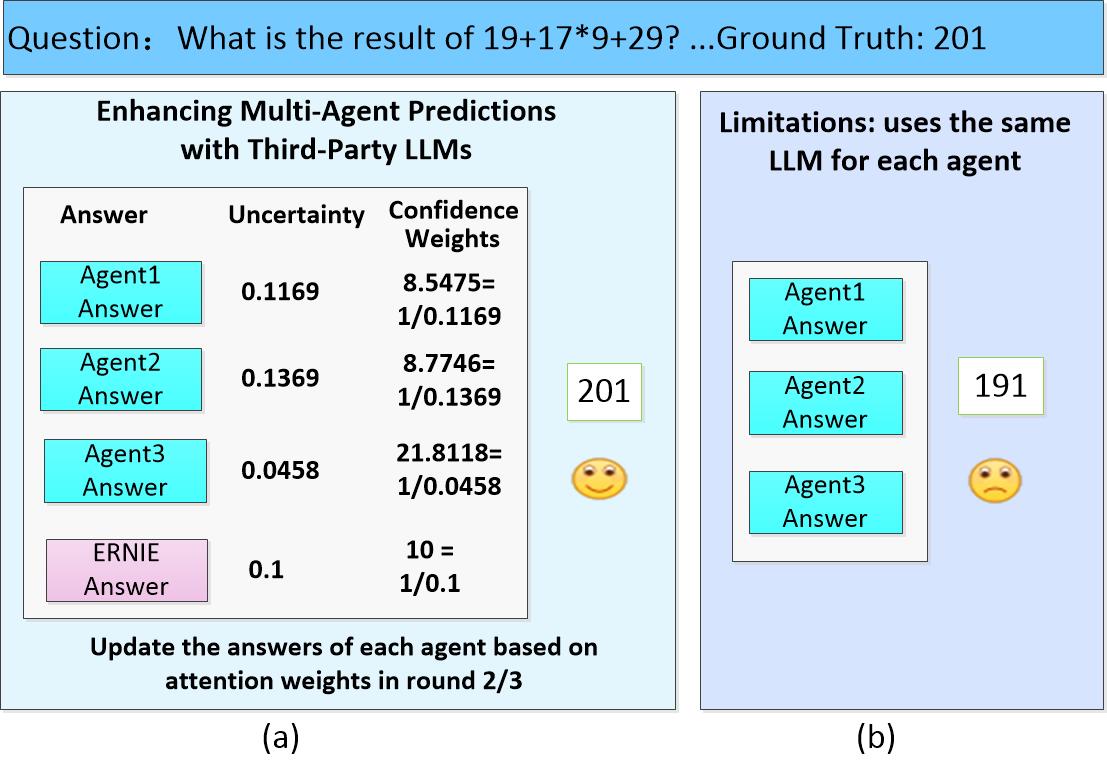

核心思路:论文的核心思路是引入第三方LLM作为“裁判”或“顾问”,通过评估各个Agent的不确定性和置信度,动态调整Agent之间的注意力权重。这样可以减少对单一Agent的依赖,鼓励Agent之间进行更深入的辩论和知识融合,从而降低幻觉产生的可能性。

技术框架:该方法的技术框架主要包含以下几个阶段:1) 多个Agent基于初始问题生成各自的答案;2) 引入第三方LLM,对每个Agent答案的不确定性和置信度进行评估;3) 根据第三方LLM的评估结果,调整Agent之间的注意力权重;4) Agent之间进行多轮辩论,互相提供证据和解释,最终达成共识;5) 输出最终答案。

关键创新:该方法最重要的创新点在于引入了第三方LLM来动态调整Agent的注意力权重。与传统的静态权重分配方法不同,该方法能够根据Agent的实际表现进行自适应调整,从而更有效地利用各个Agent的知识和能力。此外,通过不确定性估计和置信度分析,可以更好地识别和抑制幻觉信息。

关键设计:具体的技术细节可能包括:如何设计第三方LLM的评估指标(例如,基于信息熵或交叉熵的不确定性度量);如何将不确定性和置信度转化为注意力权重(例如,使用softmax函数进行归一化);如何设计Agent之间的辩论机制(例如,基于证据链或逻辑推理)。论文可能还涉及一些超参数的设置,例如,辩论的轮数、注意力权重的调整幅度等。这些细节将直接影响方法的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在算术数据集上显著优于传统的多Agent基线。具体的性能提升幅度未知,但摘要中明确指出“surpassing traditional multi-agent baselines”,表明该方法具有实际效果。该方法通过引入第三方LLM,有效缓解了幻觉问题,提升了多Agent系统的共识质量。

🎯 应用场景

该研究成果可应用于需要高可靠性和准确性的复杂推理任务,例如金融分析、医疗诊断、法律咨询等领域。通过降低LLM的幻觉,可以提升决策的质量和效率。未来,该方法还可以扩展到其他类型的多Agent系统,例如机器人协作、自动驾驶等。

📄 摘要(原文)

Large Language Models (LLMs) still face challenges when dealing with complex reasoning tasks, often resulting in hallucinations, which limit the practical application of LLMs. To alleviate this issue, this paper proposes a new method that integrates different LLMs to expand the knowledge boundary, reduce dependence on a single model, and promote in-depth debate among agents. The main contributions include: 1) Introducing third-party LLMs to adjust the attention weights of agents through uncertainty estimation and confidence analysis, optimizing consensus formation in multi-agent systems; 2) Experiments on arithmetic datasets have validated the effectiveness of the method, surpassing traditional multi-agent baselines. This research provides a new perspective for large models to alleviate hallucination phenomena when dealing with complex tasks.