mR$^2$AG: Multimodal Retrieval-Reflection-Augmented Generation for Knowledge-Based VQA

作者: Tao Zhang, Ziqi Zhang, Zongyang Ma, Yuxin Chen, Zhongang Qi, Chunfeng Yuan, Bing Li, Junfu Pu, Yuxuan Zhao, Zehua Xie, Jin Ma, Ying Shan, Weiming Hu

分类: cs.AI, cs.CL

发布日期: 2024-11-22

💡 一句话要点

提出mR$^2$AG框架,通过检索-反思增强生成提升知识型VQA任务性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 视觉问答 知识增强 检索增强生成 反思机制

📋 核心要点

- 现有MLLM在知识型VQA任务中受限于知识范围,导致回答模糊和不准确,需要外部知识补充。

- mR$^2$AG通过检索-反思机制自适应地进行知识检索,并定位相关证据,避免冗余检索和信息过滤。

- mR$^2$AG在INFOSEEK和Encyclopedic-VQA上显著优于现有MLLM和RAG方法,同时保持了基础MLLM的通用能力。

📝 摘要(中文)

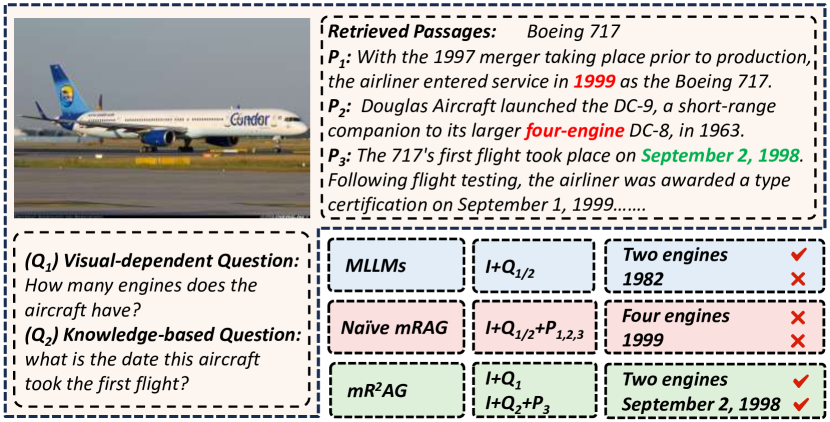

本文提出了一种新的通用框架,即多模态检索-反思增强生成(mR$^2$AG),旨在解决多模态大型语言模型(MLLM)在知识型视觉问答(VQA)任务(如INFOSEEK和Encyclopedic-VQA)中因知识范围有限而表现不佳的问题。mR$^2$AG通过自适应检索和有效信息定位来支持答案生成,并采用两种易于实现的反思操作,避免了模型复杂性的增加。检索-反思模块用于区分不同的用户查询,避免冗余检索调用;相关性-反思模块用于引导MLLM定位检索内容中的有益证据,并据此生成答案。此外,mR$^2$AG可以集成到任何经过良好训练的MLLM中,并通过提出的mR$^2$AG指令调优数据集(mR$^2$AG-IT)进行高效微调。在INFOSEEK和Encyclopedic-VQA上,mR$^2$AG显著优于最先进的MLLM(如GPT-4v/o)和基于RAG的MLLM,同时保持了基础MLLM在各种视觉相关任务中的卓越能力。

🔬 方法详解

问题定义:论文旨在解决多模态大型语言模型(MLLM)在知识型视觉问答(VQA)任务中,由于自身知识库的局限性,无法准确回答需要外部知识的问题。现有基于检索增强生成(RAG)的方法存在冗余检索、缺乏证据识别以及模型复杂度高等问题。

核心思路:论文的核心思路是通过引入“反思”机制,使模型能够自适应地判断是否需要检索外部知识,并有效定位检索结果中的相关证据。这种方法旨在提高知识型VQA的准确性和效率,同时避免增加模型的复杂性。

技术框架:mR$^2$AG框架包含以下主要模块:1) 基础MLLM:用于处理视觉和文本输入,并生成答案。2) 检索-反思模块:根据用户查询判断是否需要检索外部知识。3) 知识检索模块:在需要时检索相关知识。4) 相关性-反思模块:从检索到的知识中定位与问题相关的证据。5) 答案生成模块:基于定位的证据生成最终答案。整个流程通过指令调优数据集(mR$^2$AG-IT)进行微调。

关键创新:该方法的核心创新在于引入了“反思”机制,具体包括检索-反思和相关性-反思两个模块。检索-反思模块能够自适应地判断是否需要进行知识检索,避免了不必要的检索操作。相关性-反思模块则能够从检索到的知识中定位与问题相关的证据,提高了答案生成的准确性。与现有RAG方法相比,mR$^2$AG避免了额外的过滤模块,降低了模型复杂度。

关键设计:mR$^2$AG的关键设计包括:1) 检索-反思模块的设计,具体实现方式未知,但其目标是判断是否需要检索。2) 相关性-反思模块的设计,具体实现方式未知,但其目标是定位相关证据。3) mR$^2$AG-IT数据集的构建,用于指令调优,提高模型的性能。论文中未明确给出损失函数和网络结构的具体细节,这部分信息未知。

🖼️ 关键图片

📊 实验亮点

mR$^2$AG在INFOSEEK和Encyclopedic-VQA数据集上显著优于现有方法,包括GPT-4v/o等先进的MLLM以及基于RAG的MLLM。具体性能提升数据未在摘要中明确给出,但强调了其显著优于现有方法,同时保持了基础MLLM在其他视觉任务上的能力。

🎯 应用场景

mR$^2$AG框架可应用于各种需要外部知识辅助的视觉问答场景,例如智能客服、教育辅助、医疗诊断等。通过提供更准确和全面的答案,可以提升用户体验和工作效率。未来,该框架可以扩展到其他多模态任务,例如图像描述、视频理解等。

📄 摘要(原文)

Advanced Multimodal Large Language Models (MLLMs) struggle with recent Knowledge-based VQA tasks, such as INFOSEEK and Encyclopedic-VQA, due to their limited and frozen knowledge scope, often leading to ambiguous and inaccurate responses. Thus, multimodal Retrieval-Augmented Generation (mRAG) is naturally introduced to provide MLLMs with comprehensive and up-to-date knowledge, effectively expanding the knowledge scope. However, current mRAG methods have inherent drawbacks, including: 1) Performing retrieval even when external knowledge is not needed. 2) Lacking of identification of evidence that supports the query. 3) Increasing model complexity due to additional information filtering modules or rules. To address these shortcomings, we propose a novel generalized framework called \textbf{m}ultimodal \textbf{R}etrieval-\textbf{R}eflection-\textbf{A}ugmented \textbf{G}eneration (mR$^2$AG), which achieves adaptive retrieval and useful information localization to enable answers through two easy-to-implement reflection operations, preventing high model complexity. In mR$^2$AG, Retrieval-Reflection is designed to distinguish different user queries and avoids redundant retrieval calls, and Relevance-Reflection is introduced to guide the MLLM in locating beneficial evidence of the retrieved content and generating answers accordingly. In addition, mR$^2$AG can be integrated into any well-trained MLLM with efficient fine-tuning on the proposed mR$^2$AG Instruction-Tuning dataset (mR$^2$AG-IT). mR$^2$AG significantly outperforms state-of-the-art MLLMs (e.g., GPT-4v/o) and RAG-based MLLMs on INFOSEEK and Encyclopedic-VQA, while maintaining the exceptional capabilities of base MLLMs across a wide range of Visual-dependent tasks.