Exploring adversarial robustness of JPEG AI: methodology, comparison and new methods

作者: Egor Kovalev, Georgii Bychkov, Khaled Abud, Aleksandr Gushchin, Anna Chistyakova, Sergey Lavrushkin, Dmitriy Vatolin, Anastasia Antsiferova

分类: eess.IV, cs.AI, cs.CV

发布日期: 2024-11-18

💡 一句话要点

提出评估JPEG AI对抗鲁棒性的新方法,并进行大规模对比实验

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对抗鲁棒性 神经图像压缩 JPEG AI 对抗攻击 鲁棒性评估

📋 核心要点

- 现有神经图像压缩(NIC)鲁棒性研究不足,主要集中于开源编解码器和小范围攻击,缺乏对JPEG AI等实际应用标准的深入评估。

- 论文提出了一种新的NIC对抗鲁棒性评估方法,旨在更全面、有效地衡量神经图像压缩模型在面对恶意攻击时的性能表现。

- 通过大规模实验,论文首次评估了JPEG AI的对抗鲁棒性,并与其他NIC模型进行了对比,实验结果和代码已公开。

📝 摘要(中文)

神经网络的对抗鲁棒性是日益重要的研究领域,涵盖计算机视觉模型、大型语言模型(LLM)等。随着JPEG AI的发布——这是第一个端到端神经图像压缩(NIC)方法的标准——其鲁棒性问题变得至关重要。JPEG AI是首批嵌入消费设备的基于神经网络模型的国际实际应用之一。然而,关于NIC鲁棒性的研究仅限于开源编解码器和有限范围的攻击。本文提出了一种新的方法来衡量NIC对对抗攻击的鲁棒性。我们首次对JPEG AI的鲁棒性进行了大规模评估,并将其与其他NIC模型进行了比较。我们的评估结果和代码已在网上公开。

🔬 方法详解

问题定义:论文旨在解决神经图像压缩(NIC)模型,特别是JPEG AI,在面对对抗攻击时的鲁棒性评估问题。现有研究主要集中于开源编解码器,且攻击类型有限,无法全面评估实际应用场景下NIC模型的安全性。JPEG AI作为首个端到端神经图像压缩国际标准,其鲁棒性直接关系到消费级设备的安全性与可靠性。

核心思路:论文的核心思路是设计一套完整的评估流程,包括选择合适的对抗攻击方法、构建大规模的测试数据集,以及定义合理的鲁棒性指标。通过系统性的实验,分析JPEG AI在不同攻击下的性能表现,并与其他NIC模型进行对比,从而揭示其潜在的安全风险。

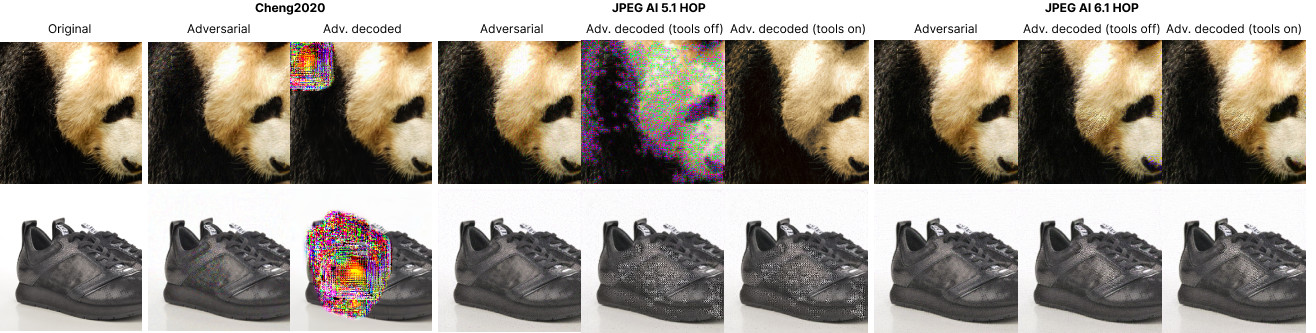

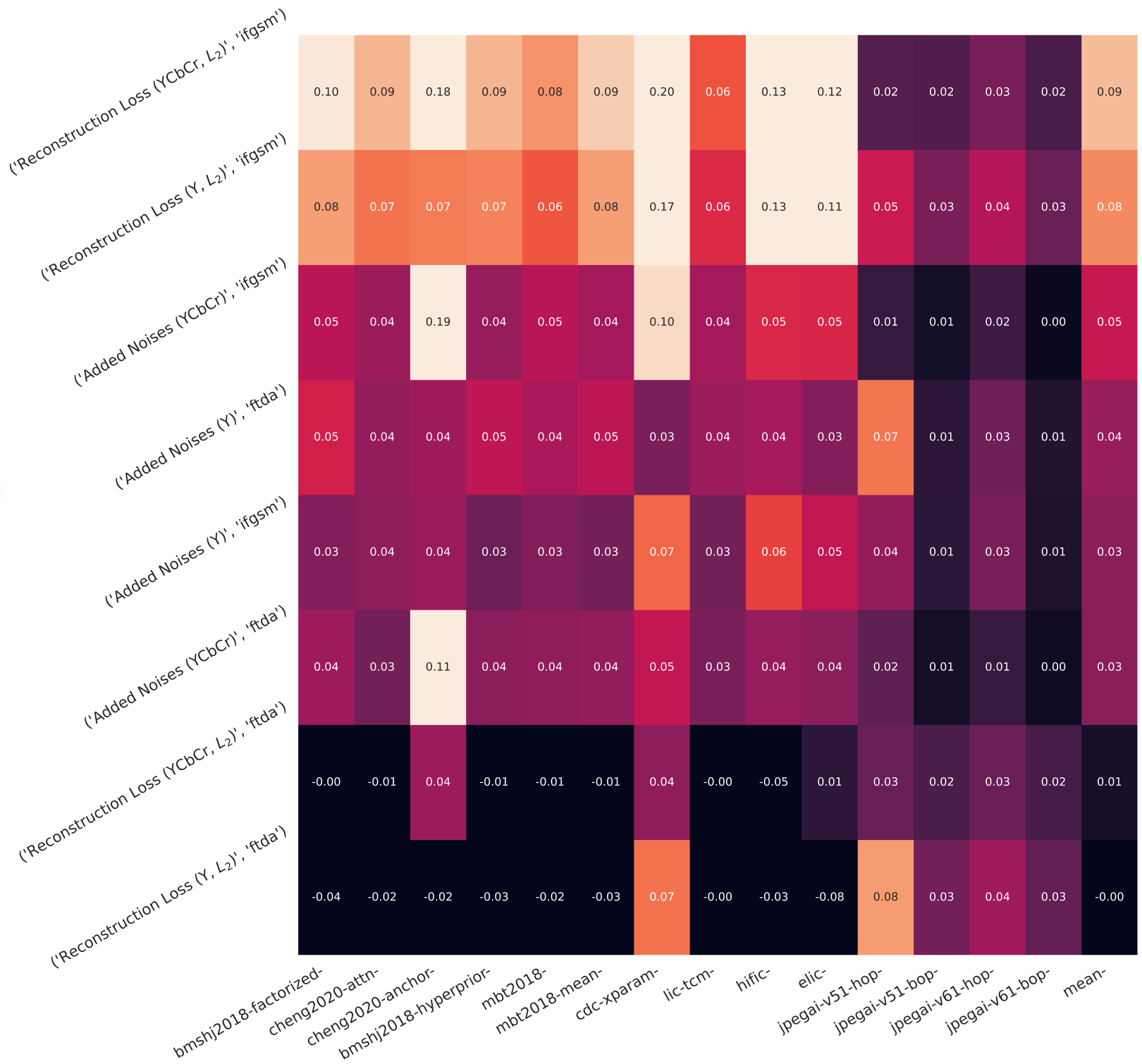

技术框架:论文提出的评估框架主要包括以下几个阶段:1) 选择或设计合适的对抗攻击算法,例如FGSM、PGD等;2) 构建包含各种图像内容和质量的大规模测试数据集;3) 使用选定的对抗攻击算法生成对抗样本;4) 将原始图像和对抗样本输入到JPEG AI和其他NIC模型中进行压缩和解压缩;5) 评估解压缩后图像的质量和相似度,计算鲁棒性指标,例如PSNR、SSIM等;6) 对比不同模型在不同攻击下的鲁棒性表现。

关键创新:论文的关键创新在于:1) 首次针对JPEG AI这一实际应用的神经图像压缩标准进行对抗鲁棒性评估;2) 提出了一个系统性的评估方法,可以用于评估各种NIC模型的鲁棒性;3) 构建了一个大规模的测试数据集,包含了各种图像内容和质量,更贴近实际应用场景。

关键设计:论文中对抗攻击算法的选择、测试数据集的构建、鲁棒性指标的定义等都是关键设计。对抗攻击算法需要具有一定的攻击强度,能够有效地欺骗NIC模型;测试数据集需要具有代表性,能够覆盖各种图像内容和质量;鲁棒性指标需要能够准确地反映NIC模型在面对对抗攻击时的性能表现。具体的参数设置、损失函数、网络结构等细节可能因不同的NIC模型和对抗攻击算法而有所不同,论文中应该会详细描述。

🖼️ 关键图片

📊 实验亮点

论文首次对JPEG AI的对抗鲁棒性进行了大规模评估,并与其他NIC模型进行了对比。具体性能数据未知,但强调了评估结果和代码的公开性,表明研究具有可复现性和参考价值。通过实验,揭示了JPEG AI在面对对抗攻击时的潜在安全风险,为后续改进提供了重要依据。

🎯 应用场景

该研究成果可应用于提升神经图像压缩算法的安全性,尤其是在消费电子设备、图像存储和传输等领域。通过评估和改进JPEG AI等标准的对抗鲁棒性,可以有效防止恶意攻击,保障用户数据安全和系统稳定。未来,该研究方向有助于推动更安全、可靠的AI图像处理技术发展。

📄 摘要(原文)

Adversarial robustness of neural networks is an increasingly important area of research, combining studies on computer vision models, large language models (LLMs), and others. With the release of JPEG AI - the first standard for end-to-end neural image compression (NIC) methods - the question of its robustness has become critically significant. JPEG AI is among the first international, real-world applications of neural-network-based models to be embedded in consumer devices. However, research on NIC robustness has been limited to open-source codecs and a narrow range of attacks. This paper proposes a new methodology for measuring NIC robustness to adversarial attacks. We present the first large-scale evaluation of JPEG AI's robustness, comparing it with other NIC models. Our evaluation results and code are publicly available online (link is hidden for a blind review).