Navigating the Risks: A Survey of Security, Privacy, and Ethics Threats in LLM-Based Agents

作者: Yuyou Gan, Yong Yang, Zhe Ma, Ping He, Rui Zeng, Yiming Wang, Qingming Li, Chunyi Zhou, Songze Li, Ting Wang, Yunjun Gao, Yingcai Wu, Shouling Ji

分类: cs.AI

发布日期: 2024-11-14

💡 一句话要点

针对LLM Agent的安全、隐私和伦理威胁的综述,提出基于来源和影响的新型分类框架。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM Agent 安全威胁 隐私风险 伦理问题 威胁分类 案例研究 未来研究方向 人工智能安全

📋 核心要点

- 现有LLM Agent面临严重的安全和隐私威胁,传统分类方法难以应对跨模块和跨阶段的复杂威胁。

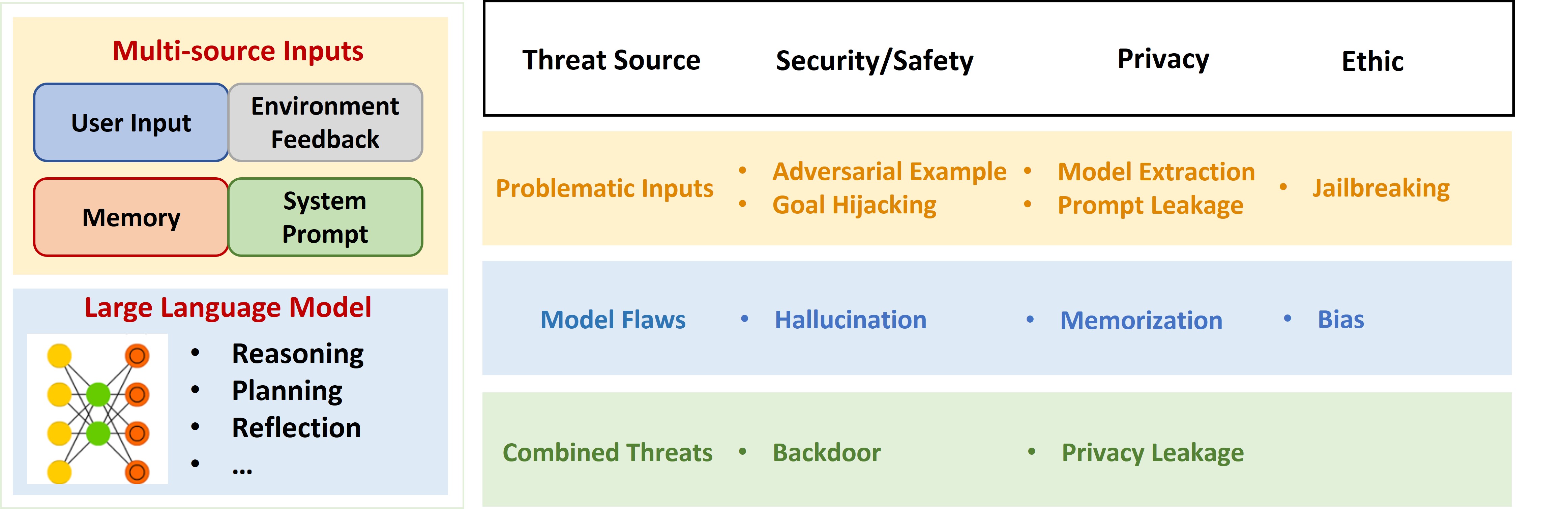

- 论文提出一种基于威胁来源和影响的新型分类框架,更全面地分析LLM Agent的安全风险。

- 通过案例研究分析了实际应用中LLM Agent面临的风险,并从数据、方法和策略层面提出了未来研究方向。

📝 摘要(中文)

随着大型语言模型(LLMs)的不断发展,基于Transformer的模型在众多自然语言处理(NLP)任务中取得了突破性进展,从而涌现出一系列使用LLMs作为控制中心的Agent。虽然LLMs在各种任务中取得了成功,但它们面临着许多安全和隐私威胁,这些威胁在Agent场景中变得更加严重。为了提高基于LLM的应用程序的可靠性,大量研究涌现出来,旨在从不同角度评估和缓解这些风险。为了帮助研究人员全面了解各种风险,本调查收集并分析了这些Agent面临的不同威胁。为了解决先前分类法在处理跨模块和跨阶段威胁方面面临的挑战,我们提出了一种基于来源和影响的新型分类框架。此外,我们确定了基于LLM的Agent的六个关键特征,并在此基础上总结了当前的研究进展并分析了它们的局限性。随后,我们选择四个具有代表性的Agent作为案例研究,以分析它们在实际使用中可能面临的风险。最后,基于上述分析,我们分别从数据、方法和策略的角度提出了未来的研究方向。

🔬 方法详解

问题定义:LLM Agent在实际应用中面临着严重的安全、隐私和伦理威胁。现有的威胁分类方法难以处理跨模块和跨阶段的复杂威胁,无法全面地评估LLM Agent的风险。因此,需要一种新的分类框架来更有效地识别和分析这些威胁,从而为LLM Agent的安全防护提供指导。

核心思路:论文的核心思路是基于威胁的来源和影响来构建一种新的分类框架。这种分类方法能够更清晰地识别威胁的根本原因和潜在后果,从而更好地理解和应对LLM Agent面临的各种风险。通过分析威胁的来源,可以针对性地采取预防措施;通过评估威胁的影响,可以制定有效的应对策略。

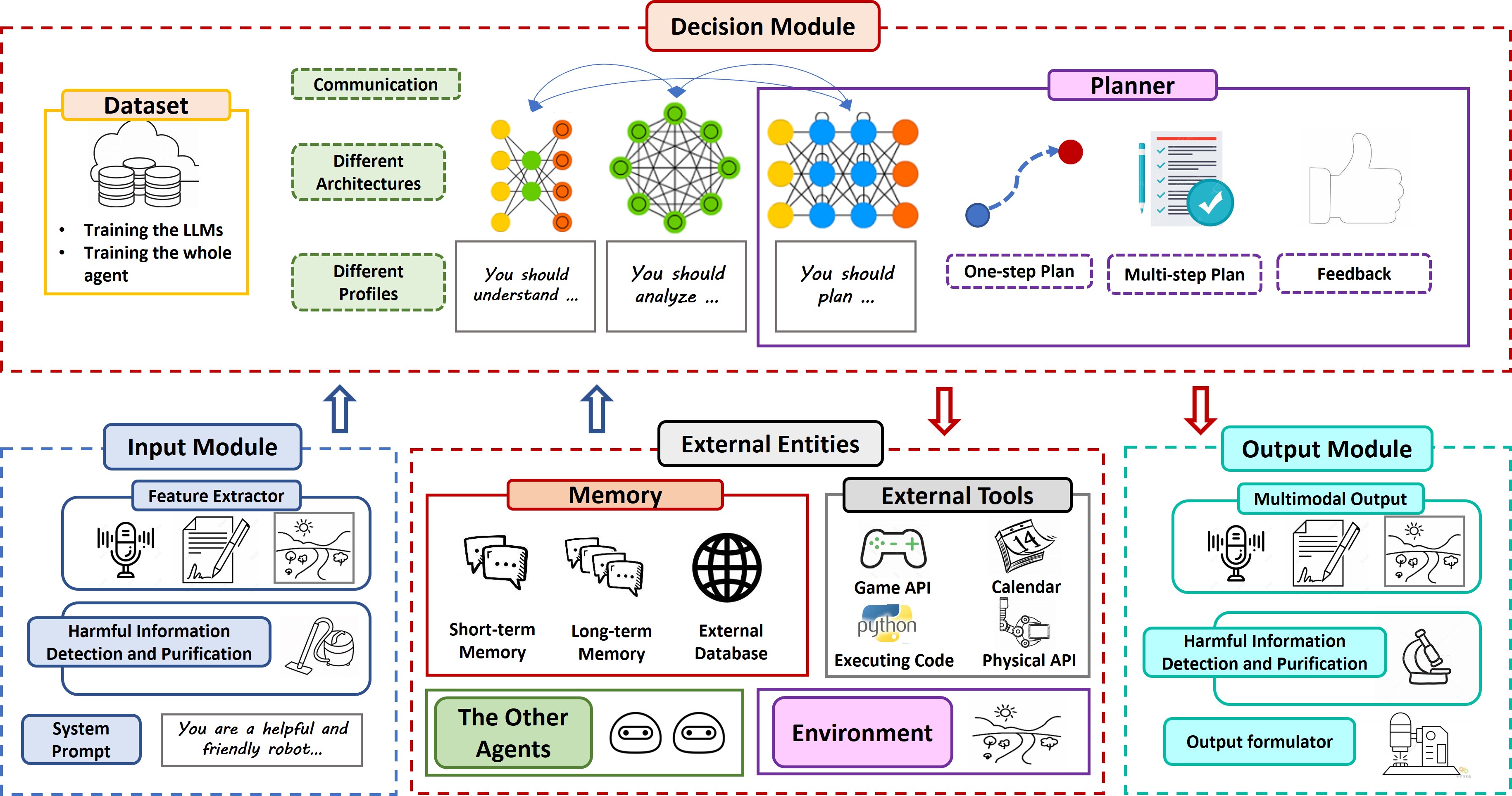

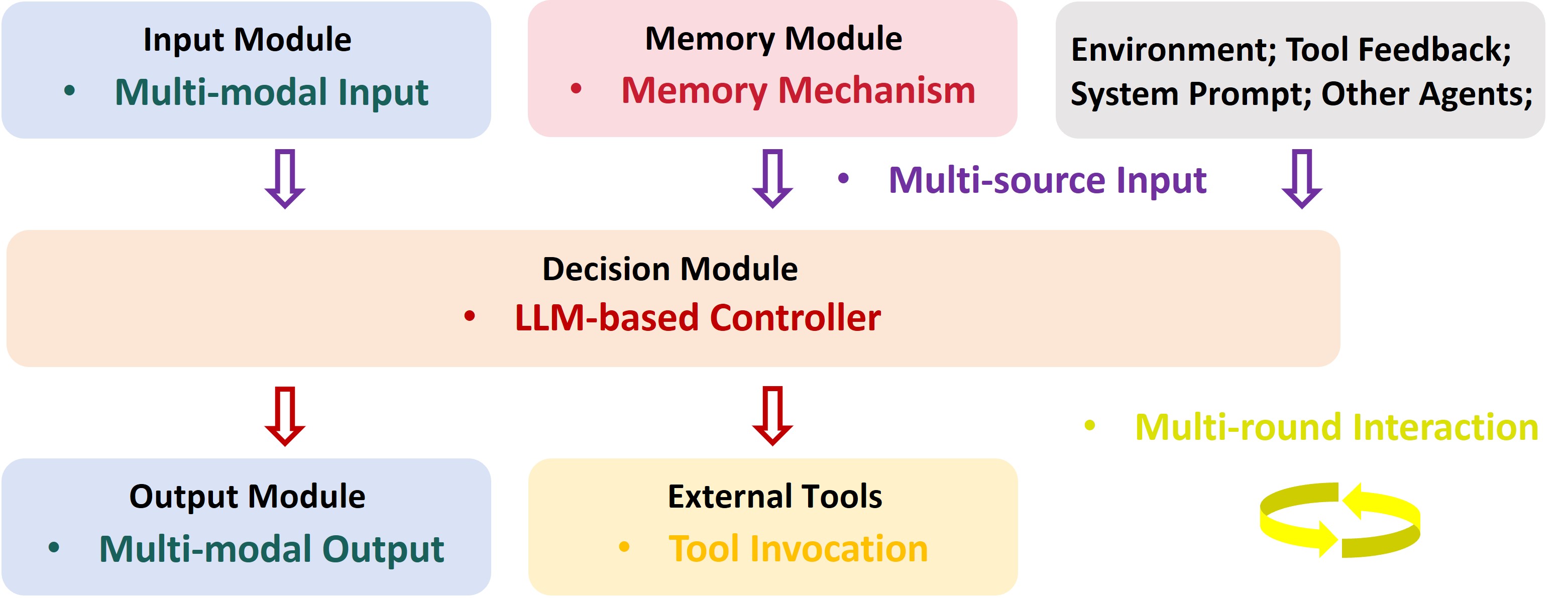

技术框架:论文首先识别了LLM Agent的六个关键特征,这些特征决定了Agent的行为和能力。然后,基于这些特征,论文构建了一个新的威胁分类框架,该框架将威胁按照来源和影响进行分类。威胁来源包括数据、模型、代码等,威胁影响包括安全、隐私、伦理等方面。此外,论文还选择了四个具有代表性的LLM Agent作为案例研究,分析它们在实际应用中可能面临的风险。

关键创新:该论文的关键创新在于提出了基于来源和影响的威胁分类框架。与传统的分类方法相比,该框架能够更全面、更深入地分析LLM Agent面临的风险。传统的分类方法通常只关注威胁的表面现象,而忽略了威胁的根本原因和潜在后果。该框架通过分析威胁的来源和影响,可以更好地理解威胁的本质,从而更有效地应对这些威胁。

关键设计:论文的关键设计包括:1) 识别LLM Agent的六个关键特征;2) 构建基于来源和影响的威胁分类框架;3) 选择四个具有代表性的LLM Agent作为案例研究;4) 从数据、方法和策略三个方面提出了未来的研究方向。这些设计共同构成了论文的核心内容,为LLM Agent的安全研究提供了重要的参考。

🖼️ 关键图片

📊 实验亮点

论文提出了基于来源和影响的新型威胁分类框架,能够更全面地分析LLM Agent面临的风险。通过对四个代表性Agent的案例研究,揭示了实际应用中存在的安全漏洞和隐私风险。此外,论文还从数据、方法和策略三个方面提出了未来的研究方向,为LLM Agent的安全研究提供了重要的指导。

🎯 应用场景

该研究成果可应用于提升LLM Agent的安全性、隐私性和伦理性,例如在智能客服、自动驾驶、金融风控等领域。通过识别和缓解LLM Agent面临的各种威胁,可以提高其可靠性和可信度,从而促进LLM Agent的广泛应用。此外,该研究还可以为相关政策制定提供参考,促进LLM Agent的健康发展。

📄 摘要(原文)

With the continuous development of large language models (LLMs), transformer-based models have made groundbreaking advances in numerous natural language processing (NLP) tasks, leading to the emergence of a series of agents that use LLMs as their control hub. While LLMs have achieved success in various tasks, they face numerous security and privacy threats, which become even more severe in the agent scenarios. To enhance the reliability of LLM-based applications, a range of research has emerged to assess and mitigate these risks from different perspectives. To help researchers gain a comprehensive understanding of various risks, this survey collects and analyzes the different threats faced by these agents. To address the challenges posed by previous taxonomies in handling cross-module and cross-stage threats, we propose a novel taxonomy framework based on the sources and impacts. Additionally, we identify six key features of LLM-based agents, based on which we summarize the current research progress and analyze their limitations. Subsequently, we select four representative agents as case studies to analyze the risks they may face in practical use. Finally, based on the aforementioned analyses, we propose future research directions from the perspectives of data, methodology, and policy, respectively.