Programming with AI: Evaluating ChatGPT, Gemini, AlphaCode, and GitHub Copilot for Programmers

作者: Md Kamrul Siam, Huanying Gu, Jerry Q. Cheng

分类: cs.SE, cs.AI

发布日期: 2024-11-14

备注: 8 pages

💡 一句话要点

评估ChatGPT、Gemini、AlphaCode和GitHub Copilot在编程任务中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: AI编程助手 代码生成 自然语言处理 性能评估 大型语言模型

📋 核心要点

- AI模型在软件开发中扮演关键角色,但现有模型在不同编程语言和任务上的性能存在差异。

- 本研究通过对比评估多个主流编程助手,旨在揭示它们在代码生成和自然语言处理方面的优缺点。

- 评估结果强调了现有模型的局限性,并呼吁进一步改进以提升AI编程助手的可靠性和准确性。

📝 摘要(中文)

本研究全面评估了包括ChatGPT、Gemini(Bard AI)、AlphaCode和GitHub Copilot在内的领先编程助手。评估基于自然语言处理和代码生成准确性等任务,涵盖Java、Python和C++等多种编程语言。研究强调了这些模型的优势和劣势,以及进一步改进以提高可靠性和准确性的重要性。尽管这些AI助手在语言理解和代码生成方面表现出高度进展,但也引发了关于伦理考量和负责任使用的讨论。随着时间的推移,开发更精细的AI技术对于在各个领域实现先进解决方案至关重要,尤其是在了解这些模型的复杂特性及其影响的情况下。本研究比较了不同的LLM,并为快速变化的AI模型领域提供了重要反馈,强调了伦理开发实践对于实现AI模型全部潜力的必要性。

🔬 方法详解

问题定义:论文旨在评估当前主流的AI编程助手(ChatGPT、Gemini、AlphaCode、GitHub Copilot)在实际编程任务中的表现。现有方法的痛点在于缺乏对这些模型在不同编程语言和任务上的系统性、全面的评估,难以指导开发者选择合适的工具,也无法为模型改进提供有效反馈。

核心思路:论文的核心思路是通过设计一系列编程任务,涵盖自然语言处理和代码生成等关键能力,在多种编程语言(Java、Python、C++)上对这些AI编程助手进行测试,从而量化评估它们的性能,并分析其优势和劣势。

技术框架:该研究没有提出新的技术框架,而是采用了一种benchmark式的评估方法。主要流程包括:1) 选择待评估的AI编程助手;2) 设计包含自然语言处理和代码生成任务的测试集;3) 在Java、Python和C++等编程语言上执行测试;4) 收集和分析测试结果,对比不同模型的性能。

关键创新:本研究的创新点在于对当前主流AI编程助手进行了全面的对比评估,揭示了它们在不同编程语言和任务上的性能差异,为开发者选择合适的工具提供了参考,也为模型改进提供了方向。

关键设计:论文的关键设计在于测试任务的设计,需要确保任务能够有效评估AI编程助手的自然语言理解和代码生成能力,并且覆盖多种编程语言。具体的参数设置、损失函数、网络结构等技术细节取决于被评估的AI编程助手本身,论文侧重于评估结果的分析和比较。

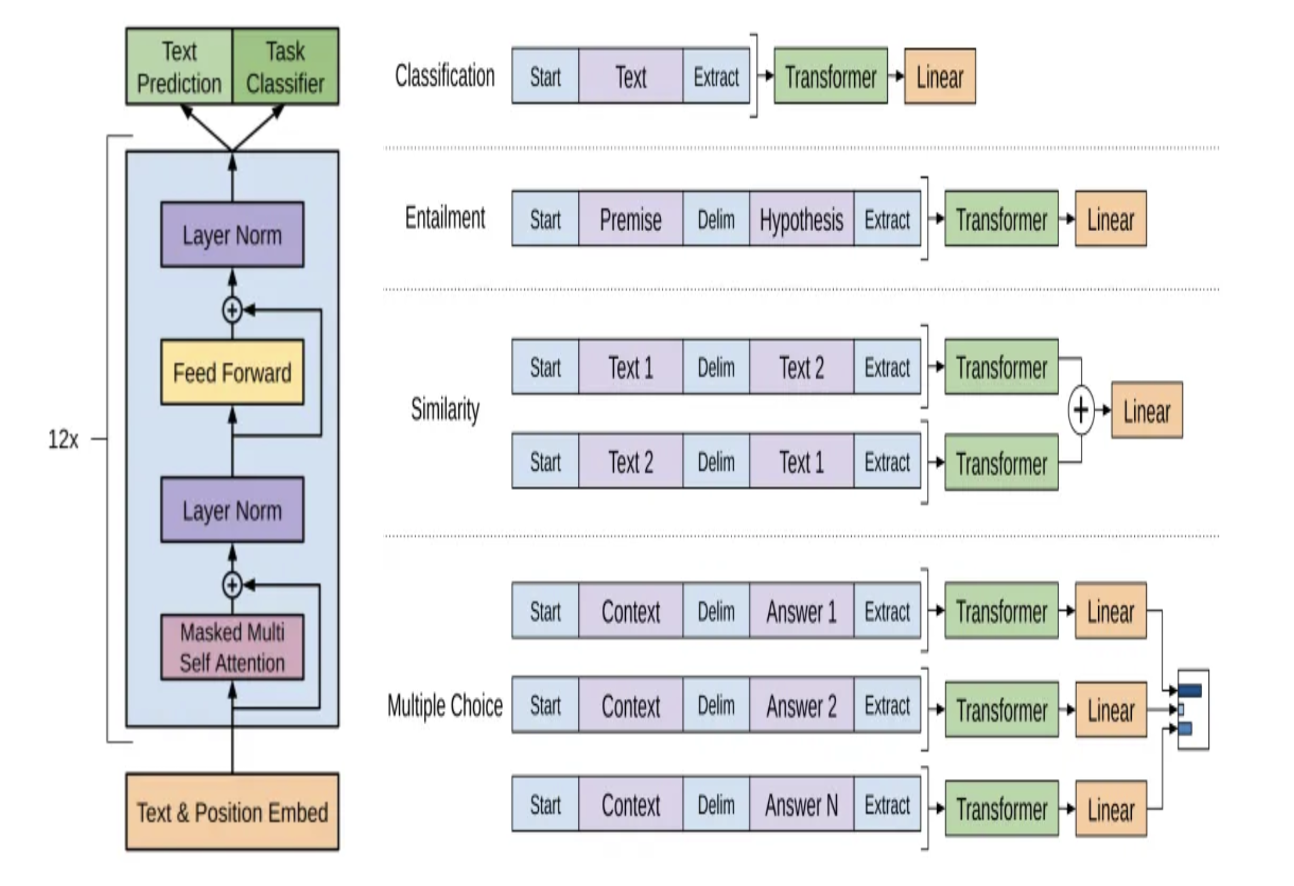

🖼️ 关键图片

📊 实验亮点

研究结果表明,不同的AI编程助手在不同的编程语言和任务上表现出不同的优势和劣势。例如,某些模型可能在Python代码生成方面表现出色,但在Java代码处理方面存在不足。该研究强调了进一步改进这些模型以提高其可靠性和准确性的重要性,并为未来的研究方向提供了指导。

🎯 应用场景

该研究结果可应用于软件开发领域,帮助开发者选择合适的AI编程助手,提高开发效率和代码质量。同时,该研究也为AI编程助手的进一步改进提供了方向,促进AI技术在软件工程领域的更广泛应用。未来,更强大的AI编程助手有望实现自动化代码生成、错误检测和代码优化等功能。

📄 摘要(原文)

Our everyday lives now heavily rely on artificial intelligence (AI) powered large language models (LLMs). Like regular users, programmers are also benefiting from the newest large language models. In response to the critical role that AI models play in modern software development, this study presents a thorough evaluation of leading programming assistants, including ChatGPT, Gemini(Bard AI), AlphaCode, and GitHub Copilot. The evaluation is based on tasks like natural language processing and code generation accuracy in different programming languages like Java, Python and C++. Based on the results, it has emphasized their strengths and weaknesses and the importance of further modifications to increase the reliability and accuracy of the latest popular models. Although these AI assistants illustrate a high level of progress in language understanding and code generation, along with ethical considerations and responsible usage, they provoke a necessity for discussion. With time, developing more refined AI technology is essential for achieving advanced solutions in various fields, especially with the knowledge of the feature intricacies of these models and their implications. This study offers a comparison of different LLMs and provides essential feedback on the rapidly changing area of AI models. It also emphasizes the need for ethical developmental practices to actualize AI models' full potential.