Liner Shipping Network Design with Reinforcement Learning

作者: Utsav Dutta, Yifan Lin, Zhaoyang Larry Jin

分类: cs.AI

发布日期: 2024-11-13

💡 一句话要点

提出基于强化学习的班轮运输网络设计方法,优化航运路线

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture)

关键词: 强化学习 班轮运输网络设计 组合优化 多商品流 航运 物流优化 网络设计

📋 核心要点

- 班轮运输网络设计问题(LSNDP)是复杂的组合优化问题,传统方法依赖分解和启发式算法,难以获得全局最优解。

- 论文提出一种基于强化学习的LSNDP求解框架,直接在网络设计上应用强化学习,并结合启发式算法处理多商品流问题。

- 实验表明,该方法在LINERLIB基准测试中表现出竞争力,并且在经过扰动的数据集训练后,仍具备良好的泛化能力。

📝 摘要(中文)

本文提出了一种新颖的强化学习框架,用于解决班轮运输网络设计问题(LSNDP),这是一个具有挑战性的组合优化问题,专注于设计具有成本效益的海运航线。 传统上,解决LSNDP的方法通常将问题分解为子问题,例如网络设计和多商品流,然后使用近似启发式算法或大型邻域搜索(LNS)技术来解决这些子问题。 相比之下,我们的方法在网络设计上采用无模型的强化学习算法,并结合基于启发式的多商品流求解器,从而在公开的LINERLIB基准测试中产生有竞争力的结果。 此外,我们的方法还通过在经过扰动的实例上训练后,在基准实例上产生有竞争力的解决方案,从而展示了泛化能力。

🔬 方法详解

问题定义:论文旨在解决班轮运输网络设计问题(LSNDP),即如何设计成本效益高的海运航线。现有方法通常将问题分解为网络设计和多商品流两个子问题,并采用启发式算法或大型邻域搜索等近似方法求解,这些方法难以保证全局最优性,且计算复杂度较高。

核心思路:论文的核心思路是利用强化学习直接优化网络设计。强化学习能够通过与环境的交互学习策略,避免了传统方法中复杂的分解和启发式设计过程。通过将网络设计视为强化学习中的动作空间,可以学习到更优的航线网络。

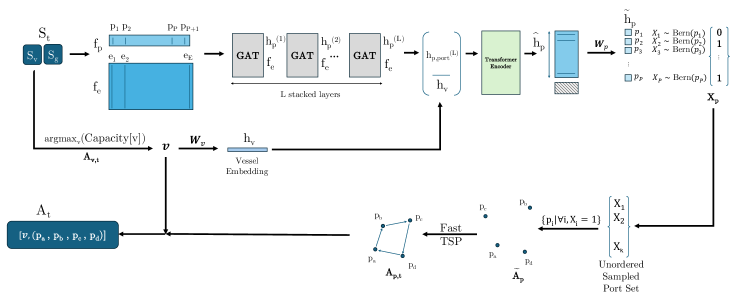

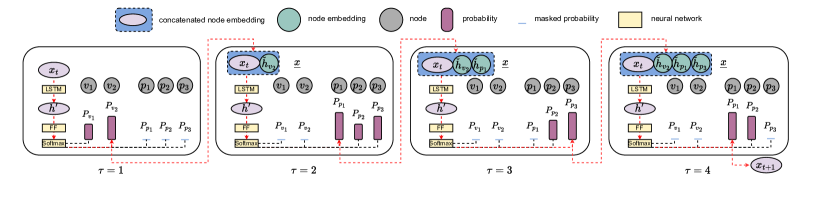

技术框架:整体框架包含两个主要模块:基于强化学习的网络设计模块和基于启发式的多商品流求解模块。首先,强化学习智能体根据当前状态(例如,港口需求和网络拓扑)选择航线网络设计方案。然后,使用启发式算法求解多商品流问题,评估该网络设计方案的成本。最后,根据成本反馈,强化学习智能体更新策略,从而学习到更优的网络设计方案。

关键创新:最重要的技术创新在于将强化学习应用于班轮运输网络设计问题,避免了传统方法中对问题的分解和启发式算法的设计。通过强化学习,可以直接学习到更优的网络设计策略,并且能够适应不同的环境和需求。此外,该方法还展示了良好的泛化能力,可以在未见过的实例上产生有竞争力的结果。

关键设计:论文采用无模型的强化学习算法,具体算法细节未知。多商品流求解器采用启发式算法,具体算法细节未知。状态空间的设计需要考虑港口需求、网络拓扑等因素。奖励函数的设计需要能够反映网络设计的成本效益,例如,可以使用总运输成本作为负奖励。

🖼️ 关键图片

📊 实验亮点

该方法在公开的LINERLIB基准测试中取得了有竞争力的结果,表明了其有效性。更重要的是,该方法在经过扰动的数据集训练后,仍然能够在原始基准测试集上表现良好,展示了其良好的泛化能力。具体的性能数据和提升幅度未知。

🎯 应用场景

该研究成果可应用于实际的班轮运输网络设计,帮助航运公司优化航线,降低运营成本,提高运输效率。此外,该方法还可以扩展到其他物流网络设计问题,例如铁路运输网络和航空运输网络等,具有广泛的应用前景。

📄 摘要(原文)

This paper proposes a novel reinforcement learning framework to address the Liner Shipping Network Design Problem (LSNDP), a challenging combinatorial optimization problem focused on designing cost-efficient maritime shipping routes. Traditional methods for solving the LSNDP typically involve decomposing the problem into sub-problems, such as network design and multi-commodity flow, which are then tackled using approximate heuristics or large neighborhood search (LNS) techniques. In contrast, our approach employs a model-free reinforcement learning algorithm on the network design, integrated with a heuristic-based multi-commodity flow solver, to produce competitive results on the publicly available LINERLIB benchmark. Additionally, our method also demonstrates generalization capabilities by producing competitive solutions on the benchmark instances after training on perturbed instances.