LogLLM: Log-based Anomaly Detection Using Large Language Models

作者: Wei Guan, Jian Cao, Shiyou Qian, Jianqi Gao, Chun Ouyang

分类: cs.SE, cs.AI

发布日期: 2024-11-13 (更新: 2025-04-14)

💡 一句话要点

提出LogLLM框架,利用大语言模型进行日志异常检测,提升软件系统可靠性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 日志异常检测 大语言模型 BERT Llama 自然语言处理 软件可靠性 Transformer

📋 核心要点

- 传统深度学习方法难以捕捉日志数据中嵌入的自然语言语义信息,限制了日志异常检测的准确性。

- LogLLM框架利用BERT和Llama等大型语言模型,结合投影器对齐向量空间,实现对日志语义的有效理解和异常分类。

- 实验结果表明,LogLLM在多个数据集上优于现有方法,即使面对不稳定的日志数据也能准确检测异常。

📝 摘要(中文)

本文提出了一种基于大语言模型(LLM)的日志异常检测框架LogLLM。该框架利用BERT提取日志消息的语义向量,并使用基于Transformer解码器的Llama模型对日志序列进行分类。此外,引入了一个投影器来对齐BERT和Llama的向量表示空间,确保对日志语义的连贯理解。与需要日志解析器提取模板的传统方法不同,LogLLM使用正则表达式预处理日志消息,简化了整个流程。该框架通过一种新颖的三阶段训练过程进行训练,旨在提高性能和适应性。在四个公共数据集上的实验结果表明,LogLLM优于最先进的方法。即使在处理不稳定的日志时,它也能有效地捕获日志消息的语义含义并准确地检测异常。

🔬 方法详解

问题定义:论文旨在解决软件系统中基于日志的异常检测问题。现有方法,特别是传统的深度学习方法,难以有效捕捉日志数据中蕴含的自然语言语义信息,导致异常检测的准确率不高。此外,许多方法依赖于日志解析器提取模板,增加了预处理的复杂性,且解析器的性能会直接影响后续检测效果。

核心思路:论文的核心思路是利用大型语言模型(LLM)强大的语义理解能力,直接从原始日志消息中提取语义信息,并进行异常检测。通过结合BERT的语义向量提取能力和Llama的序列分类能力,LogLLM能够更准确地识别日志中的异常模式。同时,避免了对日志解析器的依赖,简化了流程。

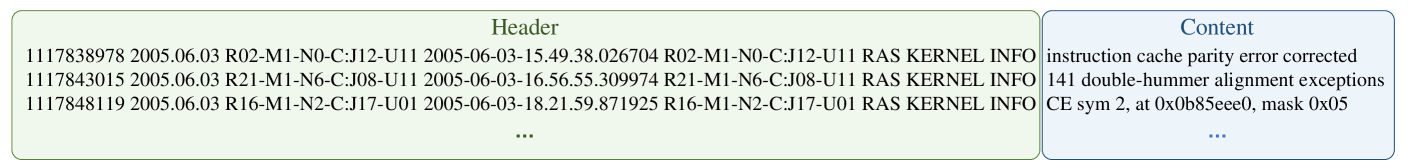

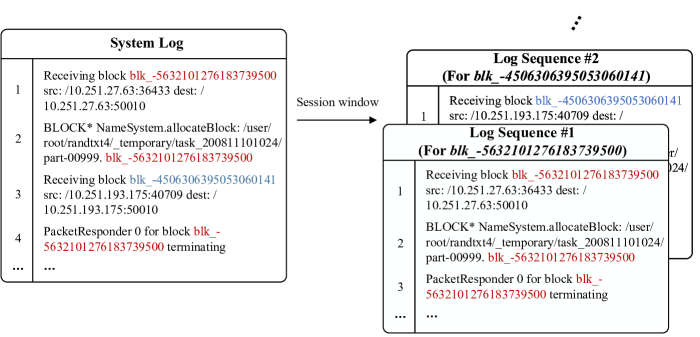

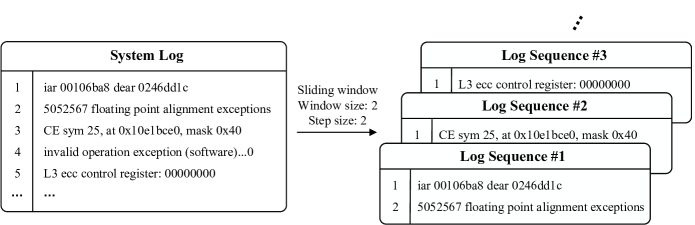

技术框架:LogLLM框架主要包含三个模块:日志预处理模块、语义向量提取模块和序列分类模块。首先,日志预处理模块使用正则表达式对原始日志消息进行清洗和标准化。然后,语义向量提取模块使用BERT模型将预处理后的日志消息转换为语义向量。接着,序列分类模块使用Llama模型对日志序列进行分类,判断是否存在异常。为了对齐BERT和Llama的向量表示空间,框架还引入了一个投影器。整个框架采用三阶段训练过程:第一阶段预训练BERT和Llama,第二阶段训练投影器,第三阶段微调整个模型。

关键创新:LogLLM的关键创新在于将大型语言模型应用于日志异常检测,并设计了一个有效的框架来整合不同的LLM。与传统方法相比,LogLLM能够更准确地捕捉日志消息的语义信息,并且不需要依赖日志解析器。此外,三阶段训练过程也提高了模型的性能和适应性。

关键设计:LogLLM的关键设计包括:1) 使用BERT作为语义向量提取器,利用其强大的自然语言理解能力;2) 使用Llama作为序列分类器,利用其Transformer解码器结构进行序列建模;3) 引入投影器对齐BERT和Llama的向量空间,确保语义一致性;4) 设计三阶段训练过程,逐步优化模型性能。具体参数设置和损失函数细节在论文中未明确给出,属于未知信息。

🖼️ 关键图片

📊 实验亮点

LogLLM在四个公共数据集上的实验结果表明,其性能优于现有的最先进方法。具体性能数据和提升幅度在论文中未明确给出,属于未知信息。但论文强调,即使在处理不稳定的日志时,LogLLM也能有效地捕获日志消息的语义含义并准确地检测异常。

🎯 应用场景

LogLLM可应用于各种软件系统的日志异常检测,例如云计算平台、数据库系统、操作系统等。通过及时发现系统异常,可以减少系统故障,提高系统可用性和可靠性,降低运维成本。该研究的成果有助于构建更智能、更可靠的软件系统。

📄 摘要(原文)

Software systems often record important runtime information in logs to help with troubleshooting. Log-based anomaly detection has become a key research area that aims to identify system issues through log data, ultimately enhancing the reliability of software systems. Traditional deep learning methods often struggle to capture the semantic information embedded in log data, which is typically organized in natural language. In this paper, we propose LogLLM, a log-based anomaly detection framework that leverages large language models (LLMs). LogLLM employs BERT for extracting semantic vectors from log messages, while utilizing Llama, a transformer decoder-based model, for classifying log sequences. Additionally, we introduce a projector to align the vector representation spaces of BERT and Llama, ensuring a cohesive understanding of log semantics. Unlike conventional methods that require log parsers to extract templates, LogLLM preprocesses log messages with regular expressions, streamlining the entire process. Our framework is trained through a novel three-stage procedure designed to enhance performance and adaptability. Experimental results across four public datasets demonstrate that LogLLM outperforms state-of-the-art methods. Even when handling unstable logs, it effectively captures the semantic meaning of log messages and detects anomalies accurately.