Automatically Detecting Online Deceptive Patterns

作者: Asmit Nayak, Shirley Zhang, Yash Wani, Rishabh Khandelwal, Kassem Fawaz

分类: cs.HC, cs.AI, cs.CY

发布日期: 2024-11-11 (更新: 2025-11-20)

💡 一句话要点

提出AutoBot框架,通过视觉模型和LLM自动检测网页欺骗性模式。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 欺骗性模式检测 计算机视觉 自然语言处理 大型语言模型 知识蒸馏

📋 核心要点

- 现有方法难以有效识别和缓解网页中普遍存在的欺骗性模式,缺乏可用且可扩展的解决方案。

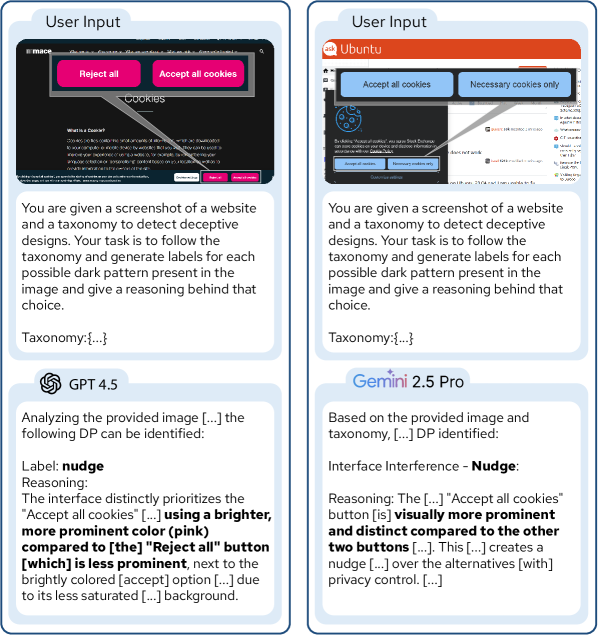

- AutoBot框架通过视觉模型分析网页截图,结合大型语言模型理解上下文,从而检测欺骗性模式。

- 实验结果表明,AutoBot在检测欺骗性模式方面表现出色,F1分数达到0.93,具有实际应用潜力。

📝 摘要(中文)

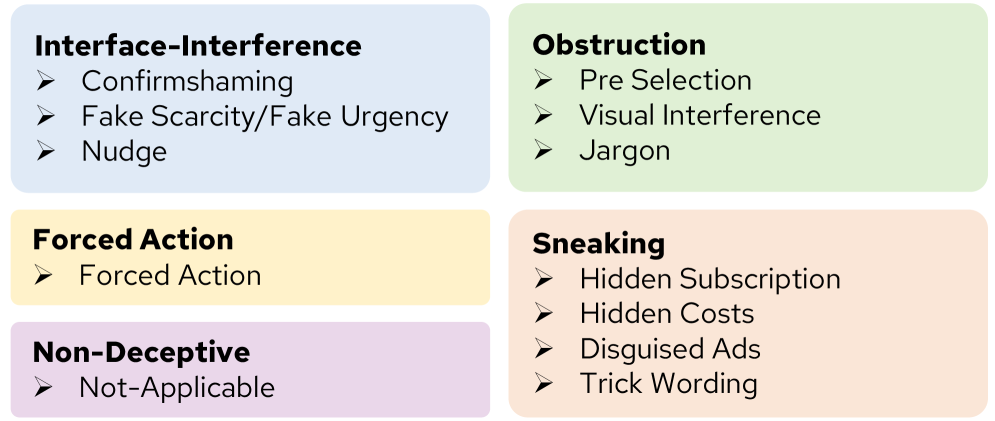

数字界面中的欺骗性模式会操纵用户做出非预期的决策,利用认知偏差和心理弱点。这些模式在各种数字平台上变得无处不在。虽然从法律和技术角度已经出现了一些缓解欺骗性模式的努力,但在创建可用和可扩展的解决方案方面仍然存在显著差距。我们介绍了AutoBot框架来解决这一差距,并帮助Web利益相关者导航和缓解在线欺骗性模式。AutoBot能够准确地从网站的屏幕截图中识别和定位欺骗性模式,而无需依赖底层的HTML代码。AutoBot采用两阶段流程,利用专用视觉模型的功能来分析网站屏幕截图,识别交互元素,并提取文本特征。接下来,使用大型语言模型,AutoBot理解这些元素周围的上下文,以确定是否存在欺骗性模式。我们还使用AutoBot创建一个合成数据集,以将知识从“教师”LLM提炼到较小的语言模型。通过广泛的评估,我们证明了AutoBot在检测Web上的欺骗性模式方面的有效性,在检测欺骗性模式时实现了0.93的F1分数,突显了其作为缓解在线欺骗性模式的重要工具的潜力。我们在针对不同Web利益相关者的三个下游应用程序中实施了AutoBot:(1)一个本地浏览器扩展,为用户提供实时反馈,(2)一个Lighthouse审计,告知开发人员其网站上潜在的欺骗性模式,以及(3)一个为研究人员和监管机构设计的测量工具。

🔬 方法详解

问题定义:论文旨在解决网页上欺骗性模式自动检测的问题。现有方法通常依赖于HTML代码分析,难以处理动态网页和复杂布局,且可扩展性差。人工检测成本高昂且效率低下。

核心思路:论文的核心思路是利用计算机视觉技术直接分析网页截图,结合自然语言处理技术理解网页元素的上下文信息,从而识别欺骗性模式。这种方法无需依赖HTML代码,能够处理各种复杂的网页布局和动态内容。

技术框架:AutoBot框架包含两个主要阶段:1) 视觉分析阶段:使用专门的视觉模型(具体模型未知)分析网页截图,识别交互元素(如按钮、链接、表单等),并提取文本特征。2) 语义理解阶段:使用大型语言模型(LLM,具体模型未知)理解交互元素周围的上下文信息,判断是否存在欺骗性模式。此外,论文还使用AutoBot生成合成数据集,用于知识蒸馏,将大型LLM的知识迁移到小型语言模型。

关键创新:AutoBot的关键创新在于将计算机视觉和自然语言处理技术相结合,实现网页欺骗性模式的自动检测。与传统方法相比,AutoBot无需依赖HTML代码,具有更强的鲁棒性和可扩展性。此外,利用合成数据进行知识蒸馏,降低了对大型标注数据集的依赖。

关键设计:论文中关于视觉模型的选择、LLM的具体架构、以及知识蒸馏的具体方法等关键设计细节未详细说明。损失函数和网络结构等技术细节也未知。合成数据集的生成方式也需要进一步了解。

🖼️ 关键图片

📊 实验亮点

AutoBot在检测网页欺骗性模式方面取得了显著成果,F1分数达到0.93。该结果表明,AutoBot能够有效地识别各种欺骗性模式,具有很高的实用价值。论文未明确指出与哪些基线方法进行了对比,因此无法量化具体的性能提升幅度。但0.93的F1分数本身就证明了AutoBot的有效性。

🎯 应用场景

AutoBot具有广泛的应用前景,可用于开发浏览器插件,为用户提供实时欺骗性模式检测;集成到Lighthouse等开发者工具中,帮助开发者识别和修复网站中的欺骗性模式;还可以作为研究工具,用于大规模测量和分析互联网上的欺骗性模式,为监管机构提供决策支持。该研究有助于提升用户体验,保护用户权益,构建更安全、更透明的互联网环境。

📄 摘要(原文)

Deceptive patterns in digital interfaces manipulate users into making unintended decisions, exploiting cognitive biases and psychological vulnerabilities. These patterns have become ubiquitous on various digital platforms. While efforts to mitigate deceptive patterns have emerged from legal and technical perspectives, a significant gap remains in creating usable and scalable solutions. We introduce our AutoBot framework to address this gap and help web stakeholders navigate and mitigate online deceptive patterns. AutoBot accurately identifies and localizes deceptive patterns from a screenshot of a website without relying on the underlying HTML code. AutoBot employs a two-stage pipeline that leverages the capabilities of specialized vision models to analyze website screenshots, identify interactive elements, and extract textual features. Next, using a large language model, AutoBot understands the context surrounding these elements to determine the presence of deceptive patterns. We also use AutoBot, to create a synthetic dataset to distill knowledge from 'teacher' LLMs to smaller language models. Through extensive evaluation, we demonstrate AutoBot's effectiveness in detecting deceptive patterns on the web, achieving an F1-score of 0.93 when detecting deceptive patterns, underscoring its potential as an essential tool for mitigating online deceptive patterns. We implement AutoBot, across three downstream applications targeting different web stakeholders: (1) a local browser extension providing users with real-time feedback, (2) a Lighthouse audit to inform developers of potential deceptive patterns on their sites, and (3) as a measurement tool designed for researchers and regulators.