Mitigating Hallucination with ZeroG: An Advanced Knowledge Management Engine

作者: Anantha Sharma, Sheeba Elizabeth John, Fatemeh Rezapoor Nikroo, Krupali Bhatt, Mrunal Zambre, Aditi Wikhe

分类: cs.IR, cs.AI, cs.CL, cs.IT

发布日期: 2024-11-08

备注: 10 pages, 4 figures, 1 table

💡 一句话要点

ZeroG:利用知识管理引擎缓解大语言模型幻觉问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 知识管理 知识蒸馏 大语言模型 幻觉缓解 文档管理

📋 核心要点

- 现有方法在处理复杂文档时,大语言模型容易产生幻觉,且响应时间较长,难以满足高效知识提取的需求。

- ZeroG通过知识蒸馏,利用小模型复制大模型的行为,并结合提示调优,确保生成上下文相关且可靠的回答。

- ZeroG采用黑盒蒸馏,无需中间特征,优化计算效率,提升准确率并缩短响应时间,为文档管理提供平衡方案。

📝 摘要(中文)

数字文档的增长给高效管理和知识提取带来了重大挑战。传统方法在处理复杂文档时常常遇到困难,导致大语言模型(LLM)出现幻觉和响应延迟高等问题。ZeroG是一种创新方法,通过利用知识蒸馏和提示调优来增强模型性能,从而显著缓解这些挑战。ZeroG采用较小的模型来复制较大教师模型的行为,通过采用黑盒蒸馏方法,确保上下文相关且有根据的响应,它创建了一个无需依赖中间特征的蒸馏数据集,从而优化了计算效率。该方法显著提高了准确性并缩短了响应时间,为现代文档管理提供了平衡的解决方案。通过结合先进的文档摄取和元数据利用技术,ZeroG提高了问答系统的准确性。图数据库和强大的元数据管理的集成进一步简化了信息检索,从而可以实现精确且上下文感知的响应。通过改变组织与复杂数据交互的方式,ZeroG增强了生产力和用户体验,为不断增长的数字文档管理需求提供了可扩展的解决方案。

🔬 方法详解

问题定义:论文旨在解决大语言模型在处理复杂文档时产生的幻觉问题,以及传统方法在知识提取方面的效率瓶颈。现有方法难以有效管理和利用文档中的信息,导致模型生成不准确或不相关的答案,同时响应时间较长。

核心思路:ZeroG的核心思路是利用知识蒸馏技术,将大型教师模型的知识迁移到小型学生模型中,从而在保证性能的同时,降低计算成本和延迟。通过提示调优,进一步提升学生模型在特定任务上的表现,使其能够生成上下文相关的可靠答案。

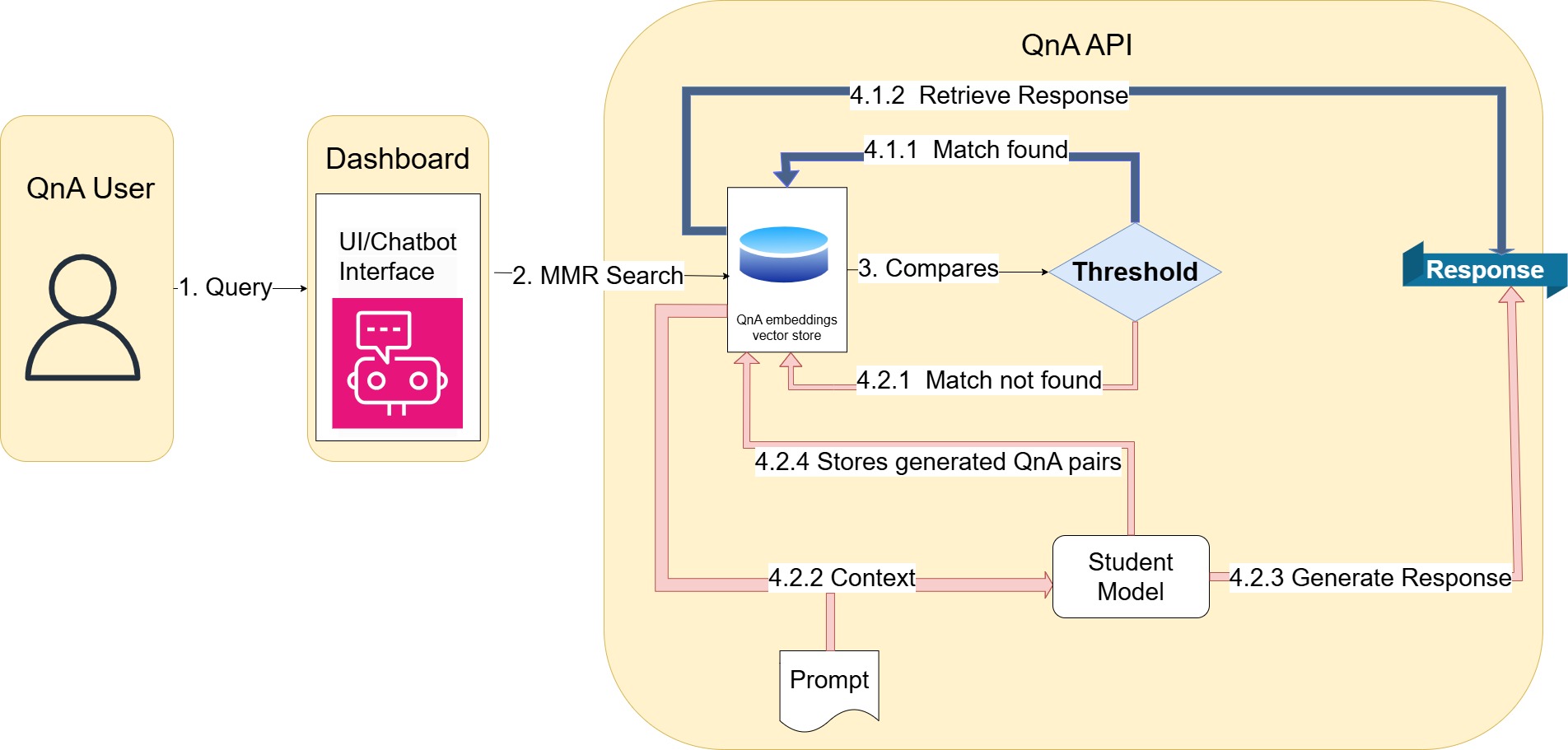

技术框架:ZeroG的技术框架主要包括以下几个阶段:1) 文档摄取:将各种格式的文档导入系统,并提取关键信息和元数据。2) 知识蒸馏:使用黑盒蒸馏方法,训练小型学生模型,使其模仿大型教师模型的行为。3) 提示调优:通过优化提示词,提升学生模型在问答任务中的准确性和相关性。4) 信息检索:利用图数据库和元数据管理,实现高效的信息检索和上下文感知。

关键创新:ZeroG的关键创新在于其黑盒蒸馏方法,该方法无需访问教师模型的内部特征,即可实现有效的知识迁移,降低了计算复杂度。此外,ZeroG还结合了文档摄取、元数据利用和图数据库等技术,构建了一个完整的知识管理引擎,提升了问答系统的准确性和效率。

关键设计:ZeroG采用黑盒蒸馏,具体实现细节未知。提示调优的具体策略未知。图数据库的选择和元数据管理方案未知。

🖼️ 关键图片

📊 实验亮点

论文摘要中提到ZeroG显著提高了准确性并缩短了响应时间,但没有给出具体的性能数据和对比基线。具体的实验结果未知,无法评估提升幅度。

🎯 应用场景

ZeroG可应用于各种需要处理大量复杂文档的场景,例如企业知识库管理、法律文件分析、医学文献检索等。通过提高信息检索的准确性和效率,ZeroG可以帮助用户更快地找到所需信息,提升工作效率,并降低因信息错误而导致的风险。未来,ZeroG有望成为企业和组织构建智能知识管理系统的关键组件。

📄 摘要(原文)

The growth of digital documents presents significant challenges in efficient management and knowledge extraction. Traditional methods often struggle with complex documents, leading to issues such as hallucinations and high latency in responses from Large Language Models (LLMs). ZeroG, an innovative approach, significantly mitigates these challenges by leveraging knowledge distillation and prompt tuning to enhance model performance. ZeroG utilizes a smaller model that replicates the behavior of a larger teacher model, ensuring contextually relevant and grounded responses, by employing a black-box distillation approach, it creates a distilled dataset without relying on intermediate features, optimizing computational efficiency. This method significantly enhances accuracy and reduces response times, providing a balanced solution for modern document management. Incorporating advanced techniques for document ingestion and metadata utilization, ZeroG improves the accuracy of question-and-answer systems. The integration of graph databases and robust metadata management further streamlines information retrieval, allowing for precise and context-aware responses. By transforming how organizations interact with complex data, ZeroG enhances productivity and user experience, offering a scalable solution for the growing demands of digital document management.