Alopex: A Computational Framework for Enabling On-Device Function Calls with LLMs

作者: Yide Ran, Zhaozhuo Xu, Yuhang Yao, Zijian Hu, Shanshan Han, Han Jin, Alay Dilipbhai Shah, Jipeng Zhang, Dimitris Stripelis, Tong Zhang, Salman Avestimehr, Chaoyang He

分类: cs.AI, cs.CL

发布日期: 2024-11-07

💡 一句话要点

Alopex框架通过逻辑数据生成和混合训练,提升设备端LLM函数调用能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 设备端LLM 函数调用 数据生成 灾难性遗忘 微调 数据混合 逻辑规则

📋 核心要点

- 现有设备端LLM函数调用面临数据稀缺、问题格式不佳和灾难性遗忘等挑战。

- Alopex框架通过逻辑生成高质量数据,采用“描述-问题-输出”格式微调,并混合数据缓解遗忘。

- 实验表明Alopex显著提升函数调用准确率,并有效降低灾难性遗忘现象。

📝 摘要(中文)

大型语言模型(LLMs)的快速发展使其越来越多地集成到移动设备中,以实现个性化辅助,这使得LLMs能够调用外部API函数来增强其性能。然而,数据稀缺、问题格式无效以及灾难性遗忘等挑战阻碍了设备端LLM代理的发展。为了解决这些问题,我们提出了Alopex,一个框架,它可以使用Fox LLM实现精确的设备端函数调用。Alopex引入了一种基于逻辑的方法来生成高质量的训练数据,以及一种新颖的“描述-问题-输出”格式进行微调,从而降低了函数信息泄露的风险。此外,使用数据混合策略来减轻灾难性遗忘,将函数调用数据与教科书数据集相结合,以提高各种任务的性能。实验结果表明,Alopex提高了函数调用准确性,并显著减少了灾难性遗忘,为将函数调用能力集成到LLMs中提供了一个强大的解决方案,无需人工干预。

🔬 方法详解

问题定义:论文旨在解决设备端LLM进行函数调用时面临的挑战,包括训练数据不足、问题格式不合理以及灾难性遗忘问题。现有方法通常依赖人工标注数据,成本高昂且难以覆盖所有可能的函数调用场景。此外,直接使用函数信息进行训练容易导致信息泄露,影响模型的泛化能力。灾难性遗忘是指模型在学习新任务时,忘记之前学习过的知识,这在持续学习的场景下是一个严重的问题。

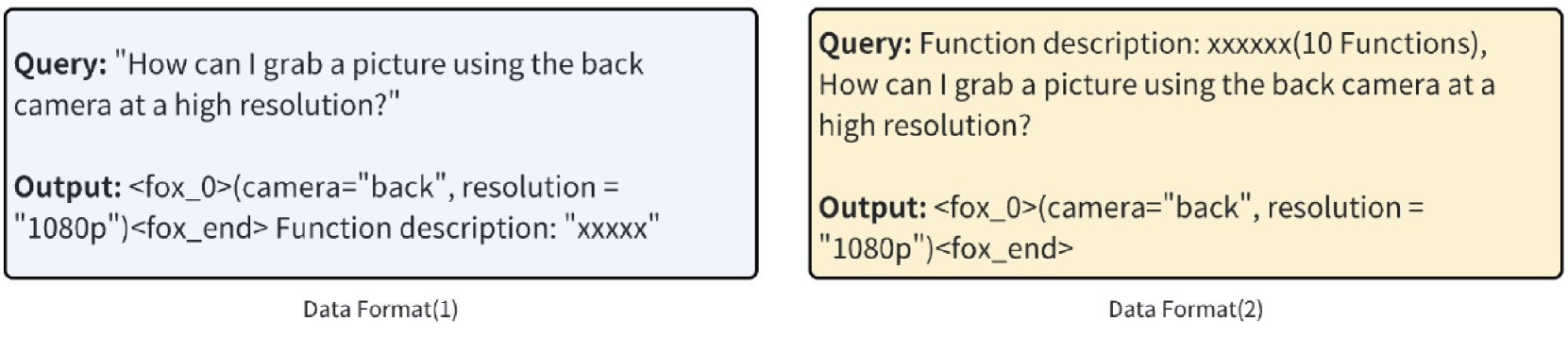

核心思路:Alopex框架的核心思路是利用逻辑规则自动生成高质量的训练数据,并采用一种新的数据格式来避免函数信息泄露。通过将函数描述、问题和输出结合起来,模型可以学习到函数调用的逻辑关系,而无需直接接触敏感的函数信息。此外,Alopex还采用数据混合策略,将函数调用数据与通用知识数据结合起来训练,以减轻灾难性遗忘。

技术框架:Alopex框架主要包含三个模块:数据生成模块、微调模块和数据混合模块。数据生成模块使用逻辑规则自动生成函数调用训练数据。微调模块使用“描述-问题-输出”格式对LLM进行微调,使其具备函数调用能力。数据混合模块将函数调用数据与通用知识数据混合,以减轻灾难性遗忘。整体流程是首先使用数据生成模块生成训练数据,然后使用微调模块对LLM进行微调,最后使用数据混合模块进行进一步的训练。

关键创新:Alopex框架的关键创新在于其数据生成方法和数据格式。传统方法依赖人工标注数据,而Alopex使用逻辑规则自动生成数据,大大降低了成本。此外,“描述-问题-输出”格式可以有效避免函数信息泄露,提高模型的安全性。数据混合策略也是一个重要的创新,它可以有效减轻灾难性遗忘,提高模型的泛化能力。

关键设计:在数据生成模块中,需要设计合适的逻辑规则来生成高质量的训练数据。在微调模块中,需要选择合适的LLM和微调参数。在数据混合模块中,需要确定函数调用数据和通用知识数据的比例。论文中可能还涉及损失函数的设计,例如使用交叉熵损失函数来训练模型。具体的网络结构取决于所选择的LLM,但通常会使用Transformer架构。

🖼️ 关键图片

📊 实验亮点

实验结果表明,Alopex框架在函数调用准确率方面取得了显著提升,并且有效降低了灾难性遗忘。具体而言,Alopex在函数调用准确率方面超越了现有基线方法,并且在持续学习场景下,能够更好地保持之前学习的知识。具体的性能数据和提升幅度需要在论文中查找。

🎯 应用场景

Alopex框架可广泛应用于智能助手、自动化客服、物联网设备控制等领域。通过赋予设备端LLM函数调用能力,可以实现更智能、更个性化的服务。例如,用户可以通过语音指令控制智能家居设备,或者通过自然语言查询天气信息。该研究有助于推动设备端AI的发展,降低对云端计算的依赖,提高用户隐私和数据安全。

📄 摘要(原文)

The rapid advancement of Large Language Models (LLMs) has led to their increased integration into mobile devices for personalized assistance, which enables LLMs to call external API functions to enhance their performance. However, challenges such as data scarcity, ineffective question formatting, and catastrophic forgetting hinder the development of on-device LLM agents. To tackle these issues, we propose Alopex, a framework that enables precise on-device function calls using the Fox LLM. Alopex introduces a logic-based method for generating high-quality training data and a novel ``description-question-output'' format for fine-tuning, reducing risks of function information leakage. Additionally, a data mixing strategy is used to mitigate catastrophic forgetting, combining function call data with textbook datasets to enhance performance in various tasks. Experimental results show that Alopex improves function call accuracy and significantly reduces catastrophic forgetting, providing a robust solution for integrating function call capabilities into LLMs without manual intervention.