To Ask or Not to Ask? Detecting Absence of Information in Vision and Language Navigation

作者: Savitha Sam Abraham, Sourav Garg, Feras Dayoub

分类: cs.AI, cs.CV

发布日期: 2024-11-06

备注: Accepted at WACV 2025

💡 一句话要点

提出基于注意力机制的指令模糊度估计模块,提升视觉语言导航中智能体的询问能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言导航 指令模糊度估计 注意力机制 人机协作 智能体询问能力

📋 核心要点

- 现有视觉语言导航智能体缺乏在指令不完整时提出澄清问题的能力,导致效率降低。

- 论文提出基于注意力机制的指令模糊度估计模块,学习指令和智能体轨迹的关联,判断信息缺失。

- 实验结果表明,该模块在精确率-召回率平衡方面提升约52%,有效提升了智能体的导航能力。

📝 摘要(中文)

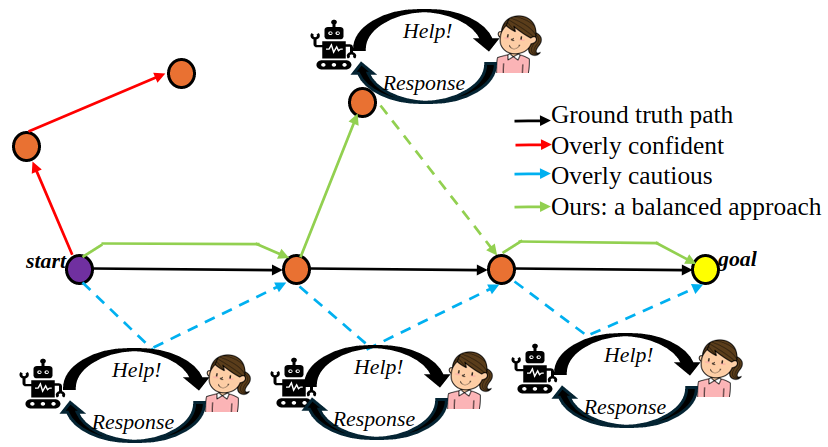

本文针对视觉语言导航(VLN)中智能体缺乏询问能力的问题,提出了一种识别“何时”缺乏足够信息的方法,而非关注“缺少什么”。该方法旨在提升智能体在指令模糊情况下的效率,减少不必要的探索并及时寻求帮助。识别不确定性的挑战在于平衡过度谨慎(高召回率)和过度自信(高精确率)。为此,我们提出了一个基于注意力机制的指令模糊度估计模块,该模块学习指令和智能体轨迹之间的关联。通过在训练期间利用指令到路径的对齐信息,该模块的模糊度估计性能在精确率-召回率平衡方面提高了约52%。消融实验表明,将该指令到路径的注意力网络与导航模块中的跨模态注意力网络相结合是有效的。结果表明,指令到路径注意力网络的注意力分数可以更好地指示模糊度。

🔬 方法详解

问题定义:现有视觉语言导航(VLN)智能体在面对模糊或不完整的指令时,缺乏主动询问以获取更多信息的能力。这导致智能体可能在错误的方向上探索,浪费时间和资源,最终影响导航效率。因此,如何让智能体识别自身缺乏足够信息,从而主动寻求帮助,是本文要解决的核心问题。现有方法主要关注如何更好地理解指令和环境,而忽略了智能体“何时”应该提问的能力。

核心思路:本文的核心思路是训练一个指令模糊度估计模块,使其能够判断当前指令是否足够清晰,足以指导智能体完成导航任务。该模块通过学习指令和智能体轨迹之间的关联,来评估指令的模糊程度。如果指令模糊度较高,则智能体可以主动寻求帮助,避免盲目探索。

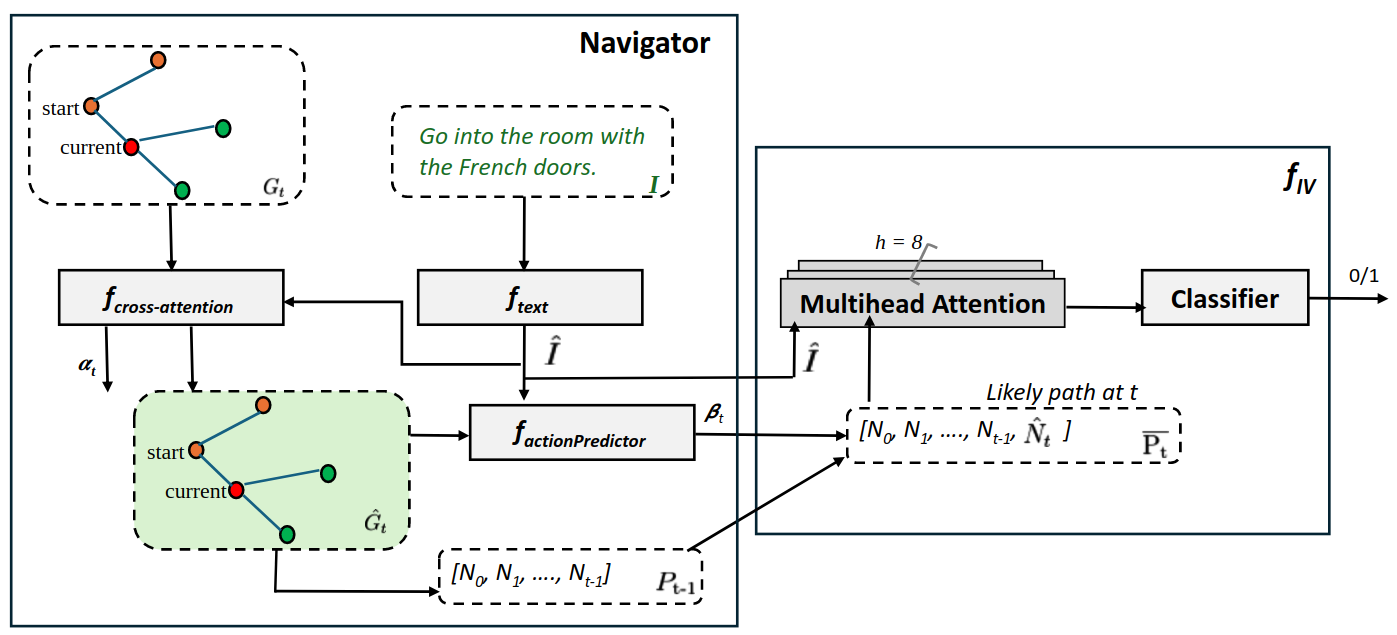

技术框架:整体框架包含一个导航模块和一个指令模糊度估计模块。导航模块负责根据指令和环境信息控制智能体的运动。指令模糊度估计模块则负责评估指令的模糊程度。该模块以指令和智能体的历史轨迹作为输入,输出一个模糊度得分。如果模糊度得分超过预设阈值,则智能体认为当前指令不够清晰,需要寻求帮助。

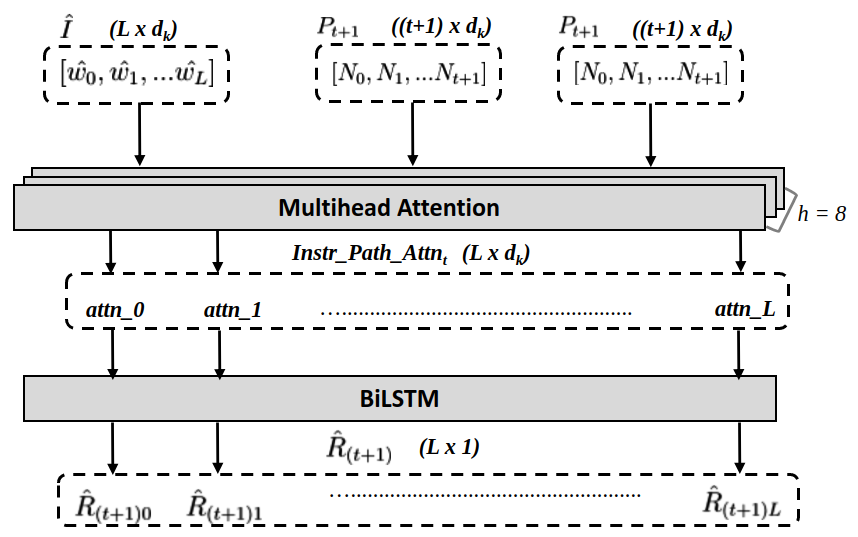

关键创新:最重要的技术创新点在于提出了基于注意力机制的指令模糊度估计模块。该模块通过学习指令和智能体轨迹之间的对齐关系,能够更准确地评估指令的模糊程度。与现有方法相比,该模块不需要显式地建模指令的缺失信息,而是通过隐式地学习指令和轨迹的关联来判断指令的完整性。

关键设计:指令模糊度估计模块采用注意力机制,学习指令和轨迹之间的关联。具体来说,该模块包含一个指令编码器和一个轨迹编码器,分别将指令和轨迹编码成向量表示。然后,使用注意力机制计算指令和轨迹之间的对齐权重。最后,将对齐权重加权求和,得到一个模糊度得分。损失函数采用交叉熵损失函数,用于训练模糊度估计模块,使其能够准确地预测指令的模糊程度。在训练过程中,利用指令到路径的对齐信息来提高模糊度估计的准确性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,本文提出的指令模糊度估计模块在精确率-召回率平衡方面提高了约52%。消融实验证明,将该模块与导航模块中的跨模态注意力网络相结合是有效的。实验还表明,指令到路径注意力网络的注意力分数可以更好地指示模糊度,从而提升智能体的导航性能。

🎯 应用场景

该研究成果可应用于各种需要人机协作的导航任务中,例如服务机器人、自动驾驶汽车等。通过让智能体具备主动询问能力,可以提高导航效率,减少人为干预,提升用户体验。此外,该方法还可以扩展到其他需要判断信息完整性的任务中,例如智能问答、信息检索等。

📄 摘要(原文)

Recent research in Vision Language Navigation (VLN) has overlooked the development of agents' inquisitive abilities, which allow them to ask clarifying questions when instructions are incomplete. This paper addresses how agents can recognize "when" they lack sufficient information, without focusing on "what" is missing, particularly in VLN tasks with vague instructions. Equipping agents with this ability enhances efficiency by reducing potential digressions and seeking timely assistance. The challenge in identifying such uncertain points is balancing between being overly cautious (high recall) and overly confident (high precision). We propose an attention-based instruction-vagueness estimation module that learns associations between instructions and the agent's trajectory. By leveraging instruction-to-path alignment information during training, the module's vagueness estimation performance improves by around 52% in terms of precision-recall balance. In our ablative experiments, we also demonstrate the effectiveness of incorporating this additional instruction-to-path attention network alongside the cross-modal attention networks within the navigator module. Our results show that the attention scores from the instruction-to-path attention network serve as better indicators for estimating vagueness.