Watson: A Cognitive Observability Framework for the Reasoning of LLM-Powered Agents

作者: Benjamin Rombaut, Sogol Masoumzadeh, Kirill Vasilevski, Dayi Lin, Ahmed E. Hassan

分类: cs.AI, cs.SE

发布日期: 2024-11-05 (更新: 2025-09-19)

💡 一句话要点

Watson:用于LLM驱动Agent推理的认知可观测性框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 认知可观测性 LLM Agent 推理过程 提示归因 Agentware 软件调试 自主系统

📋 核心要点

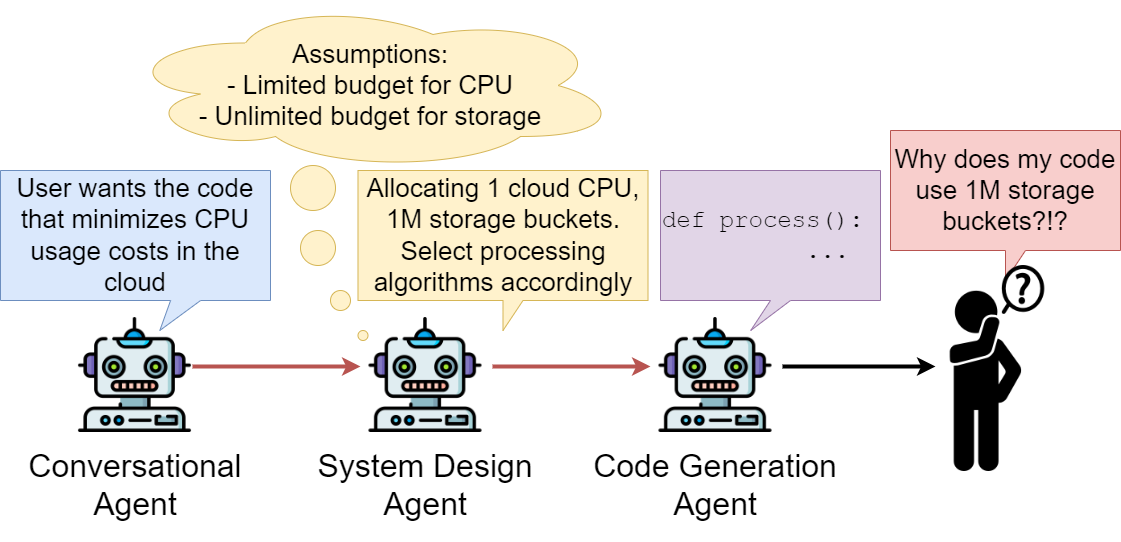

- 现有软件可观测性方法难以应对LLM Agent的高度自主性和不透明推理过程带来的挑战。

- Watson框架通过提示归因技术,追溯推断LLM Agent的推理轨迹,实现认知可观测性。

- 实验表明,Watson能够揭示可操作的推理洞察,并支持有针对性的干预,提升Agentware系统的透明度和可靠性。

📝 摘要(中文)

大型语言模型(LLM)正日益融入自主系统,催生了一种名为Agentware的新型软件,其中LLM驱动的Agent在软件工程、客户服务和数据分析等领域执行复杂的、开放式的任务。然而,它们的高度自主性和不透明的推理过程对传统的软件可观测性方法提出了重大挑战。为了解决这个问题,我们引入了认知可观测性的概念——即恢复和检查Agent决策背后隐含推理的能力。我们提出了Watson,一个通用的框架,用于观察快速思考的LLM Agent的推理过程,而无需改变它们的行为。Watson使用提示归因技术追溯地推断推理轨迹。我们在MMLU基准测试以及SWE-bench-lite数据集上的AutoCodeRover和OpenHands Agent中,在手动调试和自动校正场景下评估了Watson。在静态和动态设置中,Watson揭示了可操作的推理洞察,并支持有针对性的干预,证明了其在提高Agentware系统透明度和可靠性方面的实际效用。

🔬 方法详解

问题定义:论文旨在解决LLM驱动的Agentware系统中,由于Agent的高度自主性和不透明推理过程,导致传统软件可观测性方法失效的问题。现有方法难以理解Agent的决策过程,从而难以调试和改进Agent的行为。

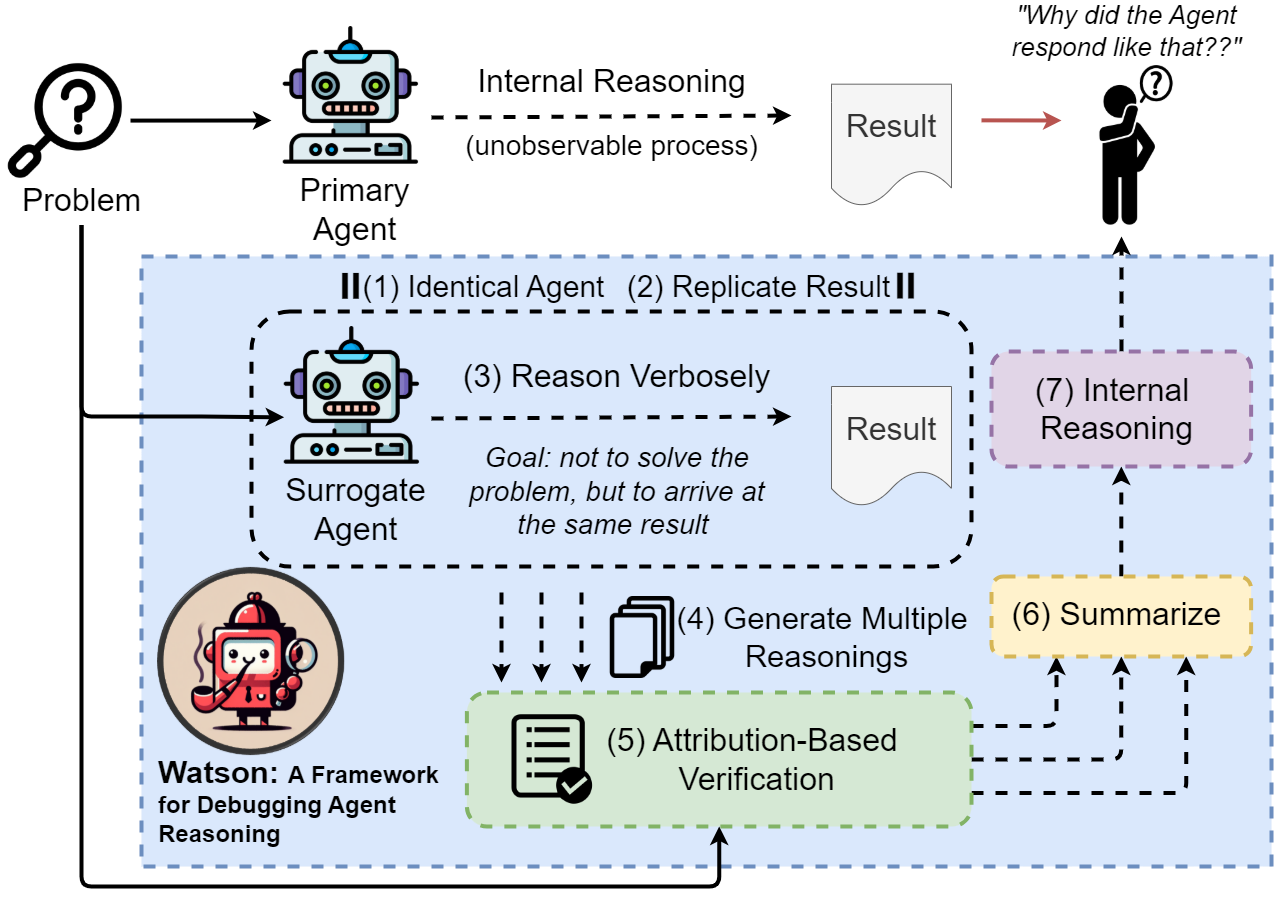

核心思路:论文的核心思路是通过认知可观测性,即恢复和检查Agent决策背后的隐含推理,来解决上述问题。Watson框架通过追溯推断Agent的推理轨迹,从而理解Agent的决策过程。这种方法无需改变Agent的行为,即可实现对Agent推理过程的观测。

技术框架:Watson框架主要包含以下几个阶段:1) Agent执行任务并生成输出;2) Watson使用提示归因技术,分析Agent的输入和输出,推断Agent的推理轨迹;3) Watson将推理轨迹呈现给用户,以便用户理解Agent的决策过程;4) 用户可以根据推理轨迹,对Agent进行调试和改进。

关键创新:Watson最重要的技术创新点是提出了认知可观测性的概念,并实现了通过提示归因技术追溯推断Agent推理轨迹的方法。与现有方法相比,Watson无需改变Agent的行为,即可实现对Agent推理过程的观测,从而更加灵活和高效。

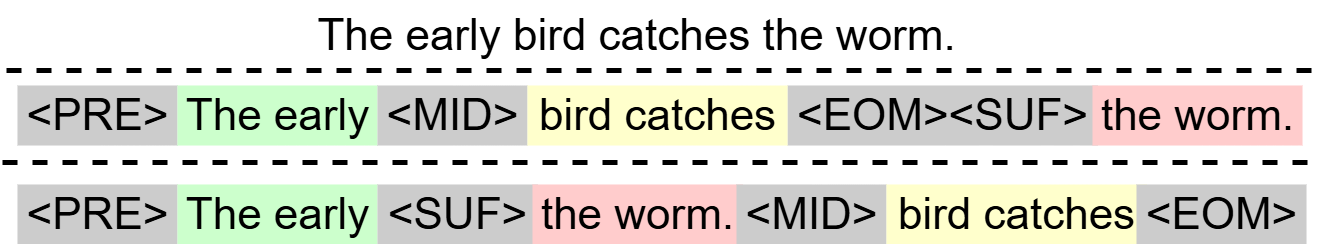

关键设计:Watson的关键设计在于提示归因技术的选择和应用。论文中使用的提示归因技术能够有效地分析Agent的输入和输出,并推断出Agent的推理轨迹。具体的提示归因技术细节在论文中未详细说明,属于未知内容。

🖼️ 关键图片

📊 实验亮点

论文在MMLU基准测试以及SWE-bench-lite数据集上的AutoCodeRover和OpenHands Agent中评估了Watson。实验结果表明,Watson能够揭示可操作的推理洞察,并支持有针对性的干预,证明了其在提高Agentware系统透明度和可靠性方面的实际效用。具体的性能数据和提升幅度在论文中未详细说明,属于未知内容。

🎯 应用场景

Watson框架可以应用于各种LLM驱动的Agentware系统,例如软件工程、客户服务和数据分析等领域。通过提高Agentware系统的透明度和可靠性,Watson可以帮助开发者更好地理解和改进Agent的行为,从而提高Agentware系统的性能和效率。未来,Watson可以进一步扩展到支持更复杂的Agent推理过程,并提供更丰富的可视化和交互功能。

📄 摘要(原文)

Large language models (LLMs) are increasingly integrated into autonomous systems, giving rise to a new class of software known as Agentware, where LLM-powered agents perform complex, open-ended tasks in domains such as software engineering, customer service, and data analysis. However, their high autonomy and opaque reasoning processes pose significant challenges for traditional software observability methods. To address this, we introduce the concept of cognitive observability - the ability to recover and inspect the implicit reasoning behind agent decisions. We present Watson, a general-purpose framework for observing the reasoning processes of fast-thinking LLM agents without altering their behavior. Watson retroactively infers reasoning traces using prompt attribution techniques. We evaluate Watson in both manual debugging and automated correction scenarios across the MMLU benchmark and the AutoCodeRover and OpenHands agents on the SWE-bench-lite dataset. In both static and dynamic settings, Watson surfaces actionable reasoning insights and supports targeted interventions, demonstrating its practical utility for improving transparency and reliability in Agentware systems.