HumanVLM: Foundation for Human-Scene Vision-Language Model

作者: Dawei Dai, Xu Long, Li Yutang, Zhang Yuanhui, Shuyin Xia

分类: cs.AI, cs.MM

发布日期: 2024-11-05

备注: 34 pages,11 figures

💡 一句话要点

提出HumanVLM,为人类-场景视觉语言任务提供基础模型。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 视觉语言模型 人类-场景理解 多模态学习 图像描述 领域特定模型

📋 核心要点

- 现有视觉语言模型在通用领域表现良好,但在人类-场景等特定领域性能不足。

- 构建大规模人类-场景图像-文本数据集,并训练领域特定的视觉语言模型HumanVLM。

- 实验表明,HumanVLM在人类相关任务上显著优于同等规模的通用视觉语言模型。

📝 摘要(中文)

本文提出了一种领域特定的视觉语言大模型(HumanVLM),旨在为人类-场景视觉语言任务提供基础。首先,作者构建了一个大规模的人类-场景多模态图像-文本数据集(HumanCaption-10M),该数据集来源于互联网,用于促进领域特定的对齐。其次,开发了一种针对以人为中心的图像的描述方法,能够捕捉人脸、身体和背景信息,并构建了一个高质量的人类-场景图像-文本数据集(HumanCaptionHQ,约311k对),其中包含尽可能多关于人类的详细信息。最后,使用HumanCaption-10M和HumanCaptionHQ训练HumanVLM。实验结果表明,HumanVLM在各种下游任务中表现出卓越的整体性能,尤其是在与人类相关的任务中,显著优于包括Qwen2VL和ChatGPT-4o在内的同等规模模型。HumanVLM及其相关数据将促进人类相关领域的研究。

🔬 方法详解

问题定义:现有的大型视觉语言模型(VLM)在通用领域取得了显著进展,但在处理特定领域,特别是涉及人类和场景的复杂交互时,性能往往不尽如人意。这些通用模型缺乏对人类行为、姿态、表情以及场景上下文的细粒度理解,导致在诸如人物识别、行为分析、人机交互等任务中表现欠佳。因此,需要一种专门针对人类-场景的VLM,以提升在该领域的性能。

核心思路:本文的核心思路是构建一个大规模、高质量的人类-场景图像-文本数据集,并在此基础上训练一个领域特定的VLM。通过领域数据的预训练,使模型能够更好地理解人类与场景之间的复杂关系,从而提升在下游任务中的性能。这种方法类似于在特定领域进行知识迁移,使模型能够更好地适应特定任务的需求。

技术框架:HumanVLM的训练框架主要包括以下几个阶段:1) 数据收集与清洗:从互联网收集大规模的人类-场景图像-文本数据,并进行清洗和过滤,构建HumanCaption-10M数据集。2) 高质量数据构建:开发一种针对以人为中心的图像的描述方法,生成详细的图像描述,构建HumanCaptionHQ数据集。3) 模型训练:使用HumanCaption-10M和HumanCaptionHQ数据集对VLM进行预训练,使其学习人类-场景的视觉和语言特征。4) 下游任务微调:在各种人类-场景相关的下游任务上对预训练的HumanVLM进行微调,以评估其性能。

关键创新:本文的关键创新在于构建了大规模、高质量的人类-场景图像-文本数据集HumanCaption-10M和HumanCaptionHQ。这些数据集包含了丰富的人类行为、姿态、表情以及场景上下文信息,为训练领域特定的VLM提供了充足的数据支持。此外,本文还提出了一种针对以人为中心的图像的描述方法,能够生成详细的图像描述,进一步提升了数据的质量。

关键设计:在数据构建方面,HumanCaptionHQ数据集采用了精细的标注策略,尽可能包含关于人类的详细信息,例如人脸、身体、姿态、表情等。在模型训练方面,采用了标准的VLM训练流程,包括图像编码器和文本解码器,并使用交叉熵损失函数进行优化。具体的网络结构和参数设置未在摘要中详细说明,属于未知信息。

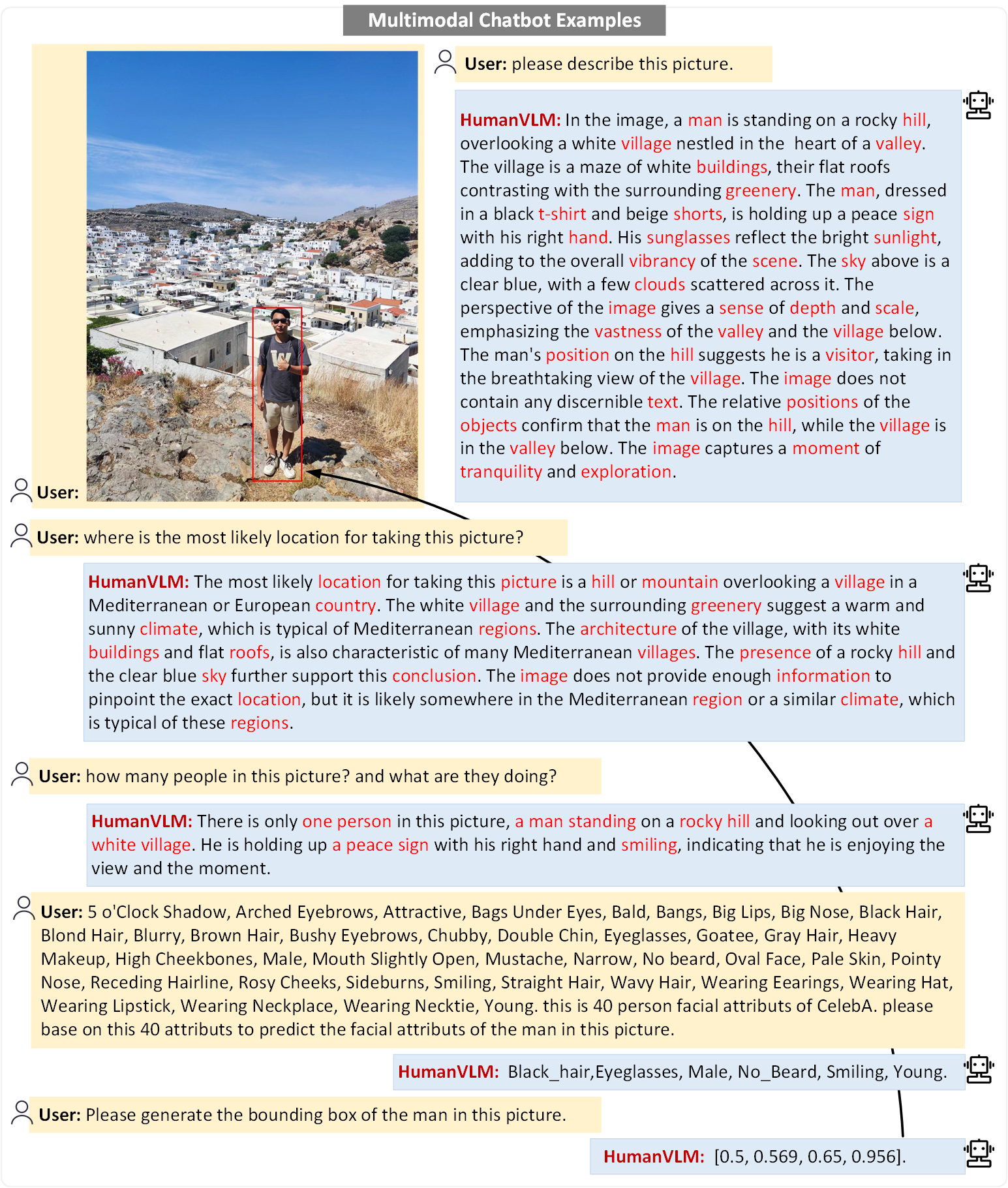

🖼️ 关键图片

📊 实验亮点

HumanVLM在各种下游任务中表现出卓越的整体性能,尤其是在与人类相关的任务中,显著优于包括Qwen2VL和ChatGPT-4o在内的同等规模模型。具体性能数据未在摘要中给出,属于未知信息。但强调了在人类相关任务上的显著优势。

🎯 应用场景

HumanVLM在人机交互、智能监控、社交媒体分析、虚拟现实等领域具有广泛的应用前景。它可以用于提升人机交互的自然性和准确性,例如在智能助手中更好地理解用户的意图和情感。在智能监控中,可以用于识别异常行为和事件。在社交媒体分析中,可以用于理解用户生成的内容和社交互动。在虚拟现实中,可以用于创建更逼真和沉浸式的体验。

📄 摘要(原文)

Human-scene vision-language tasks are increasingly prevalent in diverse social applications, yet recent advancements predominantly rely on models specifically tailored to individual tasks. Emerging research indicates that large vision-language models (VLMs) can enhance performance across various downstream vision-language understanding tasks. However, general-domain models often underperform in specialized fields. This study introduces a domain-specific Large Vision-Language Model, Human-Scene Vision-Language Model (HumanVLM), designed to provide a foundation for human-scene Vision-Language tasks. Specifically, (1) we create a large-scale human-scene multimodal image-text dataset (HumanCaption-10M) sourced from the Internet to facilitate domain-specific alignment; (2) develop a captioning approach for human-centered images, capturing human faces, bodies, and backgrounds, and construct a high-quality Human-Scene image-text dataset (HumanCaptionHQ, about 311k pairs) that contain as much detailed information as possible about human; (3) Using HumanCaption-10M and HumanCaptionHQ, we train a HumanVLM. In the experiments, we then evaluate our HumanVLM across varous downstream tasks, where it demonstrates superior overall performance among multimodal models of comparable scale, particularly excelling in human-related tasks and significantly outperforming similar models, including Qwen2VL and ChatGPT-4o. HumanVLM, alongside the data introduced, will stimulate the research in human-around fields.