RuAG: Learned-rule-augmented Generation for Large Language Models

作者: Yudi Zhang, Pei Xiao, Lu Wang, Chaoyun Zhang, Meng Fang, Yali Du, Yevgeniy Puzyrev, Randolph Yao, Si Qin, Qingwei Lin, Mykola Pechenizkiy, Dongmei Zhang, Saravan Rajmohan, Qi Zhang

分类: cs.AI, cs.CL, cs.LG

发布日期: 2024-11-04

💡 一句话要点

提出RuAG框架,通过学习规则增强大型语言模型的推理能力,克服上下文窗口限制。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 规则学习 知识注入 推理增强 蒙特卡洛树搜索

📋 核心要点

- 上下文学习(ICL)和检索增强生成(RAG)受限于上下文窗口大小,导致信息注入不足,影响LLM的推理能力。

- RuAG框架将离线数据提炼成可解释的一阶逻辑规则,并通过自然语言注入到LLM提示中,增强其推理能力。

- 在多个公共和私有工业任务上的实验表明,RuAG能有效提升LLM在自然语言处理、时间序列等任务上的性能。

📝 摘要(中文)

本文提出了一种名为RuAG的新框架,旨在通过将大量离线数据自动提炼成可解释的一阶逻辑规则,并将这些规则注入到大型语言模型(LLM)中,从而增强其推理能力。该方法首先依赖LLM的常识来制定搜索过程,由LLM自动定义头谓词和体谓词。然后,RuAG应用蒙特卡洛树搜索(MCTS)来解决组合搜索空间问题,并有效地从数据中发现逻辑规则。最终,这些逻辑规则被翻译成自然语言,从而实现有针对性的知识注入,并无缝集成到LLM提示中,以用于LLM的下游任务推理。我们在公共和私有的工业任务上评估了我们的框架,包括自然语言处理、时间序列、决策制定和工业任务,证明了其在增强LLM在各种任务上的能力方面的有效性。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)推理方法,如上下文学习(ICL)和检索增强生成(RAG),虽然能够利用外部知识,但受限于上下文窗口的大小,无法有效地注入足够的信息,从而限制了其推理能力。尤其是在需要大量知识才能完成的任务中,这种限制更为明显。

核心思路:RuAG的核心思路是将大量离线数据提炼成简洁、可解释的一阶逻辑规则,然后将这些规则以自然语言的形式注入到LLM的提示中。通过这种方式,LLM可以利用这些规则进行推理,从而克服上下文窗口的限制,提高推理能力。

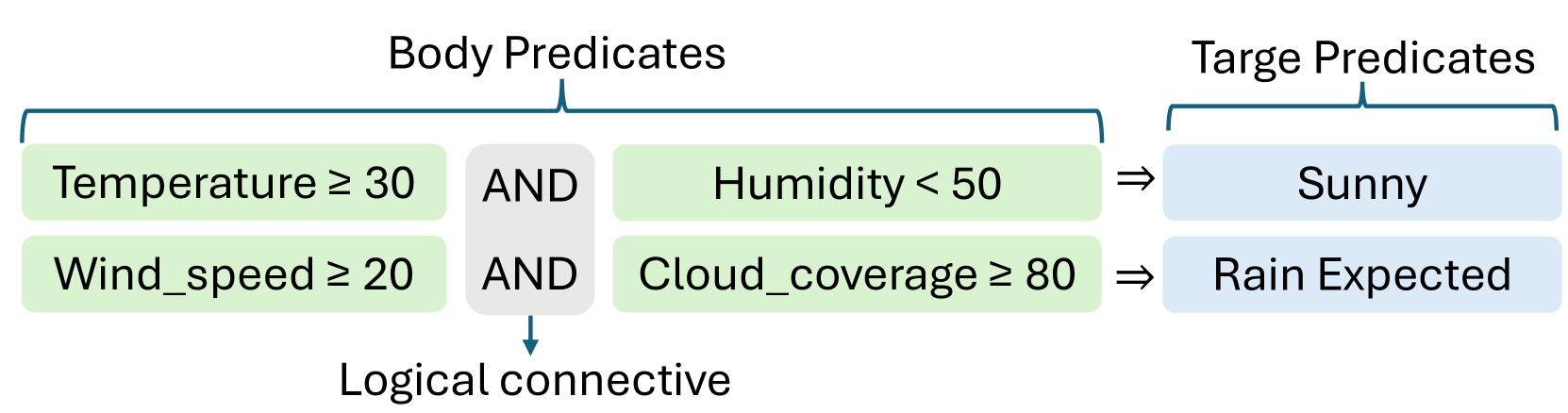

技术框架:RuAG框架主要包含以下几个阶段: 1. 谓词定义:利用LLM的常识,自动定义头谓词和体谓词,用于构建逻辑规则。 2. 规则搜索:应用蒙特卡洛树搜索(MCTS)在组合搜索空间中高效地搜索逻辑规则。 3. 规则翻译:将搜索到的逻辑规则翻译成自然语言。 4. 知识注入:将翻译后的自然语言规则注入到LLM的提示中,用于下游任务的推理。

关键创新:RuAG的关键创新在于自动地从数据中学习逻辑规则,并将其注入到LLM中。与传统的知识图谱或规则库相比,RuAG能够自动地发现与任务相关的规则,而无需人工干预。此外,RuAG使用自然语言将规则注入到LLM中,使得LLM能够更好地理解和利用这些规则。

关键设计:RuAG的关键设计包括: 1. 基于LLM的谓词定义:利用LLM的常识来指导谓词的定义,从而减少搜索空间。 2. 基于MCTS的规则搜索:使用MCTS来高效地搜索逻辑规则,避免了穷举搜索的计算复杂度。 3. 自然语言规则注入:将逻辑规则翻译成自然语言,使得LLM能够更好地理解和利用这些规则。

🖼️ 关键图片

📊 实验亮点

实验结果表明,RuAG框架在多个公共和私有工业任务上都取得了显著的性能提升。例如,在自然语言处理任务中,RuAG能够提高LLM的准确率和召回率。在时间序列分析任务中,RuAG能够提高LLM的预测精度。在决策制定任务中,RuAG能够提高LLM的决策质量。这些结果表明,RuAG能够有效地增强LLM的推理能力,并提高其在各种任务上的性能。

🎯 应用场景

RuAG框架具有广泛的应用前景,可应用于自然语言处理、时间序列分析、决策制定和工业任务等领域。通过增强LLM的推理能力,RuAG可以提高各种任务的性能,例如问答、文本生成、预测和控制等。该研究的实际价值在于能够利用海量数据自动构建知识库,并将其应用于各种实际问题中。未来,RuAG可以进一步扩展到其他领域,例如医疗、金融和教育等。

📄 摘要(原文)

In-context learning (ICL) and Retrieval-Augmented Generation (RAG) have gained attention for their ability to enhance LLMs' reasoning by incorporating external knowledge but suffer from limited contextual window size, leading to insufficient information injection. To this end, we propose a novel framework, RuAG, to automatically distill large volumes of offline data into interpretable first-order logic rules, which are injected into LLMs to boost their reasoning capabilities. Our method begins by formulating the search process relying on LLMs' commonsense, where LLMs automatically define head and body predicates. Then, RuAG applies Monte Carlo Tree Search (MCTS) to address the combinational searching space and efficiently discover logic rules from data. The resulting logic rules are translated into natural language, allowing targeted knowledge injection and seamless integration into LLM prompts for LLM's downstream task reasoning. We evaluate our framework on public and private industrial tasks, including natural language processing, time-series, decision-making, and industrial tasks, demonstrating its effectiveness in enhancing LLM's capability over diverse tasks.