A Risk Taxonomy and Reflection Tool for Large Language Model Adoption in Public Health

作者: Jiawei Zhou, Amy Z. Chen, Darshi Shah, Laura M. Schwab Reese, Munmun De Choudhury

分类: cs.HC, cs.AI, cs.CL

发布日期: 2024-11-04 (更新: 2025-10-14)

DOI: 10.1145/3757486

💡 一句话要点

构建公共卫生领域大语言模型风险分类体系与评估工具,辅助风险反思。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 公共卫生 风险评估 风险分类 焦点小组 健康传播 伦理考量

📋 核心要点

- 公共卫生领域采用大语言模型面临信息质量、伦理和社会风险等挑战,缺乏系统性的风险评估方法。

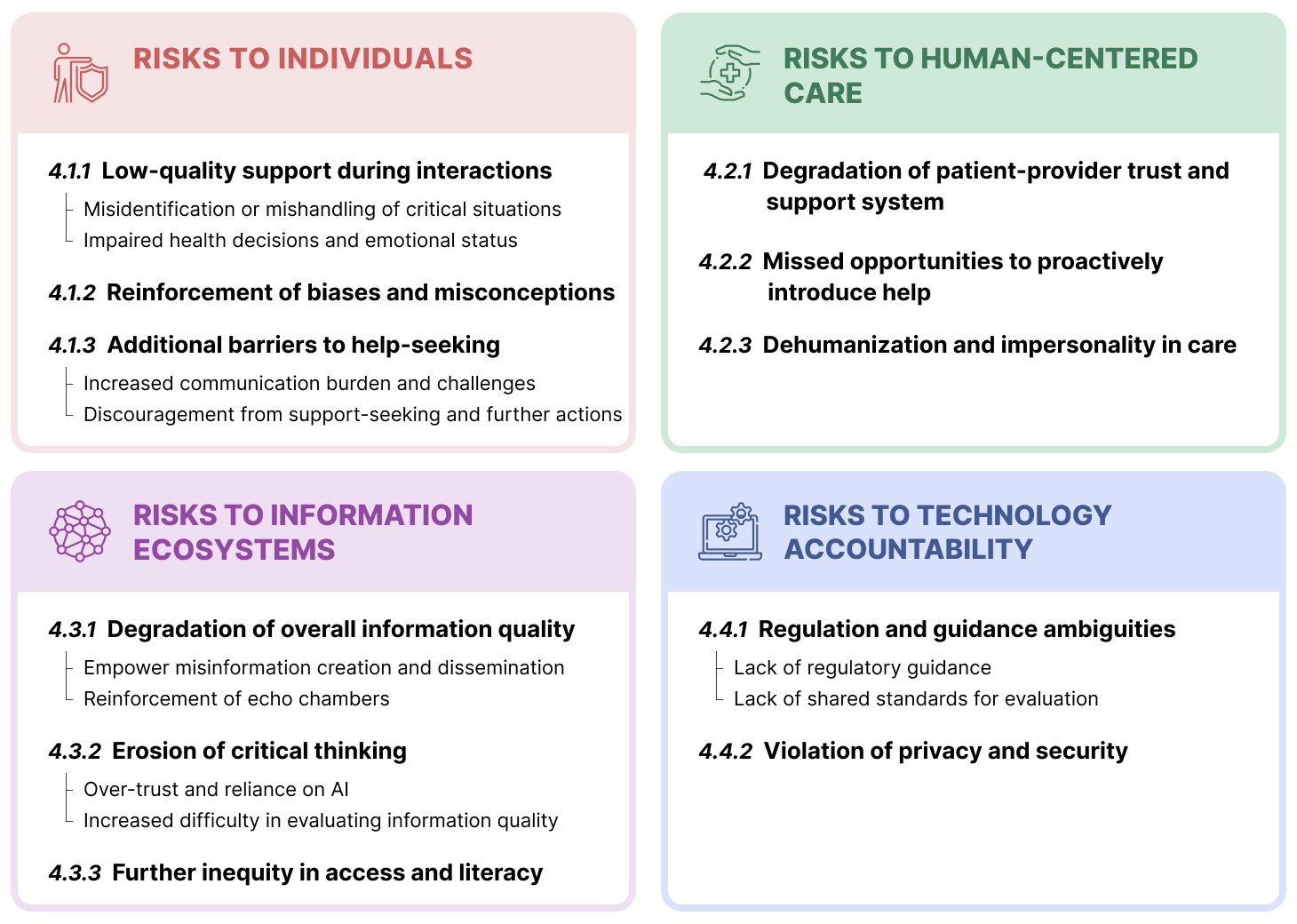

- 通过焦点小组访谈,构建了包含四个维度的风险分类体系,并提供反思性问题,辅助风险评估。

- 该研究为公共卫生和计算领域提供共享词汇和工具,促进协作,降低LLM应用风险,提升决策质量。

📝 摘要(中文)

大型语言模型(LLM)的最新突破引发了人们对其在不同领域作为信息来源或通信工具的潜在应用的兴趣和担忧。在公共卫生领域,由于风险高且影响广泛,采用LLM提出了独特的挑战,需要进行彻底的评估。然而,用于评估公共卫生领域潜在风险的结构化方法仍未得到充分探索。为了解决这一差距,我们与公共卫生专业人员和具有实际经验的个人进行了焦点小组访谈,以了解他们对三个需要高质量信息的关键公共卫生问题的担忧:传染病预防(疫苗)、慢性病和健康护理(阿片类药物使用障碍)以及社区健康和安全(亲密伴侣暴力)。我们将参与者的观点综合成一个风险分类体系,识别并关联了LLM在传统健康传播中可能引入的潜在危害。该分类体系强调了个人、以人为本的护理、信息生态系统和技术问责制四个风险维度。对于每个维度,我们都详细分析了具体风险,并提供了示例性反思问题,以帮助从业者采取风险反思方法。通过总结LLM的独特特征并将其与已识别的风险联系起来,我们讨论了重新审视先前信息行为心理模型的必要性,并通过实际经验和真实实践来补充外部有效性和领域专业知识的评估。总而言之,这项工作为计算和公共卫生领域的人们提供了一个共享的词汇和反思工具,以协作地预测、评估和减轻在决定何时使用LLM功能(或不使用)以及如何减轻危害方面的风险。

🔬 方法详解

问题定义:公共卫生领域在采用大型语言模型(LLM)时面临着独特的风险,例如错误信息传播、偏见放大、隐私泄露等。现有的风险评估方法缺乏针对公共卫生领域的特定考量,难以有效识别和应对这些风险。此外,公共卫生专业人员和普通民众对LLM的理解存在差异,导致风险认知不一致。

核心思路:本研究的核心思路是通过与公共卫生专业人员和具有实际经验的个人进行深入访谈,收集他们对LLM在公共卫生领域应用的担忧,并将其系统地整理成一个风险分类体系。该体系旨在帮助从业者从多个维度识别潜在风险,并提供反思性问题,引导他们进行更全面的风险评估。

技术框架:该研究采用定性研究方法,主要包括以下几个阶段: 1. 焦点小组访谈:招募公共卫生专业人员和具有相关生活经验的个体,围绕传染病预防、慢性病管理和社区安全等主题,探讨LLM应用可能带来的风险。 2. 数据分析:对访谈记录进行编码和主题分析,识别参与者关注的主要风险领域。 3. 风险分类体系构建:将识别出的风险领域归纳为四个维度:个人、以人为本的护理、信息生态系统和技术问责制。每个维度下进一步细分具体的风险类型。 4. 反思性问题设计:针对每个风险类型,设计一系列反思性问题,引导从业者深入思考LLM应用可能带来的潜在危害。

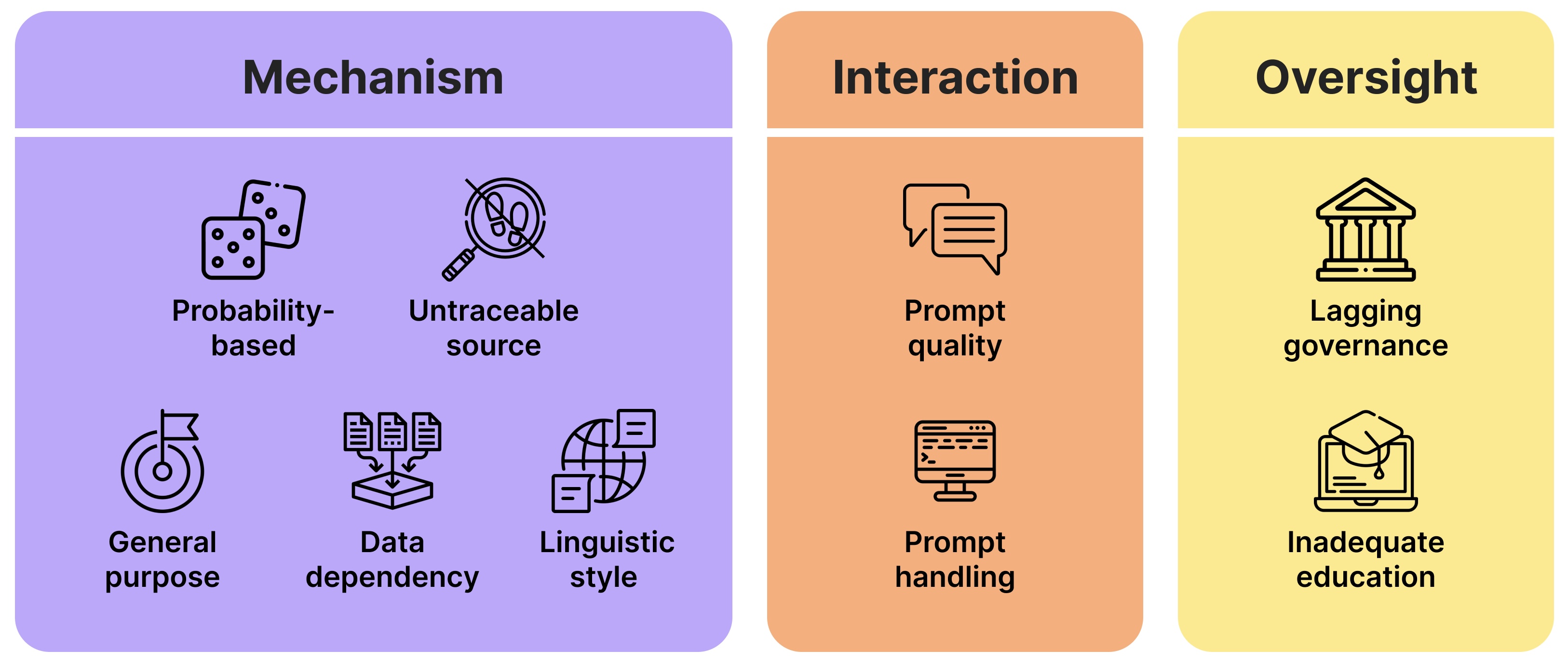

关键创新:该研究的关键创新在于构建了一个专门针对公共卫生领域的大型语言模型风险分类体系。该体系不仅识别了LLM应用可能带来的各种风险,还提供了具体的反思性问题,帮助从业者进行更全面的风险评估。此外,该研究强调了将领域专业知识和实际经验纳入风险评估的重要性。

关键设计:风险分类体系的四个维度(个人、以人为本的护理、信息生态系统和技术问责制)是基于对访谈数据的深入分析而确定的。每个维度下的具体风险类型都经过了仔细的推敲和验证,以确保其准确性和全面性。反思性问题的设计旨在引导从业者从多个角度思考问题,并考虑不同利益相关者的需求。

🖼️ 关键图片

📊 实验亮点

该研究通过焦点小组访谈,从公共卫生专业人员和具有实际经验的个体处收集了丰富的风险信息,构建了一个包含四个维度的风险分类体系。该体系为公共卫生领域的大型语言模型应用提供了全面的风险评估框架,并提供了具体的反思性问题,有助于降低潜在风险。

🎯 应用场景

该研究成果可应用于公共卫生机构、医疗保健组织和技术开发团队,帮助他们在采用大型语言模型时进行全面的风险评估和管理。通过使用该风险分类体系和反思工具,可以降低LLM应用可能带来的负面影响,提升公共卫生服务的质量和公平性。未来,该研究可以扩展到其他领域,例如教育、金融等,为AI技术的负责任应用提供指导。

📄 摘要(原文)

Recent breakthroughs in large language models (LLMs) have generated both interest and concern about their potential adoption as information sources or communication tools across different domains. In public health, where stakes are high and impacts extend across diverse populations, adopting LLMs poses unique challenges that require thorough evaluation. However, structured approaches for assessing potential risks in public health remain under-explored. To address this gap, we conducted focus groups with public health professionals and individuals with lived experience to unpack their concerns, situated across three distinct and critical public health issues that demand high-quality information: infectious disease prevention (vaccines), chronic and well-being care (opioid use disorder), and community health and safety (intimate partner violence). We synthesize participants' perspectives into a risk taxonomy, identifying and contextualizing the potential harms LLMs may introduce when positioned alongside traditional health communication. This taxonomy highlights four dimensions of risk to individuals, human-centered care, information ecosystem, and technology accountability. For each dimension, we unpack specific risks and offer example reflection questions to help practitioners adopt a risk-reflexive approach. By summarizing distinctive LLM characteristics and linking them to identified risks, we discuss the need to revisit prior mental models of information behaviors and complement evaluations with external validity and domain expertise through lived experience and real-world practices. Together, this work contributes a shared vocabulary and reflection tool for people in both computing and public health to collaboratively anticipate, evaluate, and mitigate risks in deciding when to employ LLM capabilities (or not) and how to mitigate harm.