Foundations and Recent Trends in Multimodal Mobile Agents: A Survey

作者: Biao Wu, Yanda Li, Zhiwei Zhang, Yunchao Wei, Meng Fang, Ling Chen

分类: cs.AI

发布日期: 2024-11-04 (更新: 2025-09-14)

备注: 8 pages, 1 figure

🔗 代码/项目: GITHUB

💡 一句话要点

多模态移动Agent综述:聚焦实时适应性与多模态交互

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 移动Agent 多模态交互 实时适应性 大型语言模型 模型微调

📋 核心要点

- 现有移动Agent难以在复杂动态环境中实时适应和处理多模态数据,限制了其自动化任务的能力。

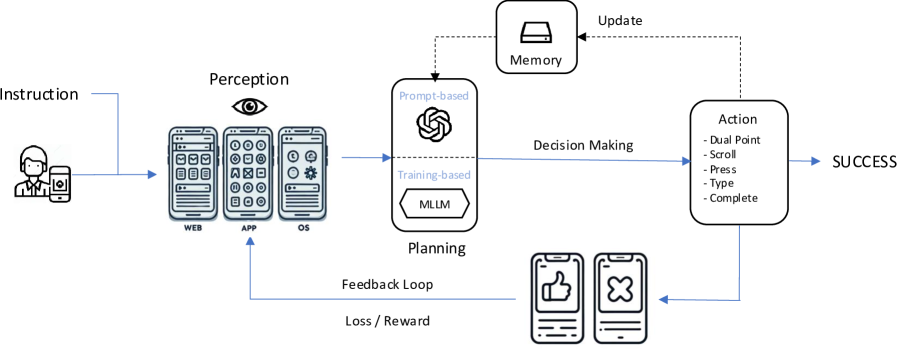

- 本文综述了基于Prompt和基于训练两种方法,利用LLM和微调多模态模型来提升移动Agent的实时适应性和多模态交互能力。

- 综述分析了最新的评估基准,这些基准能够更准确地评估Agent在静态和交互环境中的性能,并探讨了未来研究方向。

📝 摘要(中文)

移动Agent对于在复杂和动态的移动环境中自动化任务至关重要。随着基础模型的发展,对能够实时适应并处理多模态数据的Agent的需求日益增长。本综述全面回顾了移动Agent技术,重点关注了增强实时适应性和多模态交互的最新进展。新近开发的评估基准能够更好地捕捉移动任务的静态和交互环境,从而更准确地评估Agent的性能。然后,我们将这些进展分为两种主要方法:基于Prompt的方法,利用大型语言模型(LLM)进行基于指令的任务执行;以及基于训练的方法,微调多模态模型以用于移动特定应用。此外,我们还探讨了增强Agent性能的补充技术。通过讨论关键挑战并概述未来的研究方向,本综述为推进移动Agent技术提供了宝贵的见解。全面的资源列表可在 https://github.com/aialt/awesome-mobile-agents 获取。

🔬 方法详解

问题定义:移动Agent需要在复杂和动态的移动环境中执行自动化任务,但现有方法在实时适应性和多模态数据处理方面存在不足。具体来说,现有Agent难以根据环境变化快速调整策略,并且无法有效整合来自视觉、听觉等多种模态的信息,导致任务执行效率和准确性降低。

核心思路:本文的核心思路是综述近年来在移动Agent领域,特别是关于实时适应性和多模态交互方面的最新进展。通过分析基于Prompt的方法(利用LLM)和基于训练的方法(微调多模态模型),总结了提升Agent性能的关键技术和方法。这种分类和分析有助于研究人员更好地理解现有方法的优缺点,并为未来的研究方向提供指导。

技术框架:本文的综述框架主要包括以下几个部分:首先,介绍移动Agent的基本概念和重要性;其次,回顾现有的移动Agent技术,并指出其局限性;然后,重点分析基于Prompt和基于训练的两种主流方法,并探讨相关的补充技术;最后,讨论当前面临的挑战,并展望未来的研究方向。整体流程是从宏观到微观,从理论到实践,全面梳理了移动Agent领域的研究现状。

关键创新:本文的创新之处在于对移动Agent领域,特别是实时适应性和多模态交互方面的最新进展进行了系统性的综述和分类。通过对比分析基于Prompt和基于训练的方法,揭示了不同方法的优缺点和适用场景。此外,本文还探讨了评估基准的最新发展,并指出了未来研究的潜在方向。这种全面的综述有助于研究人员快速了解该领域的最新动态,并为未来的研究提供参考。

关键设计:本文作为一篇综述文章,其关键设计在于对现有文献的组织和分类。作者将现有方法分为基于Prompt和基于训练两大类,并对每一类方法进行了详细的分析和比较。此外,作者还关注了评估基准的设计,并探讨了如何更准确地评估Agent的性能。这些设计使得本文能够全面、系统地介绍移动Agent领域的研究现状,并为未来的研究提供指导。

🖼️ 关键图片

📊 实验亮点

本文重点关注了近年来移动Agent在实时适应性和多模态交互方面的进展,并对基于Prompt和基于训练的方法进行了详细的对比分析。通过对现有评估基准的分析,揭示了不同Agent在不同环境下的性能差异。此外,本文还提供了一个全面的资源列表,方便研究人员进一步了解该领域的研究成果。

🎯 应用场景

该研究成果对机器人、自动驾驶、智能家居等领域具有广泛的应用前景。例如,在机器人领域,可以利用多模态移动Agent实现更智能化的导航和任务执行;在自动驾驶领域,可以提升车辆对复杂交通环境的感知和决策能力;在智能家居领域,可以实现更自然、更便捷的人机交互。

📄 摘要(原文)

Mobile agents are essential for automating tasks in complex and dynamic mobile environments. As foundation models evolve, the demands for agents that can adapt in real-time and process multimodal data have grown. This survey provides a comprehensive review of mobile agent technologies, focusing on recent advancements that enhance real-time adaptability and multimodal interaction. Recent evaluation benchmarks have been developed better to capture the static and interactive environments of mobile tasks, offering more accurate assessments of agents' performance. We then categorize these advancements into two main approaches: prompt-based methods, which utilize large language models (LLMs) for instruction-based task execution, and training-based methods, which fine-tune multimodal models for mobile-specific applications. Additionally, we explore complementary technologies that augment agent performance. By discussing key challenges and outlining future research directions, this survey offers valuable insights for advancing mobile agent technologies. A comprehensive resource list is available at https://github.com/aialt/awesome-mobile-agents