Constrained Human-AI Cooperation: An Inclusive Embodied Social Intelligence Challenge

作者: Weihua Du, Qiushi Lyu, Jiaming Shan, Zhenting Qi, Hongxin Zhang, Sunli Chen, Andi Peng, Tianmin Shu, Kwonjoon Lee, Behzad Dariush, Chuang Gan

分类: cs.AI, cs.HC, cs.RO

发布日期: 2024-11-04 (更新: 2025-06-11)

备注: NeurIPS 2024 Dataset and Benchmark Track. The first two authors contributed equally. Project Website at https://umass-embodied-agi.github.io/CHAIC/

🔗 代码/项目: GITHUB

💡 一句话要点

提出CHAIC:一个具身社交智能挑战,用于评估人机协作中AI对受限人类的辅助能力

🎯 匹配领域: 支柱六:视频提取与匹配 (Video Extraction) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 人机协作 具身智能 社交智能 强化学习 大型语言模型 行为建模 辅助机器人 受限环境

📋 核心要点

- 现有具身智能体在人机协作中,难以有效理解人类意图和身体约束,导致协作效率低下。

- 提出CHAIC挑战,要求智能体通过观察人类行为推断意图和约束,并制定协作计划。

- 通过实验验证了CHAIC基准测试在评估机器社交智能方面的有效性,并提出了基于LLM和行为建模的新方法。

📝 摘要(中文)

本文提出了一个名为“受限人机协作”(CHAIC)的具身社交智能挑战,旨在测试具身智能体在社交感知和协作方面的能力。在CHAIC中,具身智能体需要通过第一人称视角观察,协助可能存在身体约束(例如,无法触及高处或使用轮椅)的人类高效地完成常见的家庭或户外任务。成功的助手必须:(1)通过跟随人类并观察其行为来推断人类的意图和约束(社交感知);(2)制定针对人类伙伴的协作计划,以尽快解决任务,像团队一样协同工作(协作规划)。为了评估这一挑战,我们创建了四个具有真实身体约束的新型智能体,以及八个具有室内和室外场景的长程任务,这些场景具有各种约束、紧急事件和潜在风险。我们在挑战中对基于规划和学习的基线方法进行了基准测试,并引入了一种利用大型语言模型和行为建模的新方法。实验评估表明,我们的基准测试能够系统地评估机器社交智能的关键方面。我们的基准测试和代码可在https://github.com/UMass-Embodied-AGI/CHAIC公开获取。

🔬 方法详解

问题定义:现有的人机协作研究通常假设人类没有身体上的限制,或者智能体无法有效地感知和理解人类的意图和约束。这导致智能体难以制定有效的协作计划,从而降低了协作效率。CHAIC挑战旨在解决具身智能体如何有效地辅助受限人类完成任务的问题,现有方法的痛点在于缺乏对人类意图和约束的准确理解和建模。

核心思路:论文的核心思路是让智能体通过观察人类的行为来推断其意图和约束,并在此基础上制定协作计划。这种方法模拟了人类之间的协作方式,即通过观察和理解对方的行为来更好地协同工作。通过引入大型语言模型和行为建模,可以更好地理解人类的意图和约束,从而制定更有效的协作计划。

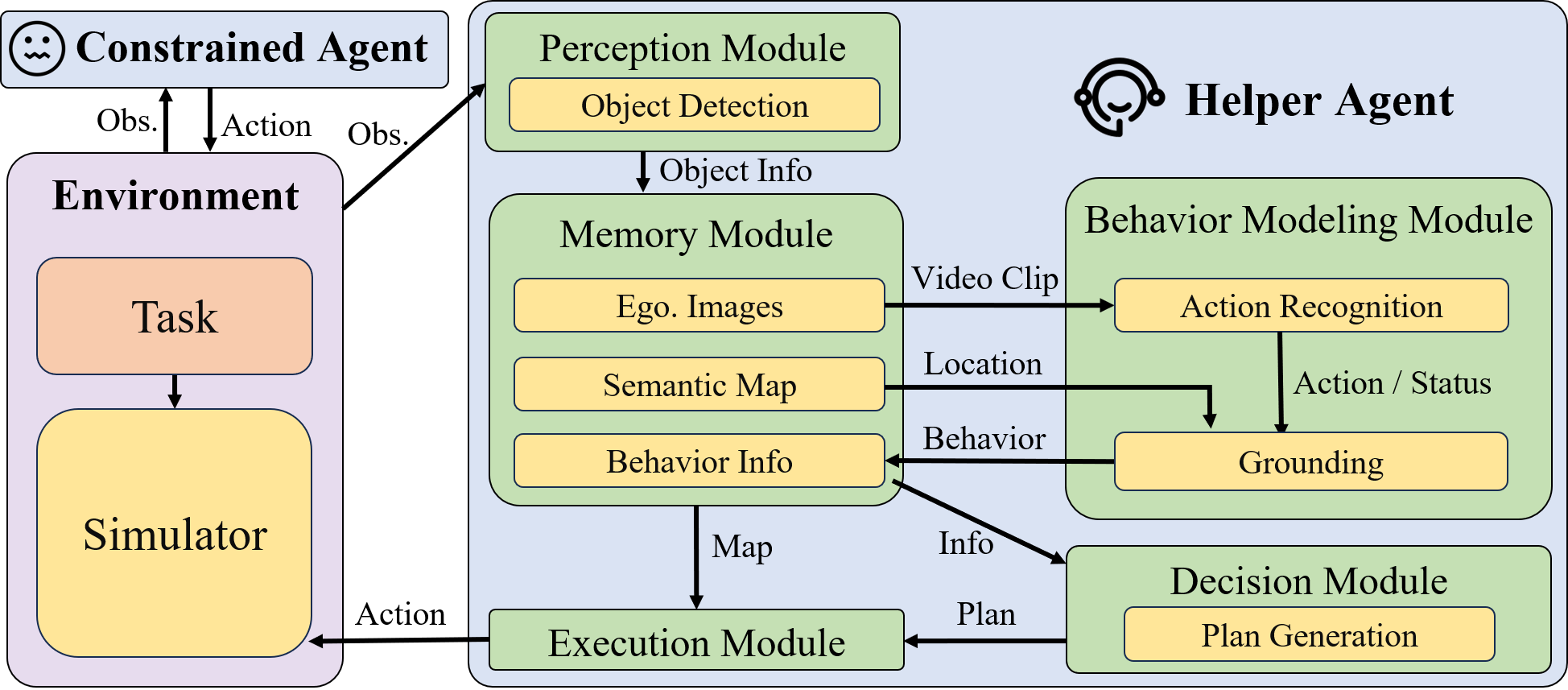

技术框架:CHAIC挑战的技术框架主要包括以下几个模块:1)环境模拟器:用于模拟室内和室外的场景,以及人类和智能体的交互;2)人类智能体:具有不同的身体约束,例如无法触及高处或使用轮椅;3)具身智能体:配备第一人称视角观察,能够感知环境和人类的行为;4)任务定义:包括一系列长程任务,例如家庭任务和户外任务;5)评估指标:用于评估智能体的社交感知和协作能力。

关键创新:该论文的关键创新点在于提出了一个包含真实物理约束的人机协作挑战,并引入了一种利用大型语言模型和行为建模的新方法。与现有的方法相比,该方法能够更好地理解人类的意图和约束,从而制定更有效的协作计划。此外,该论文还创建了四个具有真实身体约束的新型智能体,以及八个具有室内和室外场景的长程任务,为研究人机协作提供了一个新的平台。

关键设计:在CHAIC挑战中,关键的设计包括:1)人类智能体的身体约束:通过模拟不同的身体约束,例如无法触及高处或使用轮椅,来增加挑战的难度;2)任务的复杂性:通过设计长程任务,例如家庭任务和户外任务,来测试智能体的规划和协作能力;3)评估指标:通过设计合理的评估指标,例如任务完成时间和协作效率,来评估智能体的社交感知和协作能力。此外,论文还使用了大型语言模型和行为建模来提高智能体对人类意图和约束的理解能力,具体的技术细节未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,提出的CHAIC基准测试能够系统地评估机器社交智能的关键方面。通过对基于规划和学习的基线方法进行基准测试,发现现有方法在处理复杂的人机协作任务时存在不足。引入的基于大型语言模型和行为建模的新方法在某些任务上取得了较好的效果,但具体的性能数据和提升幅度未知。该研究为未来的人机协作研究提供了一个新的方向。

🎯 应用场景

该研究的潜在应用领域包括:辅助机器人、智能家居、医疗保健等。通过提高智能体对人类意图和约束的理解能力,可以开发出更智能、更人性化的辅助机器人,帮助残疾人或老年人更好地生活。此外,该研究还可以应用于智能家居领域,使智能家居系统能够更好地理解用户的需求,提供更个性化的服务。未来,该研究有望推动人机协作技术的发展,实现更高效、更自然的协作方式。

📄 摘要(原文)

We introduce Constrained Human-AI Cooperation (CHAIC), an inclusive embodied social intelligence challenge designed to test social perception and cooperation in embodied agents. In CHAIC, the goal is for an embodied agent equipped with egocentric observations to assist a human who may be operating under physical constraints -- e.g., unable to reach high places or confined to a wheelchair -- in performing common household or outdoor tasks as efficiently as possible. To achieve this, a successful helper must: (1) infer the human's intents and constraints by following the human and observing their behaviors (social perception), and (2) make a cooperative plan tailored to the human partner to solve the task as quickly as possible, working together as a team (cooperative planning). To benchmark this challenge, we create four new agents with real physical constraints and eight long-horizon tasks featuring both indoor and outdoor scenes with various constraints, emergency events, and potential risks. We benchmark planning- and learning-based baselines on the challenge and introduce a new method that leverages large language models and behavior modeling. Empirical evaluations demonstrate the effectiveness of our benchmark in enabling systematic assessment of key aspects of machine social intelligence. Our benchmark and code are publicly available at https://github.com/UMass-Embodied-AGI/CHAIC.