EcoAct: Economic Agent Determines When to Register What Action

作者: Shaokun Zhang, Jieyu Zhang, Dujian Ding, Mirian Hipolito Garcia, Ankur Mallick, Daniel Madrigal, Menglin Xia, Victor Rühle, Qingyun Wu, Chi Wang

分类: cs.AI, cs.CL

发布日期: 2024-11-03

备注: 16 pages, 10 figures

💡 一句话要点

EcoAct:经济代理决定何时注册何种动作,优化LLM工具使用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 LLM代理 工具使用 上下文优化 推理效率 经济代理 动态注册

📋 核心要点

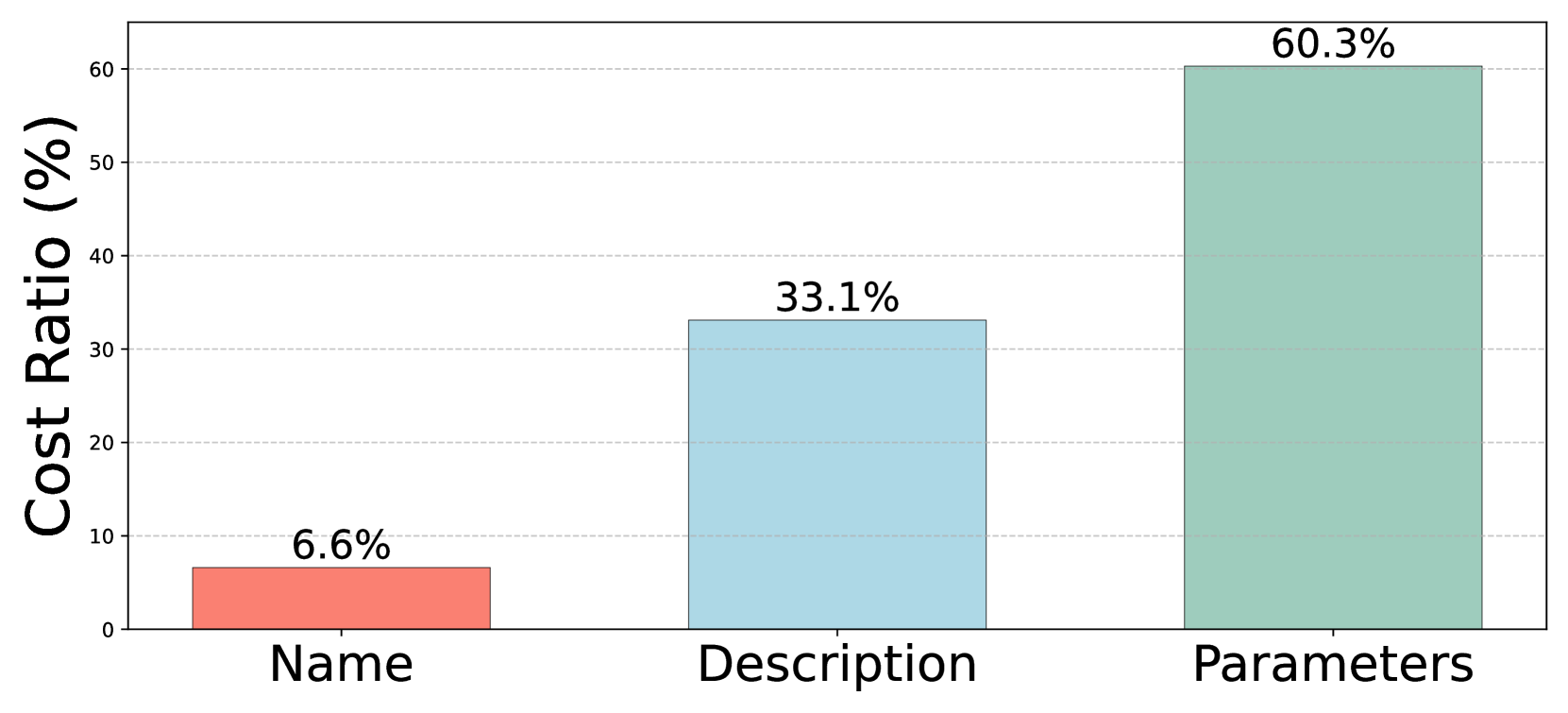

- 现有方法不加区分地将所有候选工具信息加入LLM上下文,导致上下文长度增加,效率降低。

- EcoAct的核心思想是让LLM代理根据需要选择性地注册工具,优化上下文利用率,降低计算成本。

- 实验表明,EcoAct在多步骤推理任务中,能够在保持性能的同时,降低超过50%的计算成本。

📝 摘要(中文)

本文提出了一种名为EcoAct的工具使用算法,旨在解决大型语言模型(LLM)作为代理时,盲目注册所有候选工具并将其保留在多个推理步骤中导致效率低下的问题。EcoAct允许LLM根据需要选择性地注册工具,从而优化上下文的使用。通过将工具注册过程集成到推理过程中,EcoAct在保持性能的同时,在多步骤推理任务中降低了超过50%的计算成本。该方法只需对提示进行少量修改即可插入任何推理流程,使其适用于当前和未来的LLM代理。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)代理在执行任务时,通常需要使用外部工具。然而,现有方法通常会将所有可能的工具信息都注册到LLM的上下文中,即使某些工具在当前推理步骤中并不相关。这导致上下文长度增加,推理效率降低,并且增加了计算成本。现有方法缺乏对工具注册过程的精细控制,无法根据实际需求动态地选择和注册工具。

核心思路:EcoAct的核心思路是将工具注册过程集成到LLM的推理过程中,让LLM代理能够像经济代理一样,根据当前的任务需求和上下文信息,自主决定何时注册哪些工具。通过这种方式,EcoAct可以避免不必要的工具注册,从而减少上下文长度,提高推理效率,并降低计算成本。

技术框架:EcoAct的整体框架包括以下几个主要步骤:首先,LLM代理接收任务输入。然后,代理根据当前的任务需求和上下文信息,决定是否需要注册新的工具。如果需要注册工具,代理会选择合适的工具,并将工具信息注册到上下文中。接下来,代理利用注册的工具进行推理,并生成相应的动作。最后,代理执行动作,并根据执行结果更新上下文信息。整个过程是一个循环迭代的过程,直到任务完成。

关键创新:EcoAct最重要的创新点在于将工具注册过程与LLM的推理过程紧密结合,实现了工具的动态注册和选择。与现有方法不同,EcoAct不是一次性地注册所有工具,而是根据实际需求逐步注册,从而避免了不必要的上下文膨胀。这种动态注册机制使得LLM代理能够更加高效地利用上下文信息,提高推理效率。

关键设计:EcoAct的关键设计包括:1) 使用特定的提示工程,引导LLM代理思考是否需要注册工具;2) 设计一个经济模型,让LLM代理在注册工具时考虑到成本和收益;3) 使用强化学习或其他优化方法,训练LLM代理学习如何有效地选择和注册工具。具体的参数设置和损失函数需要根据具体的任务和数据集进行调整。

🖼️ 关键图片

📊 实验亮点

实验结果表明,EcoAct在多个多步骤推理任务中,能够在保持性能的同时,降低超过50%的计算成本。与基线方法相比,EcoAct能够更有效地利用上下文信息,减少不必要的工具注册,从而提高推理效率。这些结果证明了EcoAct在优化LLM工具使用方面的有效性。

🎯 应用场景

EcoAct具有广泛的应用前景,可以应用于各种需要LLM代理与外部工具交互的场景,例如智能客服、自动化运维、机器人控制等。通过优化工具的使用,EcoAct可以显著降低计算成本,提高系统的响应速度和效率。此外,EcoAct还可以促进LLM代理在资源受限环境中的应用,例如移动设备和嵌入式系统。

📄 摘要(原文)

Recent advancements have enabled Large Language Models (LLMs) to function as agents that can perform actions using external tools. This requires registering, i.e., integrating tool information into the LLM context prior to taking actions. Current methods indiscriminately incorporate all candidate tools into the agent's context and retain them across multiple reasoning steps. This process remains opaque to LLM agents and is not integrated into their reasoning procedures, leading to inefficiencies due to increased context length from irrelevant tools. To address this, we introduce EcoAct, a tool using algorithm that allows LLMs to selectively register tools as needed, optimizing context use. By integrating the tool registration process into the reasoning procedure, EcoAct reduces computational costs by over 50% in multiple steps reasoning tasks while maintaining performance, as demonstrated through extensive experiments. Moreover, it can be plugged into any reasoning pipeline with only minor modifications to the prompt, making it applicable to LLM agents now and future.