From Silos to Systems: Process-Oriented Hazard Analysis for AI Systems

作者: Shalaleh Rismani, Roel Dobbe, AJung Moon

分类: cs.AI, cs.HC

发布日期: 2024-10-29

💡 一句话要点

提出面向AI系统的过程导向型风险分析方法PHASE,系统性识别和缓解AI系统风险。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱三:空间感知与语义 (Perception & Semantics)

关键词: AI系统安全 风险分析 系统理论过程分析 STPA 机器学习安全

📋 核心要点

- 现有AI风险分析方法侧重于孤立组件,忽略了组件交互和开发流程中的系统性风险。

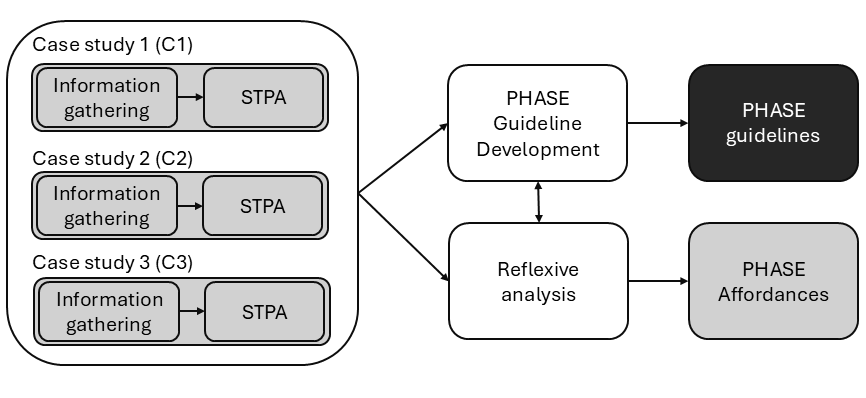

- 论文借鉴系统安全领域的STPA框架,提出PHASE方法,用于AI系统的过程导向型风险分析。

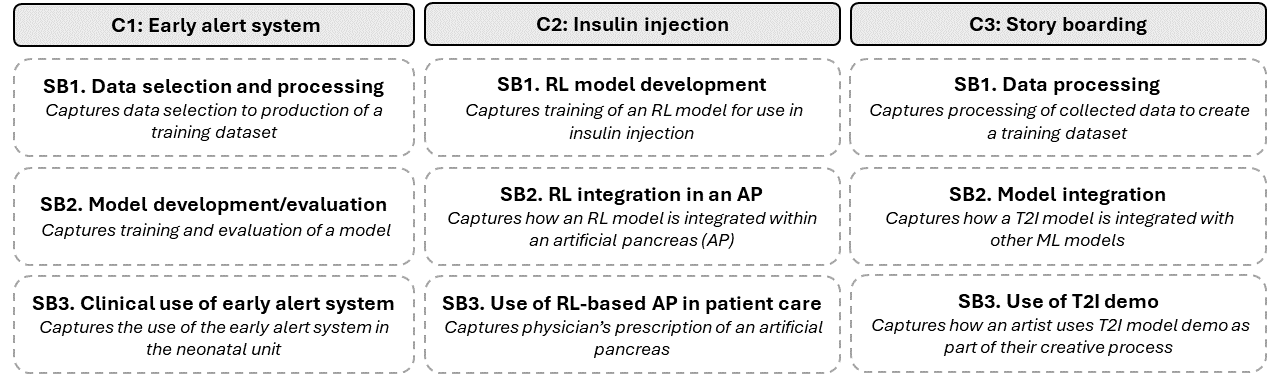

- 通过三个案例研究验证了PHASE方法在识别和缓解AI系统风险方面的有效性,并针对AI特性进行了调整。

📝 摘要(中文)

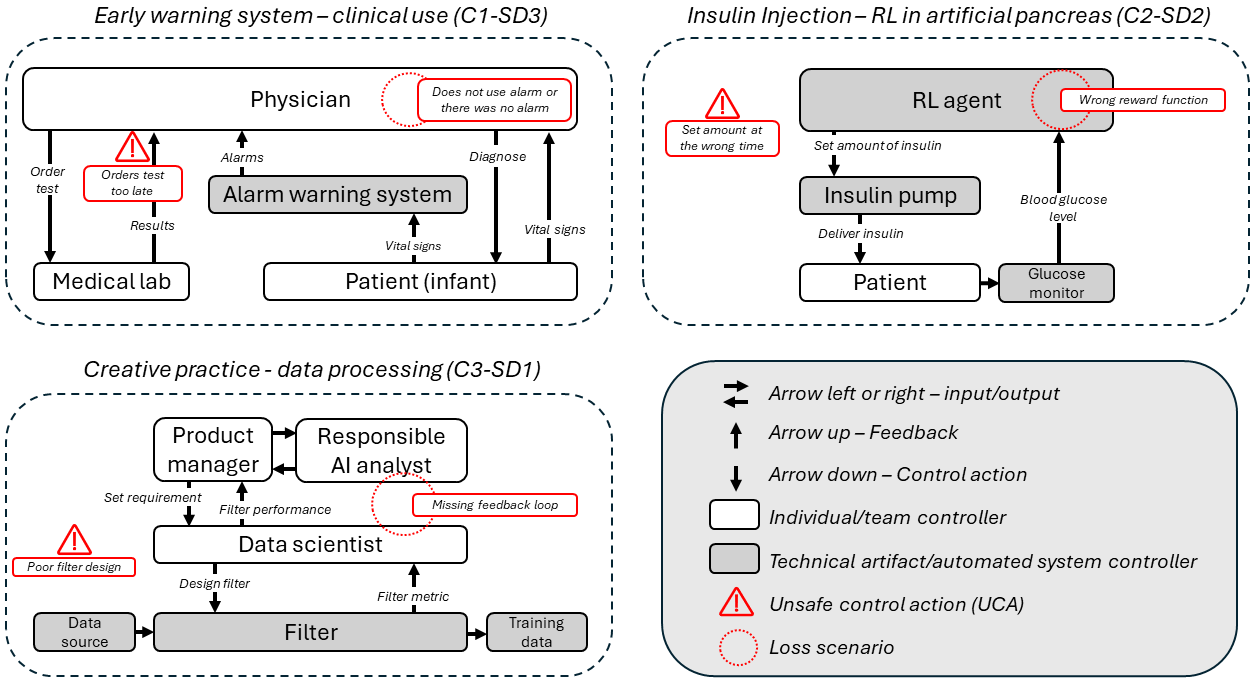

为了有效应对AI系统潜在的危害,识别和缓解系统层面的风险至关重要。现有的分析方法侧重于孤立地分析AI系统的各个组件,如训练数据或模型,忽略了组件交互或它们在公司开发过程中所处位置所带来的风险。为此,我们借鉴了系统安全领域,该领域认为安全是整个系统的涌现属性,而不仅仅是其组件。在这项工作中,我们将系统理论过程分析(STPA)——一种公认的系统安全框架——转化为分析AI操作和开发过程。我们专注于依赖机器学习算法的系统,并对涉及线性回归、强化学习和基于Transformer的生成模型的三个案例研究进行了STPA。我们的分析探讨了STPA的控制和系统理论视角如何应用于AI系统,以及AI的独特特征——如模型不透明性、能力不确定性和输出复杂性——是否需要对框架进行重大修改。我们发现,STPA的关键概念和步骤很容易应用,但需要针对AI系统进行一些调整。我们提出了面向AI系统的过程导向型风险分析(PHASE)作为指南,该指南将STPA概念应用于AI,使基于STPA的风险分析更易于访问。PHASE为负责管理AI系统危害的分析师提供了四个关键功能:1) 检测系统层面的风险,包括来自不同问题积累的风险;2) 明确承认导致算法危害体验的社会因素;3) 在危害和能够减轻危害的人员之间建立可追溯的责任链;4) 持续监测和减轻新的危害。

🔬 方法详解

问题定义:现有AI系统风险分析方法主要关注单个组件,例如训练数据或模型本身,而忽略了组件之间的交互以及AI系统在整个开发流程中所处的位置。这种孤立的分析方式无法有效识别和缓解系统层面的风险,导致潜在危害难以被发现和预防。现有方法缺乏对社会因素的考虑,难以建立危害与责任人之间的联系,也无法进行持续的风险监控和缓解。

核心思路:论文的核心思路是将系统安全领域的系统理论过程分析(STPA)框架应用于AI系统风险分析。STPA将安全视为整个系统的涌现属性,而不仅仅是单个组件的属性。通过分析系统中的控制结构和信息流,可以识别潜在的系统性风险。论文通过将STPA的控制和系统理论视角应用于AI系统,并针对AI的独特特性进行调整,从而实现更全面和有效的风险分析。

技术框架:论文提出的PHASE方法基于STPA框架,主要包含以下几个阶段:1) 定义系统边界和目标;2) 识别系统中的控制结构,包括控制器、受控对象和控制动作;3) 分析不安全控制动作(Unsafe Control Actions, UCAs),即可能导致系统风险的控制动作;4) 确定导致UCAs的原因,包括控制器的缺陷、信息传递的错误等;5) 设计安全约束,以防止UCAs的发生。PHASE方法在STPA的基础上,针对AI系统的特点进行了调整,例如考虑了模型不透明性、能力不确定性和输出复杂性等因素。

关键创新:论文的关键创新在于将STPA框架成功应用于AI系统风险分析,并提出了PHASE方法作为具体实施指南。PHASE方法能够检测系统层面的风险,包括来自不同问题积累的风险;明确承认导致算法危害体验的社会因素;在危害和能够减轻危害的人员之间建立可追溯的责任链;以及持续监测和减轻新的危害。与现有方法相比,PHASE方法更加全面、系统和可操作。

关键设计:PHASE方法的关键设计在于针对AI系统的特点对STPA框架进行了调整。例如,在识别控制结构时,需要考虑AI模型的输入、输出和内部状态;在分析UCAs时,需要考虑模型的不确定性和潜在的偏差;在设计安全约束时,需要考虑如何保证模型的鲁棒性和公平性。此外,PHASE方法还强调了社会因素的重要性,例如数据收集过程中的偏见、模型部署后的滥用等。

🖼️ 关键图片

📊 实验亮点

论文通过三个案例研究验证了PHASE方法的有效性。案例研究涉及线性回归、强化学习和基于Transformer的生成模型。分析结果表明,PHASE方法能够识别出传统方法难以发现的系统性风险,并为制定有效的风险缓解措施提供指导。虽然论文没有提供具体的性能数据或提升幅度,但案例研究表明PHASE方法具有很强的实用价值。

🎯 应用场景

该研究成果可应用于各种依赖机器学习算法的AI系统,例如自动驾驶、医疗诊断、金融风控等。通过使用PHASE方法,可以更有效地识别和缓解AI系统潜在的风险,提高系统的安全性、可靠性和公平性。该研究有助于推动AI技术的健康发展,并为AI伦理和治理提供技术支持。

📄 摘要(原文)

To effectively address potential harms from AI systems, it is essential to identify and mitigate system-level hazards. Current analysis approaches focus on individual components of an AI system, like training data or models, in isolation, overlooking hazards from component interactions or how they are situated within a company's development process. To this end, we draw from the established field of system safety, which considers safety as an emergent property of the entire system, not just its components. In this work, we translate System Theoretic Process Analysis (STPA) - a recognized system safety framework - for analyzing AI operation and development processes. We focus on systems that rely on machine learning algorithms and conducted STPA on three case studies involving linear regression, reinforcement learning, and transformer-based generative models. Our analysis explored how STPA's control and system-theoretic perspectives apply to AI systems and whether unique AI traits - such as model opacity, capability uncertainty, and output complexity - necessitate significant modifications to the framework. We find that the key concepts and steps of conducting an STPA readily apply, albeit with a few adaptations tailored for AI systems. We present the Process-oriented Hazard Analysis for AI Systems (PHASE) as a guideline that adapts STPA concepts for AI, making STPA-based hazard analysis more accessible. PHASE enables four key affordances for analysts responsible for managing AI system harms: 1) detection of hazards at the systems level, including those from accumulation of disparate issues; 2) explicit acknowledgment of social factors contributing to experiences of algorithmic harms; 3) creation of traceable accountability chains between harms and those who can mitigate the harm; and 4) ongoing monitoring and mitigation of new hazards.