Advancing Agentic Systems: Dynamic Task Decomposition, Tool Integration and Evaluation using Novel Metrics and Dataset

作者: Adrian Garret Gabriel, Alaa Alameer Ahmad, Shankar Kumar Jeyakumar

分类: cs.AI, cs.CL, cs.LG, cs.MA

发布日期: 2024-10-29

备注: 38th Conference on Neural Information Processing Systems (NeurIPS 2024), NeurIPS 2024 Workshop on Open-World Agents

💡 一句话要点

提出Agentic系统框架与评估方法,提升复杂任务处理的响应性和可扩展性。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: Agentic系统 任务分解 工具选择 评估指标 大型语言模型

📋 核心要点

- 现有Agentic系统在处理复杂、多步骤任务时,缺乏足够的动态性和适应性,难以有效分解任务和选择工具。

- 提出一种高级Agentic框架,通过异步和动态任务图分解,实现上下文感知的任务处理和工具选择,提升系统响应性和可扩展性。

- 引入Node F1 Score、SSI和Tool F1 Score等评估指标,并构建AsyncHow数据集,为Agentic系统的性能评估提供更全面的视角。

📝 摘要(中文)

本文旨在推进自主Agentic系统的发展,利用大型语言模型实现动态、上下文感知的任务分解和自动工具选择。为此,本文提出了一个高级Agentic框架,该框架能够处理多跳查询,生成并执行任务图,选择合适的工具,并适应实时变化。此外,还引入了Node F1 Score、结构相似性指数(SSI)和Tool F1 Score等新颖的评估指标,并开发了一个基于AsyncHow的专用数据集,用于分析不同任务复杂度下的Agent行为。研究结果表明,异步和动态任务图分解显著提高了系统的响应性和可扩展性,尤其是在处理复杂的多步骤任务时。结构和节点级指标对于顺序任务至关重要,而工具相关指标对于并行任务更为重要。该评估框架通过实证分析和统计测试验证,为提高Agentic系统在动态环境中的适应性和可靠性提供了有价值的见解。

🔬 方法详解

问题定义:现有Agentic系统在处理复杂任务时,任务分解策略不够灵活,难以适应动态变化的环境。工具选择往往依赖于预定义的规则,无法根据上下文进行优化。此外,缺乏有效的评估指标来全面衡量系统的性能,尤其是在结构化和工具使用方面。

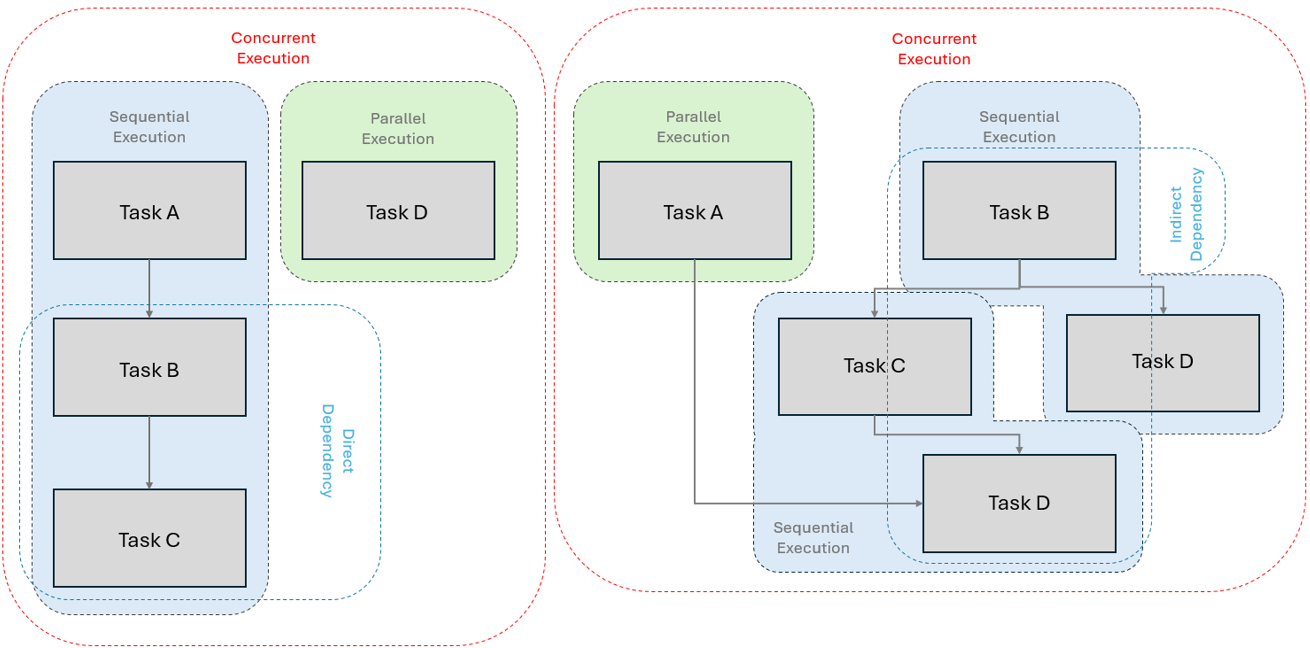

核心思路:本文的核心思路是利用大型语言模型(LLMs)的强大能力,实现动态的任务分解和工具选择。通过构建任务图,将复杂任务分解为更小的子任务,并根据实时环境和上下文信息,选择合适的工具来执行这些子任务。异步执行任务图,提高系统的响应性和可扩展性。

技术框架:该Agentic框架包含以下主要模块:1) 任务分解模块:利用LLM将复杂任务分解为子任务,并构建任务图。2) 工具选择模块:根据子任务的类型和上下文信息,选择合适的工具来执行任务。3) 任务执行模块:异步执行任务图中的子任务,并收集执行结果。4) 评估模块:使用Node F1 Score、SSI和Tool F1 Score等指标来评估系统的性能。

关键创新:最重要的技术创新点在于动态任务图分解和上下文感知的工具选择。与传统的静态任务分解方法相比,该方法能够根据实时环境和上下文信息,动态调整任务图的结构,从而更好地适应复杂任务。此外,使用LLM进行工具选择,能够更准确地选择合适的工具,提高任务执行的效率和质量。

关键设计:AsyncHow数据集的设计考虑了不同任务的复杂度和类型,包括顺序任务和并行任务。Node F1 Score用于评估任务图中节点的准确性,SSI用于评估任务图结构的相似性,Tool F1 Score用于评估工具选择的准确性。这些指标的组合使用,能够更全面地评估Agentic系统的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,异步和动态任务图分解显著提高了系统的响应性和可扩展性。结构相似性指数(SSI)是顺序任务性能的最重要预测指标,而工具F1分数对于并行任务至关重要。通过实证分析和统计测试验证了评估框架的有效性,为提高Agentic系统在动态环境中的适应性和可靠性提供了有价值的见解。

🎯 应用场景

该研究成果可应用于智能客服、自动化流程管理、智能家居等领域。通过自主的任务分解和工具选择,Agentic系统能够更有效地处理复杂的用户请求和自动化任务,提高工作效率和服务质量。未来,该技术有望在更多领域得到应用,例如智能制造、医疗诊断等。

📄 摘要(原文)

Advancements in Large Language Models (LLMs) are revolutionizing the development of autonomous agentic systems by enabling dynamic, context-aware task decomposition and automated tool selection. These sophisticated systems possess significant automation potential across various industries, managing complex tasks, interacting with external systems to enhance knowledge, and executing actions independently. This paper presents three primary contributions to advance this field: - Advanced Agentic Framework: A system that handles multi-hop queries, generates and executes task graphs, selects appropriate tools, and adapts to real-time changes. - Novel Evaluation Metrics: Introduction of Node F1 Score, Structural Similarity Index (SSI), and Tool F1 Score to comprehensively assess agentic systems. - Specialized Dataset: Development of an AsyncHow-based dataset for analyzing agent behavior across different task complexities. Our findings reveal that asynchronous and dynamic task graph decomposition significantly enhances system responsiveness and scalability, particularly for complex, multi-step tasks. Detailed analysis shows that structural and node-level metrics are crucial for sequential tasks, while tool-related metrics are more important for parallel tasks. Specifically, the Structural Similarity Index (SSI) is the most significant predictor of performance in sequential tasks, and the Tool F1 Score is essential for parallel tasks. These insights highlight the need for balanced evaluation methods that capture both structural and operational dimensions of agentic systems. Additionally, our evaluation framework, validated through empirical analysis and statistical testing, provides valuable insights for improving the adaptability and reliability of agentic systems in dynamic environments.