AutoGLM: Autonomous Foundation Agents for GUIs

作者: Xiao Liu, Bo Qin, Dongzhu Liang, Guang Dong, Hanyu Lai, Hanchen Zhang, Hanlin Zhao, Iat Long Iong, Jiadai Sun, Jiaqi Wang, Junjie Gao, Junjun Shan, Kangning Liu, Shudan Zhang, Shuntian Yao, Siyi Cheng, Wentao Yao, Wenyi Zhao, Xinghan Liu, Xinyi Liu, Xinying Chen, Xinyue Yang, Yang Yang, Yifan Xu, Yu Yang, Yujia Wang, Yulin Xu, Zehan Qi, Yuxiao Dong, Jie Tang

分类: cs.HC, cs.AI, cs.CL, cs.LG

发布日期: 2024-10-28

💡 一句话要点

AutoGLM:用于GUI自主控制的通用智能体

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: GUI控制 自主智能体 强化学习 通用人工智能 Web浏览 Android设备 中间接口 渐进式训练

📋 核心要点

- 现有通用模型在动态GUI环境中决策能力不足,限制了其向通用人工智能发展。

- AutoGLM通过设计中间接口分离规划和基础行为,并采用渐进式训练框架进行在线课程强化学习。

- AutoGLM在Web浏览和Android设备控制任务上取得了显著成果,验证了其有效性。

📝 摘要(中文)

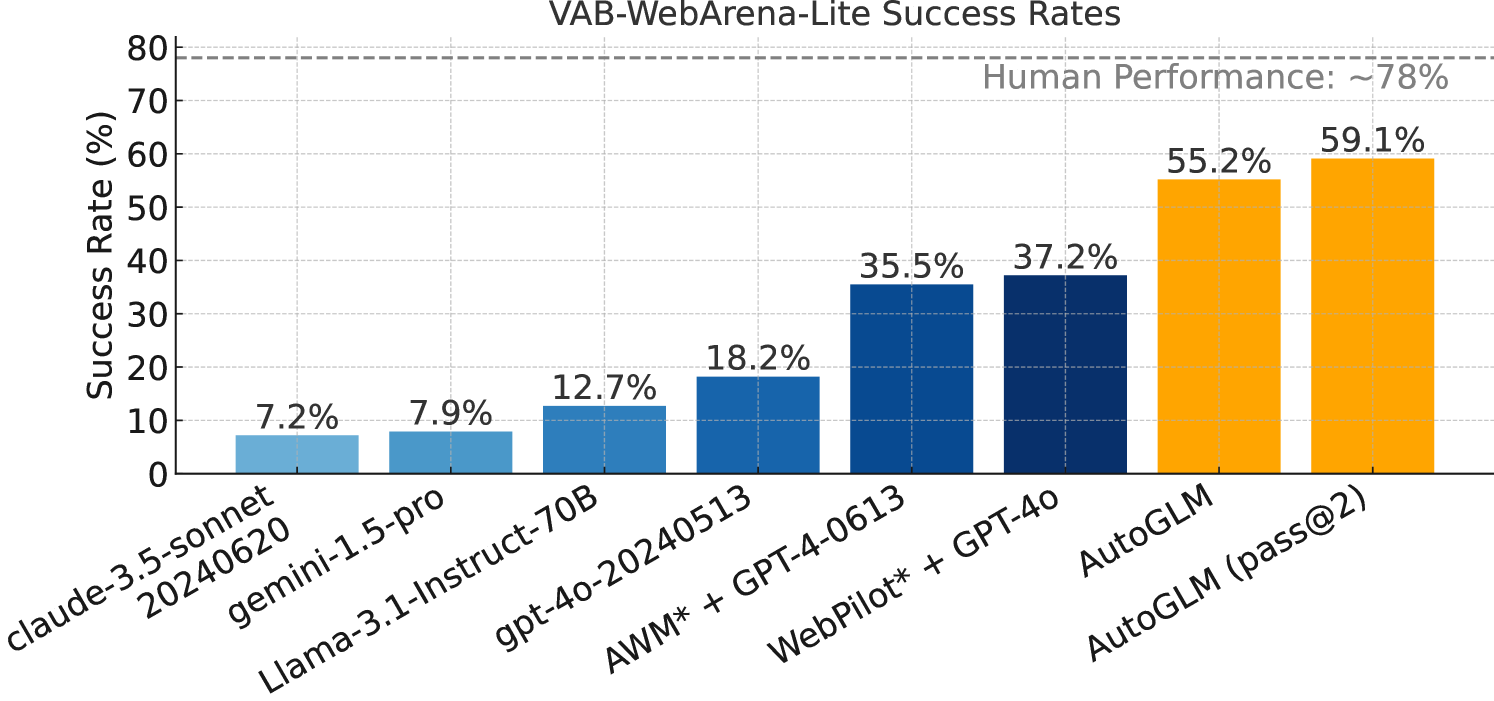

AutoGLM是ChatGLM系列的新成员,旨在作为通用智能体,通过图形用户界面(GUI)自主控制数字设备。尽管通用模型擅长获取人类知识,但它们在动态现实环境中进行决策时常常遇到困难,限制了它们在通用人工智能方面的进展。这种局限性突显了开发能够通过自主环境交互来学习的通用智能体的重要性,从而增强现有模型。AutoGLM专注于Web浏览器和手机这两个代表性的GUI场景,作为一个实用的通用智能体系统,用于现实世界的GUI交互。该方法集成了一套全面的技术和基础设施,以创建适用于用户交付的可部署智能体系统。通过这项开发,我们得出了两个关键见解:首先,GUI控制的适当“中间接口”的设计至关重要,它能够分离规划和基础行为,这两种行为分别需要不同的优化以实现灵活性和准确性。其次,我们开发了一种新颖的渐进式训练框架,该框架能够为AutoGLM实现自我进化的在线课程强化学习。我们的评估表明AutoGLM在多个领域都有效。在Web浏览方面,AutoGLM在VAB-WebArena-Lite上的成功率为55.2%(第二次尝试提高到59.1%),在OpenTable评估任务中的成功率为96.2%。在Android设备控制方面,AutoGLM在AndroidLab(VAB-Mobile)上的成功率为36.2%,在流行的中国APP中的常见任务中的成功率为89.7%。

🔬 方法详解

问题定义:论文旨在解决通用模型在图形用户界面(GUI)环境中自主决策能力不足的问题。现有方法通常难以在动态、复杂的GUI环境中进行有效的规划和执行,导致任务完成率较低。痛点在于模型难以将高层次的任务目标转化为具体的GUI操作序列,并且缺乏有效的学习机制来适应不同的GUI环境。

核心思路:论文的核心思路是设计一个能够分离规划和基础行为的中间接口,并结合渐进式训练框架进行在线课程强化学习。通过中间接口,模型可以将高层次的任务目标分解为一系列抽象的动作指令,然后由专门的模块负责将这些指令转化为具体的GUI操作。渐进式训练框架则允许模型在不断与环境交互的过程中,逐步学习更复杂的任务。

技术框架:AutoGLM的整体架构包含以下几个主要模块:1) 任务理解模块:负责理解用户的任务目标,并将其转化为内部表示。2) 规划模块:根据任务目标和当前GUI状态,生成一系列抽象的动作指令。3) 执行模块:将抽象的动作指令转化为具体的GUI操作,并与GUI环境进行交互。4) 学习模块:根据任务的完成情况和环境的反馈,更新模型的参数。

关键创新:论文最重要的技术创新点在于中间接口的设计和渐进式训练框架的引入。中间接口有效地分离了规划和基础行为,使得模型可以更加灵活地适应不同的GUI环境。渐进式训练框架则允许模型在不断与环境交互的过程中,逐步学习更复杂的任务,提高了模型的泛化能力。

关键设计:中间接口的设计需要仔细考虑抽象动作指令的粒度和表达能力。渐进式训练框架的关键在于如何设计合适的课程,以及如何平衡探索和利用。论文中可能还涉及到一些关键的参数设置,例如学习率、折扣因子等,以及一些特定的网络结构,例如用于表示GUI状态的卷积神经网络等。具体细节未知,需要查阅论文原文。

🖼️ 关键图片

📊 实验亮点

AutoGLM在多个GUI任务上取得了显著的成果。在Web浏览方面,AutoGLM在VAB-WebArena-Lite上的成功率为55.2%(第二次尝试提高到59.1%),在OpenTable评估任务中的成功率为96.2%。在Android设备控制方面,AutoGLM在AndroidLab(VAB-Mobile)上的成功率为36.2%,在流行的中国APP中的常见任务中的成功率为89.7%。这些结果表明AutoGLM在GUI自主控制方面具有很强的竞争力。

🎯 应用场景

AutoGLM具有广泛的应用前景,可用于自动化测试、智能助手、无障碍辅助等领域。例如,可以利用AutoGLM自动测试软件的功能,提高测试效率;可以将其集成到智能助手中,帮助用户完成各种GUI操作;还可以为残疾人士提供无障碍辅助,让他们能够更加方便地使用数字设备。未来,AutoGLM有望成为通用人工智能的重要组成部分。

📄 摘要(原文)

We present AutoGLM, a new series in the ChatGLM family, designed to serve as foundation agents for autonomous control of digital devices through Graphical User Interfaces (GUIs). While foundation models excel at acquiring human knowledge, they often struggle with decision-making in dynamic real-world environments, limiting their progress toward artificial general intelligence. This limitation underscores the importance of developing foundation agents capable of learning through autonomous environmental interactions by reinforcing existing models. Focusing on Web Browser and Phone as representative GUI scenarios, we have developed AutoGLM as a practical foundation agent system for real-world GUI interactions. Our approach integrates a comprehensive suite of techniques and infrastructures to create deployable agent systems suitable for user delivery. Through this development, we have derived two key insights: First, the design of an appropriate "intermediate interface" for GUI control is crucial, enabling the separation of planning and grounding behaviors, which require distinct optimization for flexibility and accuracy respectively. Second, we have developed a novel progressive training framework that enables self-evolving online curriculum reinforcement learning for AutoGLM. Our evaluations demonstrate AutoGLM's effectiveness across multiple domains. For web browsing, AutoGLM achieves a 55.2% success rate on VAB-WebArena-Lite (improving to 59.1% with a second attempt) and 96.2% on OpenTable evaluation tasks. In Android device control, AutoGLM attains a 36.2% success rate on AndroidLab (VAB-Mobile) and 89.7% on common tasks in popular Chinese APPs.