MAMMAL -- Molecular Aligned Multi-Modal Architecture and Language

作者: Yoel Shoshan, Moshiko Raboh, Michal Ozery-Flato, Vadim Ratner, Alex Golts, Jeffrey K. Weber, Ella Barkan, Simona Rabinovici-Cohen, Sagi Polaczek, Ido Amos, Ben Shapira, Liam Hazan, Matan Ninio, Sivan Ravid, Michael M. Danziger, Yosi Shamay, Sharon Kurant, Joseph A. Morrone, Parthasarathy Suryanarayanan, Michal Rosen-Zvi, Efrat Hexter

分类: q-bio.QM, cs.AI, cs.LG

发布日期: 2024-10-28 (更新: 2025-05-06)

🔗 代码/项目: GITHUB | HUGGINGFACE

💡 一句话要点

MAMMAL:分子对齐多模态架构与语言模型,用于生物学多任务学习。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态学习 生物信息学 药物发现 蛋白质工程 基因组学 语言模型 分子对齐

📋 核心要点

- 现有生物学语言模型在处理多模态数据交互方面存在局限性,无法有效整合蛋白质、小分子和组学数据。

- MAMMAL通过分子对齐的多模态架构,构建统一的多任务基础模型,支持分类、回归和生成等多种任务。

- 实验结果表明,MAMMAL在多个生物学下游任务中达到或接近SOTA,并在抗原抗体结合预测中表现更优。

📝 摘要(中文)

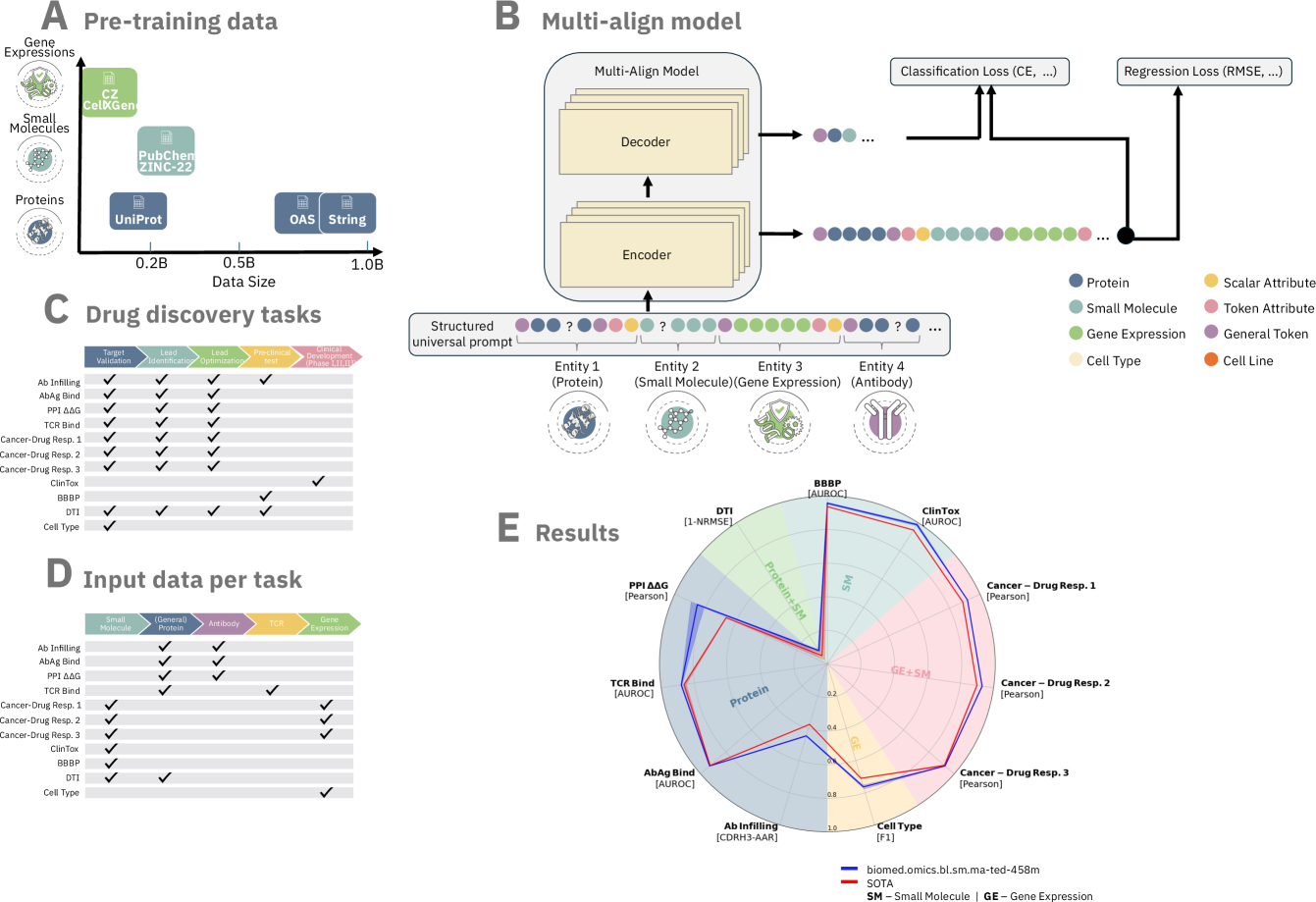

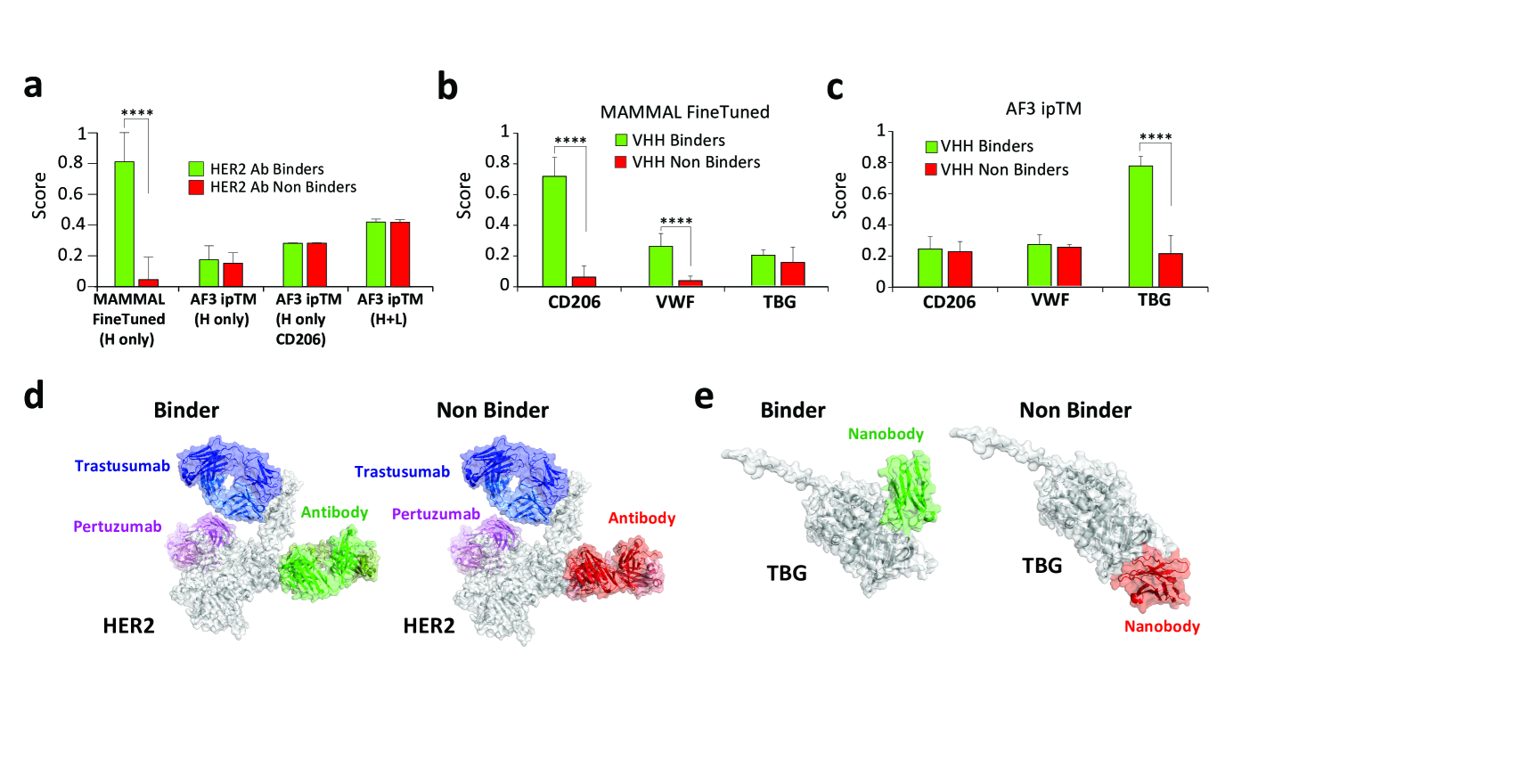

大型语言模型应用于海量生物数据集,有潜力通过揭示疾病机制和加速药物开发来变革生物学。然而,目前的模型通常是孤立的,分别在小分子、蛋白质或转录组数据上进行训练,限制了它们捕捉复杂的多模态交互的能力。有效的药物发现需要能够整合多种生物实体,同时支持预测和生成的计算工具,这是现有模型难以解决的挑战。为此,我们提出了MAMMAL——分子对齐多模态架构与语言模型——一种通用的方法,用于创建一个多任务基础模型,该模型从跨多种模态的大规模生物数据集(包括蛋白质、小分子和组学)中学习。MAMMAL的结构化提示语法支持分类、回归和生成任务,同时处理token和标量输入和输出。在11个不同的下游任务上进行评估,它在9个任务中达到了新的state-of-the-art (SOTA),并在2个任务中与SOTA相当,所有这些都在一个统一的架构中,这与之前的特定任务模型不同。此外,我们探索了Alphafold 3在抗体-抗原和纳米抗体-抗原复合物上的结合预测能力,表明MAMMAL在4个目标中的3个目标上具有明显更好的分类性能。模型代码和预训练权重可在https://github.com/BiomedSciAI/biomed-multi-alignment 和 https://huggingface.co/ibm/biomed.omics.bl.sm.ma-ted-458m 公开获取。

🔬 方法详解

问题定义:现有生物学语言模型通常针对特定模态的数据进行训练,例如蛋白质、小分子或基因组数据,缺乏整合多种生物实体信息的能力。这限制了它们在药物发现等复杂任务中的应用,因为这些任务需要理解不同生物分子之间的相互作用。现有方法难以同时支持预测和生成任务,并且通常需要针对特定任务进行定制。

核心思路:MAMMAL的核心思路是构建一个统一的多模态架构,能够同时处理蛋白质、小分子和组学数据。通过分子对齐的方式,将不同模态的数据映射到同一个语义空间,从而实现跨模态信息的有效整合。利用结构化的prompt语法,使得模型能够灵活地适应不同的下游任务,包括分类、回归和生成。

技术框架:MAMMAL的整体架构基于Transformer模型,并针对生物学数据的特点进行了优化。它包含以下主要模块:1) 多模态嵌入模块,用于将蛋白质、小分子和组学数据转换为向量表示;2) 分子对齐模块,用于将不同模态的向量表示映射到同一个语义空间;3) Transformer编码器,用于学习跨模态信息的交互;4) 任务特定解码器,用于执行分类、回归和生成等下游任务。模型使用结构化的prompt语法,允许用户指定输入和输出的类型,从而灵活地适应不同的任务。

关键创新:MAMMAL最重要的技术创新点在于其分子对齐的多模态架构,能够有效地整合不同模态的生物学数据。与现有方法相比,MAMMAL不需要针对特定任务进行定制,而是可以通过结构化的prompt语法灵活地适应不同的下游任务。此外,MAMMAL在抗原抗体结合预测任务中表现出优异的性能,表明其能够有效地捕捉生物分子之间的相互作用。

关键设计:MAMMAL的关键设计包括:1) 使用预训练的蛋白质语言模型(例如ESM)初始化蛋白质嵌入模块;2) 使用图神经网络(例如GCN)处理小分子数据;3) 使用自注意力机制学习跨模态信息的交互;4) 使用对比学习损失函数进行分子对齐;5) 使用结构化的prompt语法指定输入和输出的类型。具体的参数设置和网络结构细节在论文中有详细描述。

🖼️ 关键图片

📊 实验亮点

MAMMAL在11个不同的生物学下游任务上进行了评估,并在9个任务中达到了新的SOTA。在抗原抗体结合预测任务中,MAMMAL在4个目标中的3个目标上表现出明显优于Alphafold 3的分类性能。这些结果表明MAMMAL能够有效地整合多模态生物学数据,并在多个任务中取得显著的性能提升。

🎯 应用场景

MAMMAL具有广泛的应用前景,包括药物发现、疾病机制研究和生物标志物识别。它可以用于预测药物与靶标蛋白的结合亲和力,生成具有特定性质的候选药物分子,以及识别与疾病相关的基因或蛋白质。该模型有望加速药物开发进程,并为个性化医疗提供新的工具。

📄 摘要(原文)

Large language models applied to vast biological datasets have the potential to transform biology by uncovering disease mechanisms and accelerating drug development. However, current models are often siloed, trained separately on small-molecules, proteins, or transcriptomic data, limiting their ability to capture complex, multi-modal interactions. Effective drug discovery requires computational tools that integrate multiple biological entities while supporting prediction and generation, a challenge existing models struggle to address. For this purpose, we present MAMMAL - Molecular Aligned Multi-Modal Architecture and Language - a versatile method applied to create a multi-task foundation model that learns from large-scale biological datasets across diverse modalities, including proteins, small-molecules, and omics. MAMMAL's structured prompt syntax supports classification, regression, and generation tasks while handling token and scalar inputs and outputs. Evaluated on eleven diverse downstream tasks, it reaches a new state of the art (SOTA) in nine tasks and is comparable to SOTA in two tasks, all within a unified architecture, unlike prior task-specific models. Additionally, we explored Alphafold 3 binding prediction capabilities on antibody-antigen and nanobody-antigen complexes showing significantly better classification performance of MAMMAL in 3 out of 4 targets. The model code and pretrained weights are publicly available at https://github.com/BiomedSciAI/biomed-multi-alignment and https://huggingface.co/ibm/biomed.omics.bl.sm.ma-ted-458m